iMotionsチームは、人間の行動に関する研究を幅広いテーマで取り上げた、ライブおよび録画形式のウェビナーコンテンツの第2弾を制作しました。専門家パネルには、社内の博士号を持つ科学者、プロダクトスペシャリスト、カスタマーサクセスマネージャーに加え、クライアントやハードウェアパートナーからのゲストも登壇しました。

「ウェビナー第1弾」シリーズには、延べ1,500名以上の方にご登録いただきました!第2弾のウェビナーシリーズでは、人間行動研究の応用や実世界の活用事例について掘り下げる4つのウェビナーを開催し、全日程を終了しました。

見逃してしまいましたか?ご安心ください。ウェビナーは録画されていますので、取り上げられたトピックについてさらに詳しく知りたい方は、当社の「ウェビナー」ページからご覧いただけます。

- 研究室の外へ:パフォーマンス向上トレーニング環境におけるバイオセンサーの活用

- iMotionsを使ったリモート調査:自宅のソファから顔の表情分析と行動コーディング

- iMotions API:それは何なのか、そして研究効果を最大化するためにどのように活用できるのか?

- iMotionsとVarjoを活用したバーチャル環境での医療トレーニング

第2回ウェビナーシリーズの主な内容は以下の通りです:

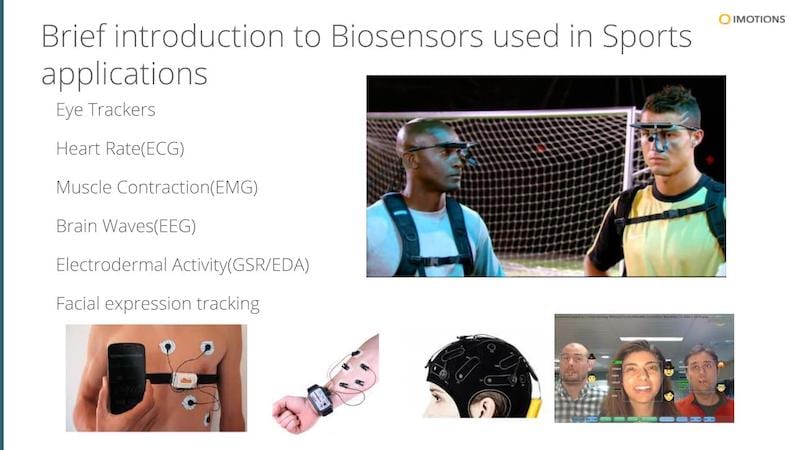

ウェビナー:研究室の枠を超えて:パフォーマンストレーニング環境におけるバイオセンサーの応用

営業担当のデビッド・シュルマンと神経科学製品スペシャリストのナム・グエンが、運動学の専門家であるゲストパネリストのデレク・マン博士を迎え、フロリダ州ジャクソンビル大学での研究についてお話しいただきました。

デレク・マン博士は、民間企業において、トップアスリート、軍関係者、企業幹部を対象に10年以上にわたり指導を行ってきました。彼は、人間のパフォーマンスにおける精神的、感情的、注意力の側面に関する専門家であり、特に高ストレス環境下における知覚や認知反応、およびパフォーマンスの分野を専門としています。

スポーツ分野におけるバイオセンサーの活用:パフォーマンスの向上

アスリートのパフォーマンス向上に役立つアイトラッカー

- アスリートは何を注視しているのか(注視点)?

- プレーヤーは、プレーが展開している最中にそれをどのように読み取っているのでしょうか?

- その選手は、本当に重要なことに集中しているだろうか?

心拍数(心電図)を用いて改善すべき点を見つける

- どのくらいで回復できますか?

- 心拍数を上昇させる要因は何でしょうか?

- ストレスの原因を特定し、それに対処することで、プレッシャーの中でも冷静さを保つ

筋収縮 ― 行動を理解するための筋電図(EMG)

- 筋肉の動きや活動をより深く理解する方法

- 特定の感情や行動の結果との関連性を調査する

認知的負荷に関する脳波(EEG):

- 選手の認知的負荷に関する知見を得る

- アスリートは、反応時間を向上させるために、どのように周囲の状況を把握しているのでしょうか?

- 彼らは決断を下すのにどれくらい時間がかかっているのでしょうか?

アスリートのパフォーマンス向上に役立つ皮膚電気反応(EDA/GSR):

- アスリートたちをワクワクさせるものは何でしょうか?

- アスリートが周囲の状況からヒントを得て、より良いパフォーマンスを発揮できるようトレーニングすることは可能だろうか?

トレーニング強度のための表情分析(FEA)

- その特定の瞬間に、どのような感情が表れていたのでしょうか?

- 「ゲームフェイス」の神経力学

- 表情からトレーニングの強度を把握する

注目質問

なぜスポーツトレーニングの分野では、その疑問を解明するために神経科学を活用しているのでしょうか?

従来は、自己申告と観察が唯一の手段でした。しかし現在では、より深い洞察を得るために、一貫性と再現性を高めるための追加データが必要とされています。バイオセンサーを活用することで、参加者自身では思い出せなかったり説明できなかったりするような、新たなレベルの洞察を得ることができます。これにより、選手のパフォーマンスを理解する上で、主観的かつ客観的な情報が加わることになります。実際に何が起きているのかをさらに深く解明し、さまざまなレベルの認知プロセスを明らかにすることが可能になります。

バイオセンサーデータの取り扱いにおいて、最大の課題は何ですか?

まず第一に、現実的な視点を持って、データ収集の対象を最も重要な1~3つの変数に絞り込むことが重要です。 実用的な場面で活用する前に、まず試験運用を行い、安全な環境下でデータが何を示しているかを理解することが不可欠です。次に、選手やコーチの理解と協力を得ることも課題となり得ます。データを意味のある形に加工する後処理には時間がかかる場合があります。このことから、プロセスを効率化し、情報を迅速に提供することの重要性が浮き彫りになります。iMotionsのソフトウェアは、この点においてデータ処理を支援し、迅速かつ効果的に結果を出すのに役立っています。

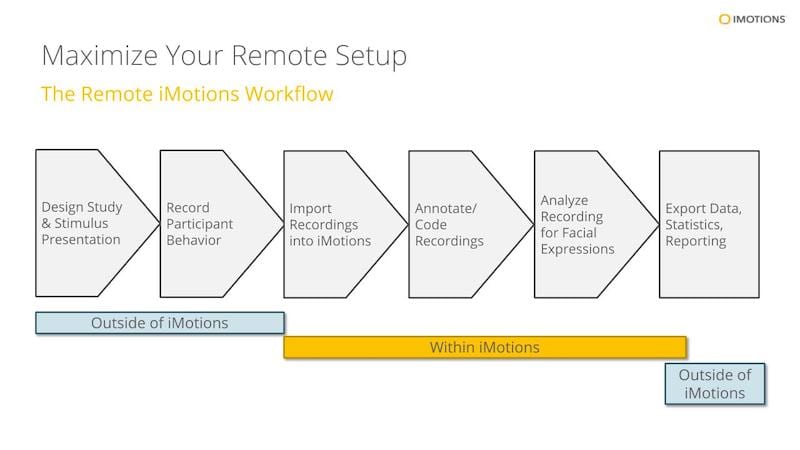

ウェビナー:iMotionsを活用したリモート調査:自宅のソファからできる表情分析と行動コーディング

ソーシャルディスタンスが求められるこの新しい時代は、人間の行動を研究する研究者たちに新たな課題をもたらしました。 被験者を実験室に招くことがもはや現実的ではなくなった場合、どうすればよいのでしょうか?神経科学者のジェシカ・ウィルソン博士と営業担当のケイト・ウィアー氏は、感情の価値(ヴァレンス)に関する知見を得るために、録画データに注釈を付けたり、事前に録画された顔の動画を後処理したりする方法について解説しました。両氏は、iMotionsプラットフォームでのデモを交えながら、注釈ツールによる行動コーディングや表情分析など、iMotionsが提供する遠隔操作機能のすべてを紹介しました。

iMotionsプラットフォームを用いた行動コーディング

行動コーディングとは、訓練を受けた担当者がラベル付けを行う、参加者に関する体系的かつ標準化された定量可能な観察結果の集まりである。アンケート調査が参加者の体験に対する主観的な評価を反映するのに対し、行動データは研究者による客観的な尺度に基づいて体系化される。したがって、行動コーディングは、生理学的データや自己報告を補完する豊富な情報源となる。

行動コーディングシステムは通常、特定の研究に固有のものであり、研究課題に大きく依存するため、万能な手法など存在しません。行動は、刺激に対するユーザーの反応をより包括的に説明するために、離散的なイベントとして、あるいは連続的なイベントとしてコーディングすることができます。心理学、UX、マーケティングなどの分野では、行動コーディングを採用した多くの活用例が見られます。

この分析的アプローチは、消費者がどのように様々な感覚情報を処理して選択を行うかを理解することなど、多岐にわたる分野に応用されています。多感覚知覚や食品に関する意思決定に関する知見を探求することで、感覚が購買習慣にどのような影響を与えるのかについて、さらに深く掘り下げてみましょう。

アノテーションを用いた行動コーディング

iMotionsの「アノテーション」機能を使用すると、これらのコードをすべて、割り当てられた色やホットキーとともに研究データに埋め込み、フレーム単位でのコーディングが可能になります。また、イベントの背景を説明するコメントを追加することもでき、後処理での分析が容易になります。iMotionsで録画を確認する際、これらのイベントはタイムライン上に表示され、継続時間、開始・終了時刻、関連するコメントなどの重要な情報は、「マーカーデータ」のエクスポート機能から取り出すことができます。

「iMotionsでの行動コーディングの方法」をご覧ください

表情分析

iMotionsを使用すれば、参加者の顔を撮影した事前録画映像をソフトウェアに取り込み、自動顔表情解析技術を用いて表現された感情を分析することができます。個人単位でもグループ単位でも、個々の顔を特定し、事後的に分析することが可能です。この機能により、研究者は新たに録画した映像に対して顔表情分析を行うだけでなく、データベースに保存されている既存のコンテンツを再検討し、さらなる分析を行うことも可能になります。

以下の画像は、研究者がウェブカメラや画面共有を通じて参加者の行動を記録するために利用できるソフトウェアの一部を示しています。研究の対象となる例としては、ウェブサイトのレイアウト(UX)、画像、動画、ゲーム、その他あらゆる種類の視覚的刺激などが挙げられます。

当社のブログをご覧ください:「表情分析(FEA)をリモートで行う方法」

注目質問

「パフォーマンス&トレーニング」における行動コーディングは、どのような付加価値をもたらすのでしょうか?

当社は政府機関や大学と連携し、業務パフォーマンスの分析や研修の分野で活動してきました。定量的な指標を用いることで、センサーデータだけでは把握できない行動の背景を理解することが可能になります。具体的な例としては、1)効率性:作業時間やクリック数など、ワークフローの状況を把握できる指標、2)医師の研修:初心者と熟練者の手術の比較、習得スキルセットなどが挙げられます。

リモートでのデータ収集を行う際、ハードウェアや環境の制約についてはどうでしょうか?

当社のエンジンの強みのひとつは、特にAffectiva-Affdexを使用する場合、通常のウェブカメラやパソコンの内蔵カメラでも録画が可能である点です(最低解像度640×480ピクセル、または顔サイズ120ピクセル以上)。 照明が問題となる可能性があるため、参加者の顔が露出過多にならないよう、また他の光源による逆光にならないよう注意することが重要です。参加者は適切な録画設定について事前に説明を受け、データ収集前にウェブカメラを適切に調整する必要があります。

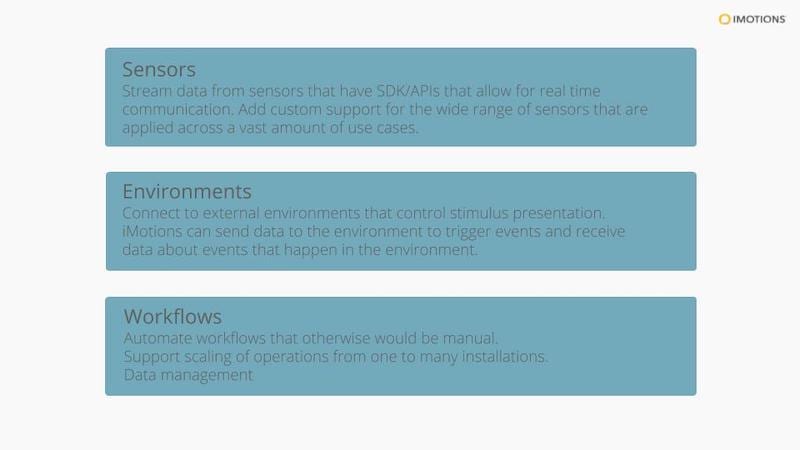

ウェビナー:iMotions API:その概要と、研究効果を最大化するための活用方法

サードパーティのデータをiMotionsに取り込み、iMotionsと通信させる必要がある研究環境において、iMotions APIをどのように活用すればよいでしょうか?プロダクトディレクターのオレ・ジェンセンとカスタマーサクセスマネージャーのトゥエ・フヴァス博士が、システム統合やワークフローの自動化、仮想環境(Unity)、ウェアラブルデバイス、Bluetoothを用いた標準通信プロトコルを中心としたAPIの活用事例を紹介しました。 デモンストレーションでは、コード設定の概要に加え、iMotionsプラットフォーム上でのライブデモも行われました。

キャプション:API を使用することで、(iMotions に統合されていない)センサー、刺激提示用の環境、およびワークフローに接続し、自動化を実現できます

キャプション:API を使用することで、(iMotions に統合されていない)センサー、刺激提示用の環境、およびワークフローに接続し、自動化を実現できます

iMotions APIの機能:

- 入力API/イベント受信:サードパーティ製センサーなどからiMotionsへデータをストリーミングします。

- 出力API/イベント配信:iMotionsから生体センサーデータ(GSRやアイトラッキングデータなど)を出力します。

- リモートコントロール:iMotionsにコマンドを送信します(例:記録の開始・停止、データのエクスポートなど)。

- Lab Streaming Layer (LSL):オープンなLSLプロトコルを使用して、iMotionsにデータをストリーミングします。

当社のブログをご覧ください:「APIとは?(その仕組みは?)」

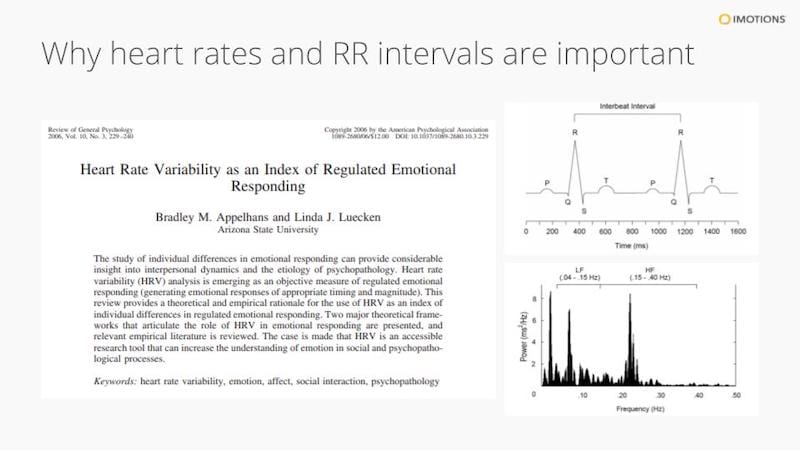

MATLABを使用したBluetoothウェアラブルの例

Tue Hvass博士は、MATLABを用いて心拍数モニタリング用ウェアラブルデバイス「Polar Chest Strap (H10)」のデモを行いました。この低消費電力のBluetooth対応ウェアラブルデバイスは、充電なしで数時間にわたり心電図(ECG)データを収集・ストリーミングする機能を備えています。 このAPIにより、デバイスはBluetooth経由でiMotionsソフトウェアにデータを共有し、RR間隔の可視化とともにデータ記録を取得することができます。iMotionsで生成された透過的なRコードを使用することで、平均BPM(1分間の心拍数)および心拍変動(HRV)を確認できます。HRVは、感情調節能力に関連する生理学的指標です。

心拍数と呼吸間隔はなぜ重要なのでしょうか? これらは、感情的な覚醒や感情の調節を示す指標として活用できます。心電図(ECG)を他の生体センサーの測定値と組み合わせることで、人の思考、感情、行動をより包括的に理解することが可能になります。各センサーの相補性を活用して人間の反応の異なる側面を理解することで(例えば、表情分析と心電図を組み合わせることで感情と覚醒の両方を把握するなど)、その人が世界をどのように体験しているのかについて、明確な全体像を把握することが可能になります。

「心拍変動(HRV)――心電図データの分析方法」をご覧ください

iMotionsとUnity環境間の双方向通信の例

Ole Jensen氏は、Shimmer GSRバイオセンサーを使用してUnity環境内の仮想車を制御する双方向通信の例を実演しました。彼はShimmerセンサーに内蔵された加速度センサーを利用して仮想車を制御し、センサーを2軸で傾けることで前進・後退・左右への移動を実現しました。加速度センサーのデータは、イベント転送機能を用いてiMotionsからUnityへ転送されます。 同時に、iMotionsはShimmerセンサーからのGSRデータとともに視覚的な情報を記録します。さらに、Unity環境はイベント受信インターフェースを使用して、ゲームのテレメトリデータをiMotionsに送信するようにプログラムされています。

テレメトリは、ゲーム分析における基本的な用語の一つです。ユーザー行動のテレメトリデータの収集、分析、およびレポート作成は、現在のゲーム開発における分析の基盤となっています。これは、一般消費者向けゲームやシリアスゲーム(学習用など)、そしてシミュレーションベースの体験全般に当てはまります。

「ゲームやVRにおける人間の体験を測定する方法」をご覧ください

注目質問

同時に何台のPolar(ECG)ベルトを追跡できますか?もし複数台の場合、信号干渉にはどのように対処しますか?

複数のPolarデバイスを1台のスマートフォンに接続した例はありますが、今回紹介されたコードではその動作は確認されていません。iMotionsには複数の生体センサーからデータを収集する機能があるため、理論上は可能です。

これは自動車業界で採用されたことはありますか?

これに関連する資料や事例研究をいくつかご用意しています。自動車業界では、さまざまな用途があります。例えば、半自動運転車、ヒューマン・マシン・トラスト・インターフェース、さらには運転時のユーザー体験などです。

スタンフォード大学デザインセンターが、バイオセンサーやその他の人的行動分析技術を統合したシミュレーターをどのように活用しているか、ぜひご覧ください。

iMotionsとVarjoを活用したバーチャル環境での医療トレーニング

バーチャルリアリティ(VR)は、環境を制御できるという特長から、医療などの分野における専門家の育成に素晴らしい可能性をもたらしています。実際、マルチモーダル生体センサーとVRツールを組み合わせることで、医療従事者は迅速かつ有意義な知見を得ることが可能になります。iMotionsとVarjoは、25年以上の外科手術経験を持ち、医療教育におけるVRの強力な提唱者であるラファエル・グロスマン医師(MD、FACS)を特別ゲストに迎え、ウェビナーを開催しました。

このウェビナーは、iMotionsのパートナーシップ担当ディレクターであり、15年以上の心理生理学研究の経験を持つロクサナ・サリム氏が司会を務めました。また、バーチャルリアリティ(VR)ハードウェア開発において7年以上の経験を持つ、Varjoの事業開発責任者であるジェフ・バンド氏が共同司会を務めました。

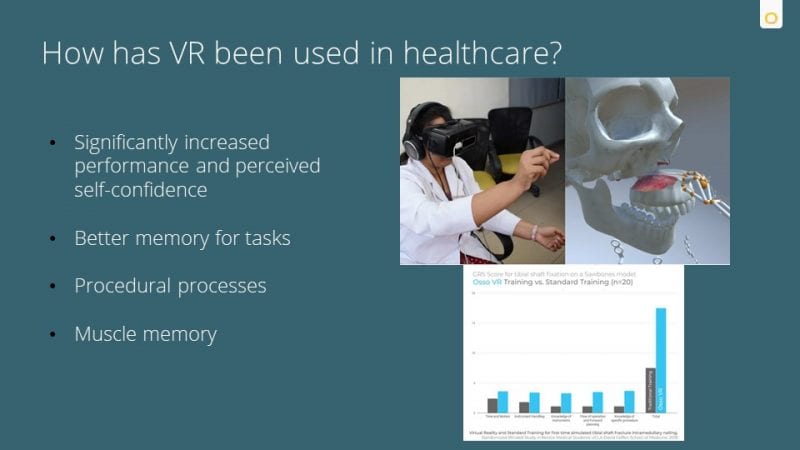

医療業界において、バーチャルリアリティ(VR)と生体センサーをどのように活用できるでしょうか。VR療法の活用例は多岐にわたり、恐怖症の軽減から、最近では外科手術のトレーニングや研究に至るまで広がっています。近年、VRを支える技術が進歩し、さまざまな場面での普及が可能になっています。2016年以降、バーチャルリアリティ(VR)技術の活用に関する論文やトレーニングが急増しています。

バーチャル環境を活用すれば、外科手術のトレーニングは従来の枠を超えてさらに高度なものになる。

- パフォーマンスと自信を大幅に向上させる

- タスクの記憶力が向上する

- 手続き的プロセス

- 筋肉の記憶

「バイオセンサーが医療の質向上に役立っている4つの感動的な事例」をご覧ください

こうした研究の中には、手術体験全体に焦点を当て、研修医の体験に関する情報を自己申告に依存して収集する傾向にあるものもある。それらは、特定の行動結果につながる根本的なメカニズムを必ずしも解明しているわけではない。手術には、認知的負荷が高く、あるいはストレスを感じやすい側面があり、それらをバイオセンサーを用いて把握し、対処することが可能かもしれない。

バイオセンサーは、医療従事者が適切な問いを立てる手助けをします

アイトラッキング:Varjoヘッドセットに内蔵されており、視覚的な注意の向け先に関する知見を提供します

- 手術室のどのような要素に注意が払われているか

- 見落とされているが、本来は重視すべき重要な要素はありますか?

皮膚電気活動(EDA)と心電図(ECG)は、感情的な興奮やストレスに関する知見をもたらすことができる

- トレーニング課題のどの側面が、より高いストレスレベルにつながるのか、その一端がうかがえる

- 初心者が時間とともにどのように上達していくか、また、専門家や指導者と比べてどうなのかについて概説する

外科の専門家であるラファエル・グロスマン医師は、人間の目の解像度を持つVR環境において、アイトラッキングやその他の生体センサーを組み込むことで、トレーニングシミュレーションをいかに最適化できるかを実演しました。このウェビナーで使用された「専門家対初心者」の外科トレーニングシミュレーションは、ORamaVR社によって制作されました。

グロスマン博士は、VRが提供する没入感あふれるリアルな環境での自身の体験について語っています。この環境は、彼や同僚たちが外科トレーニングにおいて新たな技術や手法を学び、革新を続けていく上で、大いに役立っています。

注目質問

Varjoと連携する環境にはどのようにアクセスすればよいですか?

Varjoは、Unreal、Unity、UNIGINEなど、数多くのVRアプリケーションに対応しています。同社では、独自のVR環境の構築や、既存のVR環境を同社のヘッドセットへ移行するためのコンサルティングサービスを提供しています。

データ分析にはどのようなオプションがありますか?iMotionsでAOIを設定することはできますか?

はい、iMotionsにはさまざまな分析ツールが用意されており、静的および動的なAOI(関心領域)を作成したり、AOI内の注視点や視線メトリクスから視覚的注目に関する洞察を得たりすることが可能です。また、ヒートマップを作成・エクスポートしたり、当社の最先端の視線マッピング技術を活用して、動的な環境下における参加者全体のアイトラッキングデータを迅速かつ容易に集計したりすることもできます。

![Featured image for 生体認証研究に取り組むべき理由 [チートシート]](https://imotions.com/wp-content/uploads/2022/10/Why-You-Should-Be-Doing-Biometric-Research-Cheat-Sheet-1024x536-2-300x157.jpg)