Das iMotions-Team hat eine zweite Reihe von aufgezeichneten Live-Webinaren zu einer Vielzahl von Themen aus dem Bereich der Verhaltensforschung zusammengestellt. Zu unseren Experten gehörten unsere hauseigenen promovierten Wissenschaftler, Produktspezialisten und Customer Success Manager sowie einige Gastredner aus dem Kreis unserer Kunden und Hardware-Partner.

Unsere Webinar-Reihe „Teil 1“ verzeichnete insgesamt über 1.500 Anmeldungen! Wir haben unsere zweite Webinar-Reihe mit vier weiteren Webinaren abgeschlossen, in denen wir uns eingehender mit den Anwendungsmöglichkeiten und praktischen Anwendungsfällen der Verhaltensforschung befasst haben.

Haben Sie es verpasst? Keine Sorge – wir haben die Webinare aufgezeichnet. Wenn Sie mehr über die behandelten Themen erfahren möchten, können Sie sie auf unserer Webinar-Seite abrufen.

- Über das Labor hinaus: Der Einsatz von Biosensoren im Leistungssporttraining

- Fernforschung mit iMotions: Analyse von Gesichtsausdrücken und Verhaltenskodierung bequem von der Couch aus

- iMotions API: Was ist das und wie können Sie damit Ihre Forschung optimieren?

- Schulungen im Gesundheitswesen in virtuellen Umgebungen mit iMotions und Varjo

Hier sind einige der Höhepunkte der Webinar-Reihe, Teil 2:

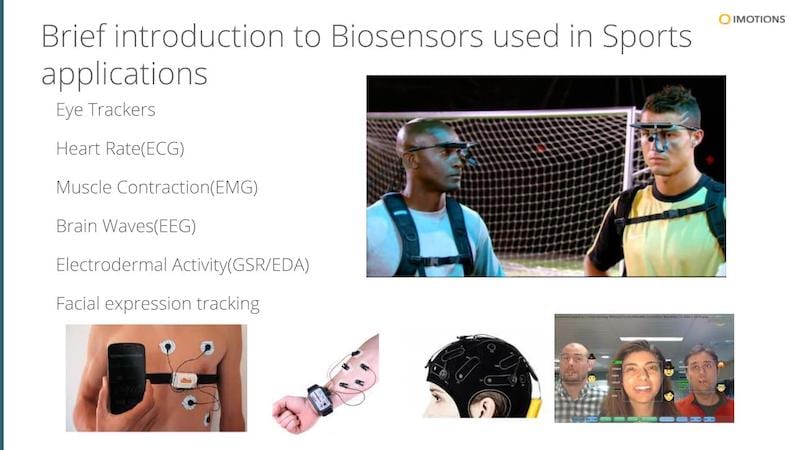

Webinar: Über das Labor hinaus: Der Einsatz von Biosensoren im Leistungssporttraining

David Schulman (Vertriebsleiter) und Nam Nguyen (Produktspezialist für Neurowissenschaften) empfingen unseren Gastredner Dr. Derek Mann, einen Experten für Bewegungswissenschaften, der über seine Forschungsarbeit an der Jacksonville University in Florida sprach.

Dr. Derek Mann verfügt über mehr als ein Jahrzehnt Erfahrung in der Privatwirtschaft, wo er mit Spitzensportlern, Angehörigen des Militärs und Führungskräften aus der Wirtschaft zusammengearbeitet hat. Er ist Experte für die mentalen, emotionalen und aufmerksamkeitsbezogenen Aspekte der menschlichen Leistungsfähigkeit und hat sich auf Wahrnehmungsprozesse, kognitive Reaktionen und Leistungsfähigkeit in Situationen mit hohem Stress spezialisiert.

Wie Biosensoren im Sport eingesetzt werden: Leistungssteigerung

Eye-Tracker zur Leistungssteigerung bei Sportlern

- Worauf richten Sportler ihren Blick (Fixation)?

- Wie analysiert der Spieler das Spielgeschehen in Echtzeit?

- Konzentriert sich der Spieler auf das Richtige?

Herzfrequenz (EKG) zur Ermittlung von Verbesserungsmöglichkeiten

- Wie schnell kann ich mich erholen?

- Was passiert, wenn die Herzfrequenz ansteigt?

- Erkenne Stressfaktoren und gehe sie an, um unter Druck einen kühlen Kopf zu bewahren

Muskelkontraktion – Elektromyographie (EMG) zum Verständnis des Verhaltens

- Wie man Muskelbewegungen und -aktivität besser versteht

- Untersuchen Sie deren Zusammenhang mit bestimmten Emotionen und Verhaltensweisen

Gehirnströme (EEG) zur Messung der kognitiven Belastung:

- Erhalten Sie Einblicke in die kognitive Belastung eines Spielers

- Wie nehmen Sportler ihre Umgebung wahr, um ihre Reaktionszeit zu verbessern?

- Wie lange brauchen sie, um eine Entscheidung zu treffen?

Elektrodermale Aktivität (EDA/GSR) zur Leistungssteigerung bei Sportlern:

- Was begeistert Sportler?

- Können wir Sportler darauf trainieren, Hinweise aus ihrer Umgebung wahrzunehmen, um bessere Leistungen zu erzielen?

Gesichtsausdrucksanalyse (FEA) zur Bestimmung der Trainingsintensität

- Welches Gefühl wurde zu einem bestimmten Zeitpunkt zum Ausdruck gebracht?

- Die Neurodynamik des „Game Face“

- Erfassung der Trainingsintensität anhand von Gesichtsausdrücken

Hervorgehobene Fragen

Warum greift der Bereich des Sporttrainings auf die Neurowissenschaften zurück, um Antworten auf seine Fragen zu finden?

Früher waren Selbstauskünfte und Beobachtungen die einzigen Möglichkeiten. Heute besteht ein zusätzlicher Bedarf an mehr Daten, um die Konsistenz und Wiederholbarkeit zu verbessern und so tiefere Einblicke zu gewinnen. Biosensoren können Ihnen zusätzliche Erkenntnisse liefern, an die sich die Teilnehmer möglicherweise nicht erinnern oder die sie nicht selbst erklären können. Dies liefert sowohl subjektive als auch objektive Informationen zum Verständnis der Leistung des Spielers. Sie sind in der Lage, auf einer tieferen Ebene zu erklären, was tatsächlich geschieht, und die verschiedenen Ebenen kognitiver Prozesse zu entschlüsseln.

Was sind die größten Herausforderungen bei der Arbeit mit Biosensordaten?

Zunächst einmal ist es wichtig, realistisch zu sein und die Datenerhebung auf die 1–3 wichtigsten Variablen zu beschränken. Es ist unerlässlich, Pilotversuche durchzuführen und in einer kontrollierten Umgebung zu verstehen, was die Daten aussagen, bevor man sie in einem praktischen Kontext anwendet. Zweitens kann es auch eine Herausforderung sein, die Akzeptanz von Athleten und Trainern zu gewinnen. Die Nachbearbeitung, um die Daten aussagekräftig zu machen, kann zeitaufwändig sein. Dies unterstreicht, wie wichtig es ist, den Prozess zu optimieren und Informationen schnell bereitzustellen. Die iMotions-Software hat in diesem Sinne bei der Datenverarbeitung geholfen, um Ergebnisse schnell und effektiv zu liefern.

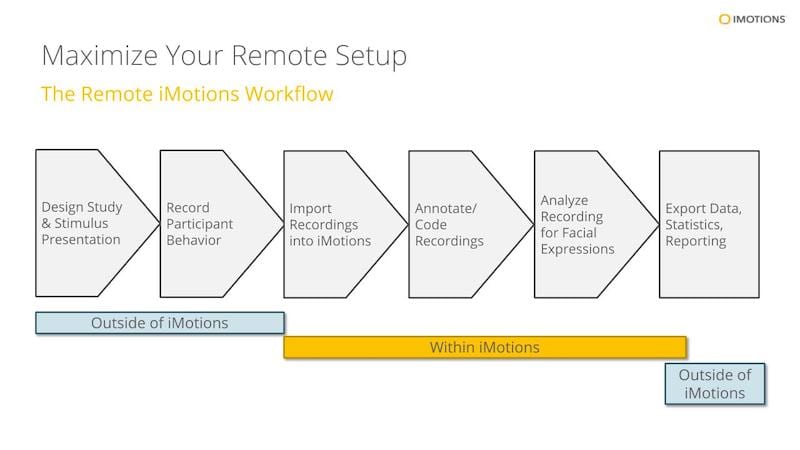

Webinar: Fernforschung mit iMotions: Mimikanalyse und Verhaltenskodierung bequem von der Couch aus

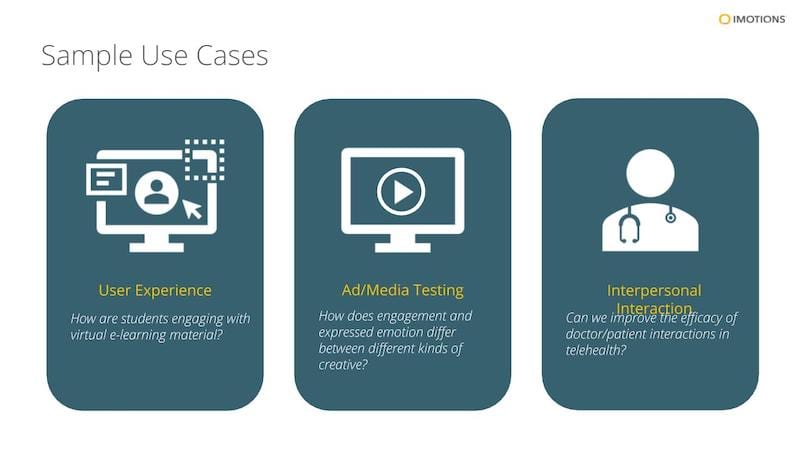

Das neue Zeitalter der sozialen Distanzierung hat Forscher, die sich mit menschlichem Verhalten befassen, vor neue Herausforderungen gestellt. Was kann man tun, wenn es nicht mehr möglich ist, Teilnehmer in ein Labor zu holen? Dr. Jessica Wilson (Neurowissenschaftlerin) und Kate Weir (Vertriebsleiterin) erläuterten, wie man Aufzeichnungen annotiert und zuvor aufgezeichnete Gesichtsvideos nachbearbeitet, um Einblicke in die emotionale Valenz zu gewinnen. Sie stellten alle Remote-Funktionen von iMotions für die Verhaltenskodierung mit dem Annotationstool und die Gesichtsausdrucksanalyse anhand einer Demo auf der iMotions-Plattform vor.

Verhaltenscodierung mit der iMotions-Plattform

Verhaltenskodierung ist eine Reihe methodischer, standardisierter und quantifizierbarer Beobachtungen eines Teilnehmers, die von geschulten Personen ausgewertet werden. Während Umfragen die subjektive Bewertung einer Erfahrung durch den Teilnehmer wiedergeben, werden Verhaltensdaten nach objektiven Maßstäben des Forschers kodiert. Somit stellt die Verhaltenskodierung eine reichhaltige Informationsquelle dar, die physiologische Daten und Selbstauskünfte ergänzt.

Verhaltenskodierungssysteme sind in der Regel auf eine bestimmte Studie zugeschnitten und hängen stark von der Forschungsfrage ab – es gibt keine Einheitslösung! Verhaltensweisen können als diskrete oder kontinuierliche Ereignisse kodiert werden, um die Reaktion des Nutzers auf die Reize ganzheitlicher zu erklären. In der Psychologie, im Bereich User Experience (UX), im Marketing usw. finden sich zahlreiche Anwendungsfälle, in denen Verhaltenskodierung zum Einsatz kommt.

Dieser analytische Ansatz erstreckt sich auf vielfältige Bereiche, darunter auch das Verständnis dafür, wie Verbraucher verschiedene sensorische Reize verarbeiten, um Entscheidungen zu treffen. Erfahren Sie mehr darüber, wie die Sinne das Kaufverhalten beeinflussen, indem Sie Einblicke in die multisensorische Wahrnehmung und die Entscheidungsfindung im Zusammenhang mit Lebensmitteln gewinnen.

Verhaltenscodierung mithilfe von Annotationen

Mithilfe der Annotations-Funktion in iMotions können Sie all diese Codes mit zugewiesenen Farben und Tastenkombinationen in Ihre Studie einbetten, um eine Bild-für-Bild-Kodierung zu ermöglichen. Nutzer können zudem Kommentare zum Kontext der Ereignisse hinzufügen, was die Analyse in der Nachbearbeitung erleichtert. Diese Ereignisse werden bei der Wiedergabe der Aufzeichnung in iMotions auf der Zeitachse angezeigt, und wichtige Informationen wie Dauer, Start- und Endzeitpunkte sowie relevante Kommentare können über den Export von Markerdaten exportiert werden.

Lesen Sie dazu: So funktioniert das Verhaltens-Coding in iMotions

Analyse von Gesichtsausdrücken

Mit iMotions können vorab aufgezeichnete Videos der Gesichter von Teilnehmern in die Software importiert und verarbeitet werden, um mithilfe automatisierter Gesichtsausdruckstechnologie gezeigte Emotionen zu analysieren. Ob auf individueller Ebene oder in einer Gruppe – einzelne Gesichter können nachträglich identifiziert und analysiert werden. Diese Funktion bedeutet, dass Forscher nicht nur Gesichtsausdrucksanalysen an neu aufgenommenen Videos durchführen können, sondern auch bereits vorhandene Inhalte in ihren Datenbanken für weitere Analysen erneut auswerten können.

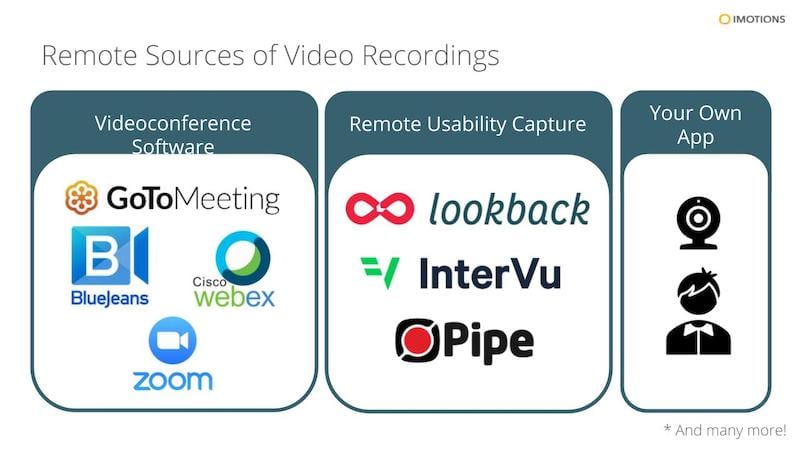

Das folgende Bild zeigt nur einige der verfügbaren Programme, mit denen Forscher das Verhalten der Teilnehmer über die Webcam und die Bildschirmfreigabe aufzeichnen können. Beispiele für Studien sind Website-Layouts (UX), Bilder, Videos, Spiele oder jede andere Art von visuellen Reizen.

Schauen Sie sich unseren Blog an: Wie die Analyse von Gesichtsausdrücken (FEA) aus der Ferne durchgeführt werden kann

Hervorgehobene Frage

Inwiefern schafft die Verhaltenscodierung im Bereich „Performance & Training“ einen Mehrwert?

Wir haben mit Behörden und Universitäten in den Bereichen Leistungsmessung und Schulung zusammengearbeitet. Anhand quantifizierbarer Kennzahlen können sie Verhaltensweisen über die reinen Sensordaten hinaus nachvollziehen. Einige Beispiele hierfür sind: 1) Effizienz: Bearbeitungszeit und Anzahl der Klicks, die Aufschluss über den Arbeitsablauf geben, sowie 2) Ärzteausbildung: Operationen von Anfängern im Vergleich zu Experten, Erwerb von Fertigkeiten usw.

Wie sieht es mit den Einschränkungen hinsichtlich Hardware und Umgebung bei der Fernerfassung von Daten aus?

Eine der Stärken unserer Engine, insbesondere bei der Verwendung von Affectiva-Affdex, besteht darin, dass Sie für die Aufzeichnung eine gewöhnliche Webcam oder sogar die integrierte Kamera Ihres Computers verwenden können (Mindestauflösung von 640 x 480 Pixel oder eine Gesichtsgröße von 120 Pixel). Die Beleuchtung kann ein Problem darstellen, daher ist es wichtig, dass die Gesichter der Teilnehmer nicht überbelichtet sind und nicht von einer anderen Lichtquelle von hinten beleuchtet werden. Die Teilnehmer sollten über die richtige Aufnahmekonfiguration informiert werden und ihre Webcams vor der Datenerfassung entsprechend einstellen.

Lesen Sie auch: Die besten Tipps für hochwertige Daten zur Analyse von Gesichtsausdrücken

Webinar: iMotions API: Was ist das und wie können Sie damit Ihre Forschung optimieren?

Wie können Sie die iMotions-API optimal nutzen, wenn Sie ein Forschungssystem betreiben, bei dem Daten von Drittanbietern in iMotions eingespeist werden und eine Kommunikation mit iMotions stattfinden muss? Produktdirektor Ole Jensen und Customer Success Manager Dr. Tue Hvass stellten einige Anwendungsfälle der API vor, die sich auf Systemintegration und Workflow-Automatisierung, virtuelle Umgebungen (in Unity), Wearables sowie Standard-Kommunikationsprotokolle mit Bluetooth konzentrierten. Die Demonstration umfasste einen Einblick in die Code-Konfigurationen sowie eine Live-Demo auf der iMotions-Plattform.

Bildunterschrift: Über die API lassen sich Sensoren (die nicht von iMotions integriert sind), die Umgebung für die Stimuluspräsentation sowie Workflows miteinander verbinden, was eine Automatisierung ermöglicht

Bildunterschrift: Über die API lassen sich Sensoren (die nicht von iMotions integriert sind), die Umgebung für die Stimuluspräsentation sowie Workflows miteinander verbinden, was eine Automatisierung ermöglicht

Funktionen der iMotions-API:

- Eingabe-API/Ereignisempfang: Daten in iMotions streamen, z. B. von Sensoren von Drittanbietern.

- Ausgabe-API/Ereignisübertragung: Streamen Sie Biosensordaten aus iMotions, z. B. GSR- oder Eye-Tracking-Daten.

- Fernsteuerung: Senden Sie Befehle an iMotions, z. B. zum Starten und Beenden der Aufzeichnung oder zum Exportieren von Daten.

- Lab Streaming Layer (LSL): Datenübertragung in iMotions über das offene LSL-Protokoll.

Schau dir unseren Blog an: Was ist eine API? (Und wie funktioniert sie?)

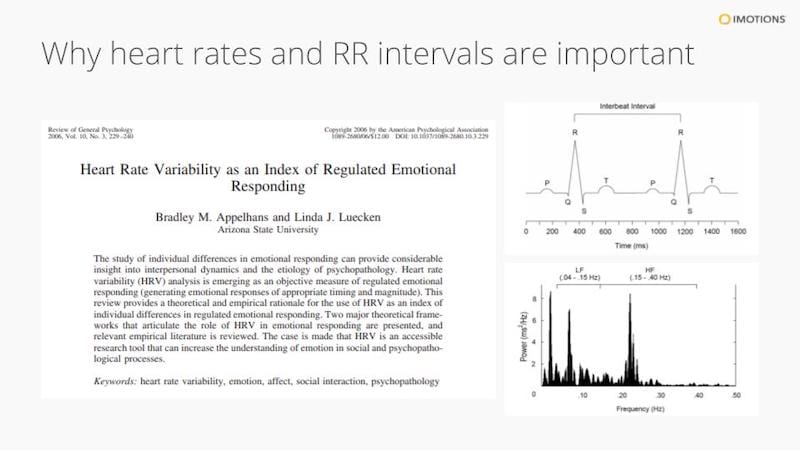

Beispiel für ein Bluetooth-Wearable mit MATLAB

Dr. Tue Hvass demonstrierte anhand von MATLAB ein Beispiel für ein tragbares Gerät zur Herzfrequenzmessung, den Polar Brustgurt (H10). Dieses energiesparende, Bluetooth-fähige Gerät kann stundenlang EKG-Daten erfassen und streamen, ohne dass es aufgeladen werden muss. Die API ermöglicht es dem Gerät, Daten über Bluetooth an die iMotions-Software zu übertragen, wobei die Datenaufzeichnungen mit einer Visualisierung der RR-Intervalle erfasst werden. Mithilfe von transparentem R-Code, der in iMotions generiert wird, können Sie die durchschnittliche Herzfrequenz (BPM) und die Herzfrequenzvariabilität (HRV) anzeigen. Die HRV ist ein physiologischer Messwert, der mit der Fähigkeit zur emotionalen Regulierung in Verbindung gebracht wird.

Warum sind Herzfrequenz und RR-Intervalle wichtig? Wir können sie als Indikator für emotionale Erregung und emotionale Regulierung nutzen. Die Kombination von EKG mit anderen Biosensormessungen kann ein umfassenderes Verständnis der Gedanken, Emotionen oder Verhaltensweisen einer Person ermöglichen. Indem wir die Komplementarität der einzelnen Sensoren nutzen, um unterschiedliche Aspekte menschlicher Reaktionen zu erfassen (z. B. durch die Kombination von Gesichtsausdrucksanalyse mit EKG, um sowohl Emotionen als auch Erregung zu verstehen), lässt sich ein klares Bild davon gewinnen, wie jemand die Welt erlebt.

Lesen Sie dazu: Herzfrequenzvariabilität – Wie man EKG-Daten analysiert

Beispiel für die bidirektionale Kommunikation zwischen iMotions und der Unity-Umgebung

Ole Jensen demonstrierte ein Beispiel für bidirektionale Kommunikation unter Verwendung eines Shimmer-GSR-Biosensors zur Steuerung eines virtuellen Autos in der Unity-Umgebung. Er nutzte die im Shimmer-Sensor integrierten Beschleunigungssensoren, um das virtuelle Auto zu steuern: Vorwärts-, Rückwärts-, Links- und Rechtsbewegungen wurden durch Neigen des Sensors um zwei Achsen erzielt. Die Beschleunigungssensordaten werden mithilfe der Ereignisweiterleitungsfunktion von iMotions an Unity weitergeleitet. Gleichzeitig zeichnet iMotions eine visuelle Darstellung zusammen mit den GSR-Daten des Shimmer-Sensors auf. Darüber hinaus ist die Unity-Umgebung so programmiert, dass sie Spiel-Telemetriedaten über die Ereignisempfangsschnittstelle zurück an iMotions sendet.

Telemetrie ist einer der grundlegenden Begriffe in der Spielanalyse. Die Erfassung, Analyse und Auswertung von Daten zum Nutzerverhalten bildet die Grundlage für die heutige Analyse in der Spieleentwicklung – sei es bei Unterhaltungsspielen, Serious Games (z. B. für Lernzwecke) oder simulationsbasierten Erlebnissen im Allgemeinen.

Lesen Sie dazu: Wie man menschliche Erfahrungen in Spielen und VR misst

Hervorgehobene Fragen

Wie viele Polar-Gurte (EKG-Gurte) können gleichzeitig erfasst werden? Falls es mehr als einen ist, wie würden Sie mit Signalstörungen umgehen?

Es gibt zwar Fälle, in denen mehrere Polars mit einem Smartphone verbunden wurden, doch wurde dies mit dem vorgestellten Code noch nicht getestet. iMotions ist jedoch in der Lage, Daten von mehreren Biosensoren zu erfassen, sodass dies theoretisch möglich ist.

Wurde dies in der Automobilindustrie eingesetzt?

Wir verfügen über einige Publikationen und Fallstudien zu diesem Thema. In der Automobilindustrie gibt es zahlreiche Anwendungsmöglichkeiten. Dazu gehören beispielsweise halbautonome Fahrzeuge, die Mensch-Maschine-Schnittstelle und sogar das Fahrerlebnis beim Autofahren.

Erfahren Sie, wie das Stanford Center for Design Simulatoren einsetzt, die Biosensoren und andere Technologien zur Erfassung menschlichen Verhaltens integrieren.

Schulungen im Gesundheitswesen in virtuellen Umgebungen mit iMotions und Varjo

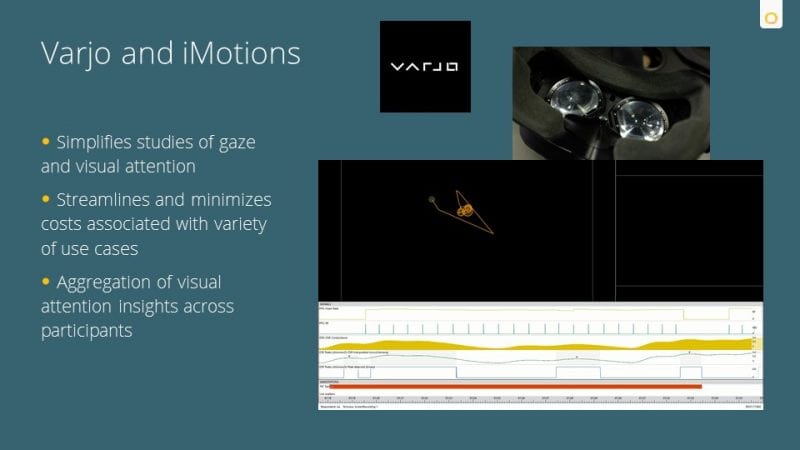

Virtual Reality (VR) eröffnet dank ihrer kontrollierbaren Umgebung spannende Möglichkeiten für die Ausbildung von Fachkräften in Bereichen wie dem Gesundheitswesen. Durch die Kombination multimodaler Biosensoren mit VR-Tools können medizinische Fachkräfte schnelle und aussagekräftige Erkenntnisse gewinnen. iMotions und Varjo veranstalteten ein Webinar mit dem Ehrengast Dr. med. Rafael Grossmann, FACS, der über mehr als 25 Jahre chirurgische Erfahrung verfügt und sich nachdrücklich für den Einsatz von VR in der Ausbildung im Gesundheitswesen einsetzt.

Das Webinar wurde von Roxanna Salim, Leiterin der Abteilung für Partnerschaften bei iMotions, moderiert, die über mehr als 15 Jahre Erfahrung in der psychophysiologischen Forschung verfügt. Ihr zur Seite stand Co-Moderator Geoff Bund, Leiter der Geschäftsentwicklung bei Varjo, der über mehr als 7 Jahre Erfahrung in der Entwicklung von Virtual-Reality-Hardware verfügt.

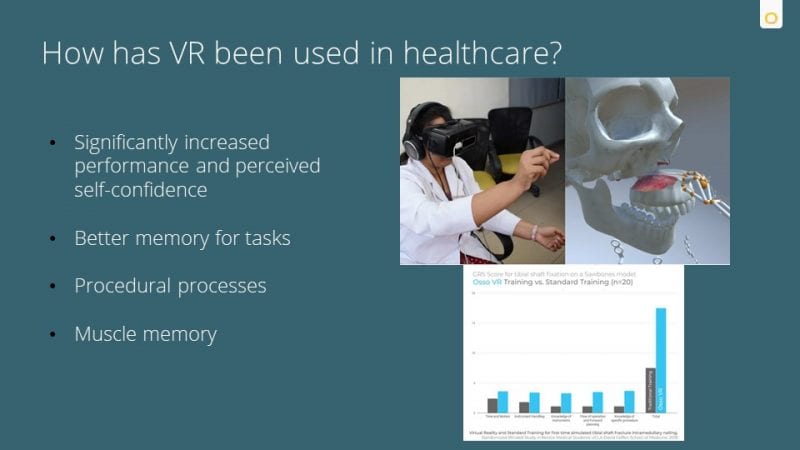

Wie lassen sich Virtual Reality und Biosensoren im Gesundheitswesen nutzen? Es gibt eine Vielzahl von Anwendungsmöglichkeiten für VR-Therapien, die von der Phobiebehandlung bis hin zu den jüngsten Entwicklungen im Bereich der chirurgischen Ausbildung und Forschung reichen. In den letzten Jahren wurden Fortschritte bei der VR-Technologie erzielt, die einen breiten Einsatz dieser Technologie in verschiedenen Bereichen ermöglichen. Seit 2016 ist ein Anstieg an Veröffentlichungen und Schulungen zum Einsatz von Virtual-Reality-Technologie (VR) zu verzeichnen.

- Über 100.000 Veröffentlichungen zu VR-Simulationen im Gesundheitswesen

- Allein für VR-chirurgische Schulungen über 22.000

Die chirurgische Ausbildung kann durch den Einsatz virtueller Umgebungen noch weiter verbessert werden.

- Die Leistung und das empfundene Selbstvertrauen deutlich steigern

- Besseres Gedächtnis für die Aufgaben

- Verfahrensabläufe

- Muskelgedächtnis

Lesen Sie mehr: Vier inspirierende Anwendungsbeispiele für Biosensoren zur Verbesserung der Gesundheitsversorgung

Einige dieser Studien konzentrieren sich in der Regel auf die gesamte Operationserfahrung und stützen sich auf Selbstauskünfte, um Informationen über die Erfahrungen der Auszubildenden zu sammeln. Sie gehen nicht unbedingt auf die zugrunde liegenden Mechanismen ein, die zu bestimmten Verhaltensweisen führen. Es kann bestimmte Aspekte der Operation geben, die kognitiv anspruchsvoller oder stressiger sind und die mithilfe von Biosensoren erfasst und behandelt werden können.

Biosensoren helfen Ihnen dabei, die richtigen Fragen zu stellen – für medizinisches Fachpersonal

Eye-Tracking: In das Varjo-Headset integriert, liefert es Einblicke in die visuelle Aufmerksamkeit

- Auf welche Aspekte des Operationssaals wird geachtet?

- Gibt es wichtige Aspekte, die nicht berücksichtigt werden, obwohl sie es eigentlich sollten?

Die elektrodermale Aktivität (EDA) und das Elektrokardiogramm (EKG) können Aufschluss über emotionale Erregung und Stress geben

- Kann Aufschluss darüber geben, welche Aspekte der Trainingsaufgaben zu einem höheren Stresslevel führen

- Gibt einen Überblick darüber, wie sich Anfänger im Laufe der Zeit verbessern und wie sie im Vergleich zu Experten oder Trainern abschneiden

Der Chirurgieexperte Dr. med. Rafael Grossmann zeigte, wie Trainingssimulationen durch integriertes Eye-Tracking und andere Biosensoren in VR-Umgebungen mit einer Auflösung auf Augenhöhe optimiert werden können. Die in diesem Webinar verwendete Trainingssimulation zum Vergleich zwischen erfahrenen und unerfahrenen Chirurgen wurde von ORamaVR entwickelt.

Dr. Grossmann berichtet von seinen persönlichen Erfahrungen in der immersiven, realistischen Umgebung, die die VR bietet. Dies hat ihm und seinen Kollegen wirklich dabei geholfen, sich weiterzubilden und mit neuen Technologien und Techniken in der chirurgischen Ausbildung immer wieder innovativ zu sein.

Hervorgehobene Fragen

Wie greife ich auf Umgebungen zu, die mit Varjo kompatibel sind?

Varjo unterstützt eine Reihe verschiedener VR-Anwendungen wie Unreal, Unity und UNIGINE, um nur einige zu nennen. Das Unternehmen bietet Beratung sowohl bei der Entwicklung eigener VR-Umgebungen als auch bei der Migration bestehender VR-Umgebungen auf seine Headsets an.

Welche Möglichkeiten zur Datenanalyse gibt es? Können wir in iMotions AOIs definieren?

Ja, iMotions bietet eine Reihe verschiedener Analysewerkzeuge, darunter die Möglichkeit, statische und bewegliche AOIs zu erstellen und anhand von Fixations- und Blickmetriken innerhalb dieser AOIs Erkenntnisse über die visuelle Aufmerksamkeit zu gewinnen. Sie können zudem Heatmaps erstellen und exportieren sowie unsere hochmoderne Blickverfolgungstechnologie nutzen, um Eye-Tracking-Daten von verschiedenen Teilnehmern in dynamischen Umgebungen schnell und einfach zusammenzufassen.