iMotionsでは、製品のアップデートを比較的高い頻度で実施することに注力しています。お客様やユーザーの皆様からは、不足している機能や改善点、あるいは有益と思われるアップデートや修正に関する貴重なフィードバックを絶えずいただいており、私たちはそれらを必要とされるタイミングで迅速にリリースできるよう努めています。今回のメジャーリリースの一環として、皆様にきっと気に入っていただけるであろう魅力的な新機能を搭載した「iMotions 9.2」のリリース時期が到来したことを、ここに発表できることを誇りに思います。

今回のアップデートでは、ソフトウェアスイートに2つの大きな変更が加えられました。それは、Affectiva社の新バージョン「Affdex 5.1」の導入と、アノテーション機能の大幅な拡充です。このリリースには他にもいくつかの小規模な更新が含まれていますので、こちらのリリースノートで詳細をご確認ください。また、iMotionsをご利用中のお客様は、ヘルプセンターにアクセスして、最新版のダウンロードおよび新機能の詳細な説明をご覧ください。

AFFDEX 5.1 統合

新しく改良されたAFFDEX SDKには、待望の改良点や新機能が多数盛り込まれています。

AFFDEX SDK 2.0は、ディープラーニングをより積極的に活用しており、大規模な自然環境下でのデータセットを用いて学習されています。あらゆる年齢、性別、人種の人々がコマーシャルを視聴している様子を捉えた1,100万件の記録が収集され、その大部分がアルゴリズムの学習に用いられ、残りは対照群として使用されました。

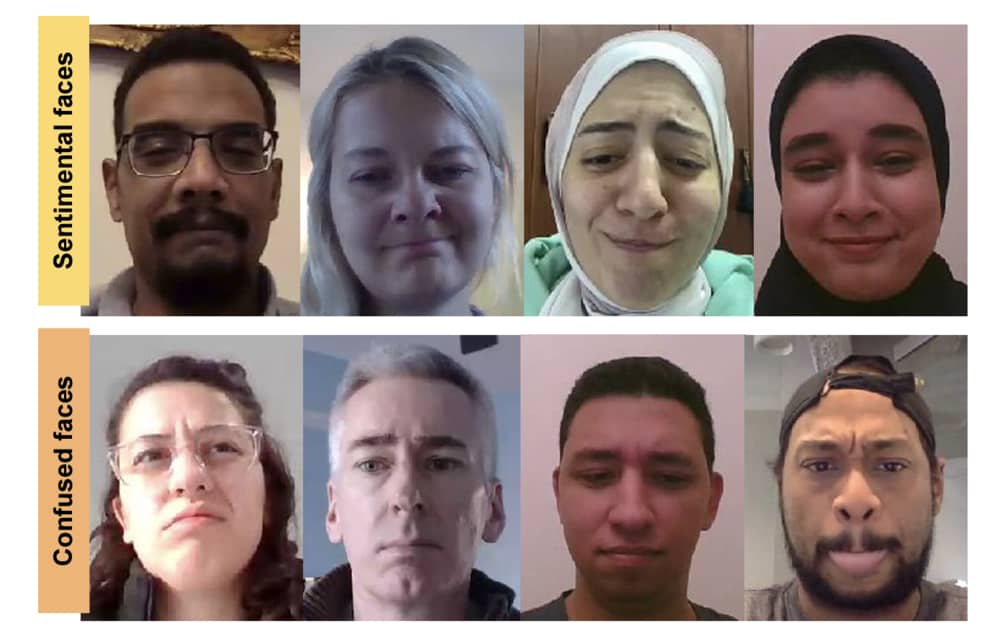

Affectivaの表情分析SDKや、表情分析全般に慣れている方なら、このアルゴリズムが識別可能な7つの主要な感情(怒り、嫌悪、恐怖、喜び、悲しみ、驚き、軽蔑)に加え、無表情があることをご存知でしょう。 これらの主要な感情は、顔面動作単位(AU)をリアルタイムで分析することで特定され、そのプロセスを通じて顔面動作分類法(FACS)が導き出されます。FACSを使用することで、表情をより詳細に把握できるだけでなく、主要な感情がどのように算出されるかについて、より透明性の高い理解が可能になります。AFFDEX 5.1では、「感傷」と「困惑」という2つの新しい表情が追加されました。

感傷や混乱は、データ収集セッション中に回答者がしばしば示す、一般的ではあるが本質的ではない(顔面コーディングシステムには分類されていない)2つの表情であり、特に感情的な動画コンテンツやユーザー体験タスクに関するユースケースにおいて顕著に見られる。 これらは基本的な表情ではないため、Affectivaはソフトウェア内で困惑や感傷を総括する識別指標のデータセットを作成する必要がありました。この実装により、ユーザーはデータ収集および分析の過程で、感情的に複雑な素材についてより深く掘り下げることができるようになります。

画像:感傷と困惑を表す顔面マーカーをそれぞれ示している被験者グループの例。

iMotionsをご利用のお客様で、Affectivaが新しいSDKを「Sentimentality」および「Confusion」と連携させるようどのようにトレーニングしたかについてさらに詳しく知りたい方は、iMotions Research Communityで公開中のクライアント限定ウェビナーをご覧ください。

改良された顔追跡機能

より具体的な技術面では、AFFDEX 5.1では顔トラッカーが改良されました。フレーム内の顔を正しく識別する精度は、前バージョンから現行バージョンへと、91.3%から94.6%へと向上しています。この改良された顔トラッカーにより、顔が部分的に隠れている場合や、照明条件が悪い場合、あるいは頭の向きが異なる場合でも、以前のバージョンに比べて正しく認識される可能性が高くなりました。

改良された顔追跡アルゴリズムは、より多様な人種・民族構成のデータセットを用いて学習されているため、より幅広い層において高い追跡成功率を実現しており、その結果、ソフトウェアの適用範囲が大幅に広がっています。

AFFDEXの機能アップデートに関する詳細や、その開発プロセスについては、こちらからホワイトペーパーの全文をダウンロードしてご覧ください。

自動注釈

バージョン9.2では、アノテーション機能を大幅に改善し、ユーザーがアノテーション作業を自動化できるようになりました。数分を超える調査を実施したことがあるユーザー、ましてや複数の参加者を対象とした数時間に及ぶ調査を行ったことのあるユーザーなら、手動でのアノテーションがいかに手間のかかる作業であるかをご存知でしょう。

iMotionsの最新バージョンが登場するまでは、アノテーションを設定するには、回答者一人ひとりに手動でアノテーションを適用する必要がありました。調査の規模によっては、時間的にも予算的にも膨大な作業となることがよくありました。

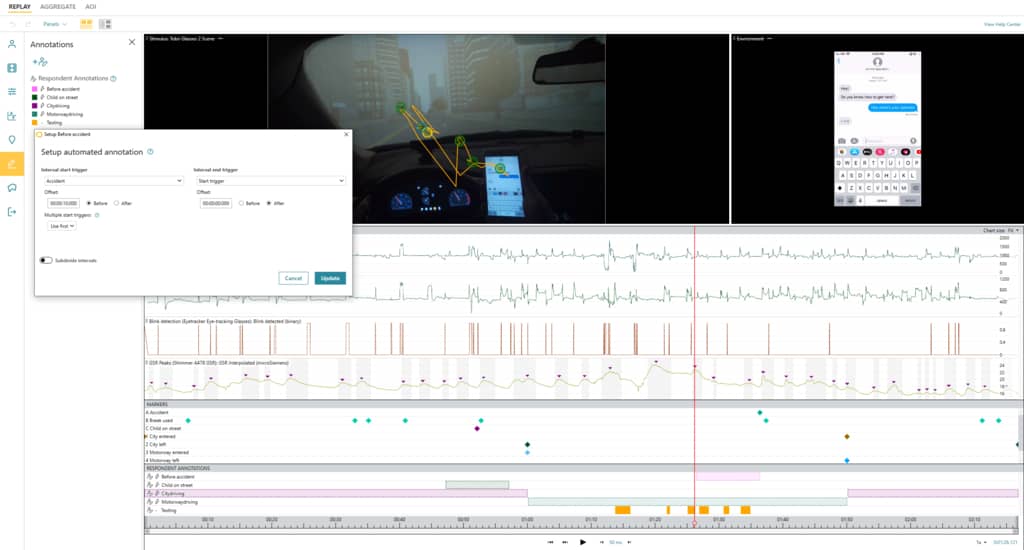

バージョン9.2より、回答者データの分析におけるアノテーション作業の大部分を自動化できるようになりました。 iMotions 9.2 以降、特定のイベント間において注釈を継続させるルールを定義できるようになり、その注釈は収集されたすべての刺激に対して全回答者に自動的に適用されます。これに必要なのはイベントのみであり、ライブマーカーや API トリガーとして収集したり、ウェブサイト、マウス、キーボードからのログを取得したり、あるいは分析中にポイントマーカーとして設定したりすることが可能です。

画像:自動化されたアノテーションワークフローは迅速かつ直感的で、アノテーションルールをシームレスかつ効率的に作成できます。

この新機能は、「時間」と「正確性」という2つの点で非常に優れています。回答者数が多くても調査プロセスが大幅に効率化され、時間を節約できます。また、データ分析における人為的ミスのリスクも最小限に抑えられるため、分析結果は一貫性を保ち、統一されたルールに基づいたものとなります。

自動注釈はどのように機能するのでしょうか?

特定の指示リストに従ってタスクを実行する多数の回答者を必要とする研究において、これらのタスクのそれぞれを「ライブイベント」に変換し、さらにそれを自動化可能な「注釈付きイベント」に変換することができます。例えば、30人にシミュレーターでの運転タスクを課し、ある時点で全員がハンドルを右に急ハンドルを切り、特定の木に衝突しなければならないと仮定しましょう。 この場合、ハンドルの急な切り返しと木への衝突の両方が、シミュレーションソフトウェアにイベントとして記録されます。その後、これらのイベントはAPIトリガーとしてiMotionsソフトウェアと共有されます。iMotionsはこのAPIトリガーを利用してアノテーションを作成します。例えば、ソフトウェアが急な右折を記録するたびに、そのイベントの前後5秒間を登録したいというアノテーションを設定できます。 これまでは、参加者一人ひとりに手動でこのアノテーションを設定する必要がありましたが、iMotionsではこれを自動化できます。これにより、参加者が急な右折を行うたびに、ソフトウェアがイベントの前後5秒間を自動的に記録します。この方法により、すべての参加者に同一のアノテーションが適用され、データの効率化と信頼性が確保されます。

![Featured image for 生体認証研究に取り組むべき理由 [チートシート]](https://imotions.com/wp-content/uploads/2022/10/Why-You-Should-Be-Doing-Biometric-Research-Cheat-Sheet-1024x536-2-300x157.jpg)