Wir bei iMotions legen großen Wert darauf, einen relativ kurzen Aktualisierungsrhythmus für unsere Produkte beizubehalten. Kunden und Nutzer geben uns ständig wertvolles Feedback zu Updates, Fehlerbehebungen und Verbesserungen, die ihnen fehlen oder von denen sie profitieren könnten, und wir bemühen uns, diese zeitnah bereitzustellen, wenn sie benötigt werden. Im Rahmen unseres Zeitplans für Hauptversionen freuen wir uns, Ihnen mitteilen zu können, dass nun die Zeit für eine neue Version mit einigen spannenden neuen Funktionen gekommen ist, von denen wir glauben, dass sie Ihnen gefallen werden: iMotions 9.2.

Dieses neue Update enthält zwei wesentliche Neuerungen für die Software-Suite: die Implementierung des neuen Affdex 5.1 von Affectiva sowie eine bedeutende Erweiterung der Annotationsfunktionen. Darüber hinaus umfasst die Version eine Reihe kleinerer Aktualisierungen. Bitte lesen Sie dazu unsere vollständigen Versionshinweise hier. Wenn Sie bereits Kunde von iMotions sind, finden Sie im Hilfe-Center den vollständigen Download sowie eine detaillierte Erläuterung der neuen Funktionen.

AFFDEX 5.1 integriert

Das neue und verbesserte AFFDEX SDK bietet eine Reihe lang erwarteter Verbesserungen und neuer Funktionen.

Das AFFDEX SDK 2.0 stützt sich stärker auf Deep Learning und wurde anhand eines umfangreichen naturalistischen Datensatzes trainiert. Es wurden 11 Millionen Aufzeichnungen von Menschen aller Altersgruppen, Geschlechter und ethnischen Gruppen gesammelt, die sich Werbespots ansahen; ein großer Teil dieser Aufzeichnungen wurde zum Trainieren des Algorithmus verwendet, der Rest diente als Kontrollgruppe.

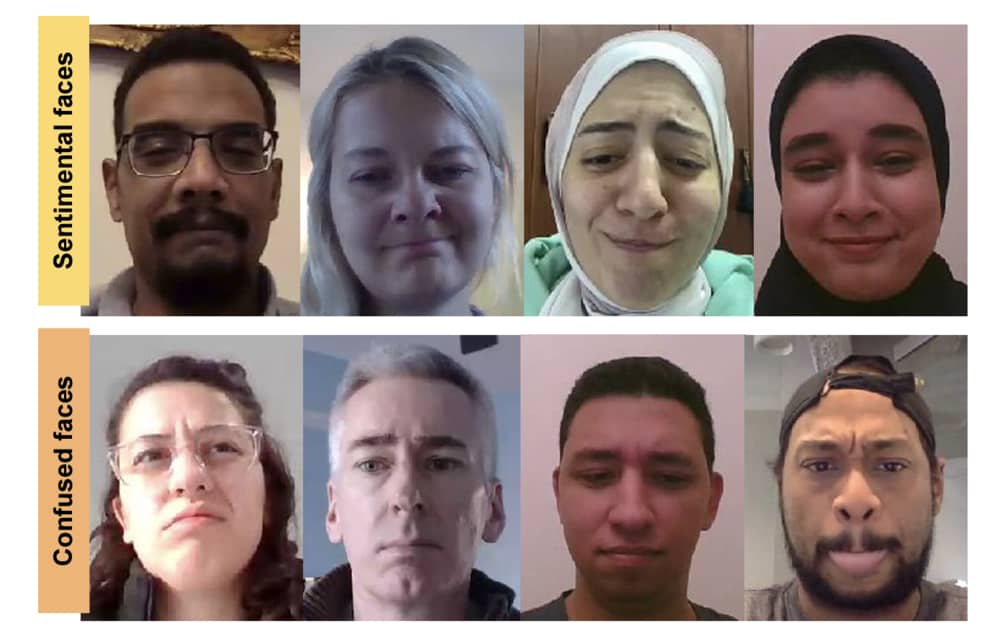

Wer mit dem SDK zur Gesichtsausdrucksanalyse von Affectiva und mit Gesichtsausdrücken im Allgemeinen vertraut ist, kennt die sieben wichtigsten Grundemotionen sowie den neutralen Ausdruck, die der Algorithmus erkennen kann (Wut, Ekel, Angst, Freude, Traurigkeit, Überraschung und Verachtung). Diese Kernemotionen werden durch die Echtzeitanalyse der Gesichtsaktions-Einheiten (AUs) ermittelt, und durch diesen Prozess erhalten wir das Facial Action Coding System (FACS). Die Verwendung von FACS ermöglicht eine differenziertere Betrachtung von Gesichtsausdrücken sowie eine größere Transparenz hinsichtlich der Berechnung der Kernemotionen. In AFFDEX 5.1 wurden zwei neue Ausdrücke hinzugefügt: Sentimentalität und Verwirrung.

Sentimentalität und Verwirrung sind zwei häufige, aber nicht grundlegende (im Gesichtsausdrucks-Kodierungssystem nicht klassifizierte) Ausdrucksformen, die Befragte während der Datenerhebungssitzungen oft zeigen, insbesondere bei Anwendungsfällen im Zusammenhang mit emotionalen Videoinhalten bzw. Aufgaben zur Benutzererfahrung. Da es sich nicht um grundlegende Ausdrucksformen handelt, musste Affectiva einen Datensatz mit identifizierenden Nennern erstellen, der Verwirrung oder Sentimentalität in der Software zusammenfasst. Diese Implementierung gibt den Nutzern nun die Möglichkeit, bei der Datenerhebung und -analyse emotional komplexes Material viel tiefergehend zu untersuchen.

Bild: Eine Gruppe von Personen, die die Gesichtsmerkmale für Sentimentalität bzw. Verwirrung zeigen.

Wenn Sie Kunde von iMotions sind und noch mehr darüber erfahren möchten, wie Affectiva das neue SDK für die Arbeit mit den Faktoren „Sentimentalität“ und „Verwirrung“ trainiert hat, schauen Sie sich unser Webinar für Kunden an, das in der iMotions Research Community verfügbar ist.

Verbesserte Gesichtserkennung

In technischer Hinsicht wurden bei AFFDEX 5.1 die Gesichtserkennungsmodule verbessert. Die Gesamtleistung bei der korrekten Erkennung von Gesichtern im Bild ist von der vorherigen zur aktuellen Version von 91,3 % auf 94,6 % gestiegen. Dank des verbesserten Gesichtserkennungsmoduls ist die Wahrscheinlichkeit, dass teilweise verdeckte Gesichter, schlechte Lichtverhältnisse und abweichende Kopfhaltungen erfolgreich erkannt werden, höher als in früheren Versionen.

Die verbesserten Gesichtserkennungsalgorithmen wurden zudem mit einem ethnisch vielfältigeren Datensatz trainiert, was bedeutet, dass sie über ein wesentlich breiteres demografisches Spektrum hinweg eine höhere Erfolgsquote bei der Erkennung aufweisen und somit in viel mehr Anwendungsfällen eingesetzt werden können.

Wenn Sie mehr über das gesamte AFFDEX-Feature-Update und dessen Entwicklung erfahren möchten, können Sie das vollständige Whitepaper hier herunterladen.

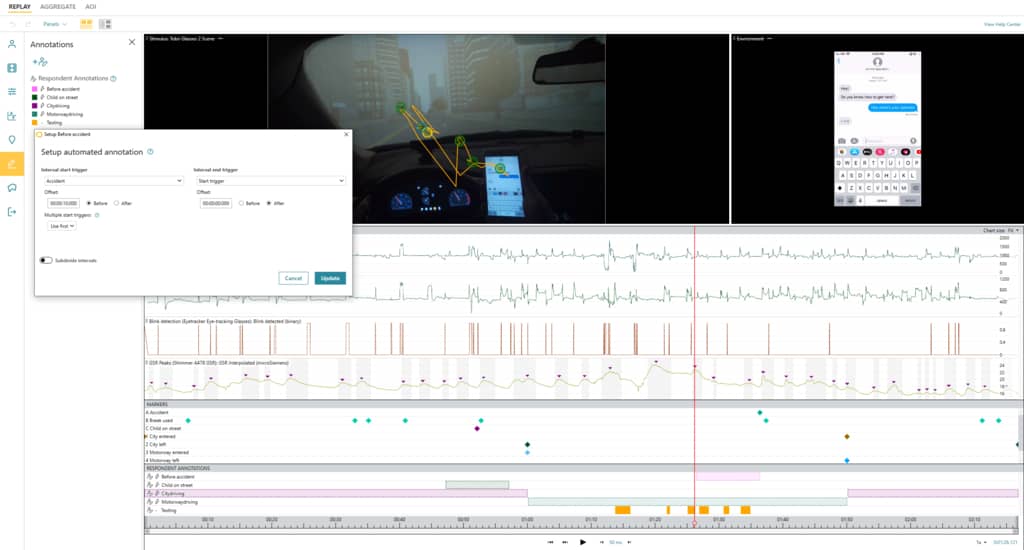

Automatische Anmerkungen

In Version 9.2 haben wir unsere Annotationsoptionen erheblich verbessert, indem wir den Nutzern die Möglichkeit bieten, ihre Annotationen zu automatisieren. Nutzer, die bereits Studien durchgeführt haben, die länger als ein paar Minuten dauern, geschweige denn stundenlange Studien mit mehreren Teilnehmern, wissen, wie aufwendig die manuelle Annotation sein kann.

Bis zur aktuellen Version von iMotions mussten Anmerkungen für jeden Befragten einzeln manuell eingefügt werden – je nach Umfang der Studie konnte dies oft einen enormen Zeit- und Kostenaufwand bedeuten.

Wir freuen uns, Ihnen mitteilen zu können, dass Sie ab Version 9.2 einen Großteil der Annotationen für Ihre Analyse der Befragten-Daten automatisieren können. Ab iMotions 9.2 können Sie in der Software eine Regel definieren, wonach Ihre Annotation von einem Ereignis zum nächsten gelten soll, und die Annotation wird dann automatisch auf alle Befragten über alle erfassten Stimuli hinweg angewendet. Dazu benötigen Sie lediglich ein Ereignis, das Sie als Live-Marker oder API-Trigger erfassen, von einer Website, der Maus oder der Tastatur protokollieren oder sogar während der Analyse als Punktmarker setzen können.

Bild: Der automatisierte Annotations-Workflow ist schnell und intuitiv, sodass Annotationsregeln nahtlos und effizient erstellt werden können.

Dies ist aus zwei Gründen eine fantastische neue Funktion: Zeitersparnis und Genauigkeit. Studien mit einer großen Teilnehmerzahl lassen sich dadurch erheblich straffen und zeitsparender durchführen. Außerdem wird bei der Datenanalyse das Risiko menschlicher Fehler minimiert, sodass Ihre analysierten Daten einheitlich sind und denselben Regeln folgen.

Wie funktionieren automatische Anmerkungen?

In Studien, bei denen eine große Anzahl von Probanden eine Aufgabe nach einer festgelegten Anweisungsliste ausführen muss, könnte jede dieser Aufgaben in ein Live-Ereignis umgewandelt werden, das wiederum in ein kommentiertes Ereignis umgewandelt werden kann, das automatisiert werden lässt. Stellen wir uns vor, wir hätten 30 Personen die Aufgabe gestellt, in einem Simulator Auto zu fahren, und an einer bestimmten Stelle müssten sie alle ihr Lenkrad scharf nach rechts reißen und gegen einen bestimmten Baum prallen. In diesem Fall werden sowohl das scharfe Drehen des Lenkrads als auch das Aufprallen auf den Baum in der Simulationssoftware als Ereignis protokolliert. Die Ereignisse werden dann als API-Trigger an die iMotions-Software weitergeleitet. Diese API-Trigger können dann von iMotions genutzt werden, um Annotationen zu erstellen. Eine Annotation könnte beispielsweise darin bestehen, dass jedes Mal, wenn die Software eine scharfe Rechtskurve protokolliert, die 5 Sekunden vor und nach dem Ereignis erfasst werden sollen. Anstatt diese Anmerkung nun für jeden einzelnen Teilnehmer manuell festzulegen, kann iMotions diesen Vorgang automatisieren, sodass jedes Mal, wenn ein Teilnehmer eine scharfe Rechtskurve fährt, die Software 5 Sekunden vor und nach dem Ereignis registriert. Auf diese Weise werden alle Teilnehmer identisch mit Anmerkungen versehen, was die Datenvereinheitlichung und -gültigkeit gewährleistet.