Unsere neueste Softwareversion – iMotions 8.0 – ist das Ergebnis von über einem Jahr Arbeit und Engagement zur Weiterentwicklung der iMotions-Software. Wir möchten diese Gelegenheit nutzen, um Ihnen einen Überblick über die neuen und verbesserten Funktionen von iMotions 8.0 zu geben und Ihnen einen detaillierten Einblick in die Möglichkeiten dieser neuesten Softwareversion zu bieten.

Neue Analyseoptionen mit R

R ist eine statistische Programmiersprache und eine Umgebung zur Durchführung statistischer Analysen. Es handelt sich um eine leistungsstarke und flexible Plattform, die es Anwendern ermöglicht, praktisch jede Analyse durchzuführen, die sie programmieren und erstellen können (außerdem besteht die Möglichkeit, öffentlich zugängliche und vorgefertigte Analysemethoden zu bearbeiten, zu konfigurieren und zu nutzen).

Als Statistikplattform wird sie hochgeschätzt, aber auch oft verschmäht – die Anwendungsmöglichkeiten sind enorm, doch die Lernkurve ist steil. Die anfänglichen Hürden beim Erlernen von R zu überwinden, kann eine Herausforderung sein, auch wenn sich der Aufwand lohnt.

Zwar bietet die iMotions-Software eine Reihe von Funktionen zur Datenverarbeitung und -analyse (einige davon, die für das Eye-Tracking verfügbar sind, finden Sie in diesem Blogbeitrag), doch möchten wir weitere Methoden bereitstellen, die den Prozess in der späteren Phase nach Abschluss der Studie vereinfachen können.

Durch die Integration von R in iMotions 8.0 können wir die damit verbundenen Analysemöglichkeiten nutzen, ohne unseren Anwendern die Last der Programmierung statistischer Tests aufzubürden. Die ersten in iMotions verfügbaren Datenverarbeitungstechniken, die R nutzen, sind:

- Spektrale Leistungsdichte für EEG-Daten

- Berechnungen der frontalen Asymmetrie für EEG-Daten

- EDA-/GSR-Spitzenerkennung

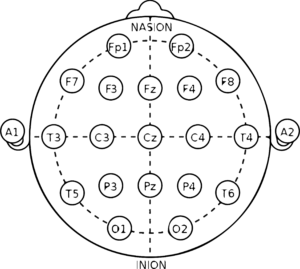

Die spektrale Leistungsdichte ist im Wesentlichen ein Maß für die Menge der EEG-Daten, die innerhalb eines bestimmten Frequenzbandes erfasst werden. So lässt sich beispielsweise anzeigen, wie viel Aktivität im Alpha-Band (7–12 Hz) an jeder Elektrode aufgezeichnet wurde. Auf diese Weise lässt sich das Aktivitätsniveau in verschiedenen Bereichen des Gehirns (oder, bei gemeinsamer Auswertung, das Aktivitätsniveau des Gehirns insgesamt) zusammenfassen.

Die frontale Asymmetrie (ein Thema, das wir bereits in einem früheren Blogbeitrag behandelt haben) ist ein Maß dafür, wie stark sich die frontale Hirnaktivität zwischen den beiden Hemisphären unterscheidet. Dies wird in der Regel durch den Vergleich der EEG-Daten der Elektroden F3 und F4 oder F7 und F8 ermittelt.

Das Ausmaß der Asymmetrie zwischen diesen Bereichen wurde mit einer erhöhten Motivation in Verbindung gebracht, sich einem Reiz zu nähern oder sich von ihm zurückzuziehen [1, 2], wobei eine erhöhte Aktivität im Alpha-Band in der linken Hemisphäre (im Vergleich zur rechten) mit einer Annäherungsmotivation assoziiert wird (und umgekehrt).

EDA-/GSR-Spitzen spiegeln einen signifikanten Anstieg der Hautleitfähigkeit über den Ausgangswert bzw. das Grundniveau wider. Unsere Haut sendet ein konstantes Signal aus, das als Begleiterscheinung einer erhöhten physiologischen oder emotionalen Erregung ansteigen kann. Eine Spitze in den Daten kann daher entscheidende Informationen über die Reaktion des Teilnehmers auf Reize liefern, indem sie verdeutlicht, in welchem Maße diese eine Veränderung der emotionalen Erregung hervorgerufen hat.

Diese Messgrößen sind nun in iMotions verfügbar und lassen sich ganz einfach berechnen, indem man im Analysebildschirm auf „Signalverarbeitung“ klickt und anschließend das entsprechende Gerät und den entsprechenden Algorithmus auswählt. Die Ergebnisse können dann grafisch dargestellt und bei Bedarf auch zur weiteren Untersuchung exportiert werden.

Integration mit Varjo

Varjo ist ein Unternehmen, das das Varjo VR-1-Headset herstellt, ein VR-Headset mit integrierter Eye-Tracking-Funktion. Unter den VR-Geräten sticht es durch seine Auflösung hervor, die der des menschlichen Auges entspricht. Die Auflösung des Headsets beträgt 60 Pixel pro Grad und ist damit zehnmal höher als bei jedem anderen derzeit erhältlichen VR-Headset.

Varjo-Geräte werden unter anderem von Technologieunternehmen wie Audi, Saab und Siemens sowie vom Architekturbüro Asymptote Architecture eingesetzt. Die Anwendungsfälle konzentrieren sich auf verschiedene Aspekte des Designs und der Ausbildung, sei es in der Fahrzeugentwicklung, der Architekturplanung, der medizinischen Simulation oder der Pilotenausbildung.

Die Daten des integrierten Eye-Trackings lassen sich nahtlos und in Echtzeit mit Signalen von Biosensoren wie EDA (elektrodermale Aktivität), EMG (Elektromyographie), EKG (Elektrokardiographie) und EEG (Elektroenzephalographie) synchronisieren. Die Nutzung multimodaler Biosensordaten auf der iMotions-Plattform kann Einblicke in die emotionalen und physiologischen Zustände des Nutzers liefern, während dieser die virtuelle Umgebung erlebt.

Neue und verbesserte Integrationen

Die Veröffentlichung von iMotions 8.0 umfasst neue und verbesserte Integrationen mit mehreren Partnern. Das SDK wurde für den Eye-Tracker „Smart Eye Aurora“ aktualisiert und ermöglicht nun eine Konfiguration mit zwei Computern sowie die Erfassung individueller Daten zur Position des linken und rechten Auges, wodurch umfangreichere Daten gesammelt werden können. Außerdem wurde dem Arbeitsablauf zur Blickkalibrierung ein Verifizierungsschritt hinzugefügt, um sicherzustellen, dass die Datenqualität für Experimente optimal ist.

Zudem ist nun eine neue Integration mit dem Emotiv Cortex SDK enthalten, die Zugriff auf eine Reihe von Daten bietet, die über Emotiv-EEG-Geräte erfasst werden. Dazu gehören die rohen EEG-Daten, Beschleunigungssensordaten sowie eine Reihe von Emotiv-Metriken wie Stress, Entspannung, Engagement, Konzentration, Begeisterung und Interesse (weitere Informationen dazu, was die einzelnen Metriken bedeuten, finden Sie auf dieser Seite).

Diese Kennzahlen bieten einen Überblick über den kognitiven Zustand des Teilnehmers und liefern einen schnellen Einblick in die Art und Weise, wie eine Person auf Reize reagiert. Die Kennzahlen wurden in verschiedenen Studien validiert [z. B. 3] (klicken Sie auf diesen Link, um mehr zu erfahren).

Darüber hinaus wurden verschiedene Verbesserungen an der EyeTech-Integration vorgenommen, darunter die Kalibrierung, die Einstellungen und die Möglichkeit, den Abstand des Teilnehmers zum Eye-Tracker aufzuzeichnen.

Neue Funktionen zur Blickverfolgung

Gaze Mapping ist eine Funktion in iMotions, mit der die unterschiedlichen dynamischen Blickwinkel der Teilnehmer in ein einheitliches Bild umgewandelt werden können, selbst wenn sie einen Reiz unterschiedlich wahrnehmen.

Diese Funktion kann sowohl in realen Situationen, in denen eine Eye-Tracking-Brille getragen wird, als auch beim Surfen auf Websites genutzt werden, wobei die Webseiten auf unterschiedliche Weise betrachtet und durchblättert werden können. In beiden Fällen können die Teilnehmer im Wesentlichen denselben Reiz oder dieselben Reize betrachten, jedoch auf unterschiedliche Weise.

Beim Blick-Mapping wird die Szene in ein einziges Bild umgewandelt. Wenn beispielsweise mehrere Personen ein Supermarktregal auf unterschiedliche Weise betrachten, können ihre Blicke auf ein Referenzfoto des Supermarktregals übertragen werden. Bei einer Website bedeutet dies, dass eine vollständige Webseite erstellt und die verschiedenen Blickwinkel auf dieselbe Seite übertragen werden.

Dies ist ein leistungsstarkes Werkzeug zur Auswertung und zum Verständnis der Blickbewegungen mehrerer Teilnehmer, die zwar dieselben Umgebungen betrachten, aber auf unterschiedliche Weise mit ihnen interagieren. Zwar funktioniert dies in den meisten Fällen, doch kann der Algorithmus, der den Blick automatisch transformiert, an seine Grenzen stoßen – beispielsweise bei besonders steilen Annäherungswinkeln (z. B. wenn sich jemand von der Seite einem Supermarktregal nähert – der Algorithmus ist möglicherweise nicht in der Lage, die Gemeinsamkeiten zwischen dem Einzelbild, auf das die Blickpunkte transformiert werden sollen, und der tatsächlich betrachteten Szene zu erkennen).

Eine Lösung für diese technischen Herausforderungen bietet iMotions 8.0. Bei realen Szenen, in denen eine Eye-Tracking-Brille getragen wird, können die Bereiche, in denen die Blickverfolgung nicht abgeschlossen werden konnte, nachbearbeitet werden. Die Ecken des Referenzfotos können manuell mit dem Blickfeld der Teilnehmer abgeglichen werden. Sobald diese Angaben eingegeben sind, kann der Algorithmus zur Blickverfolgung die nachfolgenden Bilder automatisch weiterverarbeiten. Dies kann bei Bedarf wiederholt werden, bis die Blickverfolgung vollständig ist.

Bei Webseiten tritt ein ähnliches Problem auf, doch ist hier nicht der Blickwinkel das eigentliche Problem. Viele Webseiten enthalten bewegte Bilder oder Videos, die Störungen bei der Verarbeitung der Szene durch den Blickverfolgungsalgorithmus verursachen können. Es ist nun möglich, die Bereiche festzulegen, die von der Analyse ausgeschlossen werden sollen, sodass dem Algorithmus eine saubere Grundlage für die Blickverfolgung zur Verfügung steht.

Beide Verbesserungen ermöglichen die Erfassung von Eye-Tracking-Daten in besonders anspruchsvollen Situationen, was sowohl für Studien in der realen Welt als auch für webbasierte Studien neue Möglichkeiten eröffnet.

Fazit

iMotions 8.0 bietet weitere Verbesserungen, die oben nicht erwähnt wurden, wie beispielsweise Verbesserungen bei der Synchronisation von Datenströmen und erweiterte Optionen für den Datenexport. Einen besseren Überblick erhalten Sie auf unserer Release-Seite oder in den vollständigen Release-Hinweisen (nur für bestehende Kunden).

Wenn Sie mehr über die Möglichkeiten der iMotions-Software erfahren möchten, laden Sie sich unten unsere Broschüre herunter.

Literaturverzeichnis

[1] Coan, J. A., & Allen, J. J. (2004). Frontale EEG-Asymmetrie als Moderator und Mediator von Emotionen. Biological Psychology, 67, 7–50.

[2] Harmon-Jones, E., & Allen, J. J. (1998). Wut und Aktivität im frontalen Kortex: EEG-Asymmetrie, die trotz negativer affektiver Valenz mit einer Annäherungsmotivation im Einklang steht. Journal of Personality and Social Psychology, 74, 1310–1316.

[3] Badcock, N. A., Mousikou, P., Mahajan, Y., de Lissa, P., Thie, J. und McArthur, G. (2013). Validierung des Emotiv EPOC(®)-EEG-Gaming-Systems zur Messung von auditiven ERPs in der Forschung, PeerJ, 1, e38.