『表情分析:完全ポケットガイド』の核心的な知見を探求しましょう。本書は、顔の表情から人間の感情を理解し解釈するために作成された包括的なリソースです。このガイドでは、さまざまな表情を分析するための体系的なアプローチを紹介し、心理学、コミュニケーション学、および関連分野の専門家にとって有益なテクニックを提供しています。この欠かせない参考書を活用して、感情を読み解く能力を高め、対人関係をより良いものにしてください。

Table of Contents

感情は、私たちを人間たらしめる本質そのものです。感情は、私たちの日常生活や社会的交流、注意力、知覚、そして記憶に影響を与えます。

感情を表す最も明確な指標の一つは、私たちの顔です。笑ったり泣いたりするとき、私たちは感情を露わにし、他者は目、眉、まぶた、鼻の穴、唇といった顔の主要な部位の変化に基づいて私たちの顔を「読み取る」ことで、私たちの心の内を垣間見ることができるのです。

コンピュータによる表情認識技術は、感情を揺さぶるあらゆる種類のコンテンツに対する、ありのままの、フィルターのかかっていない感情的反応を捉えることで、人間の解釈能力を驚くほど忠実に再現しています。しかし、その仕組みは一体どのようなものなのでしょうか?

答えはここにあります。この表情分析の決定版ガイドがあれば、感情認識のコツを身につけ、感情的行動の質に関する研究を進めるために必要な知識がすべて揃います。今こそ、始める絶好の機会です。

※この投稿は、当社の『表情分析ポケットガイド』からの抜粋です。下記から無料版をダウンロードして、表情分析の世界についてさらに深く理解を深めてください。

ol.pretty-list li::marker { font-size:2em; font-weight:bold; color:var(–wp–preset–color–yellow); }表情とは何でしょうか?

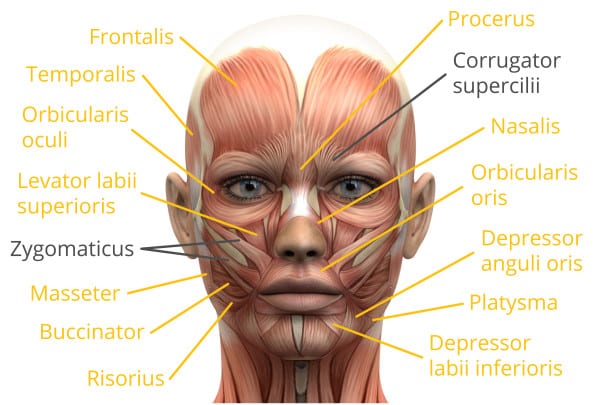

顔は、私たちの体の中でも特に精巧で、高度に多様化した部位であり、実のところ、私たちが持つ最も複雑なシグナル伝達システムの一つです。顔には、構造的にも機能的にも独立した40以上の筋肉があり、それぞれの筋肉は互いに独立して動員することができます。

顔面筋系は、体の中で唯一、筋肉が骨と顔面組織のいずれか一方に付着している部位であり(人体の他の筋肉は2つの骨に付着している)、あるいは目や唇を取り囲む筋肉のように、顔面組織のみに付着している部位でもあります。

言うまでもなく、顔の筋肉の動きは表情を作るために高度に発達しており、それによって私たちは他者と社会的情報を共有し、言語的・非言語的なコミュニケーションをとることができるのです。

.fact { position:relative; } .fact::before { content:’“’; display:block; position:absolute; top:0; left:2rem; transform:translateY(-50%); padding: 1.2rem; font-size: 3.4rem; background: var(–wp–preset–color–yellow); text-shadow: 0px 0px 12px var(–wp–preset–color–secondary), 6px 6px 1px var(–wp–preset–color–secondary); color: white; height: 1.5rem; line-height: 1; font-family: georgia, serif; }ご存知でしたか?

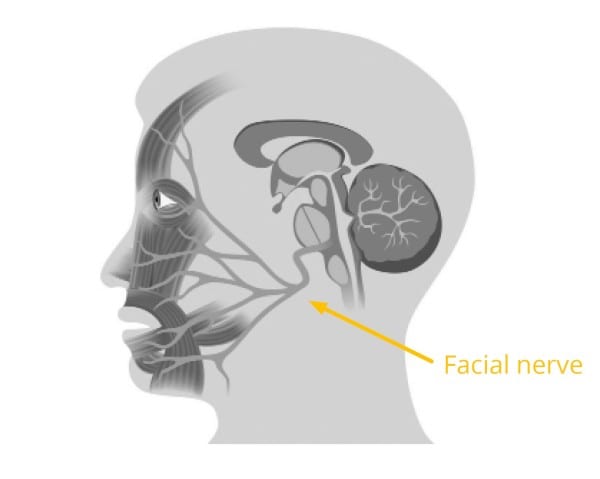

顔の筋肉のほとんどは、顔面神経という1本の神経によって制御されています。ただし、1つだけ例外があります。上まぶたは動眼神経によって支配されており、この神経は眼球運動の大部分、瞳孔の収縮、そしてまぶたを持ち上げる役割を担っています。

顔面神経は、顔の筋肉の大部分を支配しています

私たちの体のすべての筋肉は神経によって支配されており、その神経は脊髄や脳へとつながっています。この神経のつながりは双方向であり、つまり神経は脳からの信号に基づいて筋肉の収縮を引き起こす(脳から筋肉へ)と同時に、筋肉の現在の状態に関する情報を脳へと伝達する(筋肉から脳へ)のです。

表情とは何でしょうか?

表情とは、顔面神経から神経支配を受けている多数の筋肉が、顔の皮膚に付着し、それを動かす動きのことです。

顔の筋肉のほとんどは、単一の神経によって支配されているため、単に「顔面神経」と呼ばれる。

もう少し医学的な表現で言えば、顔面神経は「第VII脳神経」としても知られています。

顔面神経は脳幹の奥深くから出て、耳の少し下で頭蓋骨を抜け、まるで木のように枝分かれしてあらゆる筋肉へと伸びています。興味深いことに、顔面神経は新皮質(新皮質とは、哺乳類の脳にのみ存在する領域を指します)にある、はるかに若い運動野ともつながっており、これらの領域は主に、会話に必要な顔面筋の動きを司っています。

ご存知でしたか?

その名の通り、脳幹は進化の過程において非常に古い脳の領域であり、人間はほぼすべての生き物とこれを共有している。

表情と感情

「顔面フィードバック仮説」:1988年にフリッツ・ストラックらによって見事に発見されたように、表情と感情は密接に結びついている。 彼らの研究では、被験者にペンを口にくわえたまま、漫画のユーモア度を評価してもらった。あるグループは唇を開いた状態で(笑顔を模倣して)歯でペンを挟み、もう一方のグループは唇だけでペンを挟んだ(自然な笑顔を妨げるように)。

フリッツ・ストラックが明らかにしたのは、次のことである。第1のグループは、その漫画をより面白いと評価した。ストラックらはこれを、顔面筋の選択的な活性化や抑制が刺激に対する感情的反応に大きな影響を与えるとする「顔面フィードバック仮説」の証拠と見なした。

感情、気持ち、気分

感情とは一体何なのでしょうか?

日常的な言葉遣いでは、感情とは、激しい精神活動と、強い快または不快を特徴とする、比較的短時間の意識的体験のことを指します。しかし、科学的研究においては、まだ一貫した定義は確立されていません。感情、気分、そして感覚の心理学的・神経科学的な基盤の間には、確かに概念的な重複が見られます。

感情は、生理的および心理的な覚醒と密接に関連しており、特定の感情にはそれぞれ異なるレベルの覚醒が伴います。神経生物学的な観点から言えば、感情とは、特定の外的または内的刺激の存在によって引き起こされる複雑な行動プログラムと定義することができます。

これらの行動計画には、以下の要素が含まれています:

- 心拍数の増加や皮膚電気伝導度の上昇といった身体的症状。こうした症状は、ほとんどの場合、無意識かつ不随意に現れる。

- 行動の傾向。例えば、危険な状況から即座に逃れるか、あるいは相手への物理的な攻撃に備えるといった「闘争・逃走反応」のような行動。

- 表情、例えば歯を見せることや眉をひそめることなど。

- 出来事、刺激、または対象物に対する認知的評価。

感情 vs. 気分 vs. 心境

感情とは、感情的な行動プログラムに対する主観的な認識である。感情は意識的な思考や内省によって引き起こされる。感情がなくても感情を抱くことは確かに可能だが、感情がなければ感情を抱くことは決してできない。

気分とは、漠然とした内面的で主観的な状態であり、一般的に感情ほど強くはなく、その持続時間もはるかに長い。気分は、性格特性や特徴に大きく左右される。意図的な表情(例えば笑顔)は、実際の感情(例えば幸福感)によって引き起こされるのと同様の身体的反応を引き起こすことがある。

「アフェクト」とは、感情、気分、そして心境を総称する言葉です。

感情を分類できますか?

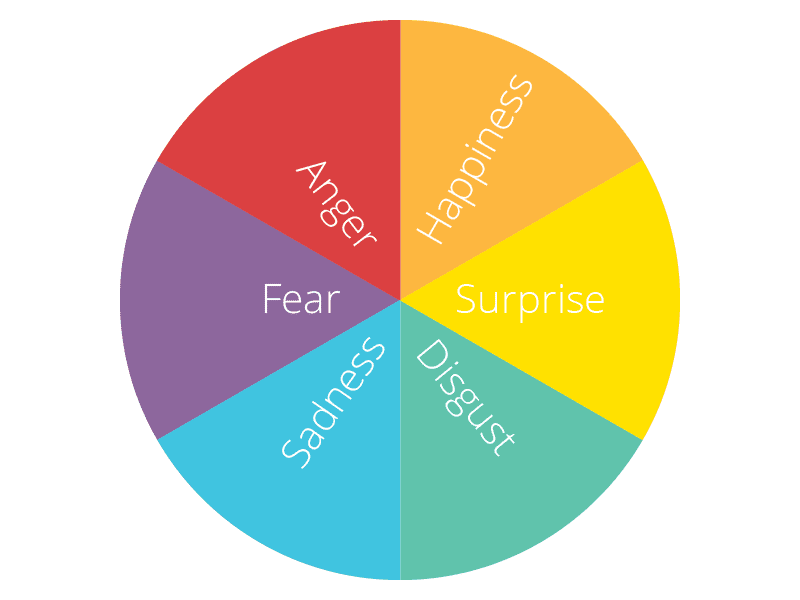

表情は感情を表す多くの要素のうちの一つに過ぎませんが、おそらく最も顕著な要素と言えるでしょう。人間は明らかに、わずかに異なる何千もの表情を作り出すことができます。しかし、性別、年齢、文化的背景、社会化の経緯にかかわらず、ほぼ誰もが特定の感情と結びつけて認識する、特徴的な表情のパターンはごくわずかしか存在しません。

これらの感情のカテゴリーは以下の通りです:

「ほぼすべての人がこれらの感情に伴う表情を作り出し、認識できる」という発見から、一部の研究者は(議論の余地はあるものの!)それらが普遍的であるという仮説を立てている。

「感情とは何か、そしてそれをどのように測定するのか」というテーマのウェビナーをご覧ください

表情分析技術

表情は、以下の3つの方法で収集・分析することができます:

- 顔面筋電図(fEMG)の測定により

- 顔の動きのライブ観察および手動によるコーディングにより

- コンピュータビジョンアルゴリズムを用いた自動的な表情分析により

それでは、これらについて詳しく説明しましょう。

顔面筋電図(fEMG)

顔面筋電図では、皮膚表面に電極を装着することで、顔面筋の活動を追跡することができます。fEMGは、収縮時に各筋線維から発生する微弱な電気信号を検出し、増幅します。fEMGの測定部位として最も一般的なのは、以下の2つの主要な筋肉群の近傍です:

1. 右/左の眉間筋(「眉をひそめる筋肉」):

これは眉の近くにある小さく細長いピラミッド状の筋肉で、一般的に眉をひそめる動作に関与しています。皺眉筋は眉を下方へ、かつ顔の中心方向へ引き下げることで、額に縦じわを作ります。この筋肉群は、強い日差しによるまぶしさを防ぐ際や、苦痛などの否定的な感情を表す際に働きます。

2. 右/左の頬骨筋(大):

この筋肉は、それぞれの頬骨から口角にかけて伸びており、口角を上に外側へ引き上げる働きがあり、一般的に笑顔と関連付けられています。

顔面動作コーディングシステム(FACS)

顔面動作コーディングシステム(FACS)は、解剖学的特徴に基づいて、専門のコーダーが顔の表情を分類するための完全に標準化されたシステムである。専門家は顔の動画を入念に観察し、現れるあらゆる表情を「アクションユニット(AU)」と呼ばれる基本要素の組み合わせとして記述する。

よくある誤解として、FACSは感情を読み取るものだと考えられがちです。しかし実際には、FACSは単なる測定システムに過ぎず、表情の意味を解釈するものではありません。これは、自転車に乗る目的は通勤することだと言うようなものです。確かに、自転車で通勤することはできますが、自転車は他にも(レジャーやスポーツのトレーニングなど)さまざまな用途に使えるのです。お分かりいただけたでしょうか。

しかし、分析段階において、FACSシステムはAUの組み合わせに基づいて感情をモジュール式に構築することを可能にする。

顔面動作単位(FAU)のコーディングを用いれば、以下の3つの表情のカテゴリーを区別するためのあらゆる知識を得ることができます:

- マクロ表現は通常0.5~4秒間続き、日常的なやり取りの中で見られ、概して肉眼でもはっきりと確認できる。

- マイクロエクスプレッションは0.5秒未満で消え、意識的または無意識的に現在の感情状態を隠そうとしたり、抑え込もうとしたりする際に生じます。

- 微妙な表情は、その根底にある感情の強さや深さと関連しています。私たちは常に微笑んだり、眉を上げたりしているわけではありません。こうした顔の動きの強さは絶えず変化しています。微妙な表情とは、関連する感情の強さがまだ低いとみなされる段階の、表情の始まりを指します。

こうした制約を背景に、完全に自動化され、コンピュータベースの新しい世代の表情認識技術が登場した。

表情分析技術

米国や欧州の主要な学術機関による画期的な研究を基盤として、自動顔表情認識技術が開発され、一般に広く利用可能となった。この技術は、顔を瞬時に検出し、表情をコード化し、感情の状態を認識するものである。

この画期的な進展は、主に最先端のコンピュータビジョンおよび機械学習アルゴリズムの導入に加え、世界中から収集された高品質な表情データベースによって実現されました。

ご存知でしたか?

自動顔面コーディング技術は、情動神経科学およびバイオセンサー工学の分野に革命をもたらし、感情分析や知見を科学界、商業用途、そして一般社会に広く普及させた。

これらの技術では、ノートパソコン、タブレット、携帯電話に内蔵されたカメラ、あるいはパソコンの画面に取り付けられた独立型のウェブカメラを使用し、回答者がさまざまなカテゴリーのコンテンツを閲覧している様子を動画で記録します。

安価なウェブカメラを使用することで、高価な専用機器が不要となり、自動表情コーディングは、回答者の自宅、職場、車内、公共交通機関など、さまざまな自然な環境下での顔動画の撮影に最適です。

iMotionsによる「リモートリサーチ」ウェビナーをご覧ください:自宅のソファからできる表情分析と行動コーディング

この魔法のようなブラックボックスの内部では、一体どのような科学技術的なプロセスが進行しているのでしょうか?

To see how these concepts are applied in practice, explore our Behavioral Research Resources page.

自動顔面コーディングの基盤となる技術

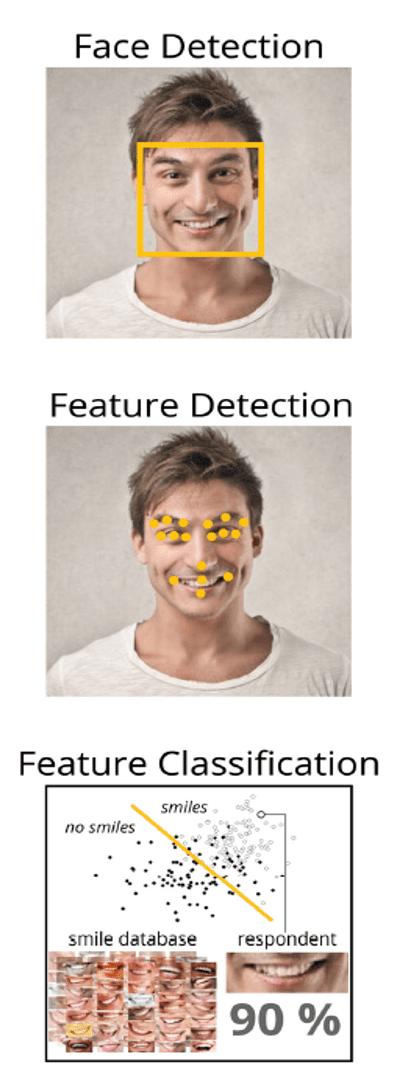

概して、すべての感情認識エンジンは同じ手順で構成されています。

顔検出 動画の

フレームや画像内の顔の位置を特定します。これは、例えばViola-Jonesカスケード分類器アルゴリズムを適用することで実現できます。これは高度な技術に聞こえるかもしれませんが、実際にはiPhoneやAndroidスマートフォンのカメラにもこの技術が搭載されています。その結果、検出された顔を囲む顔枠が表示されます。

特徴検出

検出された顔の中で、目や目尻、眉、口角、鼻先などの顔の特徴点が検出されます。その後、回答者の実際の顔に合わせるため、内部の顔モデルの位置、サイズ、スケールが調整されます。

これは、回答者の顔に重ねられた目に見えない仮想のメッシュのようなものだと想像していただければよいでしょう。回答者の顔が動いたり表情が変わったりするたびに、顔モデルは瞬時にそれに合わせて変化します。 その名の通り、顔モデルは回答者の実際の顔を簡略化したものです。実際の顔に比べて細部(いわゆる特徴)は大幅に省かれていますが、必要な機能を実現するために必要な顔の特徴は正確に備えています。

代表的な特徴としては、単一のランドマークポイント(眉尻、口角、鼻先)や特徴群(口全体、眉のアーチ全体など)があり、これらは感情を表す顔領域の「ゲシュタルト」全体を反映している。

特徴の

分類

簡略化された顔モデルが利用可能になると、すべての主要な特徴の位置および方向情報が分類アルゴリズムに入力され、アルゴリズムはこれらの特徴をアクションユニットコード、感情状態、およびその他の感情指標に変換する。

その背景にあるちょっとした理論(と分析)をご紹介します。

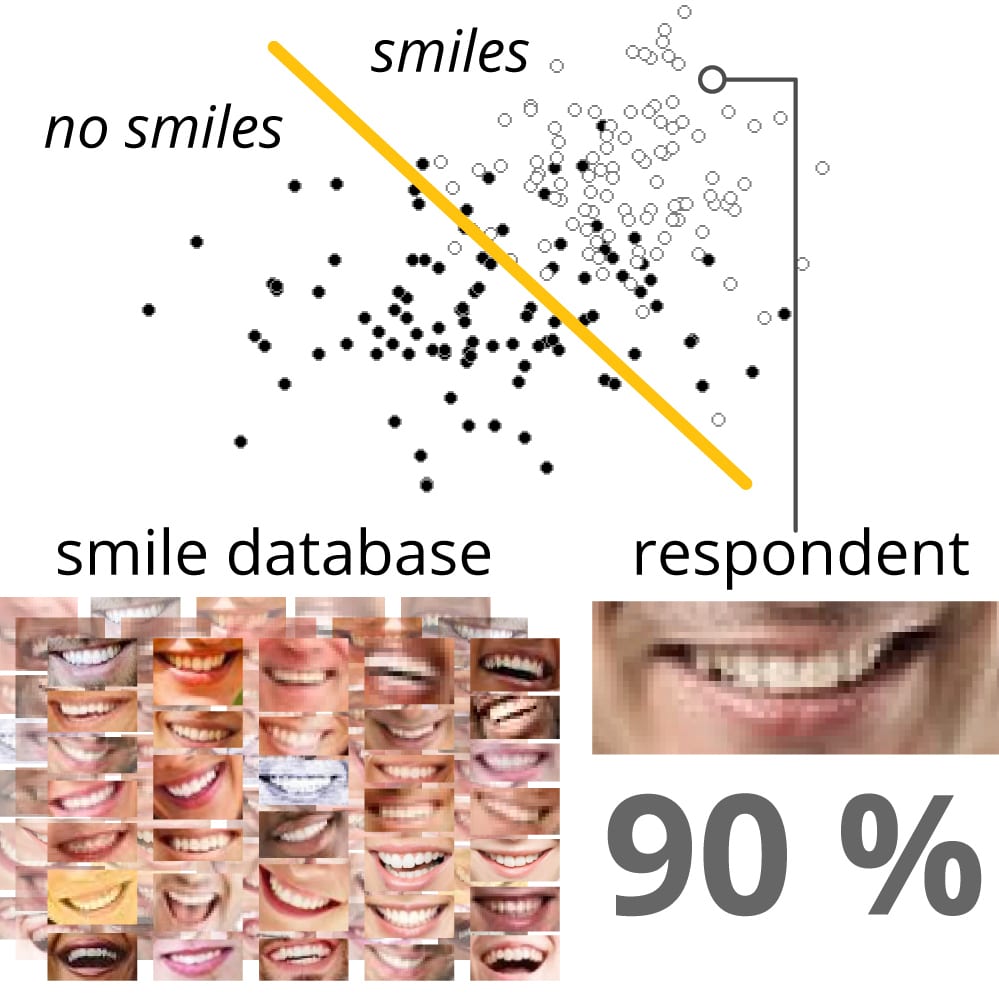

顔の特徴を指標に変換する処理は、統計的手法によって行われ、顔の実際の外観や特徴の配置を、表情エンジンが提供する基準データベースと数値的に比較することで実現される。

それはどういう意味でしょうか?回答者の現在の表情を、データベース内の数十万枚もの写真と一つひとつ照合するわけではありません。そうすれば非常に手間がかかり、永遠に終わらないでしょう。その代わりに、データベースには、複数の地理的地域や人口統計学的プロファイルに属する回答者、さらには刺激のカテゴリーや記録条件にわたる、あらゆる特徴の統計データや標準分布が収録されています。

どの表情分析エンジンも、それぞれ異なるデータベースを使用しています。これが、まったく同じ素材を異なるエンジンに入力した際に、結果がわずかに異なることがある理由の一つです。

分類は純粋に統計的なレベルで行われます。例を挙げましょう。回答者の口角が上向きになっている場合、人間のコーダーであればこれをAU12(「口角引き上げ」)の活動としてコーディングし、回答者が微笑んでいると判断します。 一方、表情認識エンジンは、口角と口の中央との垂直方向の差を計算し、10 mmという値を返します。この値は、データベース内のすべての可能な値(例えば0 mmから20 mmの間)と比較されます。

この例では、回答者の表情は「笑顔」の分布(0~10~20 mm)のちょうど真ん中に位置しているようです。エンジンに関しては、現在の表情が「ほほえみ」よりは強いものの、「満面の笑み」ほどではないと断言できます。

理想を言えば、分類器は各感情、AU、または指標に対して「Yes」か「No」のいずれかを返すはずです。しかし、残念ながらそう簡単ではありません。「smile」の分類器をもう一度見てみましょう:

塗りつぶされた点(やや左側)は、データベース内の「笑顔」に分類されていない口元の形状をすべて示しており、白い点(やや右側)は「笑顔」とみなされる口元の形状を表しています。

オレンジ色の線は分類基準を示しています。

線の左側にあるものはすべて「笑顔ではない」と分類され、右側にあるものはすべて「笑顔」と分類される。

明らかに、「笑顔ではない」と「笑顔」の間には曖昧な移行領域が存在し、そこでは一部の口元の形状が誤分類されることがあります。これらは、気づかれにくい微かな笑顔であったり、あるいは笑顔というよりはあくびに近い口元の形状であったりする可能性があります。その結果、分類器は、その表情が真の「笑顔」である可能性や確率を反映した、確率的な結果しか返すことができません。

この例では、回答者の笑顔がかなり明白であり、「特徴空間」の右端に位置しています。ここでは、分類器は「笑顔」という判定に非常に確信を持っており、90%という確固たる判定結果を返しています。他のケースでは、分類器の判定精度に対する確信度が低くなることもあります。

特徴の分類は、感情、アクションユニット、および主要な特徴ごとに個別に実行されます。つまり、笑顔の分類器はしかめっ面の分類器について何も知らず、それらは単に互いに独立してコーディングされるのです。この方法の利点は、自動コーディングが、人間(特に経験の浅いコーダー)による手動コーディングよりもはるかに客観的に行われる点にあります。手動コーディングでは、アクションユニットの活性化を他のアクションユニットと関連付けて解釈しがちであり、その結果、結果が大きく変わってしまうからです。

顔分類結果の可視化と分析について詳しく掘り下げる前に、最高品質のデータを収集するためのガイドラインや推奨事項をいくつか見ておきましょう。

顔分類結果の可視化と分析について詳しく掘り下げる前に、最高品質のデータを収集するためのガイドラインや推奨事項をいくつかご紹介します。これらの分類結果がどのように実用的な知見につながるのかについてさらに詳しく知りたい方は、当社の「Face Analytics」に関する専用リソースをご覧ください。

設備

では、具体的に見ていきましょう。

質の高いデータを収集する際にはどのような点に留意すべきか、最適な刺激とは何か、回答者の募集や指示を行う際に何を心に留めておくべきか? 私たちがお手伝いします。

- まず第一に、自動的な表情認識はオンラインで実施することが可能であり、つまり、被験者に感情的な刺激を提示しながら、その表情をモニタリング(および/または記録)することができる。

- オンラインでのデータ収集に加え、表情検出はオフラインでも活用でき、例えば、事前に記録された顔の映像を処理する際などに利用できます。さらに、より多くの参加者を撮影し、最小限の編集を行うだけで、各回答者の表情を分析することも可能です。

ウェブカメラを使用したオンラインでの自動顔面コーディングを行う際は、以下のカメラの仕様を参考にしてください:

- レンズ:標準レンズを使用してください。広角レンズや魚眼レンズは、画像が歪んで処理エラーの原因となる可能性があるため、使用しないでください。

- 解像度:最低解像度は、表情分析エンジンによって異なります。HDや4Kのカメラ解像度は必ずしも必要ありません。回答者の顔がはっきりと確認できる限り、自動表情分析は低解像度でも問題なく機能します。

- オートフォーカス:回答者の顔を一定の距離範囲内で追跡できるカメラを使用することをお勧めします。一部のカメラモデルには、回答者がピントから外れないようにするための、ソフトウェアによる追跡機能が追加で搭載されています。

- 絞り、露出、ホワイトバランス:一般的に、ほとんどのカメラは照明条件に合わせて自動的に調整を行うことができます。しかし、逆光の場合、多くのカメラではゲイン制御によって前景のコントラストが低下し、画質が低下する可能性があります。

ご存知でしたか?

カメラによっては、照明条件に応じてフレーム数を動的に調整する場合があります(例えば、照明が不十分な場合にフレームレートを下げて補正するなど)。その結果、フレームレートが変動する動画ファイルが生成されてしまいます。これは明らかに望ましくない状況です。フレームレートが変動してしまうと、回答者間の結果を比較・集計することが困難になるからです。

ウェブカメラについて:HD対応のウェブカメラの使用をお勧めします。もちろん、スマートフォンのカメラ、IPカメラ、ノートパソコン内蔵のウェブカメラなど、その他のカメラでも(用途によっては)自動表情分析を行うことは可能です。ただし、これらのカメラは一般的に、オートフォーカス、明るさ、ホワイトバランスの補正機能が限定的である点にご注意ください。

「表情分析をリモートで行う方法」をご覧ください

表情分析(FEA):応用分野

表情認識技術を用いれば、感情の高まりや顔の反応を引き出すことを意図したあらゆるコンテンツ、製品、サービス――食品サンプルやパッケージなどの実物、動画や画像、音、香り、触覚刺激など――の影響を検証することができます。 特に、無意識の表情やまぶたのわずかな開きは、実際の外部刺激や心象によって引き起こされる感情状態の変化を反映していると見なされるため、重要な研究対象となります。

では、最近、どのような商業分野や学術研究分野で感情認識技術が活用され始めているのでしょうか?ここでは、特に注目されている研究分野をいくつかご紹介します:

1. 消費者神経科学とニューロマーケティング

疑いの余地はありません。消費者の嗜好を評価し、説得力のあるメッセージを届けることは、マーケティングにおいて極めて重要な要素です。自己申告やアンケートは、回答者の態度や認知度を把握する上で理想的なツールであるかもしれませんが、自己認識や社会的望ましさの影響を受けない感情的な反応を捉えるという点では、限界があるかもしれません。

そこで、感情分析の価値が発揮されます。顔の表情を追跡することで、製品やサービスに対するより無意識的な感情的反応を定量的に測定し、自己申告による情報を大幅に充実させることができるのです。表情分析に基づいて、製品の最適化や市場セグメントの評価を行い、ターゲット層やペルソナを特定することが可能です。表情分析は、マーケティング戦略を強化するために非常に多くのことを実現してくれます。ぜひ一度、考えてみてください!

2. メディアテストおよび広告

メディア調査では、個々の回答者やフォーカスグループを対象に、テレビCMや予告編、パイロット版の全編を視聴させながら、その表情を観察することがある。感情的な反応(特に笑顔)が期待される場面でありながら、視聴者がその意図を「理解できなかった」場面を特定することは、最も極端な表情を引き出す重要なシーンを見つけることと同様に重要である。

こうした状況下では、嫌悪感、苛立ち、あるいは困惑といった感情の高まりを示す、望ましくない否定的な表情を引き起こすシーンを特定して改善したり(こうした感情は、コメディ番組がヒット作になる助けにはならないでしょう?)、あるいは試写会での観客の反応を参考にし、最終版における肯定的な表情の割合を高めるようにしたりすることが有効でしょう。

3. 心理学研究

心理学者は、人間の外部および内部の刺激に対する感情的な反応を特定するために、表情を分析する。体系的な研究において、研究者は刺激の特性(色、形、提示時間)や社会的期待を意図的に変化させることで、性格特性や個人の学習歴が表情にどのような影響を与えるかを評価することができる。

4. 臨床心理学と心理療法

自閉症スペクトラム障害(ASD)、うつ病、または境界性パーソナリティ障害(BPD)などの患者は、自身や他者の表情を調節・処理・解釈する能力に著しい障害が見られるという特徴があります。 患者が感情を喚起する刺激や社会的合図(例えば他者の顔など)にさらされている際の表情をモニタリングすることは、診断段階および介入段階の双方において、基礎となる認知行動療法の成功率を大幅に高めることができる。 その優れた例が、カリフォルニア大学サンディエゴ校(UC San Diego)のTemporal Dynamics of Learning Center(TDLC)によって開発された「Smile Maze」である。このプログラムでは、自閉症の子供たちが、笑顔によってゲームキャラクターを操作するパックマン風のゲームを通じて、表情の制御を訓練する。

5. 医療用途および美容整形

顔面神経麻痺の影響は甚大なものとなり得ます。その原因としては、ベル麻痺、腫瘍、外傷、疾患、感染症などが挙げられます。患者は一般的に、外見の著しい変化や、コミュニケーション能力、感情表現能力の低下に悩まされます。表情分析は、症状の悪化度を定量的に評価したり、麻痺した筋肉群の機能回復を目的とした外科的治療や作業療法・理学療法の効果を評価したりするために活用できます。

6. ソフトウェアのUIおよびウェブサイトのデザイン

理想を言えば、ソフトウェアの操作やウェブサイトの閲覧は快適な体験であるべきであり、フラストレーションや混乱は可能な限り最小限に抑える必要があります。テスターがウェブサイトやソフトウェアのダイアログを閲覧している際の表情を観察することで、対象とするターゲット層の感情的な満足度に関する洞察を得ることができます。ユーザーが障害に直面したり、複雑なサブメニューで迷ったりすると、眉をひそめたり、しかめっ面をしたりといった「否定的な」表情が増加するのが確認できるでしょう。

7. 人工社会エージェント(アバター)の設計

つい最近まで、ロボットやアバターは、キーボードやマウスの入力に基づいてユーザーの指示に応答するようにプログラムされていました。 ハードウェア技術、コンピュータビジョン、機械学習における最新の進歩により、コミュニケーション相手の感情状態を確実に検知し、柔軟に対応できる人工ソーシャルエージェントの基盤が築かれた。AppleのSiriは、感情的に真に知能を備えた機械の第一世代と言えるかもしれないが、世界中のコンピュータ科学者、医師、神経科学者たちは、人間のユーザーの現在の感情状態を理解し、適切に対応するための、さらに高度なセンサーやアルゴリズムの開発に尽力している。

iMotionsを正しく活用する方法

注:これは、当社の無料ガイド『表情分析 – 完全ポケットガイド』からの抜粋です。刺激の設定、データ出力と可視化、その他の生体センサー、および「iMotionsを正しく活用する方法」に関する詳細情報が掲載された完全版ガイドを入手するには、下のバナーをクリックしてください。表情分析に関してご質問がございましたら、お気軽にお問い合わせください。