Entdecken Sie in diesem umfassenden Leitfaden die wichtigsten Schritte zur Durchführung von Eye-Tracking-Tests auf Mobiltelefonen. Erfahren Sie mehr über die Tools und Techniken, die erforderlich sind, um die Aufmerksamkeit und das Engagement der Nutzer effektiv zu messen.

Table of Contents

Jeder, der schon einmal ein Smartphone oder ein anderes modernes Mobilgerät benutzt und die Freude an den Millionen von Apps erlebt hat, die uns zur Verfügung stehen, hat zweifellos auch schon die Erfahrung gemacht, dass eine App durch eine schlechte Benutzeroberfläche (UI) ruiniert wurde.

Produkt- und User-Experience-Designer (UX-Designer) müssen oft mehrere Runden von Tests, Befragungen und Analysen durchlaufen, wobei sie das Produkt, die Funktion oder das Design mehrfach überarbeiten, bevor sie etwas veröffentlichen, das als benutzerfreundlich gilt.

Aus diesem Grund beschäftigen sich Designer und Entwickler in der heutigen, sich ständig wandelnden Technologielandschaft mit einer Reihe von Fragen, die ihnen beim Designprozess helfen sollen. Die Fragen, die uns häufig gestellt werden, drehen sich darum, inwieweit iMotions bei den drängendsten Fragen im Bereich der Smartphone- und App-Tests helfen kann. Fragen wie:

- Wie gehen Menschen mit verschiedenen Arten von Inhalten um, insbesondere in der heutigen Zeit, in der wir durch gedankenloses Scrollen Empfehlungen erhalten, mit anderen in Kontakt treten und uns über das Weltgeschehen informieren?

- Inwiefern beeinflussen Apps unsere Teilhabe an der Gesellschaft und unseren Umgang mit gesellschaftlichen und politischen Ereignissen und Veränderungen?

- Wie werden Websites auf einem kleinen Handybildschirm im Vergleich zu einem Computerbildschirm dargestellt?

- Lesen die Leute den Text bis zum Ende, oder gibt es ein optimales Verhältnis zwischen Text und Bildern, um die Aufmerksamkeit der Leser aufrechtzuerhalten?

Biosensoren bieten eine hervorragende Möglichkeit, Konzepte wie Aufmerksamkeit, emotionale Reaktionen, Webdesign und alle Arten von UX-Tests zu untersuchen.

Um diese Fragen zu untersuchen, haben Smart Eye und iMotions einen mobilen Ständer entwickelt, mit dem Sie Ihre Smart Eye-Eye-Tracker für Tests mit Smartphones und Apps nutzen können. So können Sie alle Vorteile Ihres bildschirmbasierten Eye-Trackers auch auf einem Smartphone nutzen.

Der Grund, warum wir einen mobilen Ständer entwickelt haben

Bevor wir fortfahren, lohnt es sich, kurz zu erläutern, warum die Entwicklung einer Lösung, die wie Kunststoff auf Metall aussieht, tatsächlich ein großes Unterfangen ist. Ein herkömmlicher bildschirmbasierter Eye-Tracker geht davon aus, dass sich der Eye-Tracker unterhalb des Bildschirms befindet und der Teilnehmer einen bestimmten Abstand zu diesem Bildschirm einhält.

Mit diesen Informationen kann der Tracker den Winkel berechnen, den die Augen der Teilnehmer bilden, wenn sie auf verschiedene Bereiche des Bildschirms blicken. Auch wenn dies die komplexen mathematischen Berechnungen, die ein Eye-Tracker durchführt, stark vereinfacht, reicht es doch aus, um zu verstehen, dass der Einsatz derselben Hardware über einem Smartphone statt über einem Computer einige raffinierte Entwicklungen hinter den Kulissen erfordert.

Stellen Sie sich zunächst vor, Sie benutzen ein Smartphone und darunter befindet sich ein Eye-Tracker. Zack, fertig! Da braucht man doch gar keinen Handyhalter, oder? In Ihrer Vorstellung mag das Sinn ergeben, aber es gibt einen entscheidenden Unterschied zwischen Eye-Tracking auf einem Smartphone und auf einem Desktop-Bildschirm: die Tatsache, dass Sie Ihre Hände benutzen.

Die Teilnehmer werden wahrscheinlich mit den Händen über das Display streichen und mit dem Smartphone interagieren. In der Praxis werden Sie feststellen, dass die Hände den Eye-Tracker verdecken, wenn dieser unterhalb des Smartphones angebracht ist, was zu Datenverlusten führt. Die Art und Weise, wie wir ein mobiles Gerät nutzen, erfordert eine spezielle Anordnung, wenn wir aussagekräftige Eye-Tracking-Daten erhalten wollen.

Zweitens unterscheiden sich die Abmessungen eines Smartphones erheblich von denen eines Computerbildschirms. Der Bildschirm ist nicht nur kleiner, sondern wir halten ein Smartphone auch in einem anderen Winkel als beispielsweise einen Laptop. Die Einstellungen des Eye-Trackers berücksichtigen diesen Winkel bei der Berechnung der Blickposition. Daher ist es unerlässlich, die Position, den Winkel und die Höhe des Trackers relativ zum Bildschirm steuern zu können, um möglichst genaue Blickberechnungen zu erhalten, wenn der Tracker von einem Monitor auf ein Smartphone und umgekehrt bewegt wird.

Der Einsatz eines mobilen Ständers schafft somit die perfekte Balance zwischen kontrolliertem Experimentieren und ökologischer Validität – man kann mobile Inhalte in der Umgebung testen, für die sie bestimmt sind, ohne dabei die Datenqualität zu beeinträchtigen. Die Tatsache, dass man denselben Smart-Eye-Tracker sowohl für den Bildschirm als auch für das Smartphone verwenden kann, vereinfacht die Sache zudem erheblich.

UX-Forschung mit dem mobilen Ständer – So führen Sie Tests auf Ihrem Smartphone durch

Wie können wir den mobilen Ständer also in der UX-Forschung mit iMotions einsetzen? Wir haben eine Studie durchgeführt, in der die Teilnehmer zwei Aufgaben erledigen sollten: 1. Einen unserer Blogbeiträge zur Gesichtsausdrucksanalyse lesen und 2. durch den Instagram-Account von iMotions scrollen. Wir haben diese Aufgaben ausgewählt, um einige der wichtigsten Verhaltensweisen hervorzuheben, die unsere Kunden gerne untersuchen, wie zum Beispiel das Scrollen in sozialen Medien, die Navigation auf Websites und das Betrachten von Anzeigen in eingebetteten Inhalten, um nur einige zu nennen.

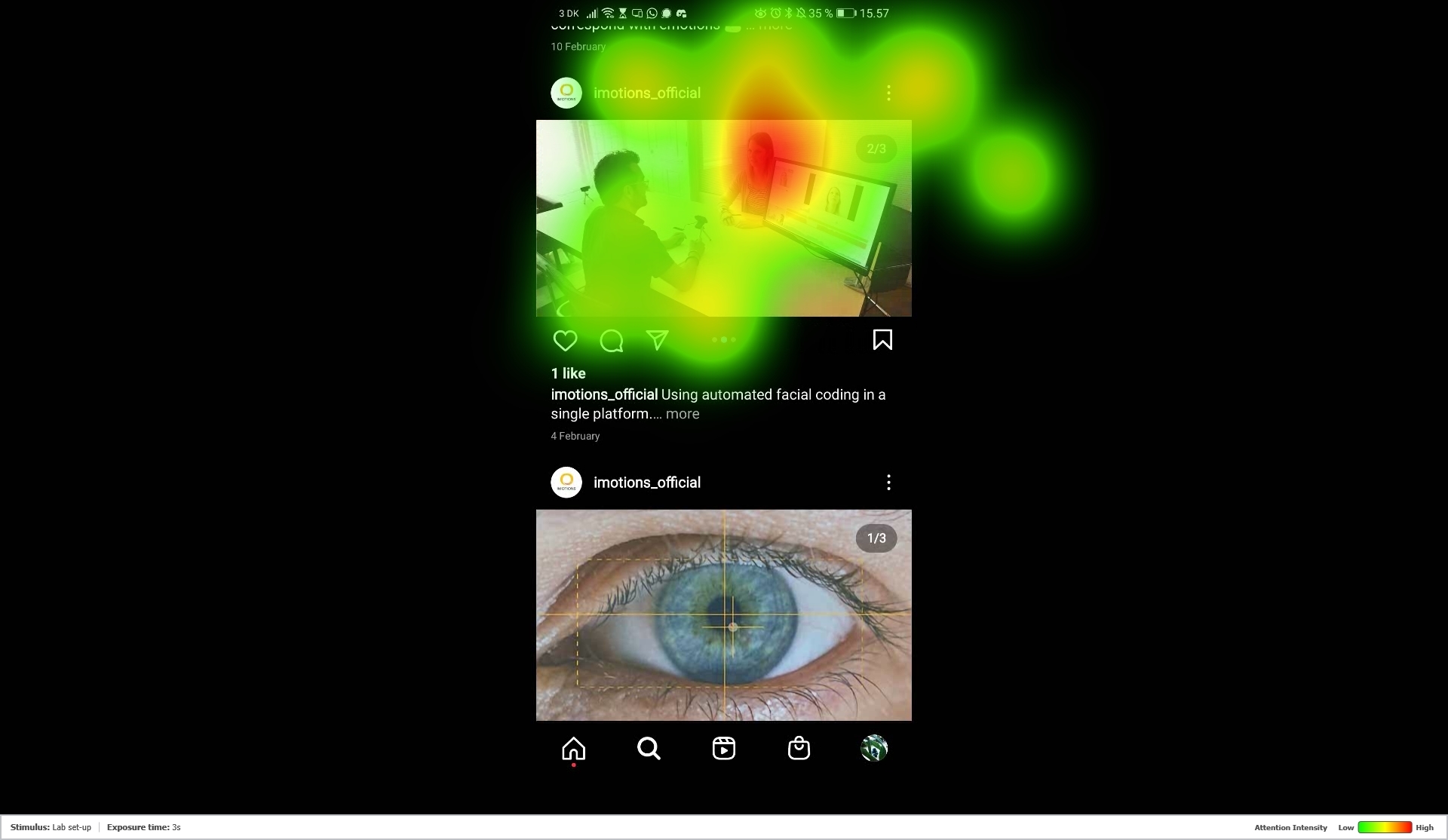

Die erste Frage, die wir uns gestellt haben, lautete: Wenn wir uns unter den unzähligen scrollbaren Inhalten nur für ein einziges Bild interessieren würden, könnten wir dieses dann isolieren und uns genauer ansehen? Die Antwort lautet natürlich: Ja. Auf dem Bild unten/nebenan sehen wir eine Heatmap eines Bildes, das eine typische Laborumgebung mit iMotions Desktop zeigt. Dies war eines von vielen Bildern auf unserem Instagram-Account.

Mithilfe des Gaze-Mapping-Tools von iMotions konnten wir jedoch das Bild auswählen, das uns interessierte, und mithilfe von Computer Vision den dynamischen Blickverlauf während des Scrollvorgangs auf dieses Bild übertragen. So konnten wir die Eye-Tracking-Daten mehrerer Teilnehmer zusammenfassen, um diese Heatmap zu erstellen.

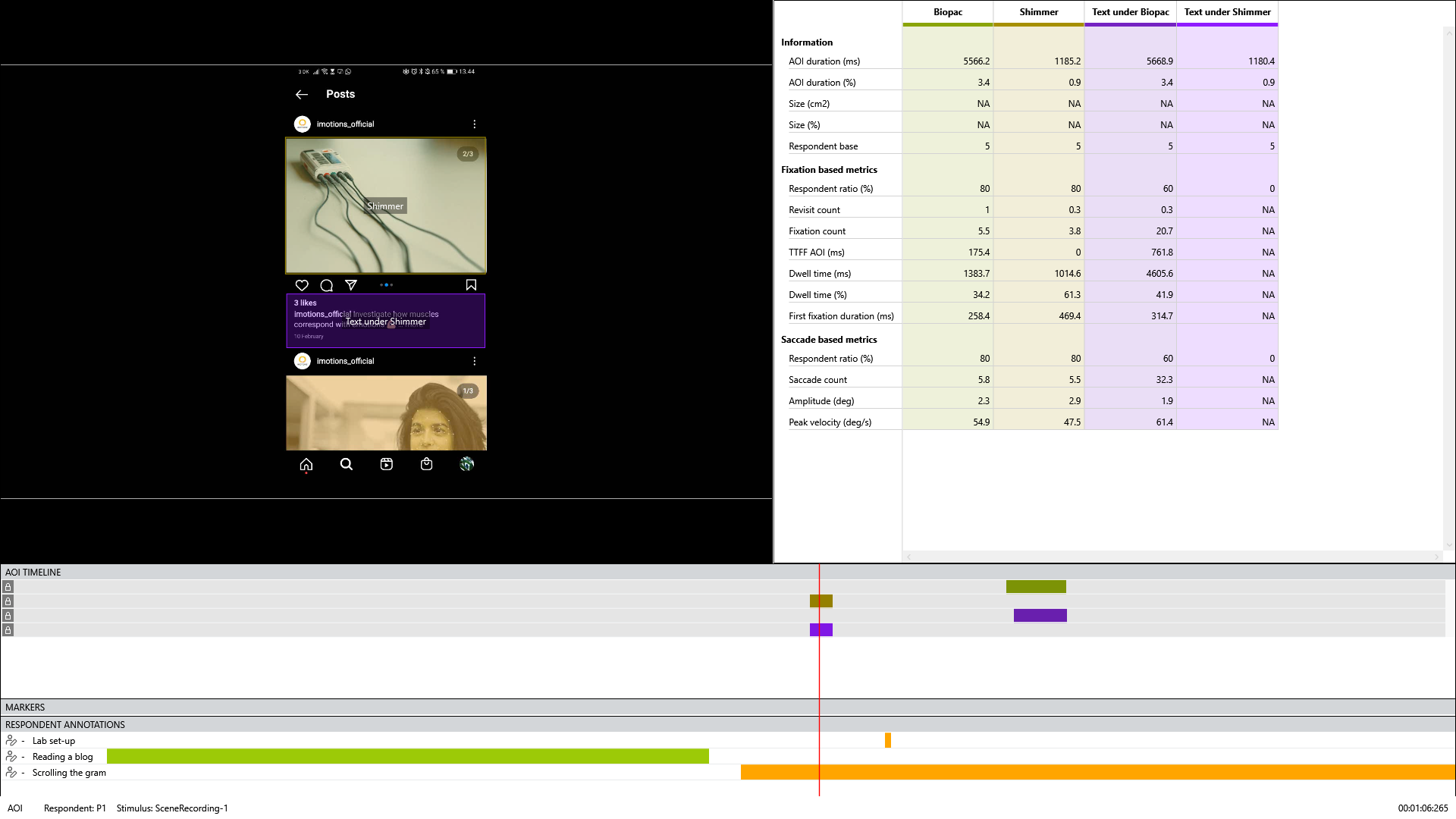

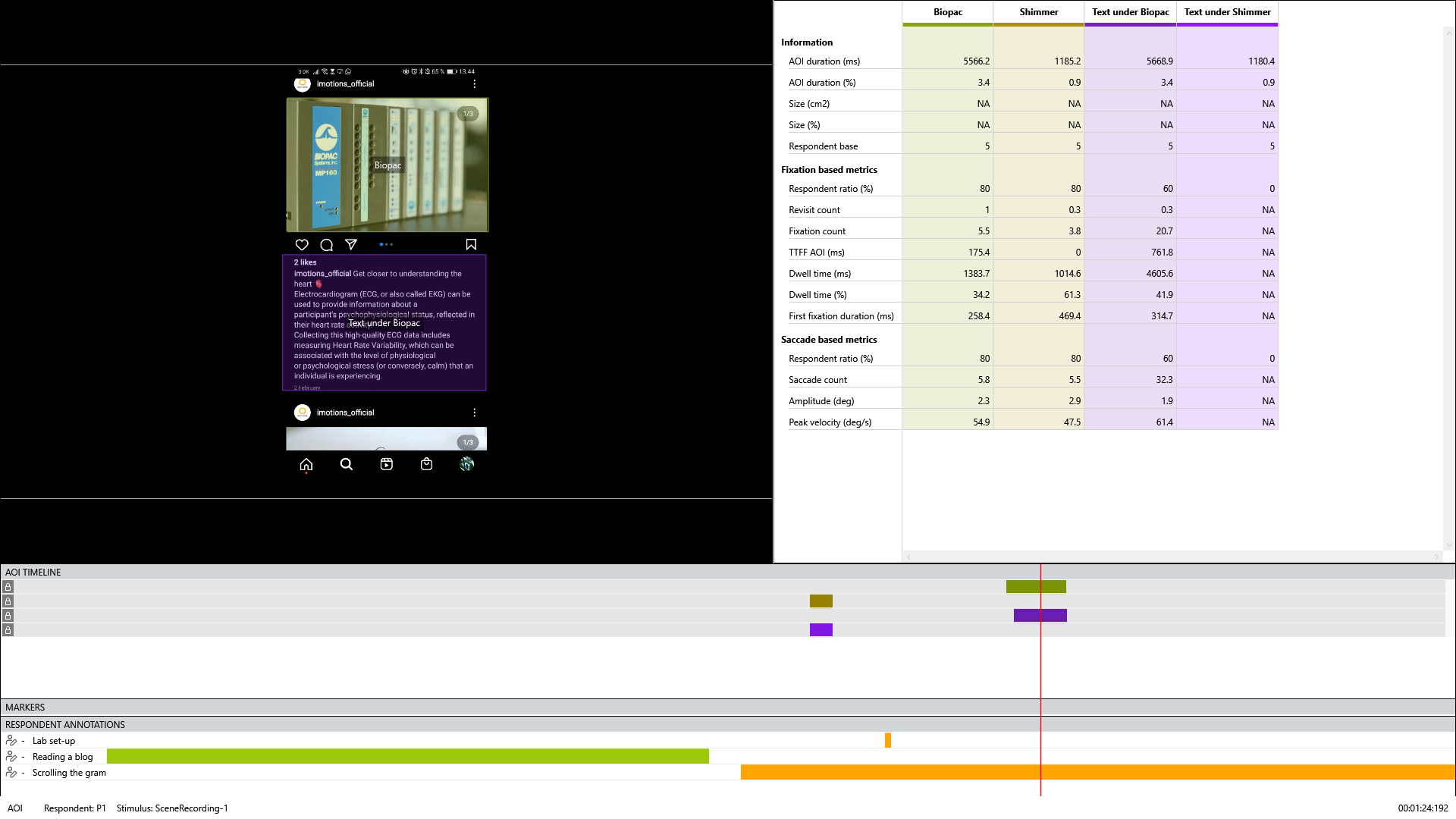

Als Nächstes wollten wir das Scrollverhalten untersuchen und einschätzen, wie schwierig dessen Analyse sein würde. Wie wir inzwischen alle wissen, kann Endlos-Scrolling einen ununterbrochenen Reizfluss erzeugen, was die Zusammenfassung und Analyse erschwert. Erschwerend kommt hinzu, dass Menschen mit unterschiedlicher Geschwindigkeit scrollen, an unterschiedlichen Stellen innehalten und unterschiedliche Wege wählen, um eine Aufgabe zu erledigen.

Mit anderen Worten: Es gibt individuelle Unterschiede darin, worauf Menschen achten, was sie ignorieren, was ihre Aufmerksamkeit weckt und was sie aufrechterhält. Eine gute Möglichkeit, bestimmte Elemente für die Analyse herauszufiltern, ist die Verwendung von Interessensbereichen (AOIs). In iMotions können Sie dynamische AOIs nutzen, die Sie während der Analyse auf dem Bildschirm verschieben können, um das Scrollverhalten jedes einzelnen Teilnehmers widerzuspiegeln.

Als Beispiel wollten wir zwei der Sensoren vergleichen, die wir für die galvanische Hautreaktion (GSR) integrieren – den Biopac und den Shimmer. Wie aus der AOI-Analyse hervorgeht, zogen beide Sensoren die Aufmerksamkeit der meisten unserer Teilnehmer auf sich: 80 % der Teilnehmer schauten sich beide Geräte an. Während die Teilnehmer jedoch 34 % ihrer Zeit damit verbrachten, das Bild des Biopac zu betrachten, verbrachten sie fast 42 % ihrer Zeit damit, die Beschreibung dieses riesigen Geräts zu lesen.

Beim Shimmer hingegen hatte niemand das Bedürfnis, den Text zu lesen, sondern verbrachte 61 % der Zeit damit, das Gerät anzuschauen. Das Bild des Shimmer war zweifellos fotogener als das des Biopac, doch die Teilnehmer beschäftigten sich eher mit den Inhalten unter dem Biopac-Bild als unter dem Shimmer-Bild.

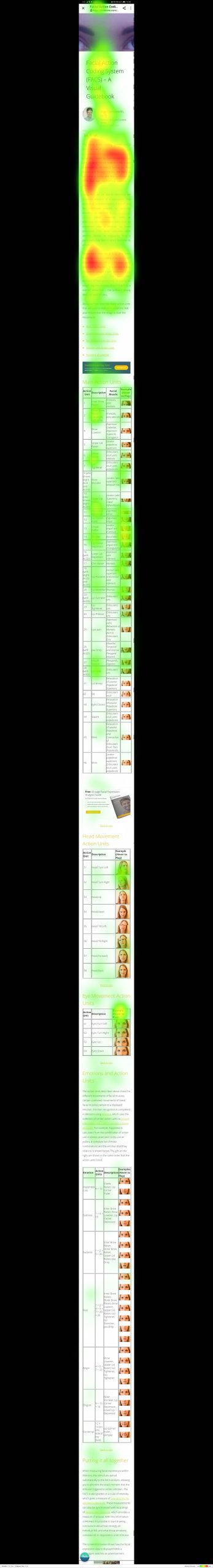

Eine weitere häufig gestellte Frage betrifft das Zusammenspiel von Text und Bildern. Dazu haben wir unseren Blogbeitrag zur Analyse von Gesichtsausdrücken ausgewählt, der einen ganzen Unterabschnitt zu den verschiedenen Ausdrucksformen enthält, die vom Algorithmus gemessen werden.

Diese Informationen veranschaulichen anhand von Text und Bildern, welche Gesichtsausdrücke gemessen werden können. Nehmen wir an, wir möchten eine Heatmap erstellen, um festzustellen, ob sich die Teilnehmer eher auf den Text oder auf die Bildhinweise konzentrieren, müssen aber einen Weg finden, die Daten über einen so langen, scrollbaren Stimulus hinweg zusammenzufassen.

Solche Untersuchungsdesigns sind bei Websites, Handbüchern, Anleitungen und anderen Usability-Studien üblich. Auch hier hilft uns das Gaze-Mapping dabei, eine Heatmap des gesamten FEA-Leitfadens zu erstellen. In diesem Fall kann es der Tatsache Rechnung tragen, dass unsere Teilnehmer scrollen, und eine Heatmap auf einem Referenzbild erstellen, bei dem es sich eigentlich um einen Screenshot des gesamten Dokuments handelt. (Der Artikel wird nach dem Bild fortgesetzt.)

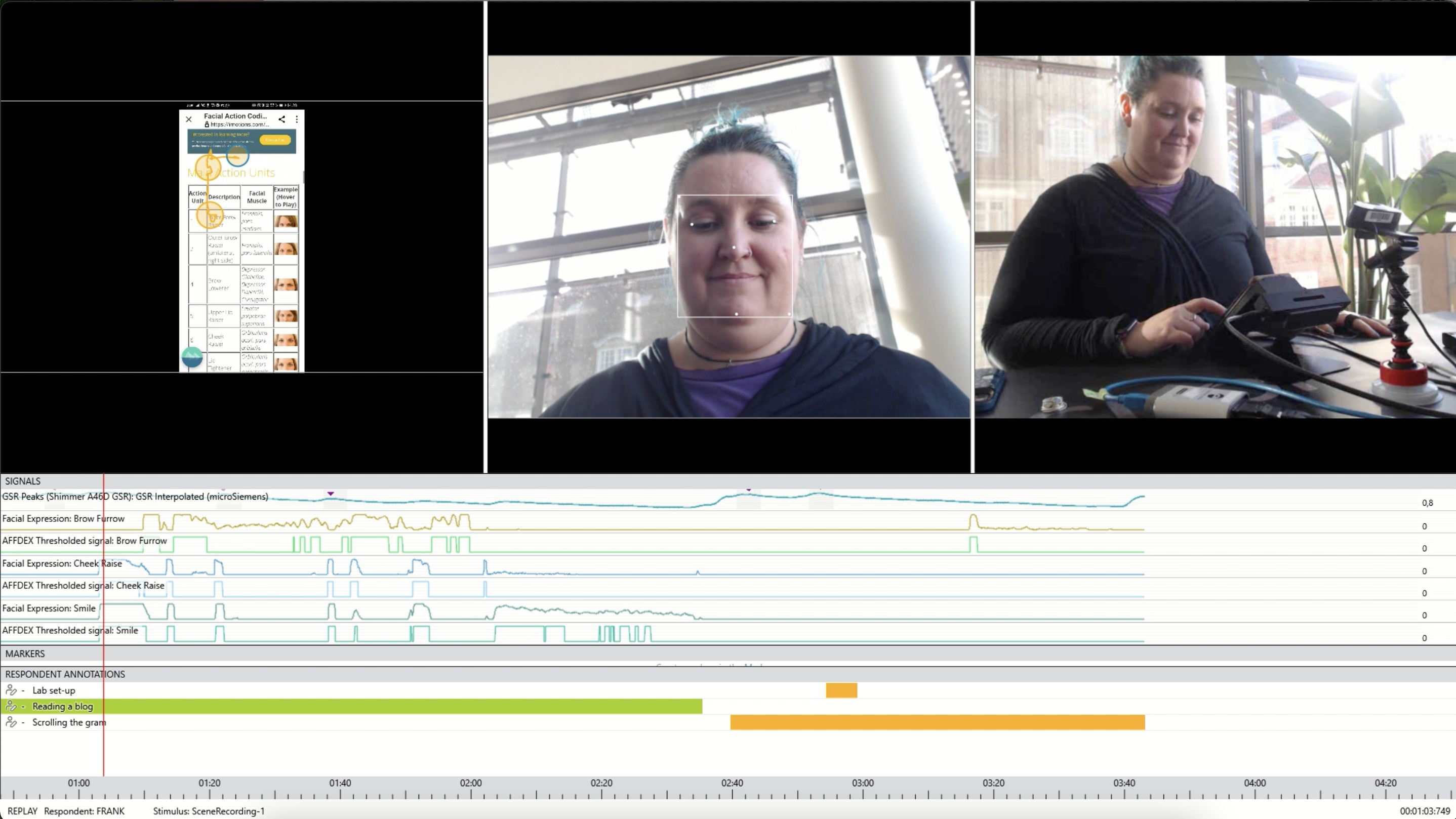

Natürlich lässt sich das Verständnis von Emotionen und Vorlieben – über das reine Betrachten von Bildern hinaus – am besten durch einen multimodalen Ansatz erreichen, und genau das haben wir auch getan. Eine Webcam zur Analyse der Mimik lässt sich problemlos auf einem Stativ hinter dem Mobilgeräteständer befestigen, und die Teilnehmer können ein Shimmer-Gerät an ihrer nicht wischenden Hand tragen, um die GSR zu messen. Hier sehen Sie einen unserer Teilnehmer, der versucht, die Gesichtsausdrücke nachzuahmen, über die er gerade liest, während die in Grau hervorgehobenen GSR-Spitzen seine emotionale Erregung gegenüber dem Text anzeigen.

Bei allen Teilnehmern kann multimodale Forschung zusätzliche Einblicke liefern, wie stark sich die Menschen mit den Inhalten, mit denen sie interagierten, beschäftigten, worauf sie ihre Aufmerksamkeit richteten und wie sich diese Beschäftigung hinsichtlich Valenz und Intensität gestaltete.

Wie Sie sehen, ermöglicht der Einsatz eines mobilen Ständers den Forschern, mobile Inhalte auf einem echten Smartphone zu testen, ohne die Datenqualität zu beeinträchtigen, da die Datenerfassung außerhalb einer kontrollierten Desktop-Umgebung erfolgt. In Kombination mit den leistungsstarken Eye-Tracking-Analysen von iMotions, darunter Gaze Mapping und dynamische AOIs, sind den Arten von Studien, die Sie auf mobilen Geräten durchführen können, nun keine Grenzen mehr gesetzt.