Im Zuge der allgemeinen Aktualisierung all unserer Funktionen zur Fernerfassung von Daten und kurz vor der Einführung von iMotions Online, unserer ersten vollständig browserbasierten Plattform für Human Insights, veröffentlichen wir die neueste Version unseres webkamera-basierten Eye-Tracking-Algorithmus – WebET 3.0. Zu diesem Zweck haben wir beschlossen, den Algorithmus im Rahmen der größten Validierungsstudie in der Geschichte von iMotions und zugleich der größten Validierungsstudie im Bereich des webkamera-basierten Eye-Trackings auf Herz und Nieren zu prüfen.

In diesem Artikel gehen wir auf die Ergebnisse der Validierungsstudie ein und betrachten dabei die Genauigkeit in Bezug auf demografische Merkmale, Lichtverhältnisse, Verbindungsprobleme sowie innerhalb von Interessensbereichen (AOI). Nach der Lektüre dieses Artikels sollten Leser, die sich für unseren firmeneigenen Eye-Tracking-Algorithmus für Webcams und iMotions Online interessieren, ein besseres Verständnis dafür haben, wie genau die Software arbeitet.

Hinweis zu Zitaten und Quellen.

Teile dieses Artikels sind Auszüge aus dem Validierungsbericht zum Eye-Tracking mit der Webcam, der hier zu finden ist, während andere Auszüge aus dem Whitepaper zum Eye-Tracking mit der Webcam stammen, das hier heruntergeladen werden kann.

Was ist webkamera-basiertes Eye-Tracking?

Das webcam-basierte Eye-Tracking nutzt eine handelsübliche Webcam, um Augenbewegungen und Blickmuster zu erfassen und zu analysieren. Durch den Einsatz von Algorithmen der Bildverarbeitung bietet es einen kostengünstigen und leicht zugänglichen Ansatz für das Eye-Tracking und findet Anwendung in den Bereichen Neurowissenschaften, Forschung, Gaming und Mensch-Computer-Interaktion, ohne dass spezielle Hardware erforderlich ist.

Warum sollten wir Algorithmen immer validieren?

Wir haben uns dazu entschlossen, die größte und demografisch vielfältigste Validierungsstudie in der Geschichte von iMotions durchzuführen, da die Validierung von Algorithmen von entscheidender Bedeutung ist, um deren Zuverlässigkeit, Wirksamkeit und ethische Anwendung sicherzustellen.

Diese Studien spielen eine entscheidende Rolle bei der Bewertung der Leistungsfähigkeit des Algorithmus, der Aufdeckung etwaiger Verzerrungen oder Mängel sowie der Validierung seiner beabsichtigten Funktionalität. Indem wir Algorithmen strengen Validierungsprozessen unterziehen, können wir ihre Genauigkeit, Robustheit und Generalisierbarkeit über verschiedene Datensätze und Szenarien hinweg bewerten.

Darüber hinaus tragen Validierungsstudien dazu bei, unbeabsichtigte Folgen wie algorithmische Verzerrungen oder diskriminierende Ergebnisse aufzudecken, sodass wir diese Probleme angehen und beheben können. Letztendlich stärken Validierungsstudien das Vertrauen in algorithmische Systeme, erhöhen die Transparenz und fördern einen verantwortungsvollen Einsatz, wodurch das Vertrauen der Nutzer und Interessengruppen gestärkt und potenzielle Risiken sowie negative Auswirkungen minimiert werden.

Ein weiterer wichtiger Grund für die Validierung von Algorithmen, insbesondere solcher, die für die Datenerhebung entwickelt wurden, besteht darin, dass sie neue Erkenntnisse zu den Ergebnissen des Whitepapers liefern könnte. Während ein Whitepaper detailliert bewertet, welche Faktoren in diesem Fall das webkamera-basierte Eye-Tracking beeinflussen können, gibt eine groß angelegte Studie, wie beispielsweise eine Validierungsstudie, Aufschluss darüber, wie eine repräsentative Stichprobe für Forscher aussehen würde und welche der im Whitepaper isolierten Faktoren in einer großen Stichprobe an Bedeutung verlieren und welche sich eher verstärken.

Methodik, Datenerhebung und Ergebnisse

Wir haben uns zum Ziel gesetzt, fünf Fragen zu beantworten, von denen wir wissen, dass sie für unsere weltweite Nutzergemeinschaft von entscheidender Bedeutung sind, und zu erörtern, welchen Nutzen sie aus der Nutzung unserer webkamera-basierten Eye-Tracking-Funktion ziehen können. In diesem Abschnitt werfen wir einen Blick darauf, wie wir die Studie angegangen sind, wie wir unsere Daten erhoben haben und welche Erkenntnisse wir aus den gesammelten Daten gewonnen haben.

Ziel der Studie und Methodik

Es gab mehrere Gründe, warum wir unbedingt die größtmögliche Validierungsstudie durchführen wollten. Am wichtigsten war natürlich, die Genauigkeit des Eye-Tracking per Webcam zu überprüfen, aber es ging um mehr als nur das.

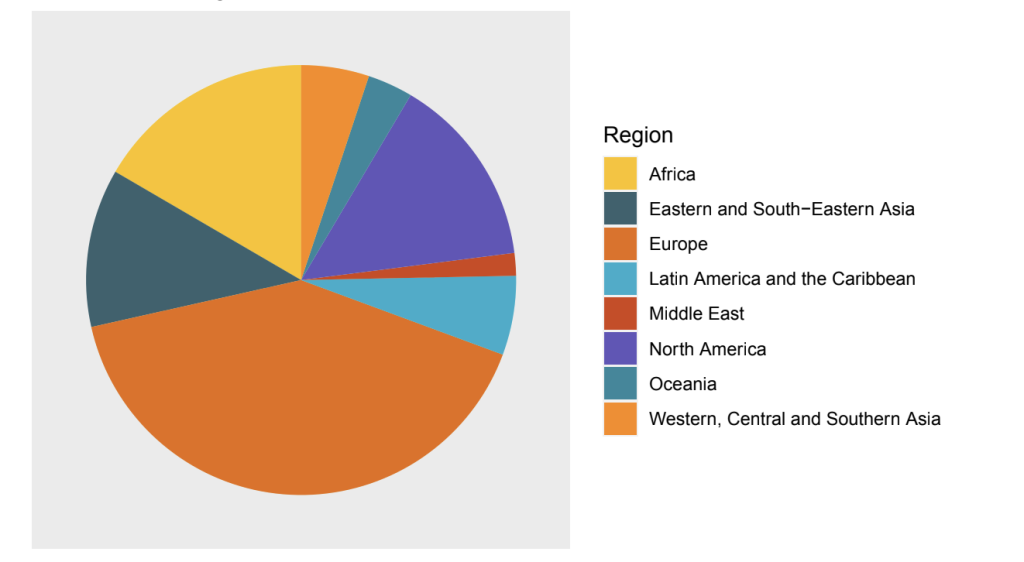

Wir wollten sicherstellen, dass wir einen Algorithmus und damit eine Plattform auf den Markt bringen, die weltweit ohne algorithmische Verzerrungen genutzt werden kann – eine häufige Falle, insbesondere bei menschenzentrierten Methoden. Deshalb haben wir unseren Algorithmus an einer wirklich globalen und repräsentativen Teilnehmergruppe validiert, die sich hinsichtlich ethnischer Zugehörigkeit, Geschlecht, Alter und anderer Faktoren wie Brillenträgern sowie dem Vorhandensein von Gesichtsbehaarung unterschied – all dies sind Faktoren, die bei vielen webbasierten Eye-Tracking-Algorithmen zu Störungen im Datenerfassungsprozess führen können.

Der Prozess der Fernerfassung von Daten

Als wir die Studie nach einer Gesamtlaufzeit von 35 Tagen beendeten, hatten wir Daten von 255 Teilnehmern gesammelt. Um den Prozess nachzuahmen, den die Mehrheit unserer Kunden bekanntermaßen zur Online-Rekrutierung von Teilnehmern nutzt, haben wir Daten über unsere eigenen externen Mailinglisten, geografisch gezielte E-Mails sowie über den kostenpflichtigen Panel-Anbieter Prolific erhoben.

Der eigentliche Prozess, Menschen zur Teilnahme an der Studie zu bewegen, lieferte uns einige interessante Erkenntnisse über die Datenerhebung, die für diejenigen aufschlussreich sein könnten, die eine Datenerhebung aus der Ferne planen. Zunächst einmal haben wir festgestellt, dass, wenn man sich auf die Bereitschaft der Teilnehmer verlässt, an der Studie teilzunehmen, ein Großteil der Teilnehmer die Studie abbricht, bevor sie abgeschlossen ist.

Wir haben die erste Runde der Einladungen zur Studie über unseren monatlichen Newsletter verschickt, wobei das Verhältnis der Studienabbrecher zu den Teilnehmern 2:1 zugunsten der Abbrecher ausfiel. Danach haben wir versucht, bestimmte Bevölkerungsgruppen in Asien und Zentralasien per E-Mail gezielt anzusprechen, was zwar zu besseren Ergebnissen führte – dennoch war die Abbruchquote weiterhin hoch. Schließlich haben wir uns für den kostenpflichtigen Panel-Anbieter Prolific entschieden, wodurch wir unser Ziel einer weltweiten Repräsentativität über alle Bevölkerungsgruppen hinweg erreichen konnten.

Das Ergebnis dieses Prozesses war für uns an sich nichts Neues. Rückmeldungen von Kunden deuteten darauf hin, dass Studienabbrüche und die damit verbundene Notwendigkeit einer Überrekrutierung eine unvermeidliche Tatsache bei der Fernerhebung von Daten sind, die man akzeptieren und auf die man sich einstellen muss. Überraschend war jedoch, dass die Abbruchquote so hoch war.

Wir waren davon ausgegangen, dass die Personen, die sich für unseren Newsletter angemeldet hatten, aus Interesse an diesem Thema auch bereit wären, an der Studie teilzunehmen. In Wahrheit haben die Teilnehmer jedoch keinen Anreiz, dranzubleiben, wenn sie die Studie nicht als lohnenswert empfinden oder in irgendeiner Form dafür belohnt werden – weshalb wir alle benötigten Daten erhielten, sobald die Teilnehmer eine Vergütung erhielten.

Ergebnisse der Validierungsstudie

In diesem Abschnitt gehen wir auf die Ergebnisse unserer oben erwähnten Validierungsstudie ein. In diesem Artikel werden nur die wichtigsten Ergebnisse vorgestellt. Wenn Sie den vollständigen Bericht einsehen möchten, können Sie ihn hier herunterladen.

Frage 1 – Wie sieht die Genauigkeitsverteilung eines mit WebET 3.0 erfassten Datensatzes aus?

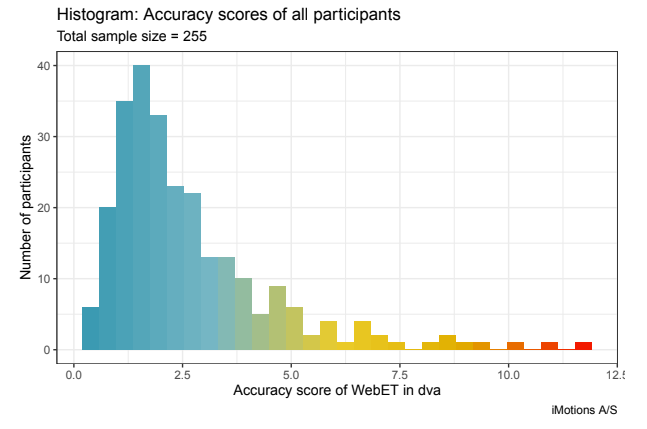

Wie bereits erwähnt, geht es bei der Validierung von Eye-Tracking-Daten vorwiegend, wenn nicht sogar ausschließlich, um die Genauigkeit. Im Interesse der Genauigkeitsvalidierung haben wir uns für einen festen Grenzwert von 5,5 Grad Genauigkeit (DVA) als Obergrenze für akzeptable Daten entschieden. Alles unter 5,5 DVA wurde als „genaue Daten“ eingestuft. Dies ist unsere allgemeine Empfehlung an alle Kunden von Webcam-Eye-Tracking-Lösungen auf der Grundlage unseres Whitepapers, da wir davon ausgehen, dass die große Mehrheit der Teilnehmer deutlich unter diesem Grenzwert liegen wird.

Warum ist ein niedriger DVA-Wert beim Eye-Tracking wichtig?

Im Bereich des Eye-Trackings wird die Genauigkeit in „DVA“ gemessen, was für „Degrees of Visual Angle“ steht. Dieser Begriff bezieht sich auf den Winkelabstand zwischen zwei Punkten im Gesichtsfeld. Wenn wir im Eye-Tracking von einem niedrigen DVA-Wert sprechen, bedeutet dies, dass das Eye-Tracking-System die Blickrichtung selbst bei kleinen Augenbewegungen mit hoher Genauigkeit bestimmen kann. Man schaut auf einem Bildschirm immer nur auf eine Stelle, und es ist Aufgabe des Eye-Trackers, zu bestimmen, wo diese liegt. Je kleiner also der Bereich ist, in dem er dies tun kann, desto besser – und das ist das Zeichen für einen präzisen Eye-Tracker.

Von den 255 erfassten Teilnehmern lagen 235 (92 %) unter dem Schwellenwert von 5,5 DVA. Noch besser: 70 % (179 Teilnehmer) lagen unter 3,0 DVA. Diese Genauigkeit ist sehr zufriedenstellend und etabliert die Webcam-Eye-Tracking-Fähigkeiten von iMotions eindeutig als branchenweit führend.

Anmerkungen zu Genauigkeitskennzahlen.

Zwar ist das Gebiet des Eye-Trackings seit langem etabliert und hat sich über mehr als hundert Jahre hinweg weiterentwickelt, doch ist zu beachten, dass das Gebiet des webkamera-basierten Eye-Trackings noch sehr jung ist. Das bedeutet, dass sich die Unternehmen, die die verschiedenen Softwareangebote entwickeln, bislang noch nicht auf einheitliche Messgrößen geeinigt haben. Dies führt wiederum dazu, dass es große Unterschiede bei der Darstellung der Genauigkeit gibt, was zu erheblicher Verwirrung führen kann, wenn man herausfinden möchte, welche Lösung den eigenen individuellen Anforderungen am besten entspricht.

Wir bei iMotions verfügen über fundierte Erfahrungen im Bereich des „klassischen“ Eye-Trackings (bildschirmbasiert und mit Brille), weshalb wir uns bewusst dafür entschieden haben, die allgemein anerkannte Genauigkeitskennzahl „Sehwinkelgrade“ (DVA) als Maßstab für die Genauigkeit beizubehalten.

Dies bringt jedoch eine Reihe von Überlegungen mit sich. Wenn Sie Online-Umfragen versenden, haben Sie keine Möglichkeit zu kontrollieren, ob Ihre Teilnehmer die Anweisungen in der Umfrageanleitung befolgen. Es gibt keine Möglichkeit, den Abstand eines Teilnehmers zum Bildschirm zu erfassen. Das bedeutet, dass Sie, um Daten erfolgreich zu erheben, eine Annahme über diesen Abstand treffen müssen, die für die meisten Szenarien zutrifft. Dies führt unweigerlich zu einigen unbekannten Abweichungen. Aus diesem Grund berichtet diese Validierungsstudie auch über mehrere Blickwinkel, sodass Sie eine fundierte Entscheidung treffen können.

Frage 2 – Haben individuelle und demografische Variablen Einfluss auf die Genauigkeit?

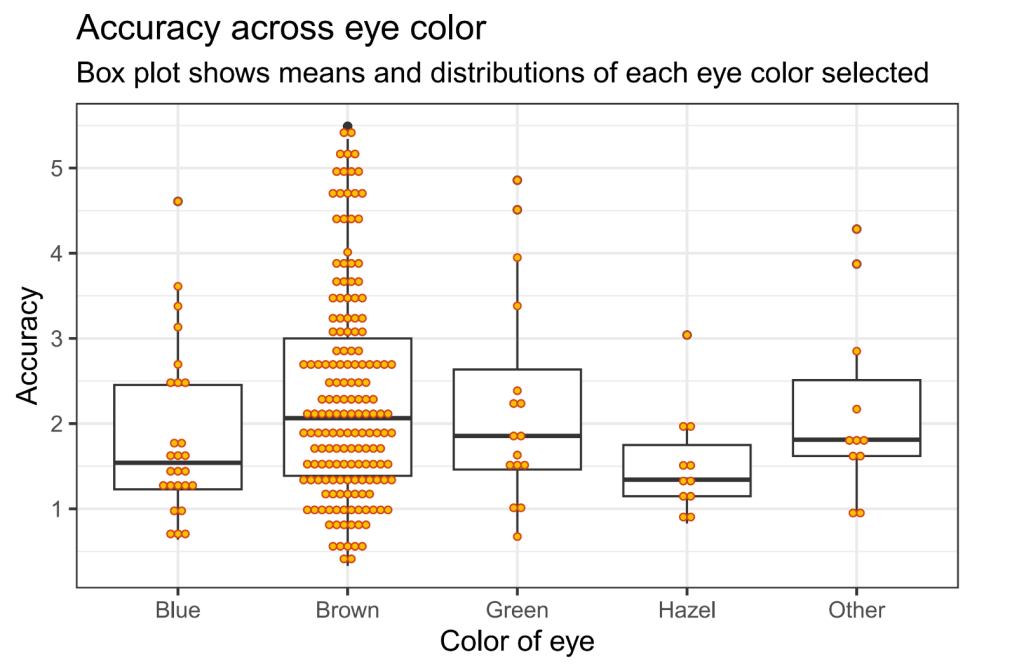

Ein weiterer zentraler Bestandteil der Validierungsstudie bestand darin, zu ermitteln, ob die Genauigkeit des Algorithmus bei einer Reihe zentraler demografischer Variablen gleichermaßen gültig war. Dazu gehörten Variablen wie ethnische Zugehörigkeit, Geschlecht, Alter, Augenfarbe sowie die Frage, ob die Teilnehmer Bart trugen oder eine Brille trugen.

Eine hohe Genauigkeit bei all diesen Parametern ist entscheidend, da sie darüber entscheidet, ob der webkamera-basierte Eye-Tracking-Algorithmus weltweit eingesetzt werden kann – unabhängig von Hautfarbe, Augenfarbe, Alter und Geschlecht. Die Parameter sind zudem von entscheidender Bedeutung für unsere Nutzer, die häufig in Umgebungen arbeiten, in denen bei den Teilnehmergruppen stets mehrere der oben genannten Variablen eine Rolle spielen.

Als wir die Datenanalyse abgeschlossen hatten, wurde uns klar, dass unser Algorithmus seine Genauigkeit über demografische Variablen hinweg tatsächlich beibehält. Kurz gesagt: Bei einer Studie mit größeren Stichproben wie der vorliegenden gab es keine signifikanten Unterschiede aufgrund der von den Teilnehmern selbst angegebenen ethnischen Zugehörigkeit, der Augenfarbe, der Angabe, ob sie Bartwuchs haben oder nicht, sowie ihres Geschlechts oder Alters.

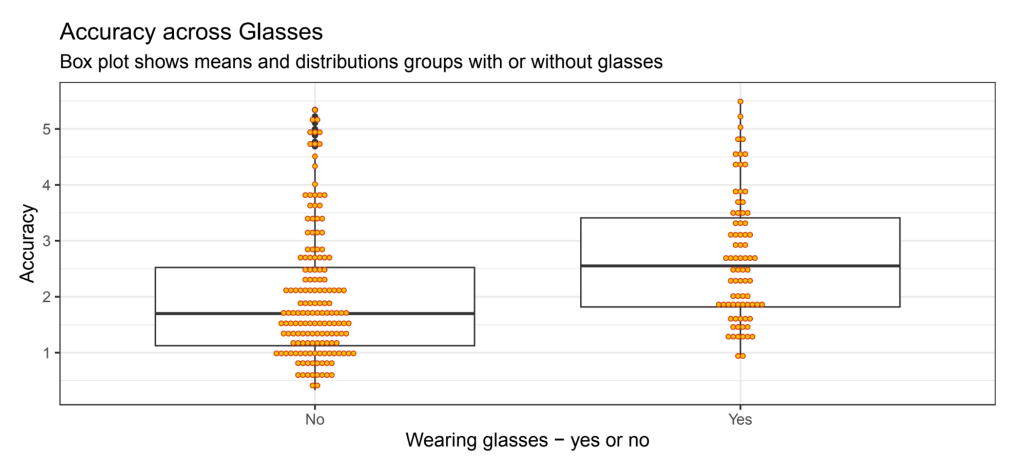

Der einzige Faktor, der die Genauigkeit der Untersuchung beeinflusste, war, ob die Teilnehmer eine Brille trugen. Dies könnte daran liegen, dass die Dicke der Brille oder die Art und Weise, wie sie das Licht aus der Umgebung und vom Bildschirm während der Datenerfassung reflektierte, die genaue Erkennung der Iris beeinträchtigte. Ob die Teilnehmer eine Brille tragen oder nicht, ist daher ein Faktor, den Sie bei der Durchführung von webkamerabasiertem Eye-Tracking berücksichtigen sollten.

Frage 3 – Inwieweit beeinflusst die Beleuchtung die Genauigkeit?

Einer der Schwachpunkte der Datenerhebung aus der Ferne besteht darin, dass man die unmittelbare Umgebung eines Teilnehmers nicht so kontrollieren kann, wie dies in einer kontrollierten Laborumgebung möglich wäre. Alle Studien, die über iMotions Online versendet werden – in das WebET 3.0 integriert ist –, enthalten Anweisungen vor Beginn der Studie dazu, wie man sitzen, den Computer ausrichten und die Beleuchtung des Raums, in dem der Teilnehmer sitzt, regulieren soll.

Auch wenn die Anweisungen vollständig, prägnant und leicht verständlich sind, lässt sich eine online durchgeführte Studie in Wahrheit nicht perfekt kontrollieren oder wiederholen, und Sie müssen höchstwahrscheinlich mit den vorliegenden Ergebnissen arbeiten. Im schlimmsten Fall müssen Sie die Daten möglicherweise komplett löschen, wenn Ihr Teilnehmer sich entschieden hat, die Studie unter suboptimalen Bedingungen durchzuführen.

Uns war es wichtig zu prüfen, ob unser Algorithmus in der Lage ist, einen Teil der Unsicherheit zu beseitigen, mit der Forscher und Datenerheber bei der Erstellung und Verteilung von Online-Umfragen an die Teilnehmer konfrontiert sind. Die Analyse zeigt, dass es keine signifikanten Unterschiede in der Genauigkeit zwischen Teilnehmern gab, die sich nach eigenen Angaben unter unterschiedlichen Lichtverhältnissen befanden.

Es ist wichtig zu beachten, dass dies nicht bedeutet, dass „die Beleuchtung keine Rolle spielt“. Die Daten, die wir zu Beleuchtung und Raumbedingungen erhoben haben, basieren ausschließlich auf Selbstauskünften. Das bedeutet, dass wir nur aus zweiter Hand über die tatsächlichen Lichtverhältnisse Bescheid wissen. Zudem gab nur ein Teilnehmer an, sich während der Studie im Freien aufgehalten zu haben – diese Daten wurden daraufhin aus der Auswertung ausgeschlossen, sodass wir nicht sagen können, ob sich die Lichtverhältnisse in Innenräumen im Vergleich zu denen im Freien auf die Genauigkeit der Eye-Tracking-Messung auswirken.

Frage 4 – Wie verändert sich die Genauigkeit im Laufe der Zeit?

Ein weiterer Unsicherheitsfaktor bei der Online-Datenerhebung ist der eigentliche Ablauf der Studie für die Teilnehmer, der durch Verzögerungen beeinträchtigt werden kann. Damit meinen wir alle technischen Gründe, aus denen die Studie länger dauern kann, als vom Forscher beabsichtigt. Wir haben eine Aufgabe konzipiert, die weniger als 10 Minuten dauert und aus Umfragen, GIFs, Bildern und Videos besteht. Die Dauer der Studie sowie die Kombination der Stimuli entsprechen dem, was die meisten Kunden von iMotions derzeit nutzen.

Bei der Auswertung unserer Daten scheint die festgestellte Verzögerung auf Internetprobleme auf Seiten der Teilnehmer zurückzuführen zu sein. Dies gilt insbesondere für Teilnehmer, die mehr als 25 Sekunden benötigten, um sich ein 12- oder 19-sekündiges Video anzusehen – also 5 Sekunden länger als vorgesehen. Zwar hatten einige Teilnehmer tatsächlich mit Internetverzögerungen zu kämpfen, doch hatten diese Probleme keinen wesentlichen Einfluss auf die Genauigkeit der Studie.

Zwar sind bei der Durchführung globaler Studien Verzögerungen zu erwarten, doch ist es wichtig, den menschlichen Faktor im Auge zu behalten. Probleme jeglicher Art bergen das Risiko, das Studienerlebnis zu beeinträchtigen, und können die Compliance der Teilnehmer verringern sowie zu Unruhe, Ortswechseln oder dem Abbruch der Studie führen.

Frage 5 – Wie wirkt sich die Genauigkeit auf die Verwendung von AOIs aus?

Ein wesentlicher Bestandteil der Messgenauigkeit ist die Fähigkeit, Blickfixationen auf bestimmte Bereiche des Bildschirms zu erkennen. Um dies zu simulieren, verwendeten wir GIFs mit Katzen, die an neun Stellen in einem Raster auf dem Bildschirm positioniert waren. Wenn die einzelnen GIFs in jeder Studie auf dem Bildschirm angezeigt wurden, konnten wir so feststellen, wie genau die Blickfixation war.

Aus den Studiendaten ging hervor, dass die Anzahl der Teilnehmer, bei denen Blickfixationen festgestellt werden konnten, in der Bildmitte am höchsten war und zu den unteren Ecken des Bildschirms hin abnahm. Ebenso stieg im Verlauf der Studie der Anteil der Teilnehmer, deren Blick nicht identifiziert und daher nicht klassifiziert werden konnte.

Dies ist höchstwahrscheinlich darauf zurückzuführen, dass die Teilnahmebereitschaft der Teilnehmer im Laufe der Studie nachlässt, wenn sie das Gefühl haben, dass die Benutzererfahrung schlecht ist. Aus diesem Grund empfehlen wir, Studien so kurz wie möglich zu halten, um Studienabbrüche oder Genauigkeitsprobleme bei den fertigen Studien zu vermeiden.

Fazit

Wir sind äußerst zufrieden mit den erhobenen Daten und den Ergebnissen der Analyse. Wir haben einen Algorithmus entwickelt, der hinsichtlich der Gesamtgenauigkeit branchenweit führend ist und nicht von demografischen Variablen beeinflusst wird. Dies belegt, dass Nutzer der Funktionen zur Fernerhebung von iMotions die Plattform sicher und vertrauensvoll für Teilnehmer auf der ganzen Welt einsetzen können, ohne das Risiko einzugehen, nicht genügend repräsentative Daten zu erhalten, da sie über alle demografischen Gruppen hinweg konsistent funktioniert.