Entdecken Sie die wichtigsten Erkenntnisse aus „Facial Expression Analysis: The Complete Pocket Guide“ – einem umfassenden Nachschlagewerk, das Ihnen hilft, menschliche Emotionen anhand von Gesichtsausdrücken zu verstehen und zu deuten. Dieser Leitfaden bietet einen strukturierten Ansatz zur Analyse verschiedener Gesichtsausdrücke und vermittelt wertvolle Techniken für Fachleute aus den Bereichen Psychologie, Kommunikation und verwandten Fachgebieten. Verbessern Sie mit diesem unverzichtbaren Nachschlagewerk Ihre Fähigkeit, Emotionen zu entschlüsseln, und optimieren Sie Ihre zwischenmenschlichen Interaktionen.

Table of Contents

Emotionen sind das Wesentliche dessen, was uns zu Menschen macht. Sie beeinflussen unseren Alltag, unsere sozialen Interaktionen, unsere Aufmerksamkeit, unsere Wahrnehmung und unser Gedächtnis.

Einer der deutlichsten Indikatoren für Emotionen ist unser Gesicht. Wenn wir lachen oder weinen, zeigen wir unsere Gefühle offen, sodass andere einen Einblick in unsere Gedankenwelt erhalten, indem sie unser Gesicht anhand von Veränderungen wichtiger Gesichtszüge wie Augen, Augenbrauen, Augenlider, Nasenflügel und Lippen „lesen“.

Die computergestützte Erkennung von Gesichtsausdrücken ahmt unsere menschlichen Fähigkeiten zur Interpretation von Emotionen auf beeindruckende Weise nach, da sie unverfälschte, ungefilterte emotionale Reaktionen auf jede Art von emotional ansprechenden Inhalten erfasst. Aber wie genau funktioniert das?

Wir haben die Antworten. Dieser umfassende Leitfaden zur Analyse von Gesichtsausdrücken ist alles, was Sie brauchen, um den Dreh bei der Erkennung von Emotionen und der Erforschung emotionalen Verhaltens herauszubekommen. Jetzt ist der richtige Zeitpunkt, um loszulegen.

Hinweis: Dieser Beitrag ist ein Auszug aus unserem Taschenführer zur Mimikanalyse. Unten können Sie sich Ihr kostenloses Exemplar herunterladen und noch mehr Einblicke in die Welt der Mimikanalyse gewinnen.

ol.pretty-list li::marker { font-size:2em; font-weight:bold; color:var(–wp–preset–color–yellow); }Was sind Mimik?

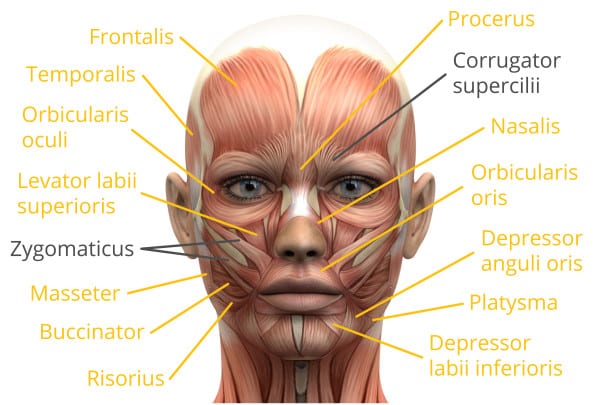

Unser Gesicht ist ein vielschichtiger, hoch differenzierter Teil unseres Körpers – tatsächlich ist es eines der komplexesten Signalsysteme, über die wir verfügen. Es umfasst über 40 strukturell und funktionell eigenständige Muskeln, von denen jeder unabhängig von den anderen angesteuert werden kann.

Das Gesichtsmuskelsystem ist der einzige Bereich unseres Körpers, in dem Muskeln entweder an einem Knochen und am Gesichtsgewebe ansetzen (andere Muskeln im menschlichen Körper verbinden sich mit zwei Knochen) oder ausschließlich am Gesichtsgewebe, wie beispielsweise die Muskeln, die die Augen oder Lippen umgeben.

Es liegt auf der Hand, dass die Aktivität der Gesichtsmuskeln in hohem Maße auf den Ausdruck ausgerichtet ist – sie ermöglicht es uns, soziale Informationen mit anderen auszutauschen und sowohl verbal als auch nonverbal zu kommunizieren.

.fact { position:relative; } .fact::before { content:’“‘; display:block; position:absolute; top:0; left:2rem; transform:translateY(-50%); padding: 1.2rem; font-size: 3.4rem; background: var(–wp–preset–color–yellow); text-shadow: 0px 0px 12px var(–wp–preset–color–secondary), 6px 6px 1px var(–wp–preset–color–secondary); color: white; height: 1.5rem; line-height: 1; font-family: georgia, serif; }Wusstest du schon?

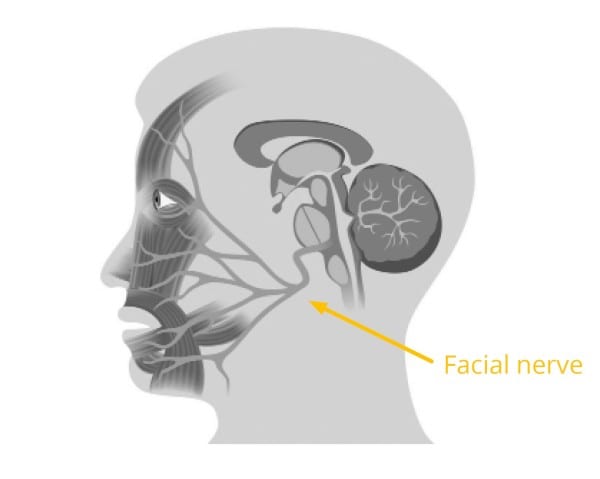

Fast alle Gesichtsmuskeln werden von einem einzigen Nerv angesteuert – dem N. facialis. Es gibt jedoch eine Ausnahme: Das obere Augenlid wird vom N. oculomotorius innerviert, der für einen Großteil der Augenbewegungen, die Pupillenkontraktion und das Anheben des Augenlids verantwortlich ist.

Der Gesichtsnerv steuert den Großteil der Gesichtsmuskeln

Alle Muskeln unseres Körpers werden von Nerven versorgt, die bis ins Rückenmark und ins Gehirn reichen. Die Nervenverbindung verläuft in beide Richtungen, was bedeutet, dass der Nerv auf der Grundlage von Signalen aus dem Gehirn Muskelkontraktionen auslöst (Gehirn-zu-Muskel), während er gleichzeitig Informationen über den aktuellen Zustand des Muskels an das Gehirn zurücksendet (Muskel-zu-Gehirn).

Was sind Mimik?

Mimik bezeichnet die Bewegungen der zahlreichen Muskeln, die vom Gesichtsnerv versorgt werden und an der Gesichtshaut ansetzen und diese bewegen.

Fast alle Gesichtsmuskeln werden von einem einzigen Nerv versorgt, der daher einfach als Gesichtsnerv bezeichnet wird.

Etwas fachsprachlicher ausgedrückt wird der Gesichtsnerv auch als „VII. Hirnnerv“ bezeichnet.

Der Gesichtsnerv entspringt tief im Hirnstamm, tritt etwas unterhalb des Ohrs aus dem Schädel aus und verzweigt sich wie ein Baum zu allen Muskeln. Interessanterweise ist der Gesichtsnerv auch mit wesentlich jüngeren motorischen Regionen in unserem Neokortex verbunden (die als „neo“ bezeichnet werden, da diese Bereiche nur im Gehirn von Säugetieren vorkommen), die in erster Linie für die zum Sprechen erforderlichen Bewegungen der Gesichtsmuskeln verantwortlich sind.

Wusstest du schon?

Wie der Name schon sagt, ist der Hirnstamm ein evolutionär sehr alter Bereich des Gehirns, den der Mensch mit fast allen lebenden Tieren gemeinsam hat.

Mimik und Emotionen

Die Hypothese der Gesichtsrückkopplung: Wie Fritz Strack und seine Kollegen 1988 auf geniale Weise entdeckten, sind Gesichtsausdrücke und Emotionen eng miteinander verflochten. In ihrer Studie wurden die Probanden gebeten, einen Stift im Mund zu halten, während sie Cartoons hinsichtlich ihres humoristischen Gehalts bewerteten. Während eine Gruppe den Stift mit geöffneten Lippen zwischen den Zähnen hielt (und so ein Lächeln nachahmte), hielt die andere Gruppe den Stift nur mit den Lippen fest (wodurch ein richtiges Lächeln verhindert wurde).

Fritz Strack kam zu folgendem Ergebnis: Die erste Gruppe bewertete den Cartoon als humorvoller. Strack und sein Team werteten dies als Beleg für die Hypothese der Gesichtsrückkopplung, die besagt, dass die selektive Aktivierung oder Hemmung der Gesichtsmuskulatur einen starken Einfluss auf die emotionale Reaktion auf Reize hat.

Emotionen, Gefühle, Stimmungen

Was genau sind Emotionen?

Im allgemeinen Sprachgebrauch versteht man unter Emotionen alle relativ kurzlebigen bewussten Erfahrungen, die durch intensive geistige Aktivität und ein hohes Maß an Freude oder Unzufriedenheit gekennzeichnet sind. In der wissenschaftlichen Forschung hat sich bislang noch keine einheitliche Definition durchgesetzt. Es gibt zweifellos begriffliche Überschneidungen zwischen den psychologischen und neurowissenschaftlichen Grundlagen von Emotionen, Stimmungen und Gefühlen.

Emotionen sind eng mit physiologischer und psychologischer Erregung verbunden, wobei bestimmte Emotionen mit unterschiedlichen Erregungsstufen einhergehen. Aus neurobiologischer Sicht lassen sich Emotionen als komplexe Handlungsprogramme definieren, die durch bestimmte externe oder interne Reize ausgelöst werden.

Diese Aktionsprogramme umfassen folgende Elemente:

- Körperliche Symptome wie erhöhte Herzfrequenz oder Hautleitfähigkeit. Meistens treten diese Symptome unbewusst und unwillkürlich auf.

- Handlungsmuster, zum Beispiel „Kampf-oder-Flucht“-Reaktionen, um entweder einer gefährlichen Situation sofort zu entkommen oder einen physischen Angriff auf den Gegner vorzubereiten.

- Mimik, zum Beispiel das Zähnezeigen und das Stirnrunzeln.

- Kognitive Bewertungen von Ereignissen, Reizen oder Objekten.

Emotionen vs. Gefühle vs. Stimmungen

Gefühle sind subjektive Wahrnehmungen der emotionalen Handlungsprogramme. Gefühle werden von bewussten Gedanken und Überlegungen gesteuert – wir können zwar durchaus Emotionen empfinden, ohne Gefühle zu haben, aber wir können einfach keine Gefühle haben, ohne Emotionen zu empfinden.

Stimmungen sind diffuse, innere, subjektive Zustände, die in der Regel weniger intensiv sind als Emotionen und deutlich länger anhalten. Stimmungen werden stark von Persönlichkeitsmerkmalen und Eigenschaften beeinflusst. Willkürliche Gesichtsausdrücke (zum Beispiel ein Lächeln) können körperliche Reaktionen hervorrufen, die denen ähneln, die durch eine tatsächliche Emotion (zum Beispiel Freude) ausgelöst werden.

Der Begriff „Affekt“ umfasst Emotionen, Gefühle und Stimmungen.

Kannst du Gefühle einordnen?

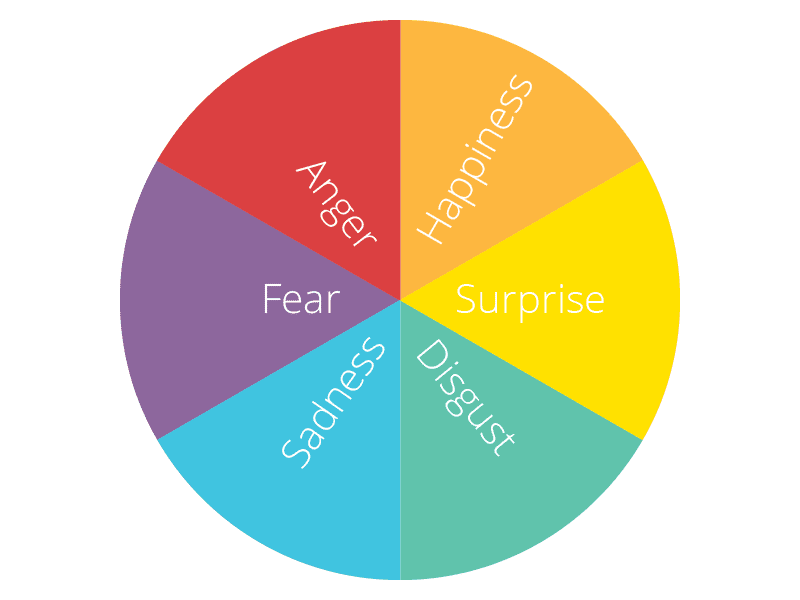

Mimik ist nur eines von vielen Anzeichen für Emotionen, aber vielleicht das offensichtlichste. Menschen sind zweifellos in der Lage, Tausende von leicht variierenden Gesichtsausdrücken zu erzeugen – dennoch gibt es nur eine kleine Anzahl charakteristischer Gesichtsausdrücke, die fast jeder mit bestimmten Emotionen in Verbindung bringt, unabhängig von Geschlecht, Alter, kulturellem Hintergrund und Sozialisationsgeschichte.

Diese grundlegenden Emotionen sind:

Die Erkenntnis, dass fast jeder die mit diesen Emotionen verbundenen Gesichtsausdrücke zeigen und erkennen kann, hat einige Forscher zu der (umstrittenen!) Annahme veranlasst, dass diese universell sind.

Sehen Sie sich unser Webinar zum Thema „Was sind Emotionen und wie messen wir sie?“ an

Verfahren zur Analyse von Gesichtsausdrücken

Mimik kann auf drei verschiedene Arten erfasst und analysiert werden:

- Durch die Erfassung der elektromyografischen Aktivität im Gesicht (fEMG)

- Durch Live-Beobachtung und manuelle Erfassung der Gesichtsaktivitäten

- Durch automatische Analyse des Gesichtsausdrucks mithilfe von Bildverarbeitungsalgorithmen

Lassen Sie uns das genauer erläutern.

Gesichts-Elektromyographie (fEMG)

Mit Hilfe der Gesichts-EMG lässt sich die Aktivität der Gesichtsmuskeln mithilfe von Elektroden, die auf der Hautoberfläche angebracht werden, erfassen. Die fEMG erfasst und verstärkt die winzigen elektrischen Impulse, die von den jeweiligen Muskelfasern bei der Kontraktion erzeugt werden. Die häufigsten fEMG-Messstellen befinden sich in der Nähe der folgenden zwei großen Muskelgruppen:

1. Rechter/linker Corrugator supercilii („Augenbrauenrunzler“):

Dies ist ein kleiner, schmaler, pyramidenförmiger Muskel in der Nähe der Augenbraue, der im Allgemeinen mit dem Stirnrunzeln in Verbindung gebracht wird. Der Corrugator zieht die Augenbraue nach unten und zur Gesichtsmitte hin, wodurch vertikale Falten auf der Stirn entstehen. Diese Muskelgruppe wird aktiviert, um die Blendung durch grelles Sonnenlicht zu vermeiden oder um negative Emotionen wie Leid auszudrücken.

2. Rechter/linker Zygomatikus (major):

Dieser Muskel verläuft von jedem Wangenknochen zu den Mundwinkeln und zieht den Mundwinkel nach oben und außen, was typischerweise mit einem Lächeln verbunden ist.

Das Facial Action Coding System (FACS)

Das Facial Action Coding System (FACS) ist ein vollständig standardisiertes Klassifizierungssystem für Gesichtsausdrücke, das sich an anatomischen Merkmalen orientiert und von erfahrenen Kodierern angewendet wird. Die Experten untersuchen Gesichtsvideos sorgfältig und beschreiben jedes Auftreten von Gesichtsausdrücken als Kombinationen aus elementaren Komponenten, den sogenannten Action Units (AUs).

Ein weit verbreiteter Irrglaube ist, dass FACS etwas mit dem Erkennen von Emotionen zu tun hat. Tatsächlich ist FACS lediglich ein Messsystem und interpretiert die Bedeutung der Gesichtsausdrücke nicht. Das ist so, als würde man sagen, der Zweck des Fahrradfahrens sei es, zur Arbeit zu fahren. Sicher, man kann mit dem Fahrrad zur Arbeit fahren, aber man kann sein Fahrrad auch für viele andere Dinge nutzen (in der Freizeit, zum Sporttraining usw.). Sie verstehen, was ich meine.

In der Analysephase ermöglicht das FACS-System jedoch eine modulare Konstruktion von Emotionen auf der Grundlage der Kombination von AUs.

Mit der Kodierung von Gesichtsaktions-Einheiten erlangen Sie das nötige Wissen, um zwischen den folgenden drei Kategorien von Gesichtsausdrücken zu unterscheiden:

- Makroausdrücke dauern in der Regel zwischen 0,5 und 4 Sekunden, treten im täglichen Umgang auf und sind meist mit bloßem Auge erkennbar.

- Mikroexpressionen dauern weniger als eine halbe Sekunde und treten auf, wenn man bewusst oder unbewusst versucht, den aktuellen emotionalen Zustand zu verbergen oder zu unterdrücken.

- Subtile Gesichtsausdrücke stehen im Zusammenhang mit der Intensität und Tiefe der zugrunde liegenden Emotion. Wir lächeln nicht ständig oder ziehen ständig die Augenbrauen hoch – die Intensität dieser Gesichtsbewegungen variiert ständig. Subtile Gesichtsausdrücke bezeichnen jeden Beginn eines Gesichtsausdrucks, bei dem die Intensität der damit verbundenen Emotion noch als gering gilt.

Aus diesen Einschränkungen heraus hat sich eine neue Generation von Technologien zur Erfassung von Gesichtsausdrücken entwickelt, die vollständig automatisiert und computergestützt sind.

Technologie zur Analyse von Gesichtsausdrücken

Auf der Grundlage bahnbrechender Forschungsergebnisse führender akademischer Einrichtungen in den Vereinigten Staaten und Europa wurden Verfahren zur automatischen Erkennung von Gesichtsausdrücken entwickelt und der breiten Öffentlichkeit zugänglich gemacht, die Gesichter sofort erkennen, Gesichtsausdrücke kodieren und emotionale Zustände erkennen.

Dieser Durchbruch wurde vor allem durch den Einsatz modernster Algorithmen für Computer Vision und maschinelles Lernen sowie durch die Erfassung hochwertiger Datenbanken mit Gesichtsausdrücken aus aller Welt ermöglicht.

Wusstest du schon?

Die automatisierte Gesichtsausdrucksanalyse hat die Bereiche der affektiven Neurowissenschaften und der Biosensorik revolutioniert und damit Emotionsanalysen und Erkenntnisse aus diesem Bereich der wissenschaftlichen Gemeinschaft, kommerziellen Anwendungen und der Öffentlichkeit zugänglich gemacht.

Diese Technologien nutzen in Laptops, Tablets und Mobiltelefonen integrierte Kameras oder an Computerbildschirmen angebrachte eigenständige Webcams, um Videos der Befragten aufzunehmen, während diese mit Inhalten verschiedener Kategorien konfrontiert werden.

Durch den Einsatz kostengünstiger Webcams entfallen spezielle High-End-Geräte, wodurch sich die automatische Ausdruckserkennung ideal für die Aufzeichnung von Gesichtsvideos in einer Vielzahl natürlicher Umgebungen eignet, wie beispielsweise in den Wohnungen der Befragten, am Arbeitsplatz, im Auto, in öffentlichen Verkehrsmitteln und vielen anderen Orten.

Sehen Sie sich unser Webinar zum Thema „Forschung aus der Ferne mit iMotions: Mimikanalyse und Verhaltenskodierung bequem von der Couch aus“ an

Welche wissenschaftlichen und technischen Verfahren stecken eigentlich in dieser magischen Blackbox?

To see how these concepts are applied in practice, explore our Behavioral Research Resources page.

Die Technologie hinter der automatischen Gesichtsausdrucksanalyse

Im Großen und Ganzen bestehen alle Systeme zur Emotionserkennung aus denselben Schritten.

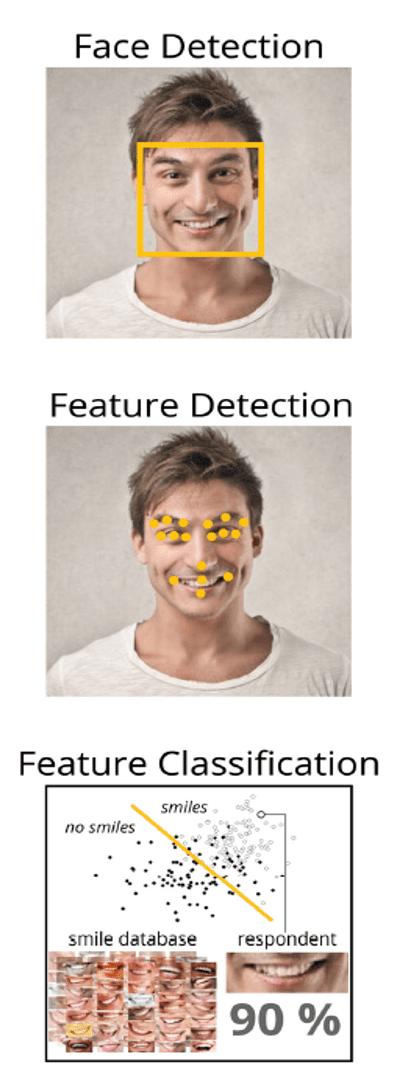

Gesichtserkennung:

Die Position eines Gesichts wird in einem Videobild oder Foto ermittelt, was beispielsweise durch die Anwendung des Viola-Jones-Cascaded-Classifier-Algorithmus erreicht werden kann. Das klingt vielleicht kompliziert, doch diese Technologie ist auch in der Kamera Ihres iPhones oder Android-Smartphones zu finden. Das Ergebnis ist ein Rahmen, der das erkannte Gesicht umgibt.

Erkennung von

Gesichtsmerkmalen: Innerhalb des erkannten Gesichts werden Gesichtsmerkmale wie Augen und Augenwinkel, Augenbrauen, Mundwinkel, Nasenspitze usw. erkannt. Anschließend werden Position, Größe und Maßstab eines internen Gesichtsmodells angepasst, um es an das tatsächliche Gesicht des Befragten anzupassen.

Man kann sich das wie ein unsichtbares virtuelles Netz vorstellen, das über das Gesicht des Befragten gelegt wird: Wann immer sich das Gesicht des Befragten bewegt oder den Gesichtsausdruck ändert, passt sich das Gesichtsmodell sofort an und folgt diesen Veränderungen. Wie der Name schon sagt, ist das Gesichtsmodell eine vereinfachte Version des tatsächlichen Gesichts des Befragten. Es weist im Vergleich zum tatsächlichen Gesicht deutlich weniger Details (sogenannte Merkmale) auf, enthält jedoch genau jene Gesichtsmerkmale, die für den Zweck erforderlich sind.

Typische Merkmale sind einzelne Orientierungspunkte (Augenbrauenecken, Mundwinkel, Nasenspitze) sowie Merkmalsgruppen (der gesamte Mund, der gesamte Augenbrauenbogen usw.), die die gesamte „Gestalt“ eines emotional aussagekräftigen Gesichtsbereichs widerspiegeln.

Merkmalsklassifizierung

Sobald das vereinfachte Gesichtsmodell vorliegt, werden die Positions- und Orientierungsdaten aller Schlüsselmerkmale in Klassifizierungsalgorithmen eingespeist, die diese Merkmale in Action-Unit-Codes, emotionale Zustände und andere affektive Kennzahlen umwandeln.

- Kopflage (Gierung, Nickwinkel, Rollwinkel)

- Augenabstand und 33 Gesichtsmarker

- 7 Grundemotionen: Valenz, Engagement, Aufmerksamkeit

- 20 Messgrößen für Gesichtsausdrücke

Hier ist ein wenig Theorie (und Analyse) dazu.

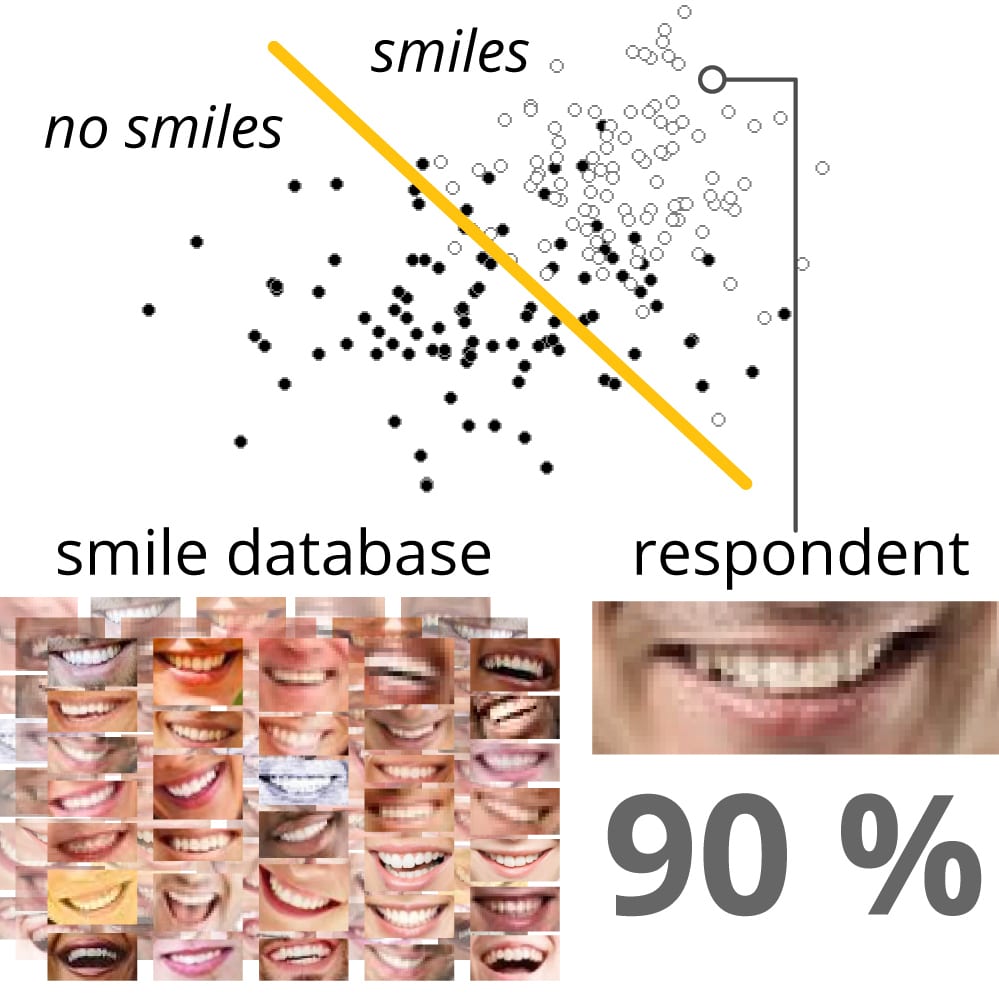

Die Umwandlung von Gesichtsmerkmalen in Messwerte erfolgt auf statistischer Basis, indem das tatsächliche Erscheinungsbild des Gesichts und die Anordnung der Merkmale numerisch mit den normativen Datenbanken verglichen werden, die von den Gesichtsausdrucks-Engines bereitgestellt werden.

Was bedeutet das? Der aktuelle Gesichtsausdruck eines Befragten wird nicht einzeln mit allen Hunderttausenden von Bildern in der Datenbank abgeglichen – das wäre ziemlich mühsam und würde ewig dauern. Stattdessen enthalten die Datenbanken statistische Werte und normative Verteilungen aller Merkmalscharakteristika über alle Befragten hinweg, die aus verschiedenen geografischen Regionen stammen und unterschiedliche demografische Profile aufweisen, sowie über verschiedene Reizkategorien und Aufnahmebedingungen.

Jede Engine zur Analyse von Gesichtsausdrücken nutzt eine andere Datenbank. Dies ist einer der Gründe, warum Sie leicht abweichende Ergebnisse erhalten können, wenn Sie genau dasselbe Ausgangsmaterial in verschiedene Engines eingeben.

Die Klassifizierung erfolgt auf rein statistischer Ebene. Hier ein Beispiel: Sind die Mundwinkel des Befragten nach oben gezogen, würde ein menschlicher Kodierer dies als Aktivität von AU12 („Lip Corner Puller“) kodieren – was bedeutet, dass der Befragte lächelt. Die Gesichtsausdrucks-Engine muss hingegen den vertikalen Abstand zwischen den Mundwinkeln und der Mundmitte berechnen und gibt einen Wert von 10 mm zurück. Dieser Wert wird mit allen möglichen Werten in der Datenbank verglichen (zum Beispiel Werte zwischen 0 mm und 20 mm).

In unserem Beispiel liegt der Gesichtsausdruck des Befragten offenbar genau in der Mitte der „Lächeln“-Verteilung (0 < 10 < 20 mm). Für den Motor lässt sich mit Sicherheit sagen, dass der aktuelle Gesichtsausdruck stärker ist als ein leichtes Lächeln, jedoch nicht so stark wie ein breites Lächeln.

Im Idealfall gibt der Klassifikator für jede Emotion, AU oder Metrik entweder „Ja“ oder „Nein“ zurück. Leider ist es nicht ganz so einfach. Schauen wir uns noch einmal den „Smile“-Klassifikator an:

Die gefüllten Punkte (eher links) stehen für alle Mundkonfigurationen in der Datenbank, die nicht als Lächeln klassifiziert sind, während die weißen Punkte (eher rechts) Mundkonfigurationen darstellen, die als Lächeln angesehen werden.

Die orangefarbene Linie kennzeichnet das Klassifizierungskriterium.

Alles links von der Linie wird als „kein Lächeln“ klassifiziert, während alles rechts davon als „Lächeln“ klassifiziert wird.

Es gibt offensichtlich eine diffuse Übergangszone zwischen Nicht-Lächeln und Lächeln, in der manche Mundkonfigurationen falsch klassifiziert werden – dabei kann es sich um subtile Lächeln handeln, die unbemerkt bleiben, oder um andere Mundöffnungen, die eher Gähnen als Lächeln sind. Folglich kann der Klassifikator nur ein probabilistisches Ergebnis liefern, das die Wahrscheinlichkeit widerspiegelt, dass es sich bei dem Gesichtsausdruck um ein echtes „Lächeln“ handelt.

In unserem Beispiel ist das Lächeln der befragten Person recht deutlich zu erkennen und liegt ganz rechts im „Merkmalsraum“. Hier ist der Klassifikator sich des Ergebnisses „Lächeln“ sehr sicher und gibt eine solide Trefferquote von 90 % an. In anderen Fällen ist der Klassifikator möglicherweise weniger sicher in seiner Einschätzung.

Die Merkmalsklassifizierung erfolgt für jede Emotion, jede Aktions-Einheit und jedes Schlüsselmerkmal unabhängig voneinander – der Klassifikator für Lächeln weiß nichts über den Klassifikator für Stirnrunzeln; sie werden einfach unabhängig voneinander kodiert. Der Vorteil dabei ist, dass die automatische Kodierung wesentlich objektiver erfolgt als die manuelle Kodierung, bei der Menschen – insbesondere unerfahrene Kodierer – dazu neigen, die Aktivierung einer Aktions-Einheit im Zusammenhang mit anderen Aktions-Einheiten zu interpretieren, was die Ergebnisse erheblich verfälscht.

Bevor wir uns eingehender mit der Visualisierung und Analyse der Ergebnisse der Gesichtsklassifizierung befassen, werfen wir einen kurzen Blick auf einige Richtlinien und Empfehlungen zur Erfassung erstklassiger Daten.

Bevor wir uns eingehender mit der Visualisierung und Analyse der Ergebnisse der Gesichtsklassifizierung befassen, werfen wir einen kurzen Blick auf einige Richtlinien und Empfehlungen zur Erfassung erstklassiger Daten. Wenn Sie genauer erfahren möchten, wie diese Klassifizierungsergebnisse in verwertbare Erkenntnisse umgesetzt werden, lesen Sie unseren speziellen Artikel zum Thema Gesichtsanalyse.

Ausstattung

Kommen wir zur Sache.

Was sollten Sie bei der Erhebung hochwertiger Daten beachten, welche Stimuli sind optimal und worauf müssen Sie bei der Rekrutierung und Einweisung der Befragten achten? Wir helfen Ihnen gerne weiter.

- Zunächst einmal lässt sich die automatische Erkennung von Gesichtsausdrücken online durchführen, d. h. während die Probanden emotionalen Reizen ausgesetzt sind und ihre Gesichtsausdrücke beobachtet (und/oder aufgezeichnet) werden.

- Neben der Online-Datenerfassung lässt sich die Erkennung von Gesichtsausdrücken auch offline einsetzen, beispielsweise zur Auswertung bereits aufgezeichneter Gesichtsbilder. Sie können sogar ein größeres Publikum aufzeichnen und mit minimalem Bearbeitungsaufwand die Gesichtsausdrücke jedes einzelnen Teilnehmers analysieren.

Beachten Sie bei der automatischen Gesichtsanalyse über Webcams bitte die folgenden Kameraspezifikationen:

- Objektiv: Verwenden Sie ein Standardobjektiv; vermeiden Sie Weitwinkel- oder Fischaugenobjektive, da diese das Bild verzerren und zu Fehlern bei der Verarbeitung führen können.

- Auflösung: Die Mindestauflösung variiert je nach Software zur Gesichtsausdrucksanalyse. Sie benötigen keineswegs HD- oder 4K-Kameraauflösungen – die automatisierte Gesichtsausdrucksanalyse funktioniert bereits bei niedrigen Auflösungen, solange das Gesicht der befragten Person deutlich zu erkennen ist.

- Autofokus: Sie sollten auf jeden Fall eine Kamera verwenden, die die Gesichter der Befragten innerhalb eines bestimmten Entfernungsbereichs verfolgen kann. Einige Kameramodelle bieten zusätzliche softwaregestützte Verfolgungsfunktionen, um sicherzustellen, dass Ihre Befragten nicht unscharf werden.

- Blende, Belichtung und Weißabgleich: Im Allgemeinen können sich die meisten Kameras automatisch an die Lichtverhältnisse anpassen. Bei Gegenlicht verringert die Verstärkungsregelung bei vielen Kameras jedoch den Bildkontrast im Vordergrund, was zu einer Verschlechterung der Bildqualität führen kann.

Wusstest du schon?

Manche Kameras passen die Bildrate je nach Lichtverhältnissen dynamisch an (sie reduzieren beispielsweise die Bildrate, um schlechte Lichtverhältnisse auszugleichen), sodass Sie eine Videodatei mit variabler Bildrate erhalten. Dies ist sicherlich nicht ideal, da Sie dadurch eine schwankende Bildrate pro Sekunde erhalten, was den Vergleich und die Zusammenfassung der Ergebnisse über die Befragten hinweg erschwert.

Ein Hinweis zu Webcams: Wir empfehlen die Verwendung einer beliebigen HD-Webcam. Selbstverständlich können Sie die automatische Gesichtsausdrucksanalyse auch mit jeder anderen Kamera durchführen, einschließlich Smartphone-Kameras, IP-Kameras oder integrierten Laptop-Webcams (abhängig von Ihrer Anwendung). Beachten Sie jedoch, dass diese Kameras in der Regel nur über begrenzte Funktionen für Autofokus, Helligkeit und Weißabgleich verfügen.

Lesen Sie hier: Wie die Analyse von Gesichtsausdrücken aus der Ferne durchgeführt werden kann

Gesichtsausdrucksanalyse (FEA): Anwendungsbereiche

Mithilfe der Gesichtserkennung können Sie die Wirkung beliebiger Inhalte, Produkte oder Dienstleistungen testen, die emotionale Erregung und Gesichtsreaktionen hervorrufen sollen – seien es physische Objekte wie Lebensmittelproben oder Verpackungen, Videos und Bilder, Geräusche, Gerüche, taktile Reize usw. Insbesondere unwillkürliche Gesichtsausdrücke sowie eine subtile Erweiterung der Augenlider sind von zentralem Interesse, da sie als Ausdruck von Veränderungen des emotionalen Zustands gelten, die durch tatsächliche äußere Reize oder mentale Bilder ausgelöst werden.

In welchen Bereichen der kommerziellen und akademischen Forschung werden Techniken zur Emotionserkennung in letzter Zeit eingesetzt? Hier ein Überblick über die wichtigsten Forschungsbereiche:

1. Konsumenten-Neurowissenschaft und Neuromarketing

Es besteht kein Zweifel: Die Auswertung von Verbraucherpräferenzen und eine überzeugende Kommunikation sind entscheidende Faktoren im Marketing. Selbstauskünfte und Fragebögen mögen zwar ideale Instrumente sein, um Einblicke in die Einstellungen und das Bewusstsein der Befragten zu gewinnen, doch sind sie möglicherweise nur begrenzt geeignet, emotionale Reaktionen zu erfassen, die nicht durch Selbstwahrnehmung und soziale Erwünschtheit verzerrt sind.

Hier kommt der Nutzen der Emotionsanalyse ins Spiel: Die Erfassung von Gesichtsausdrücken kann genutzt werden, um Selbstauskünfte durch quantifizierte Messwerte unbewusster emotionaler Reaktionen auf ein Produkt oder eine Dienstleistung erheblich zu ergänzen. Auf der Grundlage der Gesichtsausdrucksanalyse lassen sich Produkte optimieren, Marktsegmente bewerten sowie Zielgruppen und Personas identifizieren. Die Gesichtsausdrucksanalyse kann viel dazu beitragen, Ihre Marketingstrategie zu verbessern – denken Sie einfach mal darüber nach!

2. Medientests und Werbung

In der Medienforschung können einzelne Befragte oder Fokusgruppen Fernsehwerbung, Trailern und Pilotfolgen in voller Länge ausgesetzt werden, während ihre Mimik beobachtet wird. Es ist ebenso wichtig, Szenen zu identifizieren, in denen emotionale Reaktionen (insbesondere Lächeln) erwartet wurden, das Publikum diese aber einfach nicht „verstanden“ hat, wie die Schlüsselbilder zu finden, die zu den extremsten Gesichtsausdrücken führen.

In diesem Zusammenhang könnte es sinnvoll sein, Szenen herauszufiltern und zu optimieren, die unerwünschte negative Reaktionen auslösen, die auf ein erhöhtes Maß an Ekel, Frustration oder Verwirrung hindeuten (solche Emotionen würden einer Comedy-Show wohl kaum dabei helfen, zur Erfolgsserie zu werden, oder?), oder die Reaktionen des Publikums auf eine Vorführung zu nutzen, um den Anteil positiver Reaktionen in der endgültigen Fassung zu erhöhen.

3. Psychologische Forschung

Psychologen analysieren Gesichtsausdrücke, um festzustellen, wie Menschen emotional auf äußere und innere Reize reagieren. In systematischen Studien können Forscher die Eigenschaften der Reize (Farbe, Form, Darstellungsdauer) sowie soziale Erwartungen gezielt variieren, um zu untersuchen, wie sich Persönlichkeitsmerkmale und individuelle Lernerfahrungen auf Gesichtsausdrücke auswirken.

4. Klinische Psychologie und Psychotherapie

Klinische Patientengruppen wie Menschen mit Autismus-Spektrum-Störungen (ASD), Depressionen oder Borderline-Persönlichkeitsstörungen (BPD) zeichnen sich durch erhebliche Beeinträchtigungen bei der Steuerung, Verarbeitung und Interpretation ihrer eigenen sowie der Gesichtsausdrücke anderer aus. Die Beobachtung von Gesichtsausdrücken, während Patienten emotional anregenden Reizen oder sozialen Hinweisen (z. B. Gesichtern anderer) ausgesetzt sind, kann den Erfolg der zugrunde liegenden kognitiven Verhaltenstherapie sowohl während der Diagnose- als auch der Interventionsphase erheblich steigern. Ein hervorragendes Beispiel hierfür ist das „Smile Maze“, das vom Temporal Dynamics of Learning Center (TDLC) an der UC San Diego entwickelt wurde. Hier trainieren autistische Kinder ihre Gesichtsausdrücke, indem sie ein Pacman-ähnliches Spiel spielen, bei dem ein Lächeln die Spielfigur steuert.

5. Medizinische Anwendungen und plastische Chirurgie

Die Folgen einer Gesichtslähmung können verheerend sein. Zu den Ursachen zählen die Bell-Lähmung, Tumore, Traumata, Erkrankungen und Infektionen. Die Patienten haben in der Regel mit erheblichen Veränderungen ihres äußeren Erscheinungsbildes, ihrer Kommunikationsfähigkeit und ihrer Fähigkeit, Emotionen auszudrücken, zu kämpfen. Mithilfe der Mimikanalyse lassen sich die Beeinträchtigungen quantifizieren und der Erfolg chirurgischer Eingriffe sowie von Ergotherapie und Physiotherapie beurteilen, die auf die Reaktivierung der gelähmten Muskelgruppen abzielen.

6. Software-Benutzeroberfläche und Webdesign

Im Idealfall sollten die Bedienung von Software und die Navigation auf Websites eine angenehme Erfahrung sein – Frustration und Verwirrung sollten auf jeden Fall so gering wie möglich gehalten werden. Die Beobachtung der Mimik, während Tester Websites oder Software-Dialogfelder durchsehen, kann Aufschluss über die emotionale Zufriedenheit der gewünschten Zielgruppe geben. Immer wenn Nutzer auf Hindernisse stoßen oder sich in komplexen Untermenüs verirren, lassen sich mit Sicherheit vermehrt „negative“ Gesichtsausdrücke wie Stirnrunzeln oder ein finsterer Blick beobachten.

7. Entwicklung künstlicher sozialer Akteure (Avatare)

Bis vor kurzem waren Roboter und Avatare so programmiert, dass sie auf Benutzerbefehle reagierten, die über Tastatur und Maus eingegeben wurden. Neueste Durchbrüche in den Bereichen Hardwaretechnologie, Computer Vision und maschinelles Lernen haben den Grundstein für künstliche soziale Agenten gelegt, die in der Lage sind, emotionale Zustände des menschlichen Kommunikationspartners zuverlässig zu erkennen und flexibel darauf zu reagieren. Apples Siri mag die erste Generation emotional wirklich intelligenter Maschinen sein, doch Informatiker, Ärzte und Neurowissenschaftler auf der ganzen Welt arbeiten intensiv an noch intelligenteren Sensoren und Algorithmen, um den aktuellen emotionalen Zustand des menschlichen Nutzers zu verstehen und angemessen darauf zu reagieren.

So macht man es richtig mit iMotions

Hinweis: Dies ist ein Auszug aus unserem kostenlosen Leitfaden „Mimikanalyse – Der komplette Taschenführer“. Um den vollständigen Leitfaden mit weiteren Informationen zu Stimulus-Einrichtung, Datenausgabe und -visualisierung, zusätzlichen Biosensoren sowie zum Thema „So funktioniert es richtig mit iMotions“ zu erhalten, klicken Sie bitte auf das untenstehende Banner. Wenn Sie Fragen zur Mimikanalyse haben, können Sie sich gerne an uns wenden.