表情分析は、目に見える表情と基本的な感情を結びつけたダーウィンの初期の研究から発展し、現在では微妙な行動を研究するための、データに基づく現代的な手法へと進化しました。今日では、映像ベースのシステムが、リアルタイムまたは録画映像から顔面動作単位(FAU)や推論された感情パターンを自動的に検出し、研究や実用的な場面において、注意力、認知、感情をより深く理解するために、他の生体センサーと組み合わされることがよくあります。

Table of Contents

表情に関する現代の研究は、20代前半の大半を世界中を旅して過ごした、ある医学部の中退者によって始まりました。帰国後、彼は一冊の本を著しました。当時の書評家の一人は「ところどころ少々退屈な部分もある」と評しましたが、この本は、今日私たちが表情について抱く考え方の基礎を築きました。その医学部中退者こそがチャールズ・ダーウィンであり、彼は進化論と感情の両分野における学問の基盤を築いた人物です。

ダーウィンはこの著書を執筆するにあたり、版画、挿絵、図解、写真などを用いて、感情を表す際の顔の筋肉の動きを研究した。彼は、顔には60種類の異なる表情があり、それらは怒り、恐怖、驚き、嫌悪、喜び、悲しみというわずか6つの感情に集約されると主張した[1]。

ダーウィンの時代以来、表情の研究には多くの変化が見られる。彼の核心的な概念は、顔と感情の関係について私たちが考える際の指針となり続けているが、その理解はより精緻なものとなり、研究手法もより高度なものへと進化した。表情を感情と直接結びつけるのではなく、その関係はより微妙で複雑なものになり得ることが、現在ではわかっている[2]。また、図解や図表の代わりに、自動解析が可能な動画記録を用いるようになった。

iMotionsの「表情分析」モジュールは、表情分析を効果的かつ効率的に行うために開発されました。ライブ映像や録画映像を通じて、表情が自動的に分析されます。その結果に基づき、顔の動きや、それが感情表現とどのように関連しているかを把握することができます。以下では、iMotionsが提供するすべての機能について解説し、皆様の研究を成功に導くためのヒントをご紹介します。

FEAデータ収集:ライブデータまたは録画データ

表情分析は、事実上どこでも実施可能です。必要なのは、ライブ映像または録画映像だけです。この柔軟性により、被験者を実験室に招くことも、外部で録画された映像を収集することも可能です。 テレビのインタビュー、ライブ配信、あるいは自分で録画した映像など、表情が映っているものであれば、どのような記録でも利用可能です。この柔軟性により、複数のデータ収集を同時に実施することも可能です。データ収集用コンピュータの前には、一度に1人しかいなくてもよいのです。その後、後処理をバックグラウンドでキューに入れられるため、作業が遅延することはなく、データの分析に集中することができます。

実社会における行動科学

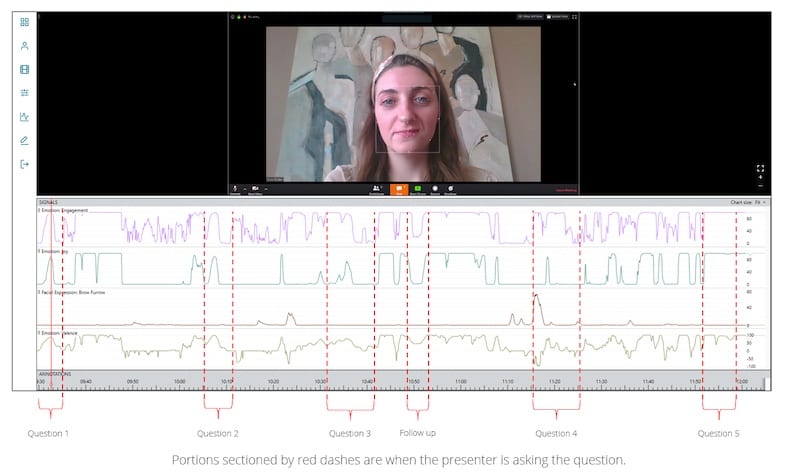

過去の記録データを後処理できるだけでなく、スマートフォンやタブレットなどのモバイルデバイスから送信されるデータをリアルタイムで分析することも可能です。また、他のバイオセンサーと容易に連携できるため、その場での相互作用を理解するための幅広い可能性が広がります。さらに、タイムライン注釈やLiveMarkersと組み合わせることで、高度な行動コーディングを行うことも可能です。

データのエクスポートおよび可視化機能

iMotionsでは、必要に応じてデータをさまざまな形式に簡単にエクスポートし、さらに分析を行うことができます。データへの注釈やマークアップ機能により、特定のセグメントを選択して、必要に応じてエクスポートすることが可能です。

iMotionsでは、エクスポートするセンサーデータ(またはセンサーデータの組み合わせ)を正確に選択できるため、必要なデータに絞って処理することができます。収集された幅広いデータは、後で必要になった場合や、再度エクスポートするために、iMotions内に保存しておくことができます。

iMotions:包括的な実験プラットフォーム

実験プロセスのほぼすべての段階をiMotionsで実行できます。実験設計(刺激の順序、被験者の詳細、グループ分け)から、刺激の提示、データ収集、処理(あるいは単なる後処理)、そしてデータエクスポートに至るまでです。

したがって、刺激の提示、顔追跡、顔の特徴抽出を行うために異なるソフトウェアを用意したり、どの参加者がどのグループに属しているかを管理したりする必要はありません。これにより、実験の実施プロセスが効率化され、スムーズかつ容易に行えるようになります。

20種類以上の表情測定項目

表情解析モジュールは、20種類以上の表情指標(別名:アクションユニット)、7つの主要な感情(喜び、怒り、恐怖、嫌悪、軽蔑、悲しみ、驚き)に関するデータ、顔のランドマーク、および頭の向きや回転といった行動指標、さらには被験者の注意力のレベルまでを提供します。

また、実験の状況に応じて測定の感度を調整することも可能であり、データ収集プロセスを完全に制御できます。感情の解明は困難な課題ですが、iMotionsによる表情分析を利用すれば、その解明に限りなく近づくことができます。

ぜひご覧ください:顔面動作コーディングシステム(FACS)―ビジュアルガイドブック

マルチモーダリティ統合

iMotionsは統合機能に優れており、複数の異なるバイオセンサーを連携させることで、人間の行動をより深く分析することが可能です。アイトラッカー(画面型、メガネ型、VR対応)、EEG、EDA、ECG、EMGなどのバイオセンサーを、実験にシームレスに組み込むことができます。

これらのセンサーは、それだけでは得られない深い洞察を提供することで、データを補完することができます。データからは、注意のプロセス、認知の変化、生理的覚醒レベルに関する情報が得られますが、これらは表情データだけを検討している場合には得られないものです。

また、Lab Streaming Layer(LSL)プロトコルを使用することで、標準で統合されていないさまざまなセンサーを接続することも可能です。これにより、他のセンサーからのデータをiMotionsに送信し、他のデータソースと同期させることができます(LSL対応のデバイスおよびツールのリストはこちら)。

免責事項:サードパーティ製のLSLアプリケーションを介して接続する際は、最終的な調査を実行する前に必ずデータの品質を確認してください。一部のLSLアプリは最近テストされていない可能性があり、更新が必要なバグが含まれている場合があります。

さらに、当社のオープンAPIを活用すれば、ほぼあらゆるデータストリームを接続することも可能です。例えば、脳コンピュータインターフェースの実現やバイオフィードバックへの応用などが挙げられます。事実上、あらゆるデータ生成デバイスをiMotionsに接続できるため、新たな研究の可能性が広がります。

表情分析の歴史は驚くほど長いものですが、現代的な形をとったのはごく最近のことです。iMotionsの表情分析モジュールを使えば、こうした変化の最前線に立ち、これまでにない方法で感情を評価する研究を行うことができます。

参考文献

[1] ダーウィン, C. (1872). 『人間と動物の感情表現』. ロンドン: J. マレー.

[2] Russell, J.A., Barrett, L.F. (1999). コア・アフェクト、典型的な感情エピソード、および「感情」と呼ばれるその他の要素:象の解剖。Journal of personality and social psychology, Vol. 76, No. 5, pp. 805-819.