行動コーディングが、定性的な観察を定量的な研究へとどのように変革するかをご覧ください。LiveMarkersとデータ収集後のアノテーションを活用して参加者の行動を標準化し、「タスク遂行時間」などの指標を追跡します。映像と生体センサーのデータを同期させることで、研究者は生体データに基づいたインタビューを実施し、生理的反応をヒントに、より深い事後的な洞察を引き出し、自己報告と客観的な行動との間のギャップを埋めることができます。

Table of Contents

iMotionsでは、生体センサーデータから得られる知見と、アンケートや自己報告といったより一般的な手法で収集された情報の交点について、よく話題にしています。しかし、観察に基づく行動データもまた、iMotionsで記録できる非常に重要でありながら、しばしば見過ごされがちな情報源です。 本ブログ記事では、動画やその他の記録媒体から観察された行動(あるいはあらゆる種類のイベント)のコーディングツールとして、iMotionsのソリューションをどのように活用できるかについて解説します。

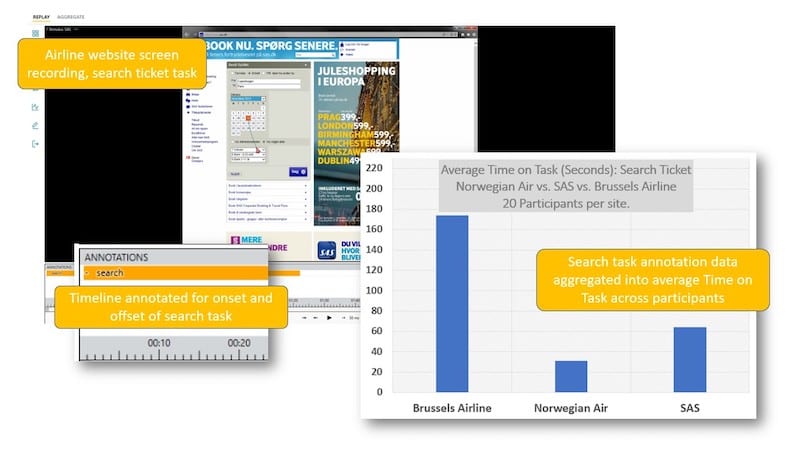

キャプション:タイムラインは、事後に作成された注釈を用いてセグメントに分割されています。この例では、参加者が行った一連のタスクの開始時点と終了時点をマークアップするために使用されています。

キャプション:タイムラインは、事後に作成された注釈を用いてセグメントに分割されています。この例では、参加者が行った一連のタスクの開始時点と終了時点をマークアップするために使用されています。

行動コーディングとは

行動コーディングとは、被験者に関する体系的かつ標準化された、定量化可能な一連の観察を指します。多くの場合、これらの観察は、人間のコーダーがその行動の記録をレビューすることで行われます。行動コードは広く利用されており、用途によってその内容は大きく異なります。心理学、人間工学、ユーザビリティ研究をはじめ、多くの分野において不可欠なツールとして活用されています。

行動コーディングに必要なのは、当社の基盤となるiMotionsソフトウェアプラットフォームだけであることをご存知でしたか?つまり、生体センサーのハードウェアを追加しなくても、高品質なアノテーションやコーディングを含む記録を作成することができます。もっとも、生理学的データを重ねて分析したいという場合は、もちろんその点についてもサポートいたします。生体センサーについてさらに詳しく知りたい方は、このテーマに関する豊富なブログ記事のライブラリをぜひご覧ください。

ぜひチェックしてみてください:

タイムライン注釈などのツールを活用することで、行動コーディングを生体認証データや自己報告と組み合わせ、それだけでは得られないような包括的な分析を行い、より深い洞察を得ることが可能になります。

すでにiMotionsをご利用の方には、本記事を通じて、コーディング作業に役立つライブマーカー、イベントマーカー、および注釈ツールについて、より深く理解していただけるよう解説しています。まだご利用でない方で、動画素材のコーディングツールをお探しの方には、iMotionsが提供する機能について理解を深めるための最速のガイドとなります。

録音データはどこで入手できますか?

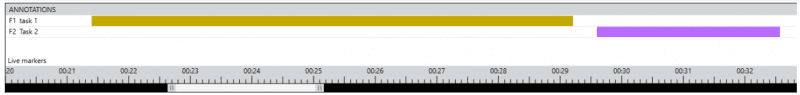

iMotionsでは、行動データをさまざまな方法で取得できます。下の図に示すように、入力データとしては、iMotionsに直接ストリーミングされる各種ビデオフィードのほか、分析用にファイルとしてインポートされる外部で録画された動画も利用可能です。また、ビデオフィードと併せて、参加者が生成するライブアノテーション(ライブマーカーとも呼ばれる)、キーボードやマウスのイベントも取得できます。 さらに、iMotions API を通じて、ゲームのテレメトリデータやドライビングシミュレータからのイベントなど、より複雑なアプリケーションのデータをストリーミングすることも可能です。

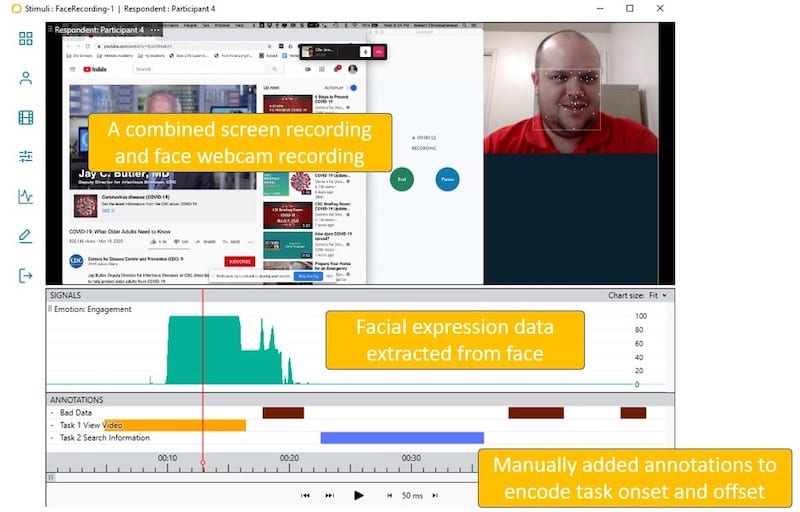

例:リモートデータ収集ツールからインポートしたウェブサイトおよび顔画像の記録

キャプション:リモートデータ収集ツール「Lookback.io」から取得した画面録画をインポートする例です。この動画には、画面キャプチャと、表情分析に使用できる顔映像の両方が含まれています。

キャプション:リモートデータ収集ツール「Lookback.io」から取得した画面録画をインポートする例です。この動画には、画面キャプチャと、表情分析に使用できる顔映像の両方が含まれています。

被験者が自身のコンピュータでウェブサイト上のタスクを実行している間、サードパーティ製ツールを使用して画面録画と顔面録画を同時に取得することができます。これらの録画データはダウンロードしてiMotionsの調査にインポートし、分析に活用できます。注釈機能を使用することで、タスクの遂行状況やタスクに費やした時間などを定量化することが可能です。さらに、表情分析を適用することで、セッション中の重要な出来事に関連する感情的な反応について洞察を得ることができます。

例:ゲームプレイの録画や、iMotionsから録画された複数のビデオフィード

例:Eコマースサイトでのタスクに費やした時間

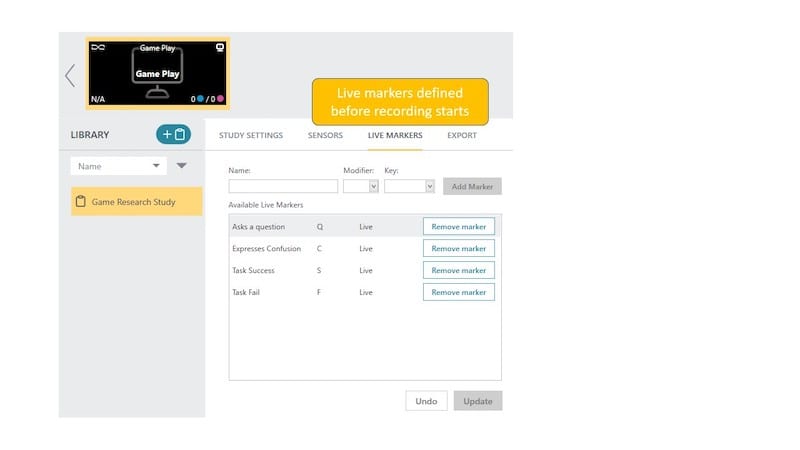

行動コーディング手法 1:LiveMarkers を使ったリアルタイム注釈

行動コーディングは、多くの場合、人間のコーダーが特定のイベントにフラグを立てるという形でリアルタイムに行われます。多くのユーザビリティプラットフォームでは、LiveMarkers を使用してこれらのイベントをリアルタイムでコーディングすることができます。以下は、ごく基本的なユーザビリティテストのためのそのようなスキーマの一例です:

Q = 質問者が質問をする

C = 対象者が困惑を示している

S = 被験者が課題を無事に完了した

F = 課題に不合格

iMotionsのLiveMarkers機能を使用すると、これらのコードをすべて研究に組み込み、各コードに関連付けられたホットキーを入力することで、これらのイベントをリアルタイムで記録することができます。これらのイベントは、iMotionsで記録を再生する際にタイムライン上に表示されるほか、センサーデータのエクスポート時には独自のタイムスタンプ付きでユーザー生成イベントとしてエクスポートされます。

iMotionsは、人間によるコーディングに代わる手段も提供しています。特にWebベースのタスクにおいては、iMotionsはマウスクリック、スクロール、ページの読み込みなど、被験者による操作を追跡することができます。

サードパーティ製ハードウェアを組み込んだより複雑な構成の場合、iMotionsは高度なAPIを介して、個別のマーカーイベントや時系列データを受信することができます。これは特にシミュレーションを利用するケースで有用であり、シミュレータからのデータを生体センサーのデータストリームと同期させることが可能です。

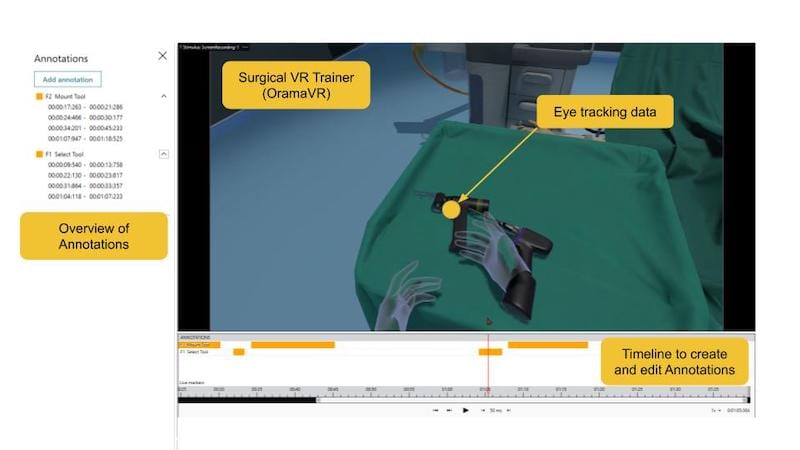

行動コーディング手法 2:収集後の注釈付け

映像は、参加者やその置かれている環境に関する豊富な情報を捉えることができます。セッション中に何が起きたかを把握するために映像を再生することで、研究者は、その環境における回答者のパフォーマンスや戦略といった幅広い側面を把握できるだけでなく、定量分析の基礎となる行動の記録も得ることができます。

キャプション:この例では、VR手術トレーニング環境(OramaVR提供)において、参加者の行動を定量化するためにアノテーションが使用されています。セッションの録画映像を確認する価値に加え、アノテーションを用いて各参加者の行動をコード化することで、タスク遂行のベンチマーク(例:タスクに費やした時間、タスクスコアなど)を確立することができます。

アノテーションは、私たちが「生体情報に基づくインタビュー」と呼んでいる手法において、非常に役立ちます。経験を思い出そうとする際、その瞬間にこそ明確に表現できるような細部や出来事を、つい見落としてしまうことがよくあります。だからこそ、ウェブユーザビリティテストにおいて「シンクアラウド」がこれほど有用なのです。 「生体情報に基づくインタビュー」では、iMotionsの生体センサー記録を振り返りの中心として活用できます。GSR(皮膚電気反応)のピークや眉をひそめる動作といった行動的・生理的なイベントを手がかりとして、その瞬間をより深く掘り下げ、より徹底的な洞察を得ることができます。この目的のために、注釈の断片を右クリックすることで、その注釈にコメントを追加し、より繊細で詳細なマークアップを行うことができます。

行動データの分析方法

行動データの性質上、それは本質的に定性的であり、目標を達成するための特定のプロセスや戦略を記述する傾向があります。しかし、コーディング体系やイベントマーカーを用いて個別の事象をコード化することで、ある程度の定量化が可能となり、これを生理学的データや自己報告データと組み合わせて活用することで、参加者の体験について多角的な視点を得ることができます。

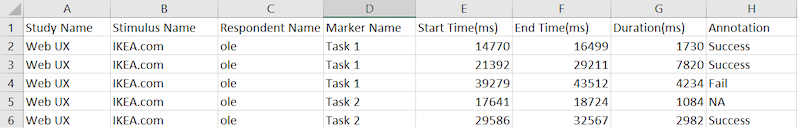

ライブマーカー、イベントマーカー、および注釈は、タイムスタンプ付きのセンサーデータエクスポート機能からまとめてエクスポートできます。また、別途用意されている「注釈サマリーエクスポート」機能では、コメント付きの注釈の完全なログを取得できます。

結論として、データの適切なコーディング、アノテーション、定量化を行うためのインフラが整っていれば、行動データは隠れた情報の宝庫となり得ます。iMotionsでは、アノテーション機能を活用することで、個別のイベントを簡単に記録・コーディングしたり、確認のためにデータの一部をハイライト表示したり、分析用にデータをエクスポートしたりすることができます。 このように、iMotionsはユーザビリティや人間工学の研究者にとって貴重なツールとなり得ます。本ツールは、生体センサーやアンケート調査を組み合わせることでさらに強化される、行動データの強固な基盤を提供します。

以下のウェビナーをご覧ください:

iMotionsを活用したリモート調査:表情分析と行動コーディング