Automatisierte AOIs vereinfachen die Eye-Tracking-Analyse, indem sie Objekte über mehrere Videobilder hinweg effizient verfolgen. Dieser Leitfaden behandelt fünf bewährte Vorgehensweisen für die Verwendung von automatischen AOIs, darunter die Objektauswahl, Überlegungen zur Bewegung und die Tracking-Genauigkeit. Optimieren Sie Ihre Forschung mit Expertenwissen zur Optimierung von Algorithmen für automatische AOIs, um eine präzise und effiziente Datenerfassung in Eye-Tracking-Studien zu gewährleisten.

Table of Contents

Einführung in automatisierte Interessensbereiche (Auto-AOIs)

Interessenbereiche (AOIs) sind das wichtigste Analyseinstrument im Eye-Tracking. Sie ermöglichen es Forschern, Augenbewegungen in quantitative Daten umzuwandeln, um Forschungsfragen zu beantworten und Hypothesen zur visuellen Aufmerksamkeit gegenüber bestimmten Objekten zu überprüfen.

Bei Standbildern ist das Erstellen von AOIs ganz einfach: Man muss lediglich das gewünschte Objekt umranden. Bei Videos kann dies jedoch mühsam sein, da Forscher die AOIs manuell auf vielen Einzelbildern platzieren müssen, um aussagekräftige Daten zu erhalten. Eines der Werkzeuge, mit denen sich der Zeitaufwand für diesen Analyseschritt reduzieren lässt, ist die Automatisierung des Zeichnens von AOIs, was manchmal auch als automatisierte AOIs bezeichnet wird.

Wie funktionieren automatisierte AOIs?

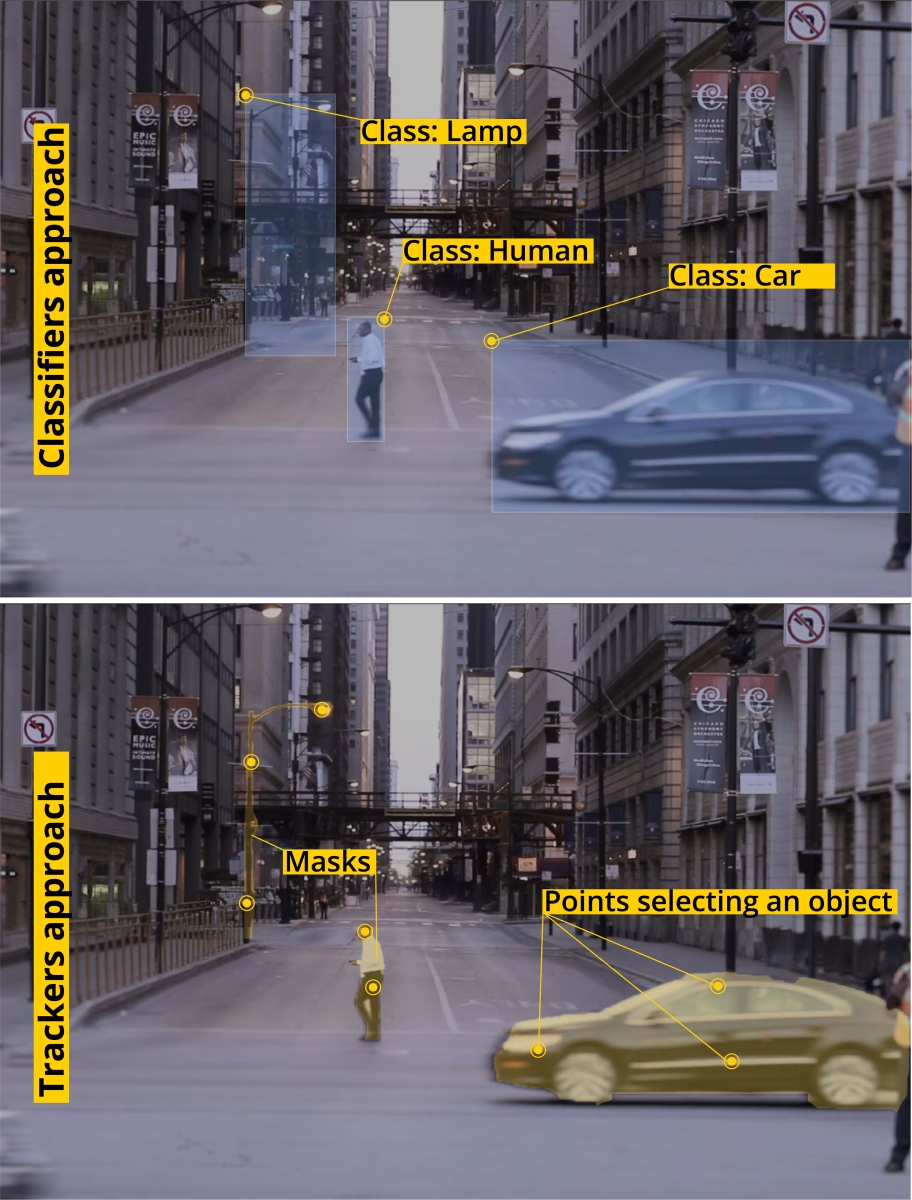

Es gibt zwei Hauptansätze, wie automatisierte AOI-Algorithmen ein Objekt verfolgen und darauf abgestimmte AOIs erstellen. Jede Methode hat ihre Stärken und Grenzen.

Automatisierte AOIs: Klassifikatoransatz

Beim Klassifikator-Ansatz für automatisierte AOIs wird ein Algorithmus darauf trainiert, verschiedene Objektklassen wie „Autos“ oder „Personen“ zu erkennen. Der Algorithmus kann ein Videobild analysieren und Objekte identifizieren, die zu den Klassen gehören, auf die er trainiert wurde. Anschließend springt der Algorithmus zum nächsten Bild und findet die Objekte erneut (und so weiter). Dabei zeichnet der Algorithmus in jedem Bild AOIs um das Objekt herum.

Der Klassifikatoransatz kann gut funktionieren, wenn Ihr Objekt zu den Klassen gehört, die der Algorithmus „kennt“. Er eignet sich auch gut, um mehrere Objekte gleichzeitig zu verfolgen. Wie effektiv diese Methode ist, hängt vom jeweiligen Algorithmus ab. In einigen Fällen haben Forscher die Algorithmen auf Klassen trainiert, an denen sie besonders interessiert sind, sodass diese Objekte sehr gezielt erkennen können.

Das bedeutet, dass ihr Algorithmus möglicherweise weiß, um welchen Fahrzeugtyp es sich im Videobild handelt, während ein anderer Algorithmus lediglich erkennt, dass es sich um ein Auto handelt. Algorithmen unterscheiden sich hinsichtlich der Anzahl der Klassen, die sie kennen, wobei diese von zwanzig bis zu Zehntausenden von Klassen reichen kann. In beiden Fällen ist der Klassifikatoransatz durch die Objekte begrenzt, die in den Klassen enthalten sind.

Automatisierte AOIs: Tracker-Ansatz

In iMotions nutzt unser AutoAOI-Tool einen innovativen Tracker-Ansatz für automatisierte AOIs. Sie wählen ein Videobild aus, das Ihr Objekt enthält (das sogenannte Eingabebild), und definieren Ihr Objekt mit wenigen Klicks, wodurch dem Bild Punkte hinzugefügt werden.

Unser Algorithmus nutzt Ihre Punkte, um Ihr Objekt zu erkennen und eine Maske darüber zu erstellen (in unserer Software erscheint diese als gelbe Markierung über dem Objekt). Der Algorithmus verfolgt das von Ihnen definierte Objekt über mehrere Bilder hinweg und erstellt automatisch AOIs, die mit der Maske des Objekts übereinstimmen. Dieser Ansatz ist nicht auf bestimmte Klassen beschränkt, sondern kann nahezu jede Art von Objekt erkennen, das Sie mit Ihren Punkten definieren können.

Unser Tracker-Ansatz für AutoAOIs bedeutet, dass Sie nicht auf bestimmte Klassen beschränkt sind. Der Algorithmus kann nahezu jedes Objekt verfolgen, da er anhand der Informationen aus den Pixeln des Eingabebildes ermittelt, welche Pixel zu Ihrem Objekt gehören und welche nicht.

Informationen wie der Kontrast zum Hintergrund, sichtbare Ränder und die Position des Objekts in vorherigen und nachfolgenden Bildern helfen dem Algorithmus dabei, die Position des Objekts zu bestimmen. Unser Algorithmus wurde auf natürliche Bewegungen trainiert und nutzt Informationen aus vorherigen Bildern, um die Ränder Ihres Objekts von Bild zu Bild weiter abzuschätzen, auch wenn er nicht weiß, um welches Objekt es sich handelt.

Wie bei jeder Methode gibt es auch hier Einschränkungen und Workarounds, die den Anwendern helfen, das Beste aus den Tools herauszuholen. In diesem Blogbeitrag stellen wir fünf bewährte Tipps für die Nutzung unseres AutoAOI-Tools mit dem Tracker-Ansatz vor.

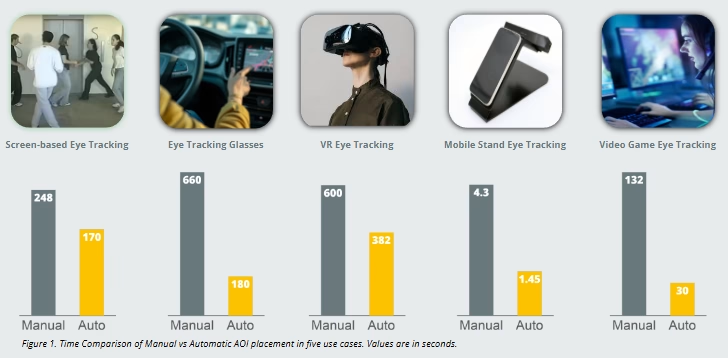

Anwendungsbeispiele für automatisierte AOI mit Videos

In den folgenden Beispielen wurden manuelle und automatisierte Methoden zur Festlegung von AOIs anhand der dafür benötigten Zeit verglichen, um diese für eine weitere quantitative Analyse festzulegen.

Im Folgenden finden Sie 5 Szenarien mit Videoclips. Diese Videoclips verdeutlichen die Unterschiede zwischen der manuellen und der automatisierten AOI-Bestückung.

1. Bildschirmbasiertes Eye-Tracking

2. Eye-Tracking-Brille

3. VR-Eye-Tracking

4. Eye-Tracking am mobilen Ständer

5. Eye-Tracking bei Videospielen

5 wichtige Punkte, die bei der Verwendung von AutoAOIs zu beachten sind

1. Auswahl eines Objekts

Der Tracker-Ansatz ist nicht auf bestimmte Klassen beschränkt und eignet sich daher für nahezu jedes sich bewegende Objekt. Wir sagen „nahezu jedes Objekt“, weil Menschen Objekte anders wahrnehmen, als Algorithmen sie verstehen. Die meisten (wenn nicht sogar alle) Objekte, die in den Klassen des Klassifikator-Ansatzes enthalten sind, lassen sich auch mit dem Tracker-Ansatz verarbeiten, da beide Ansätze Informationen aus den Pixeln des Videobildes nutzen.

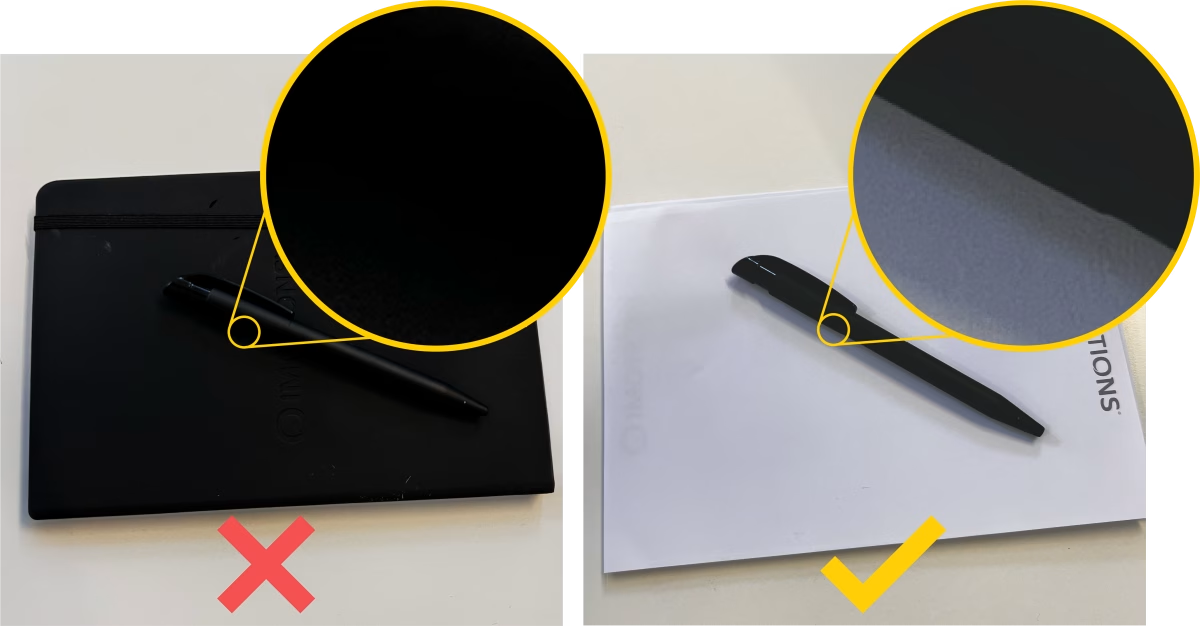

Wählen Sie Objekte mit klaren Konturen aus.

Wenn Sie wissen möchten, ob sich Ihr Objekt gut für AutoAOIs eignet, überlegen Sie, ob Sie das Objekt in Ihrem Eingabebild leicht nachzeichnen könnten. Wenn eine andere Person Ihr Objekt ebenfalls nachzeichnen müsste, wären Ihre Umrisse dann nahezu identisch, oder gibt es eine Stelle am Rand des Objekts, die etwas unklar ist?

Beispiel: Stellen Sie sich vor, in Ihrem Referenzvideo ist eine Person zu sehen, und Sie möchten nur deren Hand verfolgen. Würden mehrere Personen versuchen, die Hand nachzuzeichnen, wäre die Grenze am Handgelenk nicht so deutlich wie der Umriss der Finger. Trägt die gehende Person jedoch einen Handschuh, der sich vom Rest des Arms und vom Hintergrund abhebt, oder hat sie lange Ärmel, würde dies viel besser funktionieren, da es eine klare Grenze zum Rest des Arms gibt.

Automatische AOIs funktionieren besser bei Objekten, die durch klare Ränder vom Rest des Videobildes abgegrenzt sind. Mit anderen Worten: Lässt sich dieses Objekt leicht vom Hintergrund oder anderen Objekten im Bild unterscheiden? Denken Sie daran, dass der Algorithmus in der Regel nicht besser erkennen kann als Sie. Wenn Sie sich das Video ansehen und Schwierigkeiten haben, die Ränder eines Objekts zu erkennen (weil es unscharf ist oder das Bild dunkel ist), wird der Algorithmus ebenfalls Probleme damit haben.

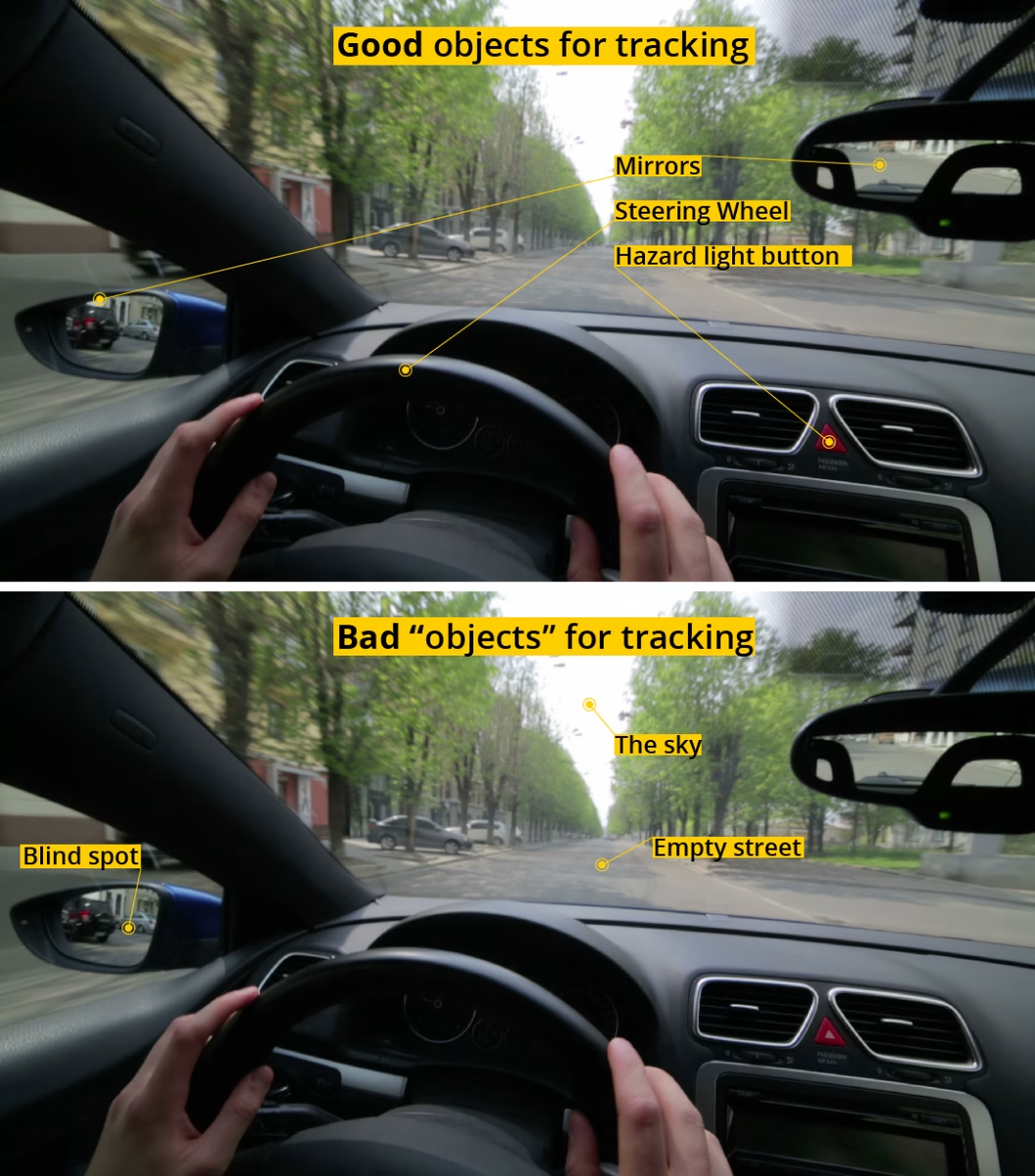

Wähle Gegenstände aus, die du in die Hand nehmen kannst.

AutoAOIs und der Tracker-Ansatz funktionieren sehr gut bei festen Objekten (dies gilt auch für den Klassifikator-Ansatz). Keiner der beiden Ansätze eignet sich gut für Objekte mit konzeptionellen Grenzen.

Beispiel:

Nehmen wir einmal an, Sie führen eine Studie durch, bei der Ihre Teilnehmer mit einer Eye-Tracking-Brille Auto fahren, und Sie möchten das Verhalten beim Überprüfen der toten Winkel untersuchen.

Mit AutoAOIs können Sie ein Objekt im toten Winkel und sogar in den verschiedenen Spiegeln rund um das Fahrzeug verfolgen. AutoAOIs können das Konzept eines „toten Winkels“ nicht erfassen, da es sich dabei um einen leeren Raum ohne klare visuelle Grenzen handelt, die man greifen kann. Ähnlich wie bei der oben genannten Regel würden die Umrisse nicht sehr ähnlich ausfallen, wenn verschiedene Personen versuchen würden, einen toten Winkel auf einem Video einzugrenzen.

Wähle jeweils nur ein Objekt aus.

AutoAOIs können für verschiedene Objekte eingerichtet werden, und die Analysen können gleichzeitig ausgeführt werden, wobei jeder Durchlauf jedoch nur für ein Objekt gilt. AutoAOIs sind nicht für Objektgruppen vorgesehen.

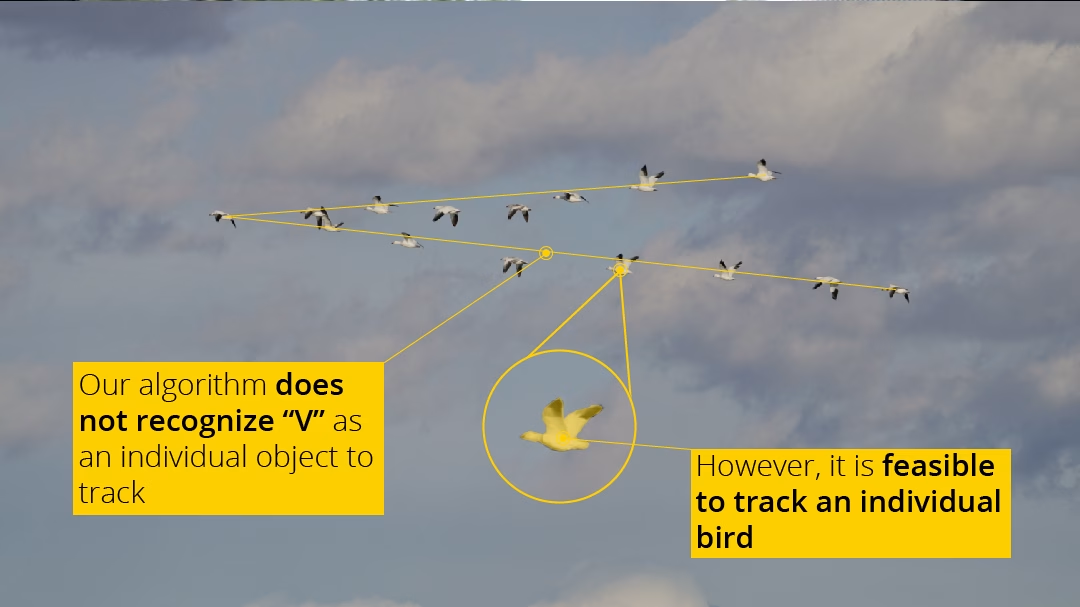

So haben automatische AOIs beispielsweise Schwierigkeiten, einen Vogelschwarm, einen Fischschwarm oder eine Flugzeugformation zu verfolgen. Auch wenn Gänse auf ihrem Zug eine deutliche „V“-Form bilden können, verbindet der Algorithmus die einzelnen Vögel nicht miteinander, um das „V“ zu erzeugen.

Gut zu wissen:

- Sie könnten sich für eine Person entscheiden, die Sie verfolgen möchten, oder versuchen, mehrere Personen auszuwählen, die Sie separat verfolgen. Forschungsergebnisse deuten darauf hin, dass unsere Augen eine Gruppe von Objekten verfolgen, indem sie sich auf die Mitte der Gruppe konzentrieren. Wenn sich also bestimmte Personen in der Mitte der Formation befinden, könnte man versuchen, einige dieser Personen zu verfolgen und die Daten später zusammenzufassen.

- Die meisten Klassifikationsansätze haben zudem Schwierigkeiten damit, einer Gruppe von Personen zu folgen, es sei denn, der Algorithmus wurde speziell dafür trainiert.

Wähle ein einzigartiges Objekt aus.

Es ist möglich, ein Objekt zu verfolgen, das anderen Objekten in derselben Szene fast identisch ist, solange sich ihre Wege nicht kreuzen. Wie im vorherigen Beispiel mit einem Vogelschwarm funktioniert die Verfolgung einiger Vögel im Schwarm problemlos, solange sie sich nicht gegenseitig überkreuzen. Unser AutoAOI-Tool wurde beim Verfolgen von Autos getestet, die sich durch den Verkehr schlängeln, hinter andere Autos fahren und wieder im Blickfeld auftauchen. Dies funktioniert gut, da sich das Auto in der Regel deutlich genug von anderen Autos auf der Straße unterscheidet. Unser AutoAOI-Tool ist nicht auf die Klassifizierung „Auto“ beschränkt, sodass Ihr Auto anhand seiner einzigartigen Merkmale von anderen Autos unterschieden werden kann.

NPCs (Nicht-Spieler-Charaktere) in Videospielen sehen sich oft sehr ähnlich, und AutoAOIs liefern gute Ergebnisse bei der Verfolgung einzelner Charaktere. Wenn sich ein NPC vor einen anderen bewegt, muss der Algorithmus erraten, welcher von beiden derjenige ist, den er in den vorherigen Bildern verfolgt hat.

Gut zu wissen:

- Falls die Zeichen nicht ganz identisch sind, stelle sicher, dass die vom Algorithmus generierte Maske die charakteristischen Merkmale abdeckt. NPCs haben manchmal ein Symbol, eine Lebensanzeige oder eine Kraftanzeige über dem Kopf. Versuche, diese in die Maske einzubeziehen, um zu sehen, ob deine AutoAOIs dadurch besser funktionieren.

- Außerdem kannst du mehrere Eingabebilder verwenden, um dem Algorithmus mitzuteilen, welches davon dein Objekt ist. Nachdem sich die Objekte gekreuzt haben, erstelle ein weiteres Eingabebild und markiere dein Objekt.

- Auch der Klassifikatoransatz steht vor dieser Herausforderung, die sich je nach dem, ob die Klassen spezifisch genug sind, um zwischen ähnlichen Objekten zu unterscheiden, und ob das Modell darauf trainiert wurde, diese Art von Bewegungen zu berücksichtigen, mitunter noch verstärkt.

2. Berücksichtigen Sie Bewegung und Veränderungen

Die Automatisierung des Prozesses zum Zeichnen von AOIs optimiert die Analyse von Eye-Tracking-Daten bei Bewegungen. Es ist wichtig zu verstehen, wie sich die Art und Geschwindigkeit der Bewegung auf Tools wie AutoAOIs auswirken.

Sind die Bewegungen „natürlich“?

Der Algorithmus, auf dem das AutoAOI-Modul basiert, wurde anhand natürlicher Bewegungen trainiert und berücksichtigt bei seinen Berechnungen die Informationen aus dem vorherigen und dem nachfolgenden Bild. AutoAOIs eignen sich gut für Objekte, die sich über den Stimulus hinweg bewegen und dabei größer oder kleiner werden, je nachdem, ob sie sich auf den Betrachter zu- oder von ihm wegbewegen. Das Modul kann sogar Objekte verfolgen, die sich drehen oder umkippen.

Er verfolgt Objekte, die verschwinden (etwa, weil sie aus dem Bildausschnitt geraten oder hinter einem anderen Objekt verschwinden) und wieder auftauchen, sofern das Objekt ähnlich aussieht wie zum Zeitpunkt seines Verschwindens. Der Algorithmus hat Schwierigkeiten mit Objekten, die unnatürliche Bewegungen aufweisen, beispielsweise wenn ein Video digital so „geglättet“ wurde, dass es schwierig ist, für das Objekt eine Maske Bild für Bild zu erstellen.

Überlege dir, wie schnell sich das Objekt verändert

Automatische AOIs können Objekte erfassen, deren Form oder Farbe sich stark verändert, solange der Übergang über mehrere Einzelbilder hinweg erfolgt. Wenn sich drastische Veränderungen schneller vollziehen als die Bildrate Ihres Videos, hat der Algorithmus Schwierigkeiten, das Objekt aus dem vorherigen Einzelbild wiederzuerkennen. Aus demselben Grund können plötzliche Veränderungen der Beleuchtung oder das plötzliche Auftauchen von Schatten problematisch sein.

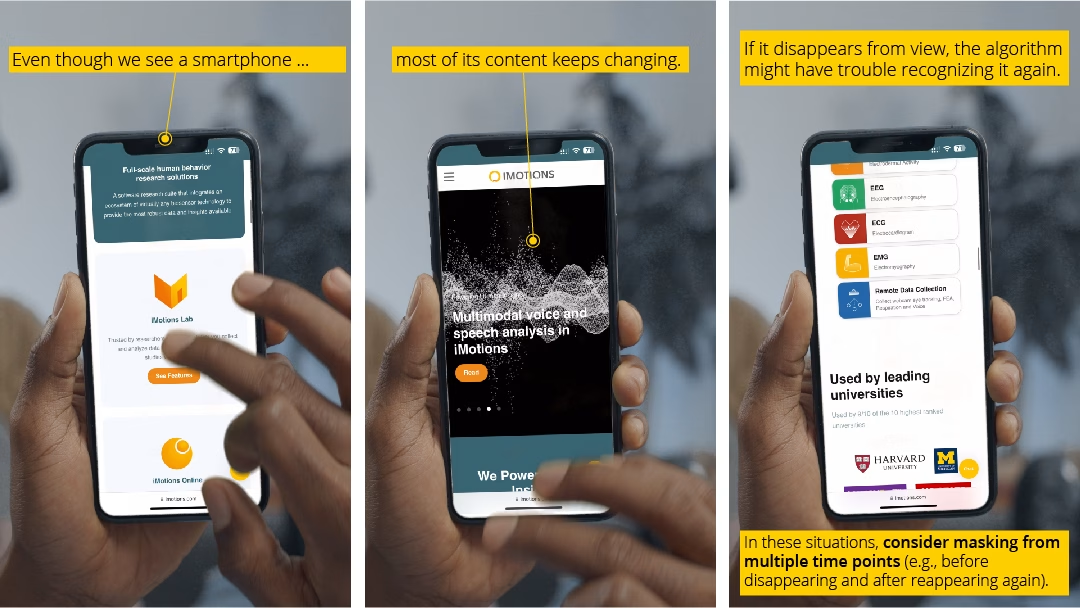

Gut zu wissen: Tracking-Bildschirme

- Beispiel: Bei der Verfolgung von Objekten mit Bildschirm (wie Smartphones, Computerbildschirmen und Tablets) kann sich das Bild auf dem Bildschirm dieser Objekte schlagartig ändern. Diese Änderung erfolgt schneller als die Bildfrequenz des Videos und betrifft den Großteil der Pixel, aus denen das Objekt besteht. Auch wenn sich die Gesamtform des Objekts nicht ändert, ändern sich doch die meisten Pixel, aus denen es besteht.

Bei AutoAOIs besteht eine Lösung darin, mehrere Instanzen zu verwenden. Jedes Mal, wenn das Objekt wieder in Sicht kommt, nachdem es zuvor nicht zu sehen war, oder sich stark verändert, erstellen Sie einen Eingabeframe und legen Sie einen Zeitbereich fest, in dem das Objekt in diesem Zustand verbleibt. Wenn sich der Zustand ändert, erstellen Sie einen neuen Eingabeframe mit einem definierten Zeitfenster, das diesen Zustand abdeckt (wiederholen Sie dies nach Bedarf). Dies wird als ein Objekt, jedoch in mehreren Durchläufen verarbeitet und eignet sich besser für solche Fälle.

3. Punkte setzen, um Ihr Objekt zu definieren

Ein großer Vorteil des Tracker-Ansatzes besteht darin, dass Sie Ihr Objekt definieren können, indem Sie einfach darauf klicken. Wenn die Punkte richtig platziert sind, sollte die Maske das gesamte Objekt und nur das Objekt abdecken.

Beginne mit einem Punkt in der Mitte des Objekts und schau dann, was in der Maske fehlt. Setze deine Punkte an den Stellen, die deiner Meinung nach für die Definition des Objekts wichtig sind. Überlege dir, wie sich das Objekt im Laufe der Zeit verändern wird. Wenn sich das Objekt stark verändern wird, achte darauf, Punkte an den Stellen zu setzen, die unverändert bleiben.

Beispiel: Wenn Sie eine gehende Person verfolgen möchten, beginnen Sie mit einem Punkt am Oberkörper und einem Punkt am Kopf. Fügen Sie anschließend die Gliedmaßen hinzu, da diese sich am stärksten bewegen. Wenn die Person einen Hut trägt, der sich von den Hüten der anderen Personen in der Szene unterscheidet, beziehen Sie den Hut mit ein.

Weniger ist mehr.

Die Definition des Objekts sollte nur wenige Klicks erfordern; viele Objekte lassen sich mit zwei oder drei Punkten definieren. Wenn Sie offenbar viele Punkte benötigen, um Ihr Objekt zu definieren, überlegen Sie, ob es einen anderen Bildausschnitt gibt, in dem Ihr Objekt besser zu erkennen ist.

Tipp: Im AutoAOI-Werkzeug von iMotions können Sie auch bei gedrückter Ctrl-Taste anklicken, um anzugeben, was nicht zum Objekt gehört, falls die ursprüngliche Maske über die Grenzen Ihres Objekts hinausragt.

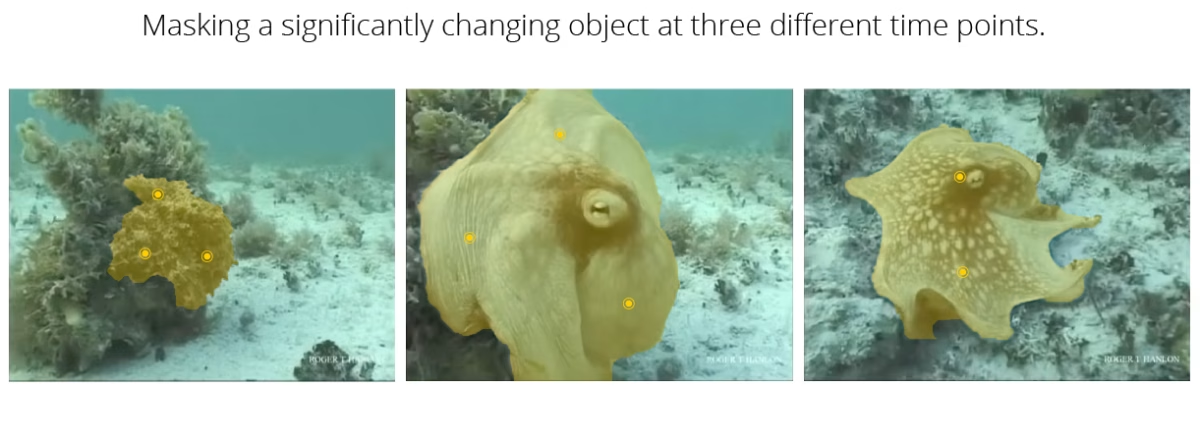

4. Wählen Sie einen guten Eingabebildschirm

Wir haben einen sich tarnenden Oktopus dabei beobachtet, wie er vor einem neugierigen Taucher flüchtet und dabei in einem einzigen Video zweimal seine Farbe, Größe und Struktur drastisch verändert. Für AutoAOI war das kein Problem. Ohne eine sorgfältige Auswahl der Eingabebilder wäre dies unmöglich gewesen.

Ein idealer Eingabebildausschnitt zeichnet sich durch eine gute Auflösung aus, und das Objekt ist deutlich zu erkennen. Obwohl man in der Regel nur ein Bild benötigt, um ein Objekt zu definieren, sollte man mehrere Eingabebildausschnitte verwenden, wenn sich das Objekt stark verändert. Wählen Sie für jede „Form“ des Objekts einen geeigneten Bildausschnitt aus. Bei der Verfolgung des Oktopus habe ich beispielsweise drei Bildausschnitte verwendet, einen für jede seiner Farben bzw. Texturen.

Falls mehrere Eingabe-Frames nicht helfen, lässt sich das Problem oft durch mehrere Instanzen desselben Objekts lösen (wie zuvor am Beispiel des verdeckten Objekts beschrieben). Wir haben Marios Kart verfolgt, als es durch einen Frageblock raste und mit Flammen, die aus den Auspuffrohren schlugen, eine Rampe hinunterflog. Anschließend schlug das Kart einen Salto und der Gleitschirm öffnete sich über dem Kart. Bei der Landung klappte der Gleitschirm wieder ein und Mario setzte das Rennen fort.

In diesem Beispiel können mehrere Eingabebilder oder Instanzen (beispielsweise eines mit dem Gleiter und eines ohne den Gleiter) hilfreich sein. Wir können den Gleiter auch als separaten AutoAOI einrichten. Das erfordert nur ein paar Klicks mehr, und der AutoAOI kann gleichzeitig mit dem Kart-AutoAOI laufen, ermöglicht uns aber neue Analysen. Wir können leicht vergleichen, wie lange jemand das Kart im Vergleich zum Gleiter angesehen hat, wenn der Gleiter vorhanden war. Mit dieser Strategie behalten wir auch die Flexibilität, diese Daten zu kombinieren.

5. Überprüfen Sie stets Ihre AOIs

Auch wenn AutoAOIs die automatische Erstellung von AOIs um sich bewegende Objekte erheblich vereinfachen, sollten Sie stets überprüfen, ob die AOIs so aussehen, wie Sie es erwarten – unabhängig davon, welche Methode Sie verwenden. Manchmal gibt es einen Abschnitt der Aufzeichnung oder des Videos, der nicht so gut funktioniert hat wie der Rest, und es ist eine alternative Lösung (ein zusätzlicher Eingabeframe oder eine AutoAOI-Analyse) erforderlich. Selbst in diesen Fällen kann die automatische Platzierung von AOIs den Benutzern dennoch Stunden an Analysezeit ersparen.