顔認証は、保存された生体認証データベースを用いて個人を特定し、認証や監視を行う技術であるのに対し、表情分析は、顔の筋肉の動きを解析することで、個人を特定することなく感情や行動パターンを推測する技術である。どちらも顔を対象としているが、表情分析は研究や消費者調査で広く利用されているのに対し、顔認証はプライバシー、偏見、悪用といった重大な倫理的懸念を引き起こしている。

Table of Contents

注目は「顔」に集まっている。世界中の政府や企業は、私たちの顔が、言葉で表現できる以上の多くの物語を語っていることに急速に気づき始めている。 刺激に対する人々の反応は、デジタル技術の助けなしには感知できないほど微細な場合があり、それが学術研究および商業研究の新たな道を開いた。しかし、顔に関する研究の利点を理解している人は多いものの、顔に関する研究には「顔認識」と「表情分析」という、性質が全く異なる2つの分野が存在することを知らない人もまだ多い。これらは、同じ生理的特徴である「顔」に焦点を当てているものの、その本質は大きく異なっている。

iMotionsは表情分析ソフトウェアの第一人者ですが、学術目的・商用目的を問わず、顔認識機能の提供やサポートは一切行っておりませんので、ご注意ください。

他のあらゆる調査手法と同様に、顔に関する調査を実施・活用する際には留意すべき点がいくつかあります。本ブログでは、顔認識と表情分析の違い、倫理的な落とし穴、そしてデータ収集におけるベストプラクティスについて解説します。

顔認証とは何ですか?

顔認証という概念は、多くの人にとっておなじみのものです。これは、指紋に次いで最も広く利用されている生体認証・識別手段の一つであり、私たちの日常生活におけるさまざまなセキュリティ手順に組み込まれています。

例えば、高級スマートフォンのロックを解除する際や、多くの空港でのセキュリティチェックの際などに、カメラを見る必要があります。公共の場所で24時間体制で稼働している一部の防犯カメラは、本人確認のために個人の特徴を捉えることさえあります。顔認証技術は、社会において急速に普及しつつあります。

顔認識のプログラミングの複雑な仕組みについては詳しく触れませんが、このソフトウェアはアルゴリズムを用いて、膨大な画像データベースに保存された画像と照らし合わせ、人物の顔の特徴を検証します。この技術は、基本的に人物の顔の要素を分析し、すでに保存されている画像と照合することで、対象となる人物を特定するものです。

通常はセキュリティ対策として導入されることが多いが、顔認識技術を活用して企業や政府が、この技術を用いて他にも様々な取り組みを行う事例が見られ始めている。

中国の企業アリババは、すでに中国国内の店舗で顔認証による決済を導入しています。レジで最高の笑顔を見せるだけで、そのままお会計を済ませて帰ることができます。つい最近まで、顔認証は主に本人確認の手段として使われていました。スマートフォンのロック解除などでご存知の方も多いでしょうが、上記の例が如実に示すように、その状況は今、急速に変化しつつあります。

顔認識技術の利用をめぐる倫理的ジレンマ

大規模監視における顔認識技術の利用は、いくつかの重大な倫理的問題を提起している。 その中でも特に重要なのがプライバシーの侵害であり、不当な追跡やプロファイリングを可能にする恐れがある。特に強力な規制枠組みが欠如している場合、当局による悪用が権力の乱用や特定の集団を標的にするリスクをもたらす。さらに、データセキュリティや情報漏洩への懸念から、機密性の高い個人情報がさらされるリスクもある。無制限に使用されれば、大量監視における顔認識技術の導入は、公共空間を根本的に変容させ、表現の自由を抑制し、公共の安全と個人の権利とのバランスを脅かすことになる。

顔認識技術が誤用されるのは、監視分野だけにとどまらない。顔認識技術は、疑似科学に誤った正当性の装いを与える可能性があり、実際にそうした事例も少なくない。一見「データに基づく」洞察を提供しているかのように見せかけることで、顔の特徴から行動や性格を予測するといった根拠のない理論を裏付けるために誤用される恐れがある。これは、頭蓋骨相学のような歴史的な誤謬を、現代技術という名目で再現するに等しい。

顔認識技術が疑似科学に利用されている好例として、SciMatch.comの事例が挙げられる。このマッチングアプリは、AIと深層学習アルゴリズムを用いて、顔の分析やそこから推測される性格特性に基づいてユーザーをマッチングさせると主張している。しかし、その手法は人相学や頭蓋骨相学といったすでに否定された理論を踏襲しており、科学的な裏付けを欠いている。 批評家たちは、性格マッチングにおける87%という精度の主張に疑問を呈し、これを疑似科学であると断じ、真の人間関係に与える影響について懸念を示している。

これらの例は、顔認識の応用例を示す一方で、人間の行動に関する研究における限界も浮き彫りにしている。これは、膨大な量の画像データを単一の画像と照合し、一致するかどうかを判定するソフトウェアである。その結論は二値的なものとなる。顔認識が研究プロジェクトで活用される可能性は否定できないが、その適用範囲はせいぜい限定的なものに留まるだろう。これに対し、表情分析の場合は逆のことが言える。

表情分析とは何ですか?

顔認識と同様に、表情分析(FEA)も顔の特徴を重視しますが、それが特定の個人に結びついているかどうかは問いません。FEAは、1970年代に心理学者ポール・エクマンによって考案された「顔面動作コーディングシステム(FACS)」に端を発しています。 現代のFEAでは、機械学習アルゴリズムを用いて、これまでにない精度とニュアンスで表情を分析しています。FACSは、人間の表情を「アクションユニット」と呼ばれる単位に分解することで機能し、各ユニットは顔の特定の筋肉または筋肉群に対応しています。

アクションユニットを利用することで、研究者は回答者に見られるさまざまな表情パターンを簡単に分類でき、その後の分析が格段に容易になります。したがって、FEA自体は、ある特定の瞬間にその人が何を感じているかを直接判断することはできず、研究者がさまざまなアクションユニットの使用を分類し、それを基に参加者の感情状態を判断できるようにするに過ぎません。

「表情分析ポケットガイド」をダウンロード

iMotionsでは、ユーザーが研究において表情分析を最大限に活用できるようアドバイスを行っています。特に、ソフトウェアがデータを処理した後に、必ずフォローアップの質問を行うことの重要性を徹底して伝えています。なぜなら、いかなるソフトウェアも人間の代わりになることはできないからです。 パートナーであるAffectiva社との協力により、Facial Action Coding System(FACS)に基づく自動顔面コーディング機能を当社のソフトウェアに統合し、今日の業界をリードする研究ツールへと発展させました。しかし、これはあくまで研究者の皆様の研究活動を強化するためのツールであり、研究そのものを定義するものではありません。

感情は状況によって異なる

友人や家族が一人で微笑んでいるのを見て、なぜ笑っているのか尋ねたことはありませんか? 笑顔は見えるものの、その意味が全く分からないこともあります。物思いにふけっているのか、幸せなのか、懐かしさを感じているのか、それとも面白いジョークを思い出しているのか。見分けるのは不可能に近いからこそ、尋ねざるを得ないのです。これは、回答者に生体センサーを用いて測定を行った際に得られるデータについても同様です。それは、私たちが感情を表現する方法が複雑だからなのです。

高品質なウェブカメラを搭載したコンピューターは、人間よりもさらに微妙な表情を識別できるというのは事実ですが、感情の表現には文脈が深く関わっています。人は常に感情を表していますが、その感情が顔に現れる際、それを表現するために使える筋肉の数は限られており、それが前述の「顔面動作単位(Facial Action Units)」です。

つまり、表現によっては共通する特徴を持つものもあるということだ。表現の要素が重複していることや、特有の癖などが、データ収集の過程で誤検知を引き起こす可能性がある。そうした誤検知を排除するのは、研究者の責任である。

そうしないと、調査結果が歪んでしまいます。もしあなたが熱のこもった話し手であれば、コンピュータは、あなたが情熱的に主張している場面でも、恐怖に震えていると判断してしまうかもしれません。目を見開き、口を開けているのは、恐怖や衝撃の表れですが、単に驚いただけかもしれません。

データにおいて偽陽性結果が生じる要因はいくつかあります。もし研究で微細な発汗を測定する「皮膚電気反応(GSR)」も併用されている場合、単に太陽が出て部屋が暖まるという事実だけで、感情が高ぶっていると判定されてしまう可能性があります。これは顔にも表れやすいものです。こうした微妙な要因が重なり合うことで、実際には存在しない特定の感情に対して偽陽性の結果が出る恐れがあります。

顔認識と同様に、表情分析も機械学習の助けを借りて自動化が可能であり、すでに「エモーションAI」と呼ばれるものとして実用化が進んでいる。エモーションAIという概念が初めて注目を集めたのは、約20年前にMITの科学者ロザリンド・ピカールが執筆した「アフェクティブ・コンピューティング」と題された論文においてである。同論文では、コンピュータサイエンスは、コンピュータが感情を認識し、ある程度の範囲で「感情を持つ」ことさえ可能になる段階に近づいていると指摘されていた。

本論文の核心的な主張の一つは、人間の感情が、何を食べるかを決めることから、個人的・職業的な重要な決断に至るまで、日常生活のあらゆる行動に影響を及ぼしているという点である。私たちを最大限に支援できるAIを構築するためには、感情を認識する能力が鍵となる。 デジタルによる感情理解を最大限に実現するため、感情AIはさまざまな測定ポイントからのデータを収集・分析することで機能しており、中でも最も重要なのが表情分析である。アイトラッキング、生理的信号、音声分析と組み合わせることで、これらの測定ポイントにより、理論上、コンピュータは人間の感情を推定し分析することが可能となる。

マルチセンサー研究入門

人間の感情の測定を自動化すること自体は、もちろん悪いことではありません。しかし、感情AIに関しては注意すべき点がいくつかあります。第一に、そのAIが完全に自動化されているか、あるいは自律的であるかという点です。

人は特定の状況下でも同じように振る舞うわけではありません。それは、私たち一人ひとりが異なる存在であるだけでなく、それぞれの状況に対して、顔に表れるストレス、興奮、衝撃、喜び、あるいは退屈といった感情の度合いが異なるからです。

また、私たちは文化的観点から状況の解釈や対応も異なって行います。世界中の誰もが同じように行動すると言うのは非常に大胆な主張であり、自律型AIがそれを理解できないのではないかという懸念も生じかねません。繰り返しになりますが、結局のところ、データ収集のプロセスにおける実践の在り方に帰着します。しかし、結果が研究者やデータ収集者によって追跡・検証されなければ、それらは科学的価値も現実世界での価値も持ちません。

顔データの倫理的な利用

研究は倫理的かつ責任を持って行われるべきだと言うのは、ほとんど言わずもがなのことのように思えるが、ここでその重要性を改めて強調する理由はいくつかある。第一に、それが研究およびデータ収集における適切な慣行だからである。第二に、私たちは今、顔認識や表情分析が、監視や抑圧の手段として、あるいは個人情報の不適切な取得や悪用として悪用されることに、ますます注目が集まるメディア環境に入りつつあるからだ。

生体認証研究、特に顔に焦点を当てた研究は議論の分かれるテーマであり、顔認証(FEA)研究を行う研究者は、確固たる倫理的基盤に立っていなければなりません。iMotionsでは、データ収集は倫理的に妥当なものでなければならないと常に提唱してきました。つまり、測定対象者から必ず

、必ず同意を得るということです。

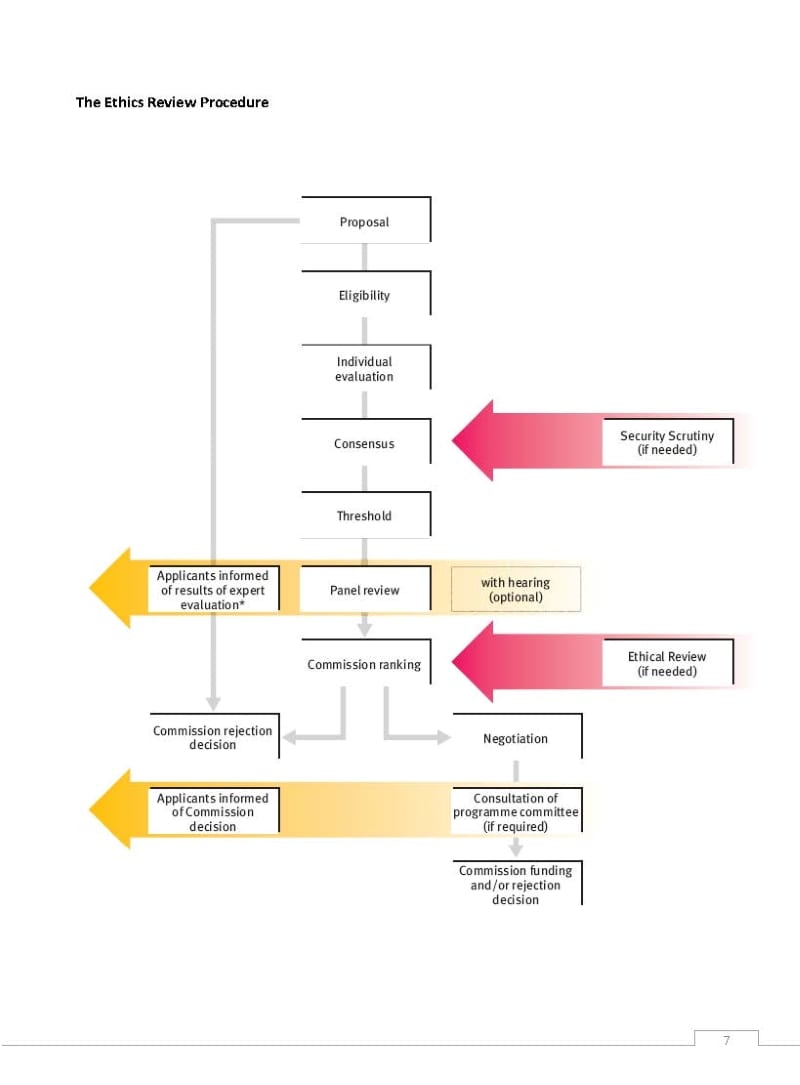

個人の知る権利を侵害するだけでなく、被験者がその事実を知らないまま研究を行うことは、研究者側の根拠のある推測に過ぎない。前述の通り、人間を対象とするあらゆる研究において、すべての被験者からインフォームド・コンセントを得ることが極めて重要である。 欧州委員会の「研究者向け倫理指針」では、インフォームド・コンセントについて、「…参加に同意する前に、参加者は研究の目的、起こりうる有害事象、いつでも不利益を被ることなく参加を拒否したり研究から脱退したりできる可能性について、明確に説明を受けるべきである」と規定している。

特に、ウェブカメラを通じて多くの顔面研究が可能になりつつある現在、生体認証の研究者にとっては、この点が極めて重要である。当然ながら、研究プロセス全体を通じて十分な注意を払う必要があり、それはまた、研究やデータ収集を行う者が、誤検知が結果として受け入れられないよう、回答者からの結果について常に確認を行うことを意味する。

同意書、秘密保持契約(NDA)、その他の法的文書を用意することで、データが不正に使用されることから研究者と参加者を保護し、研究における信頼と透明性を確保することができます。データがどのように収集されているか、また近い将来、自身のデータに関する権利がどのように影響を受ける可能性があるかについて、人々の意識が高まっている今、この関係性を軽視してはなりません。

表情分析は生体認証研究において非常に強力なツールであり、これを利用した多くの素晴らしい研究が行われています。重い処理を代行するアルゴリズムがあれば、研究の準備や実施にかかる時間を短縮できるため、大規模な被験者グループを対象とした研究が可能になります。 研究者として肝に銘じておくべきことは、自分が長い情報の流れの最終段階に位置しており、研究の目的のためにデータを倫理的に収集し、結論を導き出し、その科学的妥当性を確保するのは、最終的には自身の責任であるということです。