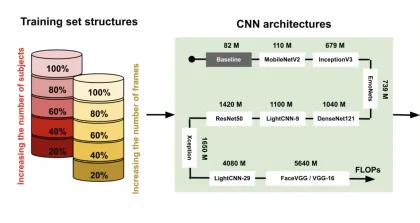

基于人工智能的面部表情分析

我们的面部展现了外在的情感表达,从而反映出我们内心的情感状态。这些外显的情感状态是通过全自动计算机算法实时检测的,该算法利用网络摄像头记录面部表情。

在受控环境下,结合其他生物传感器使用时,面部表情追踪可以成为衡量情感体验的有力指标。虽然没有任何单一传感器能够“读心”,但通过综合多路数据流并结合强大的实证方法,我们已开始朝着这一方向迈进。

从任何视频中实时或自动生成面部编码

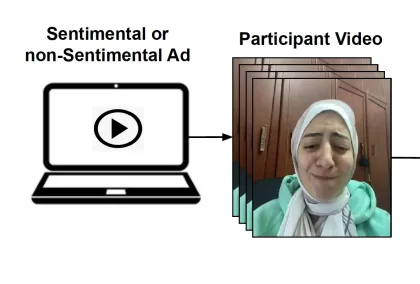

iMotions 面部表情分析模块无缝集成了业界领先的自动面部编码人工智能技术——Affectiva 的 AFFDEX。通过网络摄像头,您可以在 iMotions 软件中直接将面部表情与刺激源进行实时同步。如果您已录制面部视频,只需导入视频即可进行分析。借助内置的分析和可视化工具获取洞察,或导出数据以进行进一步分析。

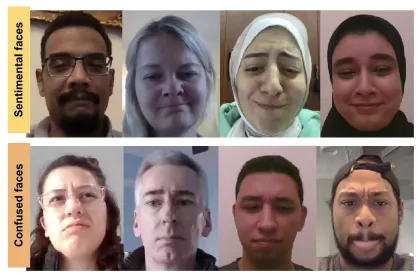

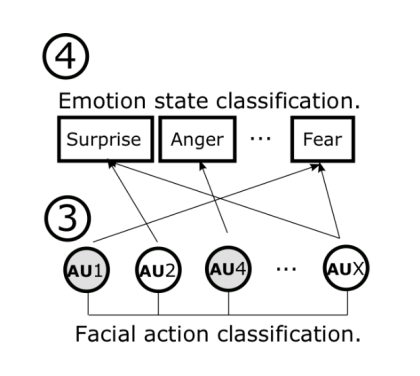

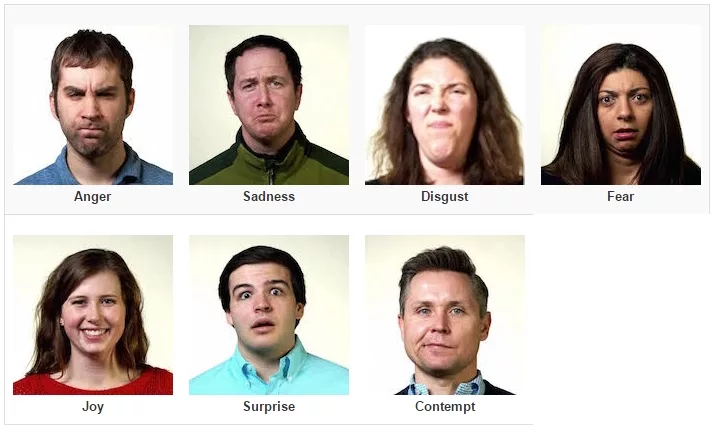

识别7种核心情绪

iMotions的面部表情分析模块通过追踪细微的面部肌肉运动,实时识别七种核心情绪:喜悦、愤怒、恐惧、惊讶、悲伤、轻蔑和厌恶。该方法基于面部动作编码系统(FACS),这是由保罗·埃克曼博士和华莱士·弗里森共同开发的客观评估框架。

研究人员可以利用这些数据开展用户体验测试、市场调研和心理健康评估等工作,从而优化产品设计、营销策略,并提升人们的整体福祉。

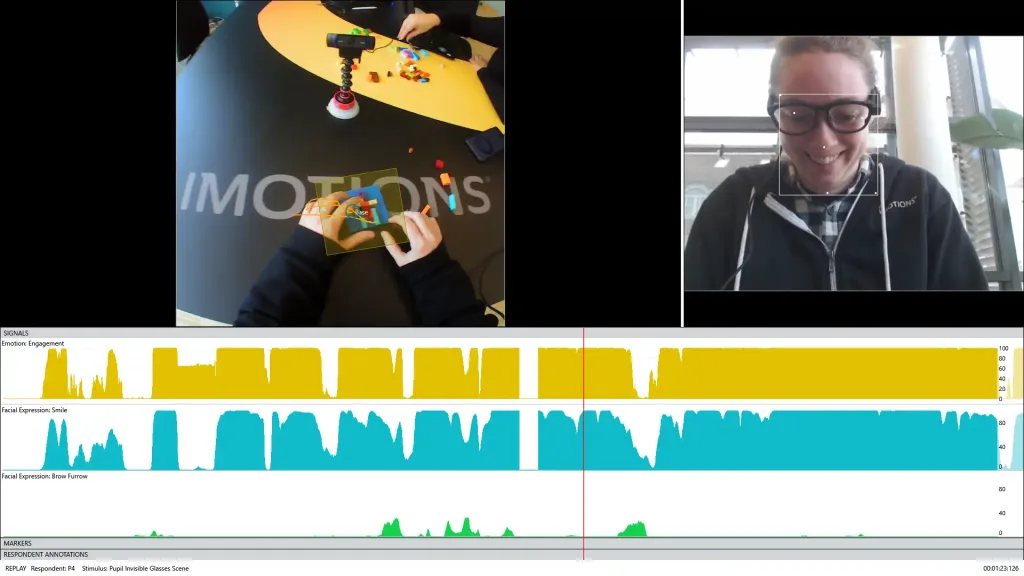

获取您内容的价值和参与度统计数据

情感极性和参与度是理解情感反应的关键指标。情感极性代表整体的情感基调,范围从负面到正面。它有助于研究人员评估用户体验、产品偏好和品牌认知。高情感极性表明积极情绪,而低情感极性则暗示负面情绪。

另一方面,参与度衡量的是表达程度和投入程度。它反映了个人对广告、视频或互动内容等刺激因素的积极响应程度。通过追踪情感倾向和参与度,企业可以优化营销策略、提升用户满意度等。

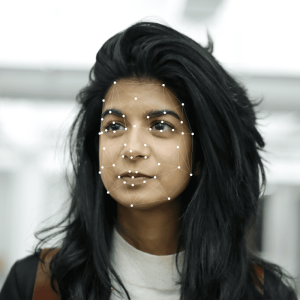

追踪面部运动以进行面部表情分析

研究人员已经开始利用面部表情分析模块来:

- 测量面部行为的人格相关因素

- 测试基于游戏的学习中的情感动态

- 探索教学模拟中的情感反应

- 评估不同驾驶条件下的生理反应

- 还有更多

常见问题解答

在此您可以查阅我们经常收到的一些问题。如果您有其他问题,无论是在此处还是本网站的其他地方都找不到答案,请通过此处联系我们。