音声分析とは、話し言葉における声の特徴やパターンを研究する学問である。音の高さ、声の調子、話し方、感情の表れといった要素を分析し、言語学、感情、個人の特性といった側面について知見を得るものである。この技術は、言語学、心理学、医療などの分野で応用されている。

Table of Contents

初めて訪れる国にいると想像してみてください。その国の言葉は話せませんし、もちろん理解することもできません。 誰かに話しかけたり、あるいは誰かに話しかけられたりすると、気がつくと相手は、あなたが理解する見込みなど微塵もないような長々とした文章を早口で話し始めています。しかし、いくつかの基本的なことは理解できるものです。もちろん文脈は話の内容を把握する助けになりますが、その場での状況を多く物語るもう一つの要素があります。それは、相手の話し方です。

その瞬間、私たちは声を分析しています。声のトーンや抑揚、音の高さ(その他も)の変化を聞き取り、その人が喜んでいるのか、悲しんでいるのか、怒っているのか、あるいは熱心に取り組んでいるのかを推測するのです。こうした情報からは、その人の内面の状態について多くのことがわかります。通常、話者の感情について明示的に説明される必要はありません。私たちは自動的に声を分析し、その答えを把握しているのです。

この現象――今日では「音声分析」と呼ぶことができるもの――は、もちろん、人間が言葉を話し始めて以来、古くから知られていたものであり、発声の測定に関する初期の試みは、少なくとも1900年代後半から行われてきた[1]。

その後、1960年代には厳密な科学的分析によってこの分野はより体系化された[2]が、音声分析が科学分野として真に確立したのは、現代のコンピューティング技術が登場してからのことである。現在、AI手法の台頭により、音声分析科学は次の変革の幕開けを迎えている。

では、音声分析とは一体何なのか、そして人間の感情や行動をより深く理解するためにどのように活用できるのでしょうか?また、AIはどのように役立つのでしょうか?以下では、音声分析がすでに、健康研究、人間とコンピュータの相互作用、UX、そして購買意欲などの意思決定の理解といった分野において、研究者の進歩をいかに支えているか、その主な事例をいくつかご紹介します。

音声分析とは何ですか?

音声分析とは、発声音を測定し、感情、年齢、性別、あるいは発話があるかどうかの有無といった定義された指標と関連付けるプロセスです。重要な点として、音声分析は使用された言葉そのものに関する直接的な情報を提供するのではなく、それらがどのように発声されたかという情報を提供するものです。

この手法では、発話音声をセグメント化し、複数の特徴量を抽出します。これらの特徴量は、個別に、あるいは組み合わせて評価することができます。アルゴリズムによって処理方法は異なりますが、通常はプロソディ、発話速度、イントネーションなどの特徴量が収集・分析されます。そして、これらの特徴量を用いて、話者が喜んでいるか怒っているかといった、発話のより高次元な特性を予測します。

発話の基本的なメカニズムと、より広範な感情的な結果の両方を測定することで、人間の行動に関する知見が得られます。このアプローチにおいて特に有望視されている分野の一つが、医療分野です。

医療分野における音声分析

医療分野において音声を分析することには、2つの利点があります。第一に、音声は(同意を得た上で)最初の接触時点から記録できるため、データとしてほぼ手間なく収集できる点です。第二に、神経疾患、精神疾患、発声障害など、幅広い疾患の予測因子として大きな可能性を秘めている点です。

声と生理機能の関係を調査した初期の研究の一つは、タイプAおよびタイプBの性格理論を広めたマイヤー・フリードマンによって行われた[3]。この理論では、人々を大まかにタイプAとタイプBのグループに分類しており、タイプAは「競争心が強く、非常に計画的で、野心的で、せっかちな」傾向があり、タイプBは「リラックスしていて、受け入れる姿勢があり、神経質さが少ない」傾向がある。

研究グループは、音声分析テストを通じて、A型の人々と心臓病患者をB型の人々と区別できることを突き止めた。この結果は、声だけで性格タイプを区別できる可能性を示唆するものと考えられた。

A型およびB型性格論は後に正当な批判を受け、事実上否定されることになった(例えば[4]および[5]を参照)が、声と疾患バイオマーカーを組み合わせるというアプローチはすでに始まっていた。例えば、最近の研究では、アプリのみを用いて生体力学的要素を抽出し、パーキンソン病の特定に活用する方法が示されている[6]。

また、ある研究ではパーキンソン病患者の脳スキャンを活用し、感情処理に関連する領域の脳損傷と感情的な発話との関連性を示し、この神経疾患において脳と声の間に直接的な関連があることを明らかにした[7]。

その後の研究により、パーキンソン病、アルツハイマー病、うつ病、筋萎縮性側索硬化症(ALS)、双極性障害、さらにはロングCOVIDに至るまで、音声による疾患の予測可能性が示されてきた[8, 9]。研究デザイン、録音、特徴抽出、分析の手法は研究によって大きく異なるものの、健康に影響を与える要因を確実かつ早期に特定するという点において、一貫した方向性を示している。

いくつかの研究や企業が、将来の医療分野における応用を見据え、自動音声状態解析(AVCA)の可能性に注目しています。結局のところ、音声解析は、幅広い疾患や障害の早期発見・診断において、低コストで、ほとんど受動的な手法として大きな可能性を秘めています。

人間とコンピュータの相互作用における音声分析

音声分析は、早期診断にとどまらず、医療提供ツールへのアクセスや利用者の感情を理解する手助けをすることで、医療の質を向上させるための新たな道筋も提供します。その一例として、遠隔医療、特に遠隔セラピーが挙げられます。

研究では、ビデオや通話による療法に音声分析手法を取り入れることが提唱されており、これにより、医療従事者は患者の評価を行う際の指針となるデータを得ることができる。最近の研究では、自殺リスクを特定する方法が示されており、通話中のセラピストに人命を救う可能性のある情報を提供できることが示唆されている [10]。

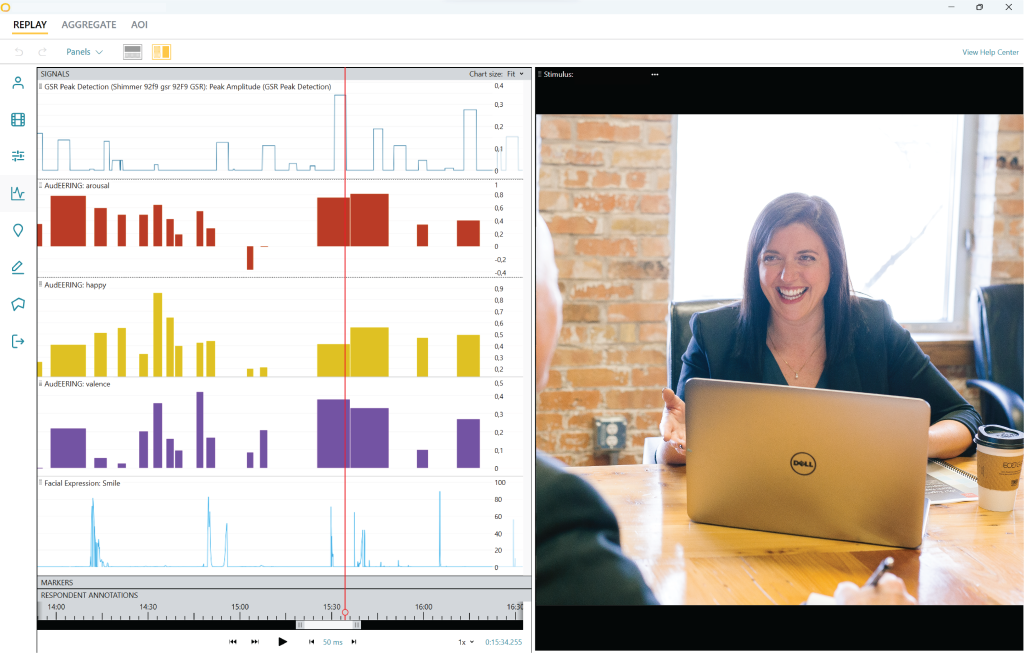

他の研究では、音声分析手法を用いることで、医師と患者のやり取りをより容易かつ客観的に評価できることが示唆されている[11]。これにより、今後の通話においてエビデンスに基づいた改善策を提案するためのデータが得られる。

この手法は、治療用チャットボットにも同様にリアルタイムで適用できる。こうしたチャットボットが普及するにつれ、単に患者の発言内容にとどまらない評価を行うことで、音声分析手法を統合し、患者のニーズにより即した応答を可能にする方法について、多くの論文で論じられている[12, 13, 14]。

音声分析との統合によって実現できる、このような感情に配慮した対話機能は、もちろん治療の場だけに限定されるものではありません。むしろ、人間が話すあらゆる体系的な対話において、応答する人間――あるいはAI――の感情に対する理解を深めることができるデータを活用することで、その対話の質が向上する可能性が高いでしょう。

無料ウェビナー:2024年11月13日 16:00(UTC+1)

audEERING × iMotions:「ボーカルの秘密を解き明かす」

音声分析が、私たちの動機や行動に潜む知見をいかに明らかにするかを探るウェビナーにぜひご参加ください。第二次世界大戦以来、音声分析は企業が従業員の気分、ストレス、健康状態を把握する一助となってきました。音声分析ソフトウェアのリーディングカンパニーであるaudEERINGが、音声データから貴重な知見を抽出するための独自のアルゴリズムとリモートツールを紹介します。audEERINGのCTO兼共同創業者による講演では、研究における音声の役割やアルゴリズムの開発経緯について解説し、成功事例もご紹介します。 私たちの声に秘められた、まだ活用されていない可能性について考える、この示唆に富むセッションをぜひお見逃しなく。

UXにおける音声分析

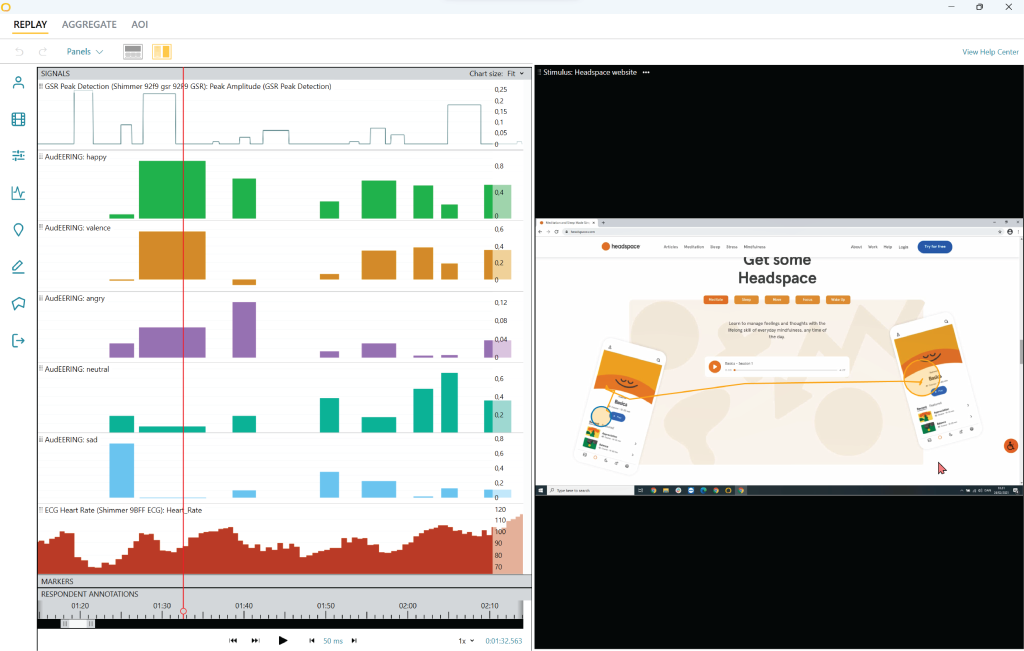

HCIと同様のアプローチは、UXデザインにも適用可能であり、実際に適用されています。特に「思考発話法」では、テストユーザーが新しくデザインされた製品を使用したり操作したりしながら、その考えを声に出して伝えます。対象となる製品は、ウェブサイトから実物製品、パッケージに至るまで多岐にわたりますが、これらはすべて、その製品を初めて目にする人物によって試用されます。ユーザーは、その過程で頭に浮かんだことをそのまま口にするだけです。

生体センサーは、ユーザーが口に出して語る以上の思考を理解するために、UXデザイナーの間ですでに広く活用されています。アイトラッキングや表情分析は、人々が実際に何に注目しているか、そしてその感情表現がそれにどう関連しているかについて、洞察を得るためのデータを提供してくれます。

音声分析は、この科学的進歩における次の論理的な段階であり、設計者が「思考発話法」の根本的な生物学的要素を検証することを可能にする。しかし、トロント大学とロチェスター工科大学の研究者らが指摘しているように、「思考発話セッションの分析は、多くの場合、時間がかかり、労力を要する」[15]。

研究者らはさらに、思考発話プロトコル中の発話を分析するための独自の機械学習手法を開発した。この際、audEERING社のdevAIceのような既成のモデルを活用すれば、時間を節約することも可能である。

研究者たちはすでに、表情分析と音声分析を組み合わせて[16]、「海軍艦艇における緊急事態」、「洪水(危機)状況」、「仮想現実ゲームに没頭しているプレイヤー」などを検証しており、今後の研究にとって有望な結果が得られている。また、他の研究者たちは、音声分析と「思考発話法」を併用し、ウェブベースの教育における学習効果の検証[17]や、ゲームプレイ体験の分析手法の確立[18]に取り組んでいる。

消費者神経科学における音声分析

UX開発における音声分析のアプローチは、消費者神経科学の分野で(必ずしも限定的ではないにせよ)しばしば用いられる手法と共通点がある。製品やプラットフォームが構築され、ユーザーがそれとの対話を行う。そして、その対話は、個々の瞬間ごとに「肯定的」「否定的」「中立的」のいずれかとして測定されるのである。

消費者神経科学やニューロマーケティングの文脈における音声分析の応用については、少なくとも1980年代から議論されてきた[20]――研究者たちは、それが「『誠実な』反応と『口先だけの』反応を区別できる」[21]と指摘していた――が、当時の研究には「不備のある研究手法があり、その結果として調査結果が過大評価されていた」。このため、より優れた計算機による分析手法(現在は容易に入手可能)と、音声データを収集するための研究デザインの再検討が必要となった。これが、現在見られるUX研究分野との重なりにつながったのである。

消費者神経科学の研究に参加する人々は、新製品や広告に触れた際、自発的に自分の考えを口に出さないかもしれませんが、思考発話法、インタビュー、フォーカスグループでの口頭での反応を分析することで、彼らの内面の思考や感情を理解する上で新たな視点が得られるのです。

音声分析の効果を最大限に引き出すためには、被験者が自然に話せる環境を整えることが極めて重要です。例えば、オンラインの美容・ファッション記事に関するある研究では、アイトラッキングや表情分析と併せて、音声データを評価するために「思考発話法」やインタビューが用いられています[19]。

広告に対する反応を音声分析によって調査することは可能ですが(インタビューなどと組み合わせて)、その逆もまた当てはまります。日本の東北大学による2019年の研究では、食品の広告を聞いた消費者は、声のピッチが高い場合、甘味や酸味の強い食品を好む傾向が強いことが明らかになりました[22]。

彼らは、「かなり高い」声のピッチが、甘い食べ物に対する特定の嗜好を促す可能性が高いことを発見した。これは、ニューロマーケターが、市場投入を支援する製品の共感をさらに理解し、高めるための新たな道筋を示している。

結論

音声分析は診断研究においては比較的確立された手法である一方、人間の行動指標を測定するツールとしては、これまでほとんど研究が進んでおらず、十分に活用されてきませんでした。 かつては、音声信号の分類や解読に多大な労力を要すること、また信頼性の高い手法が不足していたことがその要因であった。しかし、ソフトウェアの改良とAIの進歩により、今やこの手法が持つ真の可能性、すなわち人間の行動におけるこの核心的なシグナルを解き明かし、探求する可能性が見えてきた。

参考文献

[1] Muckey, F. S. (1915). 「発声の自然な方法」. 『The English Journal』, 4(10), 625. https://doi.org/10.2307/801210

[2] Friedman, M. (1969). 行動パターンの検出のための音声分析検査. JAMA, 208(5), 828. https://doi.org/10.1001/jama.1969.03160050082008

[3] Meyer Friedman; Carl E. Thoresen; James J. Gill; Diane Ulmer; Lynda H. Powell; Virginia A. Price; Byron Brown; Leonti Thompson; David D. Rabin; William S. Breall; Edward Bourg; Richard Levy; Theodore Dixon (1986年10月1日)。 「心筋梗塞後の患者におけるA型行動の変化と心疾患再発への影響:再発性冠動脈疾患予防プロジェクトの結果概要」。『American Heart Journal』112巻4号、653–665頁。doi:10.1016/0002-8703(86)90458-8。PMID 3766365。

[4] Petticrew, M. P., Lee, K., & McKee, M. (2012). タイプA行動パターンと冠動脈性心疾患:フィリップ・モリス社の「至宝」。American Journal of Public Health, 102(11), 2018–2025. https://doi.org/10.2105/ajph.2012.300816

[5] Wilmot, M. P., Haslam, N., Tian, J., & Ones, D. S. (2019). タイプA行動のタクソメトリック分析に関する直接的および概念的な再現研究。 Journal of personality and social psychology, 116(3), e12–e26. https://doi.org/10.1037/pspp0000195

[6] Romero Arias, T., Redondo Cortés, I., & Pérez Del Olmo, A. (2023). パーキンソン病患者の声に関する生体力学的パラメータ. Folia phoniatrica et logopaedica : International Association of Logopedics and Phoniatrics (IALP) 公式機関誌, 10.1159/000533289. オンライン先行公開。https://doi.org/10.1159/000533289

[7] Anzuino, I., Baglio, F., Pelizzari, L., Cabinio, M., Biassoni, F., Gnerre, M., Blasi, V., Silveri, M. C., & Di Tella, S. (2023). パーキンソン病における声によって伝達される感情の生成:基本周波数の変動性と感情的プロソディに関与する領域の灰白質体積との関連。Neuropsychology, 10.1037/neu0000912. オンライン先行公開。https://doi.org/10.1037/neu0000912

[8] Hecker, P., Steckhan, N., Eyben, F., Schuller, B. W., & Arnrich, B. (2022). 神経疾患の認識に向けた音声分析――系統的レビューと新たな動向に関する展望。 Frontiers in Digital Health, 4. https://doi.org/10.3389/fdgth.2022.842301

[9] Lin, C. W., Wang, Y. H., Li, Y. E., Chiang, T. Y., Chiu, L. W., Lin, H. C., & Chang, C. T. (2023). COVID-19に関連する発声障害および持続的なロングCOVIDの声の後遺症:系統的レビューおよびメタ分析。 American journal of otolaryngology, 44(5), 103950. https://doi.org/10.1016/j.amjoto.2023.103950

[10] Iyer, R., Nedeljkovic, M., & Meyer, D. (2022). 音声バイオマーカーを用いた成人テレヘルス利用者の自殺リスク分類:後ろ向き観察研究. JMIR mental health, 9(8), e39807. https://doi.org/10.2196/39807

[11] Habib, M., Faris, M., Qaddoura, R., Alomari, M., Alomari, A., & Faris, H. (2021). 音声ベースの遠隔医療相談の自動品質評価に向けて:ディープラーニングアプローチ. Sensors (Basel, Switzerland), 21(9), 3279. https://doi.org/10.3390/s21093279

[12] Jadczyk, T., Wojakowski, W., Tendera, M., Henry, T. D., Egnaczyk, G., & Shreenivas, S. (2021). パンデミック時の患者管理を改善する人工知能:音声技術の役割. Journal of medical Internet research, 23(5), e22959. https://doi.org/10.2196/22959

[13] Pereira, J., & Díaz, Ó. (2019). 行動変容のためのヘルスケア・チャットボットの活用:マッピング研究. Journal of Medical Systems, 43(5). https://doi.org/10.1007/s10916-019-1237-1

[14] Devaram, S. (2020). 共感型チャットボット:メンタルヘルスのウェルビーイングのための共感型チャットボットにおける感情知能。arXivプレプリント arXiv:2012.09130.

[15] Fan, M., Li, Y., & Truong, K. N. (2020). 思考発話セッションにおけるユーザビリティ上の問題の自動検出. ACM Transactions on Interactive Intelligent Systems, 10(2), 1–24. https://doi.org/10.1145/3385732

[16] Truong, K.P., Neerincx, M.A., & Leeuwen, D.A. (2008). 実環境における自発的な声や顔の感情表現の測定。

[17] Young, K. (2009). 「情報源からの直接的な情報:学習の理解における『思考発話』データの価値」。『The Journal of Educational Enquiry』, 6.

[18] Sykownik, P., Born, F., & Masuch, M. (2019). 「プレイヤーの声が聞こえますか?」:プレイヤーの発言に対する自動感情分析のためのパイプライン。2019 IEEE Conference on Games (CoG)。https://doi.org/10.1109/cig.2019.8848096

[19] Miclau, C., Peuker, V., Gailer, C., Panitz, A., & Müller, A. (2023). メディア・テクノロジー企業における美容・ファッション記事のオンラインマガジンにおける顧客エンゲージメントの向上. HCI in Business, Government and Organizations, 401–420. https://doi.org/10.1007/978-3-031-35969-9_27

[20] Brickman, G. A. (1980). 「声のピッチ分析の活用」. 『Journal of Advertising Research』, 20(2), 69-73.

[21] Klebba J. M. (1985). 研究における生理学的測定:脳活動、皮膚電気反応、瞳孔散大、および音声分析の手法と研究に関する総説。Curr. Issues Res. Advert. 8 53–76.

[22] Motoki, K., Saito, T., Nouchi, R., Kawashima, R., & Sugiura, M. (2019). 「甘い声:味覚と声の高さの間のクロスモーダル対応が広告効果に及ぼす影響」. Multisensory Research, 32(4-5), 401-427. https://doi.org/10.1163/22134808-20191365