Sensoren zur Messung der galvanischen Hautreaktion (GSR/EDA) haben Forschern dabei geholfen, emotionale Reaktionen auf vielfältige Weise zu erfassen [1]. In der Regel werden die GSR-Daten kurz nach einem Ereignis oder der Einwirkung eines Reizes ausgewertet, sobald die physiologischen Signale zu reagieren beginnen. Eine ereignisbezogene Hautleitfähigkeitsreaktion (ER-SCR) hat in Kombination mit anderen Messgrößen wie fEMG, der Analyse des Gesichtsausdrucks und der Herzfrequenz eine hohe Genauigkeit gezeigt.

Allerdings wurden sprachgesteuerte ER-SCR-Verfahren bislang noch nicht als mögliche Methode zur Emotionserkennung in Echtzeit untersucht. Die Kombination von galvanischer Hautreaktion und Sprache in der Echtzeitverarbeitung wurde kürzlich vom Human Augmentation Technologies Lab (HAT Lab) der Michigan State University untersucht.

Wir haben die Ehre, eine der Autorinnen dieser Methode, die Doktorandin Sylmarie Dávila-Montero, dazu zu interviewen, wie Hautleitfähigkeit (GSR) und Sprache unser Verständnis menschlicher Emotionen erweitern können.

Vorstellung von Sylmarie Dávila-Montero

Mein Name ist Sylmarie Dávila-Montero. Ich bin Doktorandin im Studiengang Elektrotechnik an der Michigan State University und arbeite im Human Augmentation Technologies (HAT) Lab unter der Betreuung von Dr. Andrew J. Mason.

Was macht das Human Augmentation Technology Lab?

Die übergeordnete Mission des „Human Augmentation Technologies Lab“ am College of Engineering der Michigan State University besteht darin, die Lücke zwischen Sensortechnologien und wegweisender biomedizinischer Forschung sowie Umweltanwendungen zu schließen. Unsere Forschungsgruppe hat traditionell Beiträge in den Bereichen Entwurf und Fertigung von Sensorsystemen geleistet, wobei der Schwerpunkt auf nanostrukturierten biologischen und chemischen Schnittstellen sowie auf einer hardwareeffizienten Echtzeit-Signalverarbeitung der Reaktionen von Sensoren und Sensorarrays liegt. In den letzten Jahren haben wir uns auf die Entwicklung von Ansätzen zur Verbesserung von Gehirn-Maschine-Schnittstellen und Mensch-Computer-Schnittstellen für biomedizinische und soziale Anwendungen konzentriert.

Was gehört zu Ihren Aufgaben?

Meine zentrale Forschungsfrage konzentriert sich darauf, wie wir Sensorsignale am besten in Echtzeit verarbeiten können, um menschliches Verhalten besser zu verstehen und zu erkennen, wie es soziale Interaktionen beeinflusst. Daher nutze ich in meiner Forschung Techniken der Echtzeit-Verarbeitung sozialer Signale und des maschinellen Lernens, um Zusammenhänge zwischen den erfassten Sensorsignalen und den untersuchten menschlichen Verhaltensweisen herzustellen. Diese Arbeit umfasst die Erfassung und Verarbeitung einer Vielzahl von Sensorsignalen, darunter Audiosignale und physiologische Signale. Ziel ist es, Systeme zu entwickeln, die in der Lage sind, menschliches Verhalten in Echtzeit und in realen Szenarien zu verstehen, um das Bewusstsein für menschliches Verhalten und die Qualität sozialer Interaktionen zu verbessern. Eine Verbesserung der Qualität unserer sozialen Interaktionen wirkt sich positiv auf unsere geistige und körperliche Gesundheit aus und hat somit einen positiven Einfluss auf unser Leben.

Wie setzen Sie iMotions ein, und welche Art von Biosensoren verwenden Sie in Ihrer Forschung?

Für meine Forschung setzen wir Biosensoren ein, um menschliche Emotionen und deren Veränderungen im Rahmen sozialer Interaktionen besser zu verstehen. Konkret verwenden wir Sensoren für die galvanische Hautreaktion (GSR), die Photoplethysmographie (PPG) und die Elektroenzephalographie (EEG) in Kombination mit Mikrofonen, um Daten zu physiologischen Emotionsindikatoren zu erfassen. Alle diese Biosensoren erfassen Signale aus physiologischen Prozessen, von denen bekannt ist, dass sie durch Veränderungen des emotionalen Zustands beeinflusst werden. Somit lassen sich Veränderungen in den Eigenschaften dieser Signale auf einen emotionalen Zustand zurückführen.

iMotions hat mir den Einstieg in meine Forschung erleichtert, da ich mich nicht um die Entwicklung einer Infrastruktur zur Erfassung von Sensordaten kümmern musste und sofort damit beginnen konnte, die für die Entwicklung meiner Algorithmen erforderlichen Daten zu sammeln. Darüber hinaus haben mir die Einführungsschulungen und Beratungsleistungen dabei geholfen, mich besser auf die Forschung im Bereich des menschlichen Verhaltens vorzubereiten.

Warum ist der Einsatz biometrischer Sensoren für Ihre Forschung wichtig?

Das Verständnis des emotionalen Zustands einer Person ist wichtig, wenn man nach Wegen sucht, soziale Interaktionen zu verbessern. Soziale Interaktionen sind äußerst komplex. Sie basieren auf dem Sozialverhalten von zwei oder mehr Personen. Gleichzeitig wird unser Sozialverhalten von internen und externen Reizen bestimmt. Interne Reize gehen von unserem Geist aus und umfassen beispielsweise unsere Emotionen, Stimmungen, Einstellungen und Persönlichkeit, während externe Reize Aspekte unserer Umgebung und die Art und Weise, wie wir miteinander kommunizieren, betreffen. Wir nutzen Biosensoren, um physiologische Signale zu erfassen, die mit Veränderungen unserer emotionalen Zustände zusammenhängen. Dies eröffnet uns einen Einblick in einen Teil jener inneren Reize, die unser Sozialverhalten beeinflussen.

In einer unserer jüngsten Veröffentlichungen haben wir den Zusammenhang zwischen Audiosignalen und elektrodermalen Reaktionen (EDA) untersucht und einen neuen Ansatz zur Klassifizierung von Hautleitfähigkeitsreaktionen analysiert, die durch emotionale Erregung ausgelöst werden, wobei Sprachsignale als auslösendes Ereignis dienten. EDA-Reaktionen stammen von Signalen, die mit GSR-Sensoren erfasst werden, wobei die Messungen die Veränderungen der Hautbeschaffenheit widerspiegeln, die durch Veränderungen der Schweißdrüsensekretion reguliert werden. Die Schweißsekretion, die vom sympathischen Nervensystem gesteuert wird, nimmt mit zunehmender emotionaler Erregung zu. Da EDA-Signale als guter Indikator für emotionale Erregung gelten, wurden sie in zahlreichen Arbeiten zur Vorhersage emotionaler Zustände herangezogen.

Inwiefern helfen Ihnen diese Instrumente dabei, Ihre Forschungsfragen zu beantworten?

Der Einsatz von Biosensoren hilft uns dabei, Veränderungen im emotionalen Zustand zu erfassen, die wir dann mit einem Ereignis während einer sozialen Interaktion in Verbindung bringen können. Diese Zuordnung nehmen wir mithilfe von Mikrofonen vor, die uns Informationen über externe Reize liefern, d. h. über die Kommunikationsdynamik, die während der sozialen Interaktion zu beobachten ist. Durch die Kombination von Biosensoren und Mikrofonen können wir relevante Informationen gewinnen, die es uns ermöglichen, Elemente sozialer Interaktionen zu beobachten.

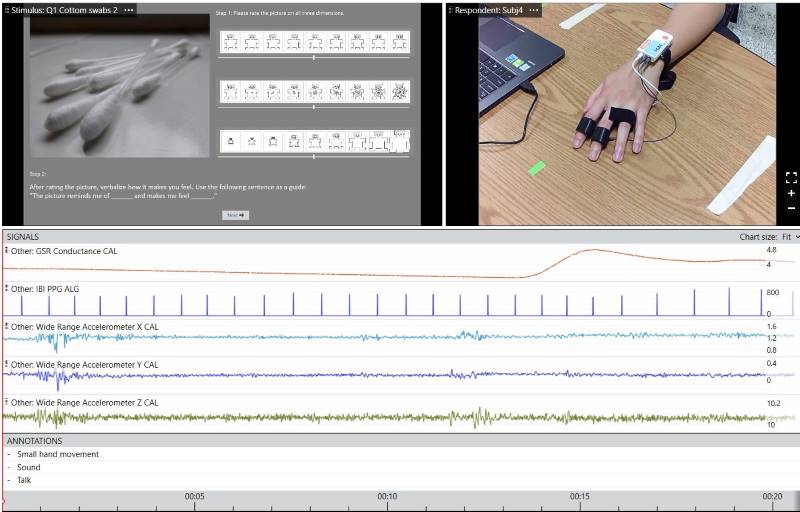

Um herauszufinden, wie wir Sensorsignale am besten in Echtzeit verarbeiten können, um menschliches Verhalten und dessen Auswirkungen auf soziale Interaktionen besser zu verstehen, haben wir zunächst damit begonnen, unsere Algorithmen anhand von zuvor aufgezeichneten Daten zu entwickeln. In unserer jüngsten Veröffentlichung haben wir die iMotions-Software verwendet, um gleichzeitig Audiosignale und EDA-Signale aufzuzeichnen. Die EDA-Signale wurden mithilfe des Shimmer3 GSR+-Sensors erfasst, der an der mittleren Fingerglied der Zeige- und Mittelfinger der nicht-dominanten Hand angebracht war.

Wir haben Audio- und EDA-Signale aufgezeichnet, während die Probanden verschiedene Bilder betrachteten und laut aussprachen, welche Gefühle das jeweilige Bild bei ihnen auslöste. Die Auswertung der gesammelten Daten deutete darauf hin, dass Sprache dazu genutzt werden könnte, um zu entscheiden, welche EDA-Reaktionen bei der Emotionserkennung berücksichtigt werden sollten, was zur Verbesserung von Algorithmen zur Emotionserkennung in Echtzeit beitragen könnte.

Sehen Sie sich das folgende Video an, in dem Sylmaries Forschungsarbeit zu GSR und Echtzeitüberwachung vorgestellt wird:

Wie sehen Sie die Zukunft der Forschung in Ihrem Fachgebiet?

Ich bin der Ansicht, dass mit dem wachsenden Bestreben, menschliches Verhalten in natürlichen Umgebungen zu verstehen, tragbare Sensoren zur Erfassung von Daten für die Forschung über unseren Körper und unsere Umgebung immer beliebter werden. Tragbare Sensoren, die emotionale Zustände in Echtzeit präzise erfassen können, könnten unter anderem den Nutzen in Anwendungen im Gesundheitswesen und bei der Interaktion am Arbeitsplatz erheblich steigern. Auf kommerzieller Ebene sehen wir bereits tragbare Geräte wie Fitbit und Amazon Halo [2], die in natürlichen Umgebungen Stresslevel anhand physiologischer Signale messen bzw. Emotionen mithilfe von Mikrofonen erfassen. Doch wie können wir diese Informationen am besten nutzen, um unsere sozialen Interaktionen mit anderen zu verbessern? Die Beantwortung dieser Frage wird wahrscheinlich umfangreiche zukünftige Forschungsarbeiten erfordern.

Warum haben Sie sich für iMotions entschieden?

Ich bin auf iMotions aufmerksam geworden, als ich nach Sensorgeräten für meine Forschung gesucht und nach einer Möglichkeit gesucht habe, alle für mich relevanten Daten synchron zu erfassen. Dabei habe ich erfahren, dass die iMotions-Software in der Lage ist, Video-, Audio- und Biosensorsignale in einer benutzerfreundlichen Umgebung zu synchronisieren.

Darüber hinaus bietet die iMotions-Software über ihr „Advance API“-Modul die Möglichkeit, neben den Standard-Biosensoren auch beliebige andere Geräte anzuschließen. Das war für mich besonders attraktiv, da ich die Freiheit haben wollte, jede Art von Sensor einzusetzen, die meiner Forschung zugutekommen könnte – einschließlich maßgeschneiderter Sensoren, die in unserem Labor entwickelt wurden. Somit bot iMotions mir die notwendigen Werkzeuge, die ich benötigte, um meine Forschung in Angriff zu nehmen.

Da Sprache und Audio als Teil von Reizen und als Mittel zum Verständnis emotionaler Reaktionen untersucht werden, eröffnet diese Methode zur Kodierung sprachausgelöster Ereignisse neue Möglichkeiten für die Erforschung des menschlichen Verhaltens.

iMotions hat erkannt, dass diese Funktion benötigt wird, um Audiosignale für eine Vielzahl von Anwendungen zu testen. Ab iMotions 8.1.6 haben Sie die Möglichkeit, Audiodateien als Stimulus zu importieren, wahlweise zusammen mit einem begleitenden Bild. Sie können ein Bild auswählen, das während der Wiedergabe des Tons angezeigt wird, oder sich ausschließlich auf den Ton als einzigen Stimulus konzentrieren.

Wir freuen uns darauf, die künftigen Forschungsarbeiten unserer Kunden am Human Augmentation Technologies Lab der Michigan State University zu verfolgen, die sich mit Wearable-Technologie und biomedizinischer Forschung befassen. Ihre Erkenntnisse werden zu künftigen Innovationen im Bereich des maschinellen Lernens und der Mensch-Maschine-Interaktion führen.

Quellenangaben:

[1] GSR und Emotionen: Was unsere Haut über unsere Gefühle verrät

[2] https://www.bloomberg.com/news/newsletters/2020-08-31/amazon-s-halo-wearable-can-read-emotions-is-that-too-weird