In diesem Artikel haben wir einen visuellen Leitfaden zusammengestellt, um die Leistungsfähigkeit des Facial Action Coding System (FACS) besser darzustellen. Alle Gesichtsaktionseinheiten werden mit Animationen vorgestellt, um ein Verständnis aus erster Hand und wertvolle Referenzpunkte für die Zukunft zu bieten. Wenn Sie also mit der Mimikanalyse (FEA) arbeiten, empfehlen wir Ihnen, diese Seite als Lesezeichen zu speichern – sie könnte Ihnen eine Menge Arbeit ersparen.

Das Facial Action Coding System

Das Facial Action Coding System (FACS) bezieht sich auf eine Reihe von Gesichtsmuskelbewegungen, die einer dargestellten Emotion entsprechen. Ursprünglich wurde es 1970 von Carl-Herman Hjortsjö mit 23 Gesichtsbewegungseinheiten geschaffen und anschließend von Paul Ekman und Wallace Friesen weiterentwickelt. Das FACS, wie wir es heute kennen, wurde erstmals 1978 veröffentlicht und 2002 grundlegend überarbeitet.

Mit FACS sind wir in der Lage, die gezeigten Emotionen eines Teilnehmers zu bestimmen. Diese Analyse der Gesichtsausdrücke ist eine der wenigen Techniken, die für die Bewertung von Emotionen in Echtzeit zur Verfügung stehen(eine weitere Möglichkeit ist das fEMG). Andere Maßnahmen, wie Interviews und psychometrische Tests, müssen nach der Präsentation eines Reizes durchgeführt werden. Diese Verzögerung ist letztlich ein weiteres Hindernis für die Messung der tatsächlichen Gefühle eines Teilnehmers als direkte Reaktion auf einen Reiz.

Lange Zeit waren die Forscher darauf beschränkt, die Videoaufnahmen der Teilnehmer manuell nach den vom FACS beschriebenen Handlungseinheiten zu kodieren. Dieser Prozess kann nun durch eine automatische Mimikanalyse ergänzt werden. Dies spart eine Menge Zeit und Geld, da die Auswertung nicht mehr die Analyse jedes einzelnen Bildes durch einen geschulten Forscher erfordert – die Software erledigt diese Arbeit einfach für Sie.

Im Folgenden haben wir die wichtigsten Aktionseinheiten aufgelistet, die zur Bestimmung von Emotionen verwendet werden. Fahren Sie mit der Maus über das Bild, um die Bewegung zu starten!

Table of Contents

Die 3 wichtigsten Vorteile der Gesichtskodierung

Die Kodierung von Gesichtern bietet mehrere wichtige Vorteile im Bereich der Emotionsanalyse und der Erforschung menschlichen Verhaltens:

- Nicht-intrusive Emotionsmessung: Die Gesichtscodierung ermöglicht eine nicht-intrusive und natürliche Emotionsmessung, da sie emotionale Ausdrücke in Echtzeit erfasst, ohne dass die Teilnehmer ihre Gefühle mündlich oder schriftlich mitteilen müssen. Dies ermöglicht authentischere und unvoreingenommenere Einblicke in emotionale Reaktionen.

- Hohe zeitliche Präzision: Die Gesichtscodierung bietet eine hohe zeitliche Präzision, die es den Forschern ermöglicht, Mikroausdrücke und subtile Veränderungen in der Mimik zu analysieren, die in Bruchteilen von Sekunden auftreten können. Diese Detailgenauigkeit ist wertvoll für das Verständnis der Dynamik emotionaler Reaktionen und ihrer Auslöser.

- Objektive und quantifizierbare Daten: Die Gesichtscodierung erzeugt objektive und quantifizierbare Daten und eignet sich daher sowohl für die Forschung als auch für kommerzielle Anwendungen. Durch die Umwandlung von Gesichtsausdrücken in numerische Daten können Forscher strenge statistische Analysen durchführen und Veränderungen der Emotionen im Laufe der Zeit verfolgen, was zu einem tieferen Verständnis des menschlichen Verhaltens und der Verbraucherpräferenzen beiträgt.

Hauptaktionseinheiten

| Aktionseinheit | Beschreibung | Gesichtsmuskel | Beispiel |

|---|---|---|---|

| 1 | Innerer Augenbrauenanheizer | Frontalis, Pars medialis |  |

| 2 | Äußere Augenbrauenanhebung (einseitig, rechts) | Frontalis, Pars lateralis |  |

| 4 | Brauenuntersetzer | Depressor Glabellae, Depressor Supercilli, Currugator |  |

| 5 | Obere Deckelanhebung | Levator palpebrae superioris |  |

| 6 | Wangenaufreißer | Augenhöhle (Orbicularis oculi), Pars orbitalis |  |

| 7 | Deckelspanner | Augenhöhle (Orbicularis oculi), Augenhöhle (Pars palpebralis) |  |

| 9 (zeigt auch leichte AU4 und AU10) | Nasenfaltenformer | Levator labii superioris alaquae nasi |  |

| 10 (zeigt auch leichte AU25) | Der Oberlippenschmeichler | Levator Labii Superioris, Caput infraorbitalis |  |

| 11 | Nasolabialer Vertiefungstank | Jochbein Minor |  |

| 12 | Lippeneckenzieher | Jochbein-Dur |  |

| 13 | Wangenpuffer | Levator anguli oris (Caninus) |  |

| 14 | Dimpler | Buccinator |  |

| 15 | Lippeneckenzieher | Depressor anguli oris (Triangularis) |  |

| 16 (mit AU25) | Unterlippendrücker | Unterer Schamlippendrücker (Depressor labii inferioris) |  |

| 17 | Kinnanheizer | Mentalis |  |

| 18 (mit leichten AU22 und AU25) | Lippenknutscher | Obere Schamlippen und untere Schamlippen |  |

| 20 | Lippenspanner | Risorius |  |

| 22 (mit AU25) | Lip Funneler | Augenhöhle (Orbicularis oris) |  |

| 23 | Lippenstraffer | Augenhöhle (Orbicularis oris) |  |

| 24 | Lippenpresser | Augenhöhle (Orbicularis oris) |  |

| 25 | Lippen teilen | Depressor Labii, Entspannung des Mentalis (AU17), Orbicularis Oris |  |

| 26 (mit AU25) | Kinnladen | Masetter; Temporale und innere Pterygoide entspannt |  |

| 27 | Mundpartie | Pterygoide, Digastricus |  |

| 28 (mit AU26) | Lippen lutschen | Augenhöhle (Orbicularis oris) |  |

| 41 | Herabhängen des Deckels | Entspannung des Levator Palpebrae Superioris |  |

| 42 | Schlitz | Augenhöhle (Orbicularis oculi) |  |

| 43 | Geschlossene Augen | Entspannung des Levator Palpebrae Superioris |  |

| 44 | Schielen | Augenhöhle (Orbicularis oculi), Augenhöhle (Pars palpebralis) |  |

| 45 | Blinken | Entspannung des Levator Palpebrae und Kontraktion des Orbicularis Oculi, Pars Palpebralis. |  |

| 46 | Wink | Levator palpebrae superioris; Orbicularis oculi, pars palpebralis |  |

Kopfbewegungs-Aktionseinheiten

| Aktionseinheit | Beschreibung | Beispiel |

| 51 | Kopf Links abbiegen |  |

| 52 | Kopf Rechts abbiegen |  |

| 53 | Kopf hoch |  |

| 54 | Kopf nach unten |  |

| 55 | Kopfneigung links |  |

| 56 | Kopfneigung rechts |  |

| 57 | Kopf vorwärts |  |

| 58 | Kopf zurück |  |

Augenbewegungs-Aktionseinheiten

| Aktionseinheit | Beschreibung | Beispiel |

| 61 | Die Augen wenden sich nach links |  |

| 62 | Augen nach rechts |  |

| 63 | Augen auf |  |

| 64 | Augen nach unten |  |

Emotionen und Handlungseinheiten

Die oben beschriebenen Aktionseinheiten zeigen die verschiedenen Bewegungen der Gesichtsmuskeln. Bestimmte kombinierte Bewegungen dieser Gesichtsmuskeln beziehen sich auf eine angezeigte Emotion. Die Erkennung von Emotionen erfolgt in iMotions mit Hilfe von Affectiva, das aus der Kombination bestimmter Aktionseinheiten Informationen darüber ableitet, welche Emotion angezeigt wird. So wird z. B. Freude aus der Kombination der Aktionseinheiten 6 (Wangen anheben) und 12 (Lippenwinkel ziehen) berechnet. Eine vollständige Liste dieser Kombinationen und der damit verbundenen Emotion finden Sie unten. Die Gifs auf der rechten Seite sind in der gleichen Reihenfolge wie die aufgelisteten Aktionseinheiten dargestellt.

| Emotionen | Aktionseinheiten | Beschreibung | Beispiele |

| Glück / Freude | 6 + 12 | Wangenanheber, Lippeneckenzieher |

|

| Traurigkeit | 1 + 4 + 15 | Innerer Augenbrauenheber, Brauensenker, Lippeneckenzieher |

|

| Überraschung | 1 + 2 + 5 + 26 | Innenbrauenanhebung, Außenbrauenanhebung, Oberlidanhebung, Kieferabsenkung |

|

| Furcht | 1 + 2 + 4 + 5 + 7 + 20 + 26 | Innenbrauenanhebung, Außenbrauenanhebung, Unterlidanhebung, Oberlidanhebung, Lidstraffung, Lippendehnung, Kieferabsenkung |

|

| Wut | 4 + 5 + 7 + 23 | Brauenunterzieher, Oberlidstraffer, Lidstraffer, Lippenstraffer |

|

| Ekel | 9 + 15 + 16 | Nasenfaltenformer, Lippeneckenzieher, Unterlippenzieher |

|

| Verachtung | 12 + 14 (auf einer Seite des Gesichts) | Lippeneckenzieher, Dimpler |

|

Alles zusammenfügen

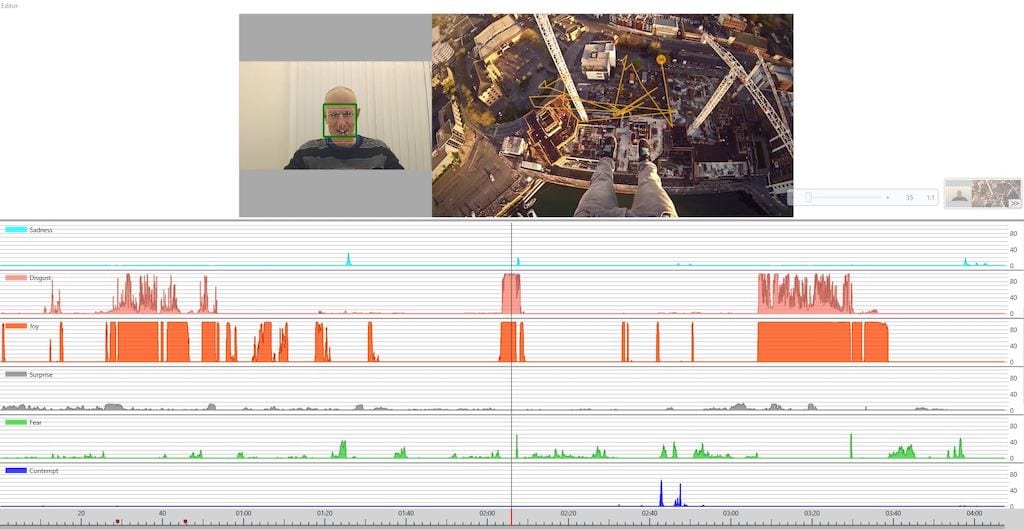

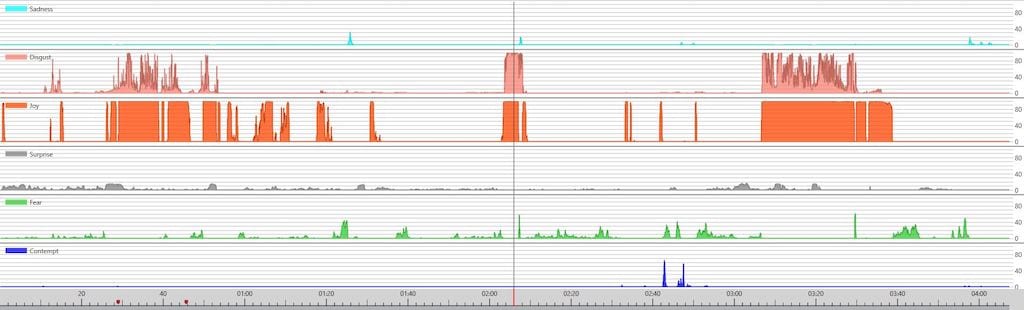

Bei der Messung von Gesichtsausdrücken in iMotions werden die Stimuli automatisch mit der FACS-Analyse verknüpft, so dass Sie den genauen Zeitpunkt bestimmen können, zu dem der Stimulus eine bestimmte Emotion ausgelöst hat. Die FACS wird außerdem auf einer Intensitätsskala eingestuft, die ein Maß dafür ist, wie stark die Emotion dargestellt wird. Diese Messungen können auch mit Aufzeichnungen der galvanischen Hautreaktion synchronisiert werden, die ein Maß für die Erregung darstellt. Aus der Kombination dieser Informationen lassen sich Rückschlüsse darauf ziehen, wie stark eine Person auf einen bestimmten Stimulus reagiert hat und worin diese Emotionen bestanden haben.

Die folgende Abbildung zeigt, wie die Mimikdaten angezeigt werden, während ein Teilnehmer eine Werbung ansieht.

Wenn wir das Bild vergrößern, können wir die Intensität der angezeigten Emotion sehen. In der Abbildung unten werden fünf Emotionen angezeigt. iMotions bietet jedoch eine Messung der sieben zentralen Emotionen (die in der Tabelle oben aufgeführt sind), neben und in Verbindung mit Messungen von Handlungseinheiten.

Beste Facial Action Coding System Software

Um die beste Software zur Codierung von Gesichtsbewegungen auszuwählen, sollten Sie zunächst Ihre Forschungsziele und Ihr Budget festlegen. Beurteilen Sie wesentliche Funktionen wie Echtzeitfunktionen, Interoperabilität und Benutzerfreundlichkeit. Informieren Sie sich über die Genauigkeit der Software, die Benutzergemeinschaft und den Ruf des Anbieters, und ziehen Sie, falls verfügbar, Demo- oder Testversionen in Betracht. Wählen Sie schließlich die Software aus, die Ihren spezifischen Forschungsanforderungen entspricht, den erforderlichen Support und die erforderlichen Schulungen bietet und in Ihr Budget passt.

Integriert in iMotions ist die Affectiva Emotion AI, eine hochspezialisierte Emotionserkennungstechnologie. Die Emotion AI Plattform wurde entwickelt, um menschliche Emotionen aus Gesichtsausdrücken zu verstehen und zu analysieren. Hier sind einige wichtige Funktionen und Details:

- Erkennung von Emotionen: Affectivas Emotion AI nutzt Deep Learning und Computer Vision, um Gesichtsausdrücke in Echtzeit zu erkennen und zu klassifizieren. Sie kann eine Reihe von Emotionen wie Freude, Überraschung, Ärger und mehr erkennen.

- Emotionsmetriken: Die Software liefert verschiedene Metriken in Bezug auf Emotionen, einschließlich Intensität, Valenz (positive oder negative Emotion) und Engagement-Level. Diese Daten können in der Marktforschung, der Werbung und der Analyse der Benutzererfahrung nützlich sein.

- Anwendungen in der realen Welt: Affectiva’s Emotion AI wird in einer Vielzahl von Branchen eingesetzt, darunter Marktforschung, Automotive (für Fahrerüberwachung und Sicherheit), Gesundheitswesen (für Patienten-Feedback und Engagement-Monitoring) und Mensch-Computer-Interaktion (zur Verbesserung der Benutzererfahrung in digitalen Anwendungen).

- Cloud-basierte Lösung: Affectiva bietet Cloud-basierte Lösungen, die in verschiedene Anwendungen und Plattformen integriert werden können und somit für Entwickler und Forscher zugänglich sind.

Häufig gestellte Fragen

Wie genau ist das System zur Kodierung von Gesichtsbewegungen?

Die Genauigkeit des Facial Action Coding System (FACS) hängt in hohem Maße von der Ausbildung und Erfahrung der Personen ab, die es anwenden. Wenn es von erfahrenen FACS-Kodierern unter kontrollierten Bedingungen angewendet wird, kann FACS eine hohe Genauigkeit bei der Kodierung von Gesichtsausdrücken erreichen. Die Genauigkeit kann jedoch in Abhängigkeit von Faktoren wie der Komplexität der Emotionen und der Qualität der Datenerfassung variieren.

Ist für die Verwendung des Facial Action Coding System (FACS) eine Schulung erforderlich?

Sowohl ja als auch nein, wenn Sie ein Experte werden wollen, dann ist eine Ausbildung sehr empfehlenswert und wird in der Regel auch gefördert, um das Facial Action Coding System (FACS) effektiv auf hohem Niveau zu nutzen. Wenn Sie eine Software wie Affectiva/iMotions verwenden, bei der die Software die Kodierung der visuellen Stimuli übernimmt, müssen Sie in der Regel kein Experte für FACS sein, um es zu verwenden.

Kann Facial Coding für die Erkennung von Emotionen in Echtzeitanwendungen verwendet werden?

Ja, Gesichtscodierung kann für die Echtzeit-Erkennung von Emotionen in Anwendungen wie Mensch-Computer-Interaktion, Marktforschung und affektive Datenverarbeitung verwendet werden. Fortschritte in der Computer Vision und der Gesichtserkennungstechnologie haben die Entwicklung von Echtzeit-Gesichtscodierungssystemen ermöglicht, die Gesichtsausdrücke analysieren können, während sie auftreten. Diese Systeme verwenden Algorithmen des maschinellen Lernens, um Emotionen auf der Grundlage der Bewegungen und Muster der Gesichtsmuskeln in Echtzeit-Videoströmen zu erkennen und zu klassifizieren. Die Erkennung von Emotionen in Echtzeit durch Gesichtscodierung findet Anwendung in Bereichen wie User Experience Design, virtuelle Realität und Analyse von Kundenfeedback.

Ich hoffe, dass diese Erklärung von Aktionseinheiten und FACS hilfreich und informativ war. Wenn Sie noch mehr über Mimik erfahren möchten, haben wir auch einen kostenlosen Pocket Guide, den Sie unten kostenlos herunterladen können!