Die Stimmungsanalyse befasst sich mit der Untersuchung von Stimmmerkmalen und -mustern in der gesprochenen Kommunikation. Dabei werden Elemente wie Tonhöhe, Klangfarbe, Sprechgeschwindigkeit und emotionale Signale untersucht, um Erkenntnisse über Aspekte wie Sprachwissenschaft, Emotionen und individuelle Eigenschaften zu gewinnen. Diese Technologie findet Anwendung in Bereichen wie der Sprachwissenschaft, der Psychologie und dem Gesundheitswesen.

Table of Contents

Stell dir vor, du bist in einem Land, in dem du noch nie zuvor warst. Du sprichst die Sprache nicht und verstehst sie schon gar nicht. Sie sprechen jemanden an, oder vielleicht spricht diese Person Sie an, und ehe Sie sich versehen, taucht sie tief in eine Reihe von Sätzen ein, die Sie unmöglich verstehen können. Nur dass Sie doch ein paar grundlegende Dinge verstehen. Der Kontext hilft natürlich dabei, das Gesagte einzuordnen, aber es gibt noch etwas anderes, das viel darüber verrät, was sonst noch vor sich geht – die Art und Weise, wie die Person spricht.

Was wir in diesem Moment tun, ist, die Stimme zu analysieren – wir nehmen Veränderungen in Tonfall, Sprachrhythmus, Tonhöhe (und mehr) wahr und können daraus schließen, ob die Person glücklich oder traurig, wütend oder interessiert ist. Diese Informationen verraten uns viel über den inneren Zustand der Person. Normalerweise muss man uns die Emotionen des Sprechers nicht ausdrücklich mitteilen – wir analysieren die Stimme automatisch und kennen die Antwort.

Dieses Phänomen – das wir heute als Stimmenanalyse bezeichnen – ist natürlich schon so lange bekannt, wie Menschen sprechen, und erste Versuche, die Stimmbildung zu messen, gibt es spätestens seit dem späten 20. Jahrhundert [1].

Dies wurde in den 1960er Jahren durch strenge wissenschaftliche Analysen weiter formalisiert [2], doch erst mit dem Aufkommen moderner Computertechnologien hat sich die Stimmenanalyse als wissenschaftliches Fachgebiet wirklich etabliert. Mit dem Aufkommen von KI-Methoden stehen wir nun am Beginn eines neuen Wandels in der Wissenschaft der Stimmenanalyse.

Doch was ist Stimmungsanalyse, und wie kann sie dazu beitragen, menschliche Emotionen und Verhaltensweisen besser zu verstehen? Und wie hilft dabei die KI? Im Folgenden werden wir einige der wichtigsten Anwendungsbereiche beleuchten, in denen die Stimmungsanalyse Forschern bereits dabei hilft, Fortschritte in der Gesundheitsforschung, der Mensch-Computer-Interaktion, der Benutzererfahrung (UX) und beim Verständnis von Entscheidungen wie beispielsweise Kaufabsichten zu erzielen.

Was ist Sprachanalyse?

Bei der Stimmenanalyse werden Stimmlaute gemessen und bestimmten Kennzahlen zugeordnet – beispielsweise Emotionen, Alter, Geschlecht oder das Vorhandensein bzw. Fehlen von Sprache. Entscheidend ist, dass die Stimmenanalyse keine direkten Informationen über die verwendeten Wörter liefert, sondern vielmehr über die Art und Weise, wie diese erzeugt wurden.

Bei diesem Verfahren wird der erzeugte Ton in Segmente unterteilt, und es werden verschiedene Merkmale extrahiert, die dann entweder einzeln oder gemeinsam ausgewertet werden können. Die verschiedenen Algorithmen funktionieren auf unterschiedliche Weise, doch in der Regel werden Merkmale wie Prosodie, Sprechgeschwindigkeit und Intonation erfasst und analysiert. Diese werden dann verwendet, um eine Vorhersage über höherdimensionale Eigenschaften der Sprache zu erstellen, beispielsweise darüber, ob die Person glücklich oder wütend ist.

Messungen sowohl der grundlegenden Mechanismen der Sprache als auch allgemeinerer emotionaler Aspekte liefern Erkenntnisse über menschliches Verhalten. Ein Bereich, in dem dieser Ansatz besonders vielversprechend ist, ist das Gesundheitswesen.

Stimmenanalyse im Gesundheitswesen

Die Analyse der Stimme im Gesundheitswesen bietet zwei wesentliche Vorteile. Erstens lässt sie sich fast mühelos als Datenform erfassen, da sie (mit Einwilligung) bereits beim ersten Kontakt aufgezeichnet werden kann. Zweitens ist sie ein vielversprechender Prädiktor für eine Vielzahl von neurologischen, psychiatrischen und stimmlichen Störungen.

Eine der ersten Studien, die den Zusammenhang zwischen Stimme und Physiologie untersuchte, wurde von Meyer Friedman durchgeführt, der die Theorie der Typ-A- und Typ-B-Persönlichkeiten bekannt machte [3]. Diese Theorie unterteilt Menschen grob in Typ-A- und Typ-B-Gruppen, wobei Typ-A-Persönlichkeiten eher als „wettbewerbsorientiert, sehr organisiert, ehrgeizig und ungeduldig“ und Typ-B-Persönlichkeiten eher als „entspannt, aufgeschlossen und weniger neurotisch“ beschrieben werden.

Die Forschungsgruppe stellte anhand eines Stimmungsanalysetests fest, dass sie Teilnehmer des Typs A und Herzpatienten von Teilnehmern des Typs B unterscheiden konnte. Daraus wurde geschlossen, dass sich Persönlichkeitstypen allein anhand der Stimme unterscheiden lassen.

Zwar wurde die Theorie der Typ-A- und Typ-B-Persönlichkeiten später zu Recht kritisiert und damit im Wesentlichen widerlegt (siehe beispielsweise [4 und 5]), doch war der Ansatz, die Stimme in Verbindung mit Krankheitsbiomarkern zu nutzen, bereits auf den Weg gebracht worden. So haben beispielsweise aktuelle Forschungsergebnisse gezeigt, wie biomechanische Elemente allein anhand einer App extrahiert und zur Erkennung der Parkinson-Krankheit herangezogen werden können [6].

In der Forschung wurden zudem Gehirnscans von Parkinson-Patienten herangezogen, um einen Zusammenhang zwischen Hirnschäden in Bereichen, die mit der Emotionsverarbeitung in Verbindung stehen, und emotionaler Sprache aufzuzeigen, wodurch ein direkter Zusammenhang zwischen Gehirn und Stimme im Rahmen dieser neurologischen Erkrankung hergestellt wurde [7].

Forschungsarbeiten haben gezeigt, dass die Stimme das Potenzial besitzt, Parkinson, Alzheimer, Depressionen, Amyotrophe Lateralsklerose (ALS), bipolare Störungen und sogar Long Covid zu erkennen [8, 9]. Die Methoden hinsichtlich Studiendesign, Aufzeichnung, Merkmalsextraktion und Analyse variieren zwar stark von Studie zu Studie, weisen jedoch alle in dieselbe Richtung – hin zu einer zuverlässigen Früherkennung von Faktoren, die sich auf die Gesundheit auswirken.

Mehrere Studien und Unternehmen haben das Potenzial der automatisierten Stimmenanalyse (AVCA) für zukünftige Anwendungen im Gesundheitswesen hervorgehoben. Letztendlich erweist sich die Stimmenanalyse als vielversprechende, kostengünstige und nahezu passive Methode zur Früherkennung und Diagnose einer Vielzahl von Krankheiten und Störungen.

Stimmenanalyse in der Mensch-Computer-Interaktion

Die Sprachanalyse bietet über die Früherkennung hinaus noch einen weiteren Ansatz zur Verbesserung der Gesundheitsversorgung – indem sie den Zugang zu und das emotionale Verständnis von Instrumenten der Gesundheitsversorgung erleichtert. Ein Beispiel hierfür ist die Telemedizin, insbesondere die Teletherapie.

Forschungsergebnisse deuten darauf hin, dass die Integration von Sprachanalysemethoden in die video- oder telefonbasierte Therapie den Therapeuten Daten liefert, die ihnen bei der Beurteilung des Patienten helfen können. Eine aktuelle Studie hat gezeigt, wie ein Suizidrisiko erkannt werden kann – was dem Therapeuten während des Gesprächs potenziell lebensrettende Informationen liefern könnte [10].

Andere Studien haben aufgezeigt, wie Arzt-Patienten-Interaktionen mithilfe von Sprachanalysemethoden leichter und objektiver bewertet werden können [11]. Dies kann Daten liefern, auf deren Grundlage evidenzbasierte Verbesserungsvorschläge für künftige Gespräche gemacht werden können.

Diese Technik lässt sich in ähnlicher Weise in Echtzeit auf therapeutische Chatbots anwenden. In verschiedenen Artikeln wurde erörtert, wie diese zunehmend verbreiteten Chatbots Methoden der Sprachanalyse integrieren können, um durch eine Bewertung, die über das bloße Gesagte des Patienten hinausgeht, Antworten zu ermöglichen, die besser auf die Bedürfnisse des Patienten abgestimmt sind [12, 13, 14].

Diese emotionale Intelligenz, die durch die Integration von Sprachanalyse ermöglicht wird, ist natürlich nicht allein auf therapeutische Kontexte beschränkt. Vielmehr kann jede systematische Interaktion, bei der ein Mensch spricht, wahrscheinlich von Daten profitieren, die das emotionale Bewusstsein der antwortenden Person – oder KI – schärfen.

Kostenloses Webinar am 13. November 2024 um 16:00 Uhr (UTC+1)

audEERING x iMotions: „Den Code der Stimme knacken“

Nehmen Sie an unserem Webinar teil und erfahren Sie, wie die Stimmenanalyse verborgene Einblicke in unsere Motivationen und Verhaltensweisen liefert. Seit dem Zweiten Weltkrieg hilft die Stimmenanalyse Unternehmen dabei, Stimmungen, Stress und den Gesundheitszustand zu verstehen. audEERING, ein führender Anbieter von Software zur Stimmenanalyse, stellt seinen Algorithmus und sein Fernzugriffstool vor, mit denen sich wertvolle Erkenntnisse aus Sprachdaten gewinnen lassen. Der CTO und Mitbegründer von audEERING wird die Rolle der Stimme in der Forschung erläutern, die Entwicklung des Algorithmus beschreiben und erfolgreiche Anwendungsbeispiele vorstellen. Verpassen Sie nicht diese zum Nachdenken anregende Sitzung über das unerschlossene Potenzial unserer Stimme.

Stimmenanalyse in der Benutzererfahrung

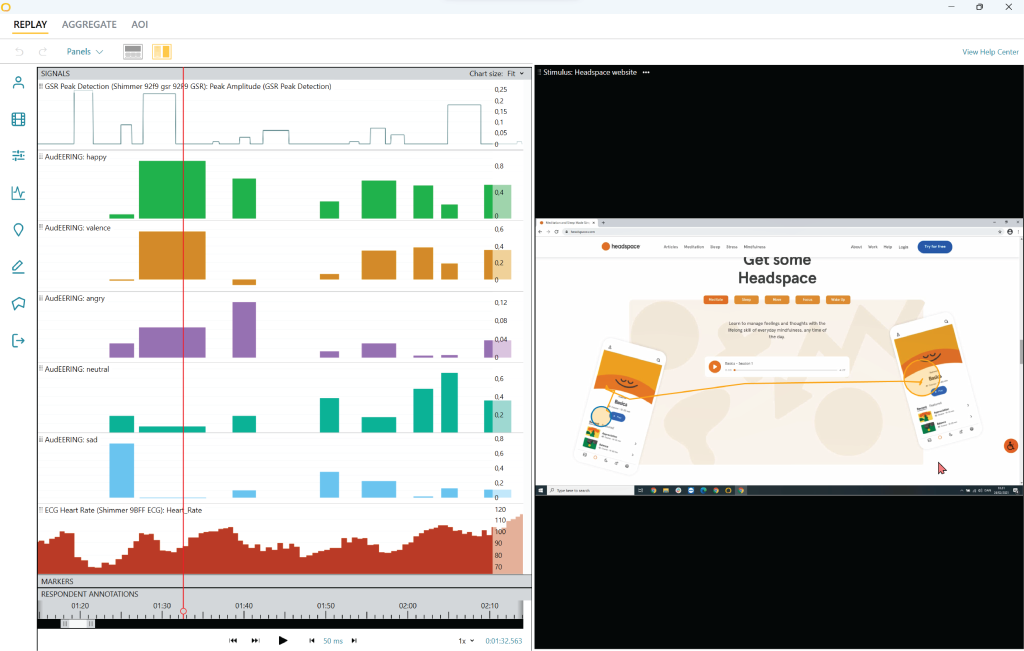

Ein ähnlicher Ansatz wie bei der HCI lässt sich auch auf das UX-Design anwenden – und wird dort auch genutzt. Dies gilt insbesondere für Think-Aloud-Protokolle, bei denen ein Testnutzer seine Gedanken laut ausspricht, während er ein neu gestaltetes Produkt nutzt oder durch dieses navigiert. Das Produkt – das von einer Website über einen physischen Gegenstand bis hin zu einer Verpackung reichen kann – wird von einer Person getestet, die es zuvor noch nicht gesehen hat. Der Nutzer schildert dabei einfach, was ihm während des Vorgangs in den Sinn kommt.

Biosensoren werden bereits in großem Umfang eingesetzt, um UX-Designern Einblicke in die Gedanken der Nutzer zu vermitteln, die über das hinausgehen, was diese lediglich laut aussprechen. Eye-Tracking und die Analyse von Gesichtsausdrücken liefern Daten, die Aufschluss darüber geben, worauf sich Menschen tatsächlich konzentrieren und in welchem Zusammenhang ihre emotionalen Ausdrucksformen damit stehen.

Die Sprachanalyse stellt den nächsten logischen Schritt in dieser wissenschaftlichen Entwicklung dar und ermöglicht es Designern, die grundlegende biologische Komponente von Think-Aloud-Protokollen zu untersuchen. Wie Forscher der University of Toronto und des Rochester Institute of Technology jedoch angemerkt haben, ist „die Analyse von Think-Aloud-Sitzungen oft zeitaufwendig und arbeitsintensiv“ [15].

Die Forscher entwickelten daraufhin eine eigene interne Methode des maschinellen Lernens zur Analyse der Äußerungen während des Think-Aloud-Protokolls – dabei lässt sich sogar Zeit sparen, indem man auf bereits verfügbare Modelle wie devAIce von audEERING zurückgreift.

Forscher kombinieren bereits die Analyse von Gesichtsausdrücken mit der Stimmenanalyse [16], um „Notfallsituationen auf einem Marineschiff“, „eine Hochwassersituation (Krise)“ und „Spieler, die in ein Virtual-Reality-Spiel vertieft sind“, zu untersuchen, und erzielen dabei vielversprechende Ergebnisse für die zukünftige Forschung. Andere Forscher haben die Stimmenanalyse in Verbindung mit Think-Aloud-Protokollen genutzt, um das Lernen im Rahmen webbasierter Bildung zu untersuchen [17] und Analysen der Spielerfahrung zu erstellen [18].

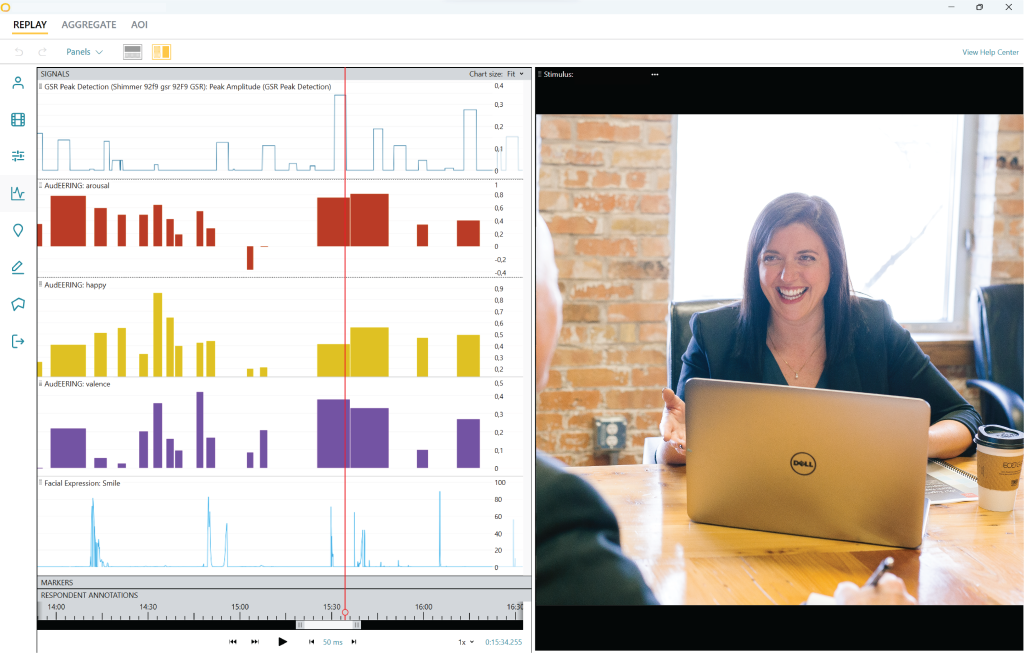

Stimmenanalyse in der Konsumenten-Neurowissenschaft

Der Ansatz, die Stimme im Rahmen der UX-Entwicklung zu analysieren, weist Überschneidungen mit der Vorgehensweise auf, wie sie häufig – wenn auch nicht ausschließlich – in der Konsumenten-Neurowissenschaft angewendet wird. Ein Produkt oder eine Plattform wird entwickelt, und ein Nutzer interagiert damit – diese Interaktion wird dann letztlich in einzelnen Momenten als positiv, negativ oder neutral bewertet.

Zwar wird die Anwendung der Stimmenanalyse im Rahmen der Konsumenten-Neurowissenschaft oder des Neuromarketings bereits seit mindestens den 1980er Jahren diskutiert [20] – wobei Forscher darauf hinwiesen, dass sie „die ‚aufrichtige‘ von der ‚vorgetäuschten‘ Reaktion unterscheiden kann“ [21] –, doch wurde auch festgestellt, dass die damalige Forschung „mangelhafte Forschungsinstrumente und eine daraus resultierende Überbewertung der Ergebnisse“ aufwies. Dies erforderte verbesserte computergestützte Analysemethoden (die heute leicht verfügbar sind) sowie eine Neubewertung der Studiendesigns zur Erfassung von Stimmdaten. Dies führte zu den Überschneidungen, die wir heute mit dem Bereich der UX-Forschung beobachten.

Auch wenn die Teilnehmer einer Studie im Bereich der Konsumenten-Neurowissenschaft ihre Gedanken beim Umgang mit einem neuen Produkt oder einer Werbung vielleicht nicht spontan äußern, eröffnet die Analyse ihrer verbalen Äußerungen während Think-Aloud-Sitzungen, Interviews und Fokusgruppen eine neue Dimension für das Verständnis ihrer inneren Gedanken und Gefühle.

Um das Potenzial der Sprachanalyse voll auszuschöpfen, ist es entscheidend, eine natürliche Umgebung zu schaffen, in der die Probanden sprechen können. Dies zeigt sich beispielsweise in einer Studie zu Online-Artikeln über Schönheit und Mode, in der neben Eye-Tracking und der Analyse von Gesichtsausdrücken auch „Think-aloud“-Verfahren und Interviews zur Auswertung der Sprachdaten eingesetzt wurden [19].

Zwar ist es möglich, Verbraucher mithilfe von Sprachanalysen in Reaktion auf Werbung zu untersuchen (in Kombination mit einem Interview oder Ähnlichem), doch gilt auch das Gegenteil. Eine Studie der Universität Tohoku in Japan aus dem Jahr 2019 ergab, dass Verbraucher, die sich Werbung für Lebensmittel anhörten, eher süße oder saure Speisen bevorzugten, wenn die Stimme eine hohe Tonlage hatte [22].

Sie stellten fest, dass eine „deutlich hohe“ Stimmlage wahrscheinlich eine besondere Vorliebe für süße Lebensmittel fördert. Dies zeigt einen weiteren Weg auf, wie Neuromarketer die Resonanz der Produkte, die sie auf den Markt bringen, besser verstehen und verbessern können.

Fazit

Obwohl die Stimmenanalyse in der diagnostischen Forschung eine relativ etablierte Methode ist, wurde sie im Bereich der Messung menschlichen Verhaltens bislang kaum erforscht und nur unzureichend genutzt. In der Vergangenheit lag dies an dem hohen Arbeitsaufwand, der für die Klassifizierung und Entschlüsselung von Stimm-Signalen erforderlich war, sowie am Mangel an zuverlässigen verfügbaren Methoden. Dank der Weiterentwicklung von Software und Fortschritten in der KI können wir nun jedoch das wahre Potenzial dieser Methode erkennen, das darin liegt, dieses zentrale Signal des menschlichen Verhaltens zu erschließen und zu erforschen.

Literaturverzeichnis

[1] Muckey, F. S. (1915). Die natürliche Methode der Stimmbildung. The English Journal, 4(10), 625. https://doi.org/10.2307/801210

[2] Friedman, M. (1969). Stimmanalysetest zur Erkennung von Verhaltensmustern. JAMA, 208(5), 828. https://doi.org/10.1001/jama.1969.03160050082008

[3] Meyer Friedman; Carl E. Thoresen; James J. Gill; Diane Ulmer; Lynda H. Powell; Virginia A. Price; Byron Brown; Leonti Thompson; David D. Rabin; William S. Breall; Edward Bourg; Richard Levy; Theodore Dixon (1. Oktober 1986). „Veränderung des Typ-A-Verhaltens und dessen Auswirkungen auf Herzrezidive bei Patienten nach einem Herzinfarkt: Zusammenfassung der Ergebnisse des Projekts zur Prävention von Koronarreizidiven“. American Heart Journal. 112 (4): 653–665. doi:10.1016/0002-8703(86)90458-8. PMID 3766365.

[4] Petticrew, M. P., Lee, K. & McKee, M. (2012). Typ-A-Verhaltensmuster und koronare Herzkrankheit: Philip Morris’ „Kronjuwel“. American Journal of Public Health, 102(11), 2018–2025. https://doi.org/10.2105/ajph.2012.300816

[5] Wilmot, M. P., Haslam, N., Tian, J., & Ones, D. S. (2019). Direkte und konzeptionelle Replikationen der taxometrischen Analyse des Typ-A-Verhaltens. Journal of Personality and Social Psychology, 116(3), e12–e26. https://doi.org/10.1037/pspp0000195

[6] Romero Arias, T., Redondo Cortés, I., & Pérez Del Olmo, A. (2023). Biomechanische Parameter der Stimme bei Patienten mit Parkinson-Krankheit. Folia phoniatrica et logopaedica: Offizielles Organ der Internationalen Vereinigung für Logopädie und Phoniatrie (IALP), 10.1159/000533289. Vorabveröffentlichung online. https://doi.org/10.1159/000533289

[7] Anzuino, I., Baglio, F., Pelizzari, L., Cabinio, M., Biassoni, F., Gnerre, M., Blasi, V., Silveri, M. C. & Di Tella, S. (2023). Erzeugung von durch die Stimme vermittelten Emotionen bei Parkinson: Zusammenhang zwischen der Variabilität der Grundfrequenz und dem Volumen der grauen Substanz in Regionen, die an der emotionalen Prosodie beteiligt sind. Neuropsychology, 10.1037/neu0000912. Vorab-Online-Veröffentlichung. https://doi.org/10.1037/neu0000912

[8] Hecker, P., Steckhan, N., Eyben, F., Schuller, B. W. & Arnrich, B. (2022). Stimmenanalyse zur Erkennung neurologischer Erkrankungen – Eine systematische Übersicht und Einblicke in neue Trends. Frontiers in Digital Health, 4. https://doi.org/10.3389/fdgth.2022.842301

[9] Lin, C. W., Wang, Y. H., Li, Y. E., Chiang, T. Y., Chiu, L. W., Lin, H. C. & Chang, C. T. (2023). COVID-bedingte Dysphonie und anhaltende Stimmfolgen bei Long-COVID: Eine systematische Übersicht und Metaanalyse. American Journal of Otolaryngology, 44(5), 103950. https://doi.org/10.1016/j.amjoto.2023.103950

[10] Iyer, R., Nedeljkovic, M. & Meyer, D. (2022). Einsatz von Stimmbiomarkern zur Einstufung des Suizidrisikos bei erwachsenen Nutzern von Telemedizin-Hotlines: Eine retrospektive Beobachtungsstudie. JMIR Mental Health, 9(8), e39807. https://doi.org/10.2196/39807

[11] Habib, M., Faris, M., Qaddoura, R., Alomari, M., Alomari, A. & Faris, H. (2021). Auf dem Weg zu einer automatischen Qualitätsbewertung sprachbasierter telemedizinischer Konsultationen: Ein Deep-Learning-Ansatz. Sensors (Basel, Schweiz), 21(9), 3279. https://doi.org/10.3390/s21093279

[12] Jadczyk, T., Wojakowski, W., Tendera, M., Henry, T. D., Egnaczyk, G. & Shreenivas, S. (2021). Künstliche Intelligenz kann das Patientenmanagement in Zeiten einer Pandemie verbessern: Die Rolle der Sprachtechnologie. Journal of Medical Internet Research, 23(5), e22959. https://doi.org/10.2196/22959

[13] Pereira, J., & Díaz, Ó. (2019). Einsatz von Gesundheits-Chatbots zur Verhaltensänderung: Eine Mapping-Studie. Journal of Medical Systems, 43(5). https://doi.org/10.1007/s10916-019-1237-1

[14] Devaram, S. (2020). Empathischer Chatbot: Emotionale Intelligenz für empathische Chatbots: Emotionale Intelligenz für psychisches Wohlbefinden. arXiv-Vorabdruck arXiv:2012.09130.

[15] Fan, M., Li, Y. & Truong, K. N. (2020). Automatische Erkennung von Usability-Problemen in Think-Aloud-Sitzungen. ACM Transactions on Interactive Intelligent Systems, 10(2), 1–24. https://doi.org/10.1145/3385732

[16] Truong, K.P., Neerincx, M.A. und Leeuwen, D.A. (2008). Messung spontaner stimmlicher und mimischer Emotionsausdrücke in realen Umgebungen.

[17] Young, K. (2009). Direkt aus erster Hand: Der Wert von „Think-aloud“-Daten für das Verständnis des Lernens. The Journal of Educational Enquiry, 6.

[18] Sykownik, P., Born, F. & Masuch, M. (2019). Can you hear the player Experience? Eine Pipeline zur automatisierten Stimmungsanalyse von Spieleräußerungen. IEEE-Konferenz über Spiele (CoG) 2019. https://doi.org/10.1109/cig.2019.8848096

[19] Miclau, C., Peuker, V., Gailer, C., Panitz, A. & Müller, A. (2023). Steigerung der Kundeninteraktion eines Online-Magazins für Beauty- und Modeartikel innerhalb eines Medien- und Technologieunternehmens. HCI in Business, Government and Organizations, 401–420. https://doi.org/10.1007/978-3-031-35969-9_27

[20] Brickman, G. A. (1980). Einsatzmöglichkeiten der Stimmhöhenanalyse. Journal of Advertising Research, 20(2), 69–73.

[21] Klebba, J. M. (1985). Physiologische Messverfahren in der Forschung: Ein Überblick über Methoden und Studien zu Gehirnaktivität, elektrodermaler Reaktion, Pupillenerweiterung und Stimmenanalyse. Curr. Issues Res. Advert. 8, 53–76.

[22] Motoki, K., Saito, T., Nouchi, R., Kawashima, R. & Sugiura, M. (2019). Eine sanfte Stimme: Der Einfluss intermodaler Zusammenhänge zwischen Geschmack und Stimmlage auf die Werbewirksamkeit. Multisensory Research, 32(4-5), 401–427. https://doi.org/10.1163/22134808-20191365