iMotions hat sich dem Bereich der Stimm- und Sprachanalyse zugewandt und bietet mit einer neuen Softwarefunktion und einem brandneuen Modul neue Möglichkeiten für die multimodale Stimmanalyseforschung. In diesem Artikel wird ausführlich erläutert, wie diese beiden Neuerungen neue, tiefgreifende Einblicke in die Erforschung des menschlichen Verhaltens liefern können.

Table of Contents

Wie die Leser unserer Blogs und die Abonnenten unseres Newsletters inzwischen wissen, hat iMotions begonnen, sich im Bereich der Stimmenanalyse zu engagieren. Als letzte Grenze des menschlichen Emotionsspektrums, die bei iMotions bislang noch nicht analysiert werden konnte, findet die menschliche Stimme nun ihren Platz in der Verhaltensforschung.

Sprach-zu-Text-Analyse

Im Juni haben wir bei iMotions den ersten Schritt in Richtung Sprach- und Stimmenanalyse unternommen, als wir unsere in Zusammenarbeit mit AssemblyAI entwickelte Funktion zur Sprach-zu-Text-Analyse eingeführt haben. Diese Funktion stellte für iMotions einen entscheidenden Wendepunkt im Bereich der Emotionsanalyse dar, da sie unseren ersten offiziellen Vorstoß in den Bereich der Stimmenanalyse darstellte.

Die Sprach-zu-Text-Funktion ist ein vielseitiges Werkzeug, das die Sprachanalyse vereinfacht, indem es den mühsamen und zeitaufwändigen Prozess der Transkription von Audio- und Videoaufnahmen automatisiert und gleichzeitig den Wörtern im Inhalt emotionale Kennzeichnungen zuweist.

Die Audio-Intelligence-Software von AssemblyAI, auf der die Funktion von iMotions basiert, ist eine hochmoderne Plattform, die auf die Verarbeitung und das Verständnis von Audiodaten spezialisiert ist. Mithilfe fortschrittlicher Algorithmen des maschinellen Lernens kann sie gesprochene Worte aus Audioaufnahmen mit beeindruckender Genauigkeit transkribieren, was sie zu einem unschätzbaren Werkzeug für Branchen wie Transkriptionsdienste, Content-Erstellung und Kundenservice macht.

Darüber hinaus geht die Audio-Intelligence-Software von AssemblyAI über die reine Transkription hinaus und bietet Funktionen wie Sprechererkennung, Stimmungsanalyse und Schlüsselwort-Extraktion, wodurch wertvolle Erkenntnisse aus gesprochenen Inhalten gewonnen werden können.

Diese Erweiterung der ohnehin schon umfangreichen iMotions-Funktionsbibliothek ist für Forscher, Unternehmen und Pädagogen von unschätzbarem Wert. Die Sprach-zu-Text-Analyse ermöglicht die schnelle und präzise Extraktion emotionaler Erkenntnisse aus gesprochenen Inhalten und liefert dabei gleichzeitig eine praktische, in Abschnitte unterteilte Transkription. Damit können Sie emotional aufgeladene Wörter in einem Interview, einem Vortrag oder einer Kundenservice-Interaktion mühelos lokalisieren und kategorisieren. Diese Funktion ermöglicht es Anwendern, emotionale Auslöser zu identifizieren, Stimmungen einzuschätzen und zugrunde liegende emotionale Dynamiken in Gesprächen und Inhalten aufzudecken – und das alles innerhalb der benutzerfreundlichen iMotions-Software.

Das Sprachanalysemodul

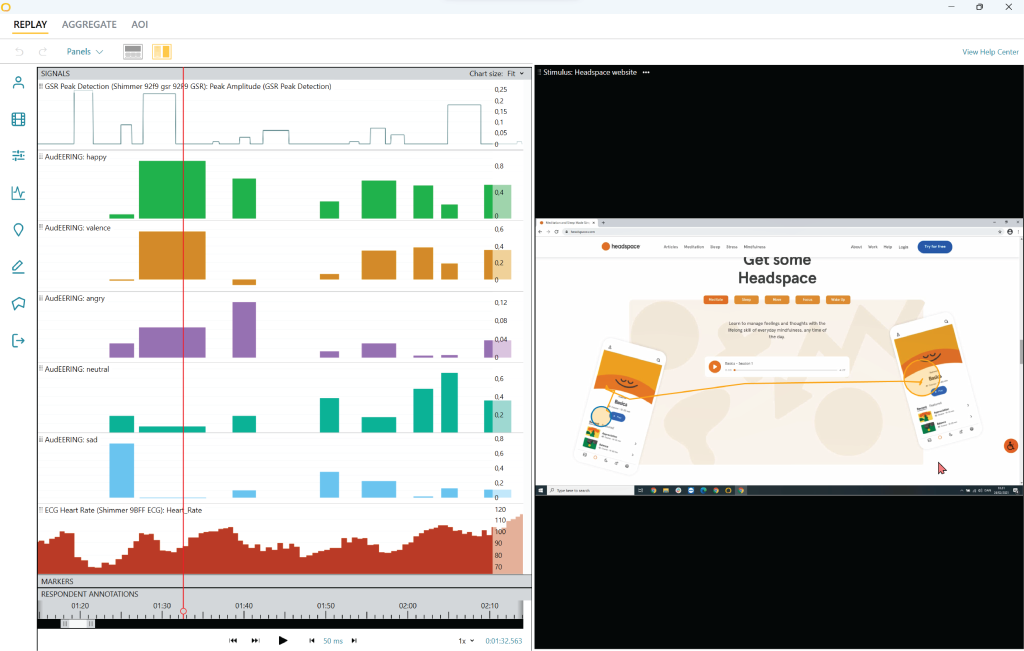

Die Sprach-zu-Text-Analyse war jedoch nur der erste Schritt, denn wir haben uns nach dem Erfolg dieser Technologie nicht auf unseren Lorbeeren ausgeruht. Stattdessen haben wir mit der Einführung unseres neuen Sprachanalyse-Moduls, das in Zusammenarbeit mit audEERING entwickelt wurde, den nächsten und weitaus bedeutenderen Schritt in den Bereich der Hör- und Sprachanalyse gewagt.

Dieses Modul nutzt die einzigartigen akustischen Eigenschaften der menschlichen Stimme. Es setzt modernste Algorithmen des maschinellen Lernens ein, um Aspekte wie Tonhöhe und Betonung in der Stimme eines Sprechers zu analysieren. Diese akustischen Merkmale stehen in direktem Zusammenhang mit der emotionalen Valenz der Sprache – also der zugrunde liegenden positiven oder negativen Ausrichtung einer Emotion.

Basierend auf openSMILE 3.0

Das neue Sprachanalysemodul integriert die devAIce-Plattform von audEERING, die auf der renommierten Software openSMILE 3.0 basiert.

Die Software openSMILE ist ein Open-Source-Toolkit zur Audio- und Sprachverarbeitung, das an der Technischen Universität München von einem Team entwickelt wurde, das heute bei audEERING tätig ist. Es dient dazu, eine Vielzahl von Audio-Merkmalen und Informationen aus Audiosignalen zu extrahieren. Zu diesen Merkmalen gehören akustische, prosodische und übergeordnete Deskriptoren, was es zu einem wertvollen Werkzeug für Aufgaben wie Sprachanalyse, Emotionserkennung, Sprecheridentifikation und vieles mehr macht. openSMILE wird in der akademischen Forschung (zitiert in Tausenden von begutachteten Publikationen) und in der Industrie zur Verarbeitung von Audiodaten weit verbreitet eingesetzt und ermöglicht die Entwicklung von Anwendungen in Bereichen wie der Verarbeitung natürlicher Sprache, dem Audio-Mining und der Mensch-Computer-Interaktion.

Durch die Integration des Sprachanalysemoduls in das iMotions-Ökosystem erhalten Nutzer die beispiellose Möglichkeit, die emotionalen Zustände von Sprechern in Audioaufnahmen einzuschätzen. Dieser Fortschritt ist geradezu revolutionär. Er eröffnet eine neue Ebene des emotionalen Verständnisses, indem er über den reinen Textinhalt hinaus die feinen Nuancen der Sprachausgabe analysiert.

Die Kraft der Integration: Ein ganzheitlicher Ansatz

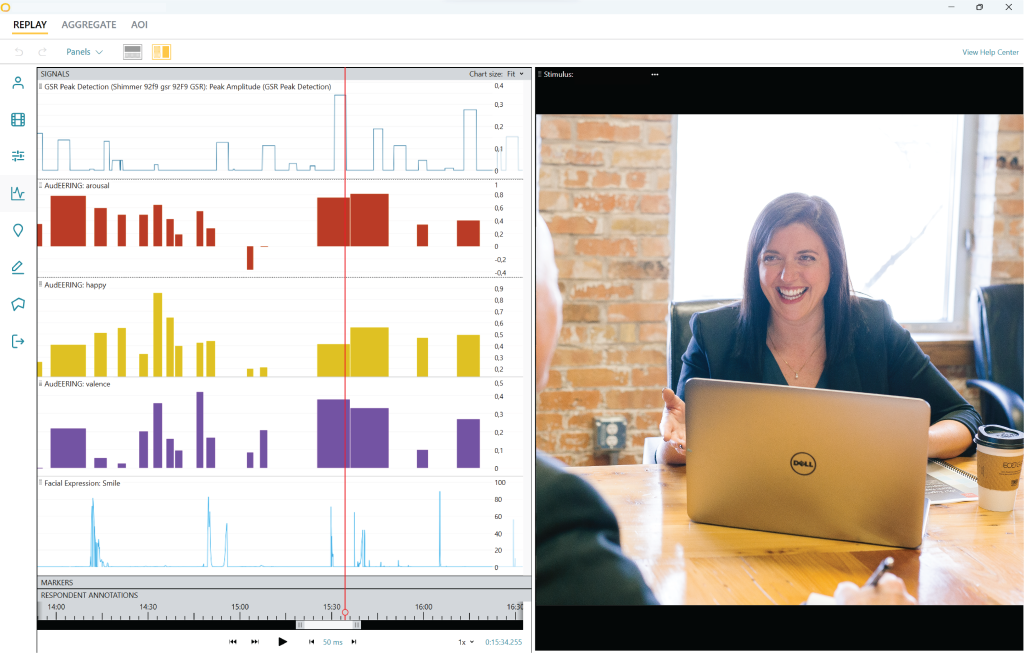

iMotions bietet eine umfassende Methode zur Analyse von Emotionen in der gesprochenen Sprache, indem es die Sprach-zu-Text-Analyse mit dem Sprachanalyse-Modul kombiniert. So wie Mimik mehr aussagen kann als Worte, kann auch die Art und Weise, wie wir über bestimmte Themen sprechen, je nach Kontext, Gesprächspartner oder Thema variieren. Diese Unterschiede können zu unerwarteten Interpretationen der Daten führen.

Beispielsweise können Menschen Humor einsetzen, um ernste Themen wie Tod oder Krankheit anzusprechen, was es für Software schwierig macht, diese Inhalte genau zu kategorisieren. In solchen Fällen ist es von Vorteil, über Tools zur Datenvalidierung zu verfügen. Als Forscher können Sie sowohl das Sprachanalysemodul zur Emotionserkennung in Echtzeit als auch die Erkennung der emotionalen Valenz in unserer Sprach-zu-Text-Funktion nutzen. So können Sie sowohl hören als auch sehen, wie die Teilnehmer auf Fragen reagieren oder bestimmte Themen angehen.

Forschern und Fachleuten steht nun ein vielseitiges Instrumentarium zur Verfügung, mit dem sie emotionale Inhalte in der gesprochenen Sprache analysieren können. Die Sprach-zu-Text-Analyse deckt emotionale Aspekte innerhalb der textuellen Komponenten der Sprache auf, während das Stimmanalysemodul den emotionalen Unterton untersucht, der durch die Stimme des Sprechers vermittelt wird, einschließlich Tonfall und Betonung. Diese Kombination ermöglicht ein tieferes und umfassenderes Verständnis der emotionalen Kommunikation.

Auswirkungen auf verschiedene Branchen

Die Auswirkungen dieser integrierten Funktionen sind weitreichend und erstrecken sich über verschiedene Branchen

Biomarker: Biomarker, also subtile Indikatoren im Körper, werden zunehmend in Verbindung mit Stimm- und Sprachanalysen erforscht, um das Gesundheitswesen zu revolutionieren. Dieser innovative Ansatz verspricht eine frühzeitigere Erkennung von Krankheiten und individuellere Behandlungsstrategien.

Mensch-Computer-Interaktion: Da sich die Telediagnostik im Gesundheitswesen zunehmend durchsetzt und sowohl die Beurteilung der körperlichen als auch der psychischen Gesundheit umfasst, spielen die Stimm- und Sprachanalyse eine entscheidende Rolle bei der Gestaltung der Mensch-Computer-Interaktion in diesem Bereich. Die Stimm- und Sprachanalyse bietet eine vielseitige und nicht-invasive Möglichkeit, wertvolle Gesundheitsdaten aus der Ferne zu erfassen, was sie im Kontext von Telemedizin und Teletherapie besonders wertvoll macht.

UX: Im Bereich UX, insbesondere bei Think-Aloud-Protokollen, bei denen Nutzer ihre Gedanken während der Interaktion mit einem neuen Produkt laut aussprechen, liefern Stimm- und Sprachanalysen wertvolle Erkenntnisse für UX-Designer. Biosensoren wie Eye-Tracking und die Analyse von Gesichtsausdrücken gehen über verbales Feedback hinaus und zeigen, worauf sich Nutzer konzentrieren und wie sich ihre Emotionen entwickeln. Die Stimmanalyse stellt die nächste Herausforderung dar und befasst sich mit den biologischen Aspekten von Think-Aloud-Protokollen.

Psychische Gesundheit: Therapeuten können tiefere Einblicke in die Gefühlslage ihrer Patienten gewinnen, indem sie sowohl die gesprochenen Worte als auch die Art und Weise, wie sie gesprochen werden, analysieren.

Bildung: Lehrkräfte können besser auf die Studierenden eingehen, wenn sie die emotionale Dynamik in Online-Vorlesungen mithilfe von Text- und Sprachanalysen besser verstehen.

Kommunikation: Wissenschaftler und Forscher können die menschliche Kommunikation eingehender untersuchen und dabei das komplexe Zusammenspiel von Text und Stimme bei der Vermittlung von Emotionen beleuchten.

Marketing und Werbung: Marketingfachleute können ihre Kampagnen optimieren, indem sie nicht nur emotional aufgeladene Wörter in Anzeigen analysieren, sondern auch untersuchen, wie der Tonfall eines Sprechers die emotionale Wirkung beeinflusst. Marketingfachleute und Werbetreibende können zudem Sprachanalysen und Sprach-zu-Text-Verfahren sinnvoll einsetzen, um die Fokusgruppen oder qualitativen Interviews zu validieren, die sie im Rahmen ihrer Forschung durchführen.

Diagnostik im Gesundheitswesen: Die Stimmenanalyse kann als leistungsstarkes Diagnosewerkzeug im Gesundheitswesen eingesetzt werden, indem künstliche Intelligenz und maschinelles Lernen genutzt werden, um subtile Stimmveränderungen zu erkennen, die mit verschiedenen Erkrankungen in Verbindung stehen. Durch die Analyse von Tonhöhe, Klangfarbe, Rhythmus und Sprachmustern können Stimmbiomarker dabei helfen, neurologische Erkrankungen wie die Parkinson-Krankheit, psychische Erkrankungen wie Depressionen und Angstzustände sowie sogar Atemwegserkrankungen zu erkennen.

Die Früherkennung durch Stimmenanalyse ermöglicht ein rechtzeitiges Eingreifen und verbessert so die Behandlungsergebnisse für die Patienten. Diese nicht-invasive, kostengünstige Technologie ist vielversprechend für die Fernüberwachung, die Telemedizin und personalisierte Behandlungspläne. Sie macht die Gesundheitsversorgung zugänglicher und effizienter und verringert gleichzeitig die Abhängigkeit von herkömmlichen Diagnosemethoden.

Fazit

Unser Weg von der Sprach-zu-Text-Analyse zum Sprachanalyse-Modul stellt einen Meilenstein im Bereich der Emotionsanalyse von Sprache dar. Die Integration dieser Funktionen bietet einen umfassenden Ansatz zum Verständnis des emotionalen Ausdrucks in der Sprache und ermöglicht es Anwendern aus verschiedenen Branchen, neue Erkenntnisse zu gewinnen, fundierte Entscheidungen zu treffen und eine effektivere Kommunikation zu fördern. Dieser Weg unterstreicht das Engagement von iMotions, die Grenzen der Emotionsanalysetechnologie zu erweitern, sowie unser starkes Bekenntnis, unseren Anwendern leistungsstarke Werkzeuge zur Verfügung zu stellen.