Das Eye-Tracking hat sich von frühen mechanischen Aufbauten zu modernen, bildschirmbasierten, mobilen und VR-Systemen weiterentwickelt. Heutige Software wie iMotions integriert über 30 Tracker, unterstützt Blickverfolgung, AOIs und synchronisierte Biosensoren und verarbeitet Stimuli von Desktop-Computern bis hin zu Mobilgeräten. Forscher können Aufmerksamkeit, Blickfixationen und Verhalten mithilfe von Heatmaps, Exportfunktionen und Anmerkungen analysieren und schaffen so eine nahtlose, multimodale Plattform für die Erforschung menschlichen Verhaltens.

Table of Contents

Eye-Tracking ist eine Methode mit einer über hundertjährigen Geschichte. Seit den Anfängen der „Follow-the-Speck-on-the-Eye“-Methode hat sich viel verändert, und bei den meisten heutigen Versuchen sitzt man einfach bequem vor einem Tracker von der Größe einer Schokoriegel. Es liegt auf der Hand, dass die Hardware benutzerfreundlicher, schneller und leistungsfähiger geworden ist, aber auch die Software hat viele Veränderungen durchlaufen.

Die Geschichte der Eye-Tracking-Software reicht zwar nicht so weit zurück wie die der Hardware, folgt aber einem ähnlichen Verlauf – angefangen bei einfachen, aber funktionalen Lösungen bis hin zu dem, was wir heute haben: benutzerfreundlicher, schneller, besser. Während die Software früher lediglich die wesentlichen Rohdaten lieferte, ist es heute möglich, mit wenigen Klicks viel weiter zu gehen.

iMotions bietet eine vollständig flexible Plattform für die Erforschung menschlichen Verhaltens, einschließlich Softwaremodulen für bildschirmbasiertes Eye-Tracking, Eye-Tracking-Brillen und Eye-Tracking in VR (sowie viele weitere Modalitäten). Im Folgenden haben wir die wichtigsten Funktionen unseres Moduls für bildschirmbasiertes Eye-Tracking aufgeführt. Wir verfügen vielleicht nicht über jede erdenkliche Softwarefunktion (wir können Sie (noch) nicht zum Mond schicken, und an dem „Abschluss“-Button arbeiten wir noch), aber wir glauben, dass wir dem schon ziemlich nahe kommen. Wenn Sie mehr erfahren und sich ein umfassendes Bild von der Software machen möchten, wenden Sie sich an einen unserer Experten.

Integrationen

An die iMotions-Software lassen sich über 30 verschiedene bildschirmbasierte Eye-Tracker anschließen. Dazu gehören Tracker von führenden Unternehmen wie Smart Eye, EyeTech und Gazepoint, aber auch Eye-Tracker von Firmen, die inzwischen übernommen wurden und keine Hardware mehr herstellen (z. B. SMI, aber auch andere). Dies bietet Ihnen je nach Ihren Anforderungen ein hohes Maß an Flexibilität – sei es in Bezug auf Abtastrate, Genauigkeit, Abdeckung oder Kosten.

Die Software bietet für alle bildschirmbasierten Eye-Tracker dieselben Funktionen, sodass Analysemethoden wie das Gaze-Mapping auch dann durchgeführt werden können, wenn diese beim jeweiligen Eye-Tracker nicht zum Standard gehören.

Blickverfolgung

Beim Gaze-Mapping werden dynamische visuelle Reize – wie beispielsweise eine Website – in ein einziges Bild umgewandelt, auf dem die Blickbewegungen mehrerer Teilnehmer zusammengefasst werden können. Es liefert eine einheitliche Ansicht, auf deren Grundlage Heatmaps erstellt und andere Kennzahlen berechnet werden können.

Diese Analysemethode ist hilfreich, wenn man die Sehgewohnheiten oder Aufmerksamkeitsprozesse mehrerer Betrachter verstehen möchte, selbst wenn diese den Stimulus zu unterschiedlichen Zeitpunkten auf unterschiedliche Weise wahrnehmen. (In diesem Blogbeitrag erläutern wir einige der Grundlagen des Gaze-Mappings.)

Umfassende Versuchsplattform

iMotions deckt nahezu jeden Schritt des Versuchsablaufs ab – von der Versuchsplanung (Reihenfolge der Stimuli, Teilnehmerdaten, Gruppeneinteilung) über die Stimuluspräsentation (mehr dazu weiter unten) bis hin zur Datenerfassung, -verarbeitung und zum Datenexport. Je nach Ihren Anforderungen bietet iMotions möglicherweise auch alle Analysefunktionen, die Sie benötigen – Heatmaps und Blickverfolgungs-/Fixationsaufzeichnungen (sowohl für einzelne Teilnehmer als auch für Teilnehmergruppen) werden automatisch generiert.

Das bedeutet, dass das gesamte Experiment in iMotions durchgeführt werden kann – es ist keine separate Software erforderlich, um die Stimuluspräsentation, die Eye-Tracker-Aufzeichnung oder die Verwaltung der Teilnehmergruppen zu übernehmen. Dadurch wird der Ablauf besonders effizient und einfach, insbesondere bei Experimenten mit mehreren Teilnehmern.

Reizarten

Das Modul zur Bildschirm-Eye-Tracking-Messung ermöglicht die Erfassung der Blickbewegungen beim Betrachten beliebiger bildschirmbasierter Reize. Dazu gehören Bilder, Videos, Websites, Spiele und Software – egal ob auf einem Desktop-Computer, einem Tablet oder einem Mobiltelefon. Das bedeutet, dass die visuellen Reaktionen der Teilnehmer auf praktisch alles getestet werden können – sei es die Ermittlung der Anzahl der Fixationen, die ein Arzt bei der Beurteilung einer Röntgenaufnahme auf einem Bildschirm vornimmt, eine Heatmap von Verbrauchern, die sich neue Produktdesigns ansehen, oder die blinden Flecken, die Spieler beim Durchspielen eines Spiels zeigen.

Daten und Analyse

iMotions bietet eine Reihe von Datenausgaben, die bei der Auswertung der visuellen Aufmerksamkeit der Teilnehmer helfen. Dazu gehören die unverzichtbaren Fixationen, Blickpunkte und Heatmaps sowie weitere berechnete Kennzahlen. (Einen Blogbeitrag, der viele dieser Kennzahlen behandelt, finden Sie hier).

Zu diesen Messgrößen gehören unter anderem die Dauer der ersten Fixation, die durchschnittliche Fixationsdauer sowie die Möglichkeit, Bereiche von Interesse (AOIs) zu definieren. AOIs können in beliebiger Form als Kontur über jedem beliebigen Stimulus platziert werden – sei es ein Bild, ein Video, ein Spiel usw. Diese liefern über 30 Messgrößen in Bezug auf Augenbewegungen, Größe und Position.

R-Notebooks führen auf der Grundlage der vom Eye-Tracker gelieferten Daten unter anderem eine Blinzelerkennung durch. Zudem lassen sich synchronisierte Informationen zur Computernutzung erfassen, wie beispielsweise Mausklicks und Tastenanschläge – was besonders nützlich ist, wenn die Interaktion mit dem Computer mit den Biosensordaten in Verbindung gebracht werden soll.

Nicht alle Daten sind gleichwertig – es kann Teile der Analyse geben, die ausgelassen oder genauer betrachtet werden sollten. Vielleicht möchten Sie nur bestimmte Teile der Daten exportieren und den Rest ignorieren. iMotions bietet ein Annotationswerkzeug, das entweder live während der Datenerfassung oder nach der Datenerfassung verwendet werden kann. Es ist ganz einfach, die Daten zu markieren und bestimmte Segmente für die weitere Verarbeitung oder den Export auszuwählen.

Weitere Integrationen

iMotions bietet zudem die Möglichkeit, mehrere verschiedene Biosensoren miteinander zu verbinden, um eine umfassendere Analyse des menschlichen Verhaltens zu ermöglichen. Biosensoren wie beispielsweise zur Analyse des Gesichtsausdrucks, EDA, EEG, EKG und EMG (unter anderem) lassen sich nahtlos in das Experiment integrieren.

Diese Sensoren können die Daten ergänzen, indem sie ein tieferes Verständnis ermöglichen, das sonst fehlen würde. Die Daten können Aufschluss über den emotionalen Ausdruck, die physiologische Erregung oder die Gehirnaktivität geben – Informationen, die bei einer alleinigen Betrachtung der Eye-Tracking-Daten nicht verfügbar sind.

Über das Lab Streaming Layer (LSL)-Protokoll lassen sich auch zahlreiche andere Sensoren anschließen, die nicht standardmäßig integriert sind. Auf diese Weise können Daten von anderen Sensoren an iMotions gesendet und mit anderen Datenquellen synchronisiert werden (eine Liste der von LSL unterstützten Geräte und Tools finden Sie hier).

Darüber hinaus ist es möglich, über die offene API praktisch jeden beliebigen Datenstrom anzubinden. Dies wird beispielsweise genutzt, um Daten aus einem Fahrzeug in einen Fahrsimulator einzuspeisen, sodass visuelle Reaktionen mit der Bremsgeschwindigkeit korreliert werden können. Praktisch jedes datenerzeugende Gerät lässt sich an iMotions anschließen, was neue Forschungsmöglichkeiten eröffnet.

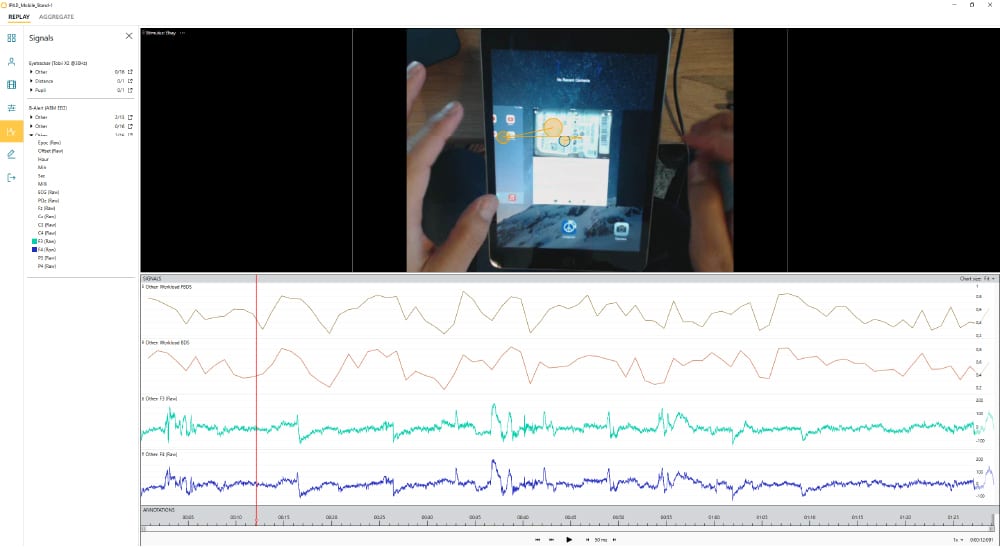

Mobiltelefone/Tablets

„Bildschirmbasiert“ muss nicht unbedingt nur einen Desktop-Monitor bedeuten. Da über 50 % der Internetnutzung über das Mobiltelefon erfolgt und Tablets immer häufiger zum Einsatz kommen, besteht ein klarer Bedarf, die Teilnehmer auf einem anderen Gerät als einem Desktop-Bildschirm zu testen. Es ist möglich, das Eye-Tracking-System an praktisch jedes Mobiltelefon oder Tablet anzuschließen und darauf zu kalibrieren. So können die Reaktionen der Nutzer unabhängig vom gewählten Gerät untersucht werden. Die gleichen Stimulusarten können auch aufgezeichnet werden, selbst wenn sie auf einem mobilen Gerät präsentiert werden.

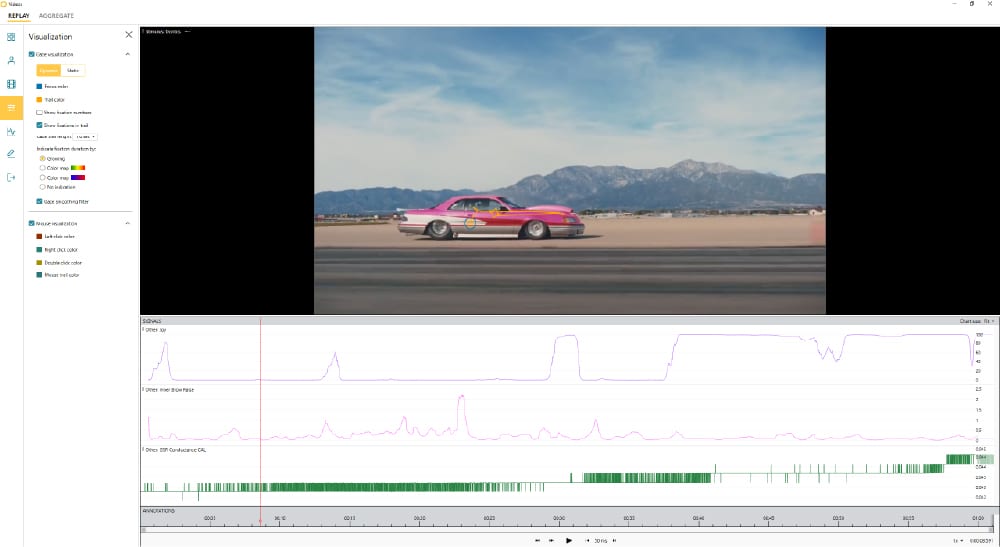

Export und Visualisierung

Experimente enden nie bereits mit der Datenerfassung – erst durch die Analyse der Daten können Hypothesen überprüft und Erkenntnisse gewonnen werden. Mit iMotions Lab lassen sich die Daten bei Bedarf problemlos zur weiteren Analyse exportieren. Die Daten können zudem über eine intuitive Benutzeroberfläche angezeigt werden – die Aufzeichnung des Stimulus kann exportiert werden, wobei die Blick- und Fixationsdaten als statisches Bild oder Videodatei dargestellt werden. Durch Anmerkungen und Markierungen lassen sich bestimmte Segmente nach Belieben auswählen.

Sie können genau auswählen, welche Sensordaten gemeinsam exportiert werden sollen. Das bedeutet, dass zwar große Datenmengen erfasst werden können, die Daten, die Sie als überflüssig erachten (zum Beispiel die verbleibende Batterieladung eines EDA-Geräts), jedoch nicht in derselben Datei exportiert werden müssen. So können Sie genau die Daten exportieren, die Sie für Ihre gewünschten Analysen benötigen.

Fazit

Die oben genannten Punkte decken die wichtigsten Funktionen des bildschirmbasierten Eye-Tracking-Moduls ab, doch jede einzelne davon bietet noch viel mehr. Wenn Sie mehr darüber erfahren möchten, inwiefern dieses Modul für Sie geeignet ist (oder auch nicht!), wenden Sie sich bitte an unsere Experten oder laden Sie die untenstehende Broschüre herunter.