Beim VR-Eye-Tracking werden die Augenbewegungen und das Verhalten der Nutzer in der virtuellen Realität untersucht, um die visuelle Aufmerksamkeit, kognitive Prozesse und die Nutzererfahrung besser zu verstehen. Forscher nutzen spezielle Eye-Tracking-Sensoren, die in VR-Headsets integriert sind, um Blickdaten zu erfassen und zu analysieren. Diese Forschung trägt dazu bei, VR-Interaktionen, die Entwicklung von Inhalten und das Design von Benutzeroberflächen zu verbessern.

Table of Contents

Die virtuelle Realität hat die Möglichkeit geschaffen, Welten zu erleben, die nicht existieren oder nicht existieren können. Diese Fähigkeit erweitert den Spielraum für experimentelle Versuchsanordnungen für Forscher erheblich. Testszenarien müssen nicht länger durch Faktoren eingeschränkt werden, die normalerweise die Durchführung bestimmter Experimente verhindern würden – Zeit, Sicherheit, Budget (oder sogar: die Gesetze der Physik). In der VR lässt sich alles simulieren.

Zwar haben sich die Testmöglichkeiten erweitert, doch auch die Technologie musste Schritt halten. Wenn Sie beispielsweise die Aufmerksamkeit von Piloten testen möchten, während diese eine neue Flugsimulation erleben, benötigen Sie Informationen darüber, wohin sie blicken. Hier kommt Eye-Tracking in der VR ins Spiel. Im Folgenden stellen wir Ihnen Eye-Tracking in der VR vor, erläutern, wie es sich vom Eye-Tracking in der realen Welt unterscheidet, und zeigen auf, wie es sogar das virtuelle Erlebnis selbst verbessern kann.

Wie funktioniert Eye-Tracking in der VR?

Beim Eye-Tracking wird in der Regel kontinuierlich der Abstand zwischen der Pupillenmitte und der Reflexion an der Hornhaut gemessen – dieser Abstand ändert sich je nach Blickwinkel. Ein für das menschliche Auge unsichtbares Infrarotlicht erzeugt diese Reflexion, während Kameras die Bewegungen aufzeichnen und verfolgen. Algorithmen der Bildverarbeitung können anhand des Blickwinkels ableiten, wohin der Blick gerichtet ist.

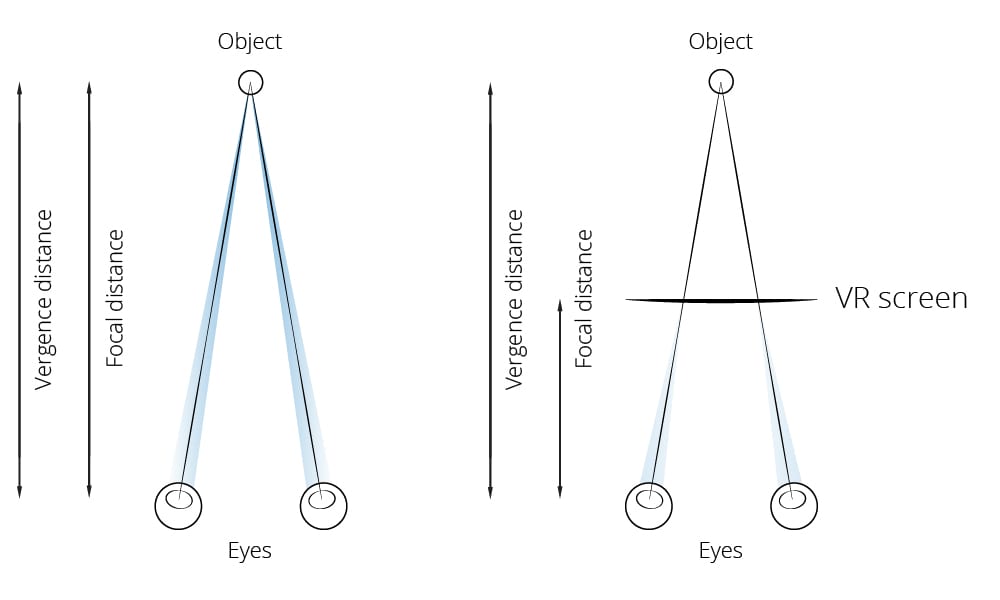

Das Prinzip ist in der VR dasselbe, mit einem entscheidenden Unterschied: Die Augen zeigen nicht unbedingt in die Richtung, in die die Person blickt. In der realen Welt weisen die Augen eine sogenannte „Vergenz“ auf – dabei sind die Augenwinkel auf einen zentralen Punkt ausgerichtet, an dem sich die Blicke treffen (siehe Abbildung unten).

Im Alltag würden sich die Linien, die von der Mitte jedes Auges ausgehen, an einem gemeinsamen Punkt treffen – nämlich an dem Objekt, das die Person gerade betrachtet. In der VR befindet sich das Display so nah vor den Augen, dass die Augen nicht unbedingt eine Konvergenz zeigen, doch aufgrund der dargestellten 3D-Informationen entsteht natürlich dennoch eine Tiefenwahrnehmung. Das Eye-Tracking in der VR muss daher mit unvollständigen Blickdaten zurechtkommen [1].

Glücklicherweise gibt die Position der Augen zwar nicht den vollständigen Überblick, doch verfügen wir über die fehlenden Daten. Durch die Kombination von Informationen über die Tiefe der virtuellen Objekte in der VR-Umgebung lässt sich ein Modell dessen erstellen, was betrachtet wurde – es kann eine virtuelle Linie von der Blickrichtung in die virtuelle Welt gezogen werden.

Nicht alle VR-Umgebungen verfügen zwangsläufig über diese Informationen, was eine genaue Verfolgung in solchen Szenarien unmöglich macht; in den Fällen, in denen dies jedoch der Fall ist, kann eine Blickverfolgung durchgeführt werden.

Die Vorteile von Eye-Tracking in der VR

Da das Rendern vollständiger virtueller Umgebungen einen hohen Rechenaufwand erfordert, ist es unerlässlich, Wege zu finden, diese Belastung zu verringern, damit die Rechenleistung anderweitig genutzt werden kann (z. B. um ein flüssiges Erlebnis zu gewährleisten, den Funktionsumfang zu erweitern oder die grafische Darstellung zu verbessern).

Foveated Rendering

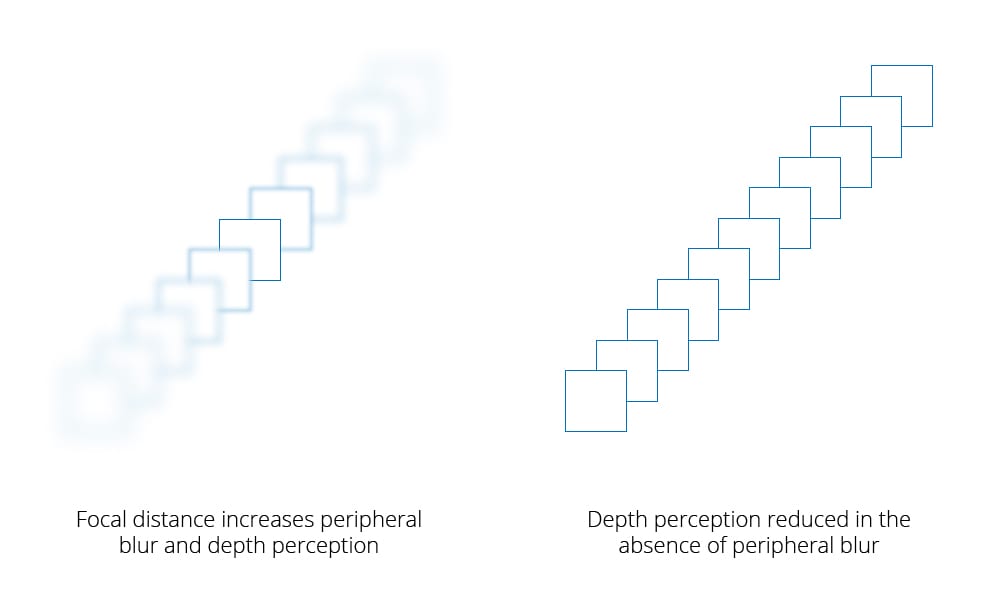

Durch die Nutzung von Eye-Tracking-Daten in der VR lässt sich das sogenannte „Foveated Rendering“ umsetzen, bei dem nur jene Elemente der Umgebung gerendert werden, auf die der Blick gerichtet ist. Dies kann den Rechenaufwand verringern und zudem eine immersivere Umgebung schaffen, in der die virtuelle Welt der realen Welt näher kommt.

Dies entspricht nicht nur unseren realen Erfahrungen – da unser peripherer Blickwinkel weitgehend unscharf ist –, sondern schafft auch ein realistischeres Tiefengefühl. Forscher haben bereits darauf hingewiesen, dass ein Fehlen der Unschärfe durch Fokusverlust zu einer „veränderten Wahrnehmung von Größe und Entfernung von Objekten in der virtuellen Umgebung“ führen kann [1, 2]. Durch die Einführung einer peripheren Unschärfe wird die Tiefenwahrnehmung gesteigert. Diese Unschärfe entsteht durch einen Prozess namens „Akkommodation“ – bei dem die Augenlinse ihren Fokus relativ zur Entfernung des betrachteten Objekts anpasst.

Verbesserter visueller Realismus

Das foveierte Rendering kann zudem die ökologische Validität der Erfahrung verbessern (d. h. wie gut ein Experiment die Realität nachahmt). Durch die Schaffung von Umgebungen, die dem realen Leben näher kommen, kann davon ausgegangen werden, dass auch das Verhalten der Teilnehmer in der VR dem realen Leben ähnelt. Forscher können zunehmend darauf vertrauen, dass die Ergebnisse des Experiments über die virtuelle Welt hinaus übertragbar sind.

Letztendlich bedeutet dies, dass Aufmerksamkeitsprozesse dank Eye-Tracking sowohl gemessen werden können als auch als realitätsnäher gelten. Dies eröffnet neue Möglichkeiten für ein genaues Verständnis menschlichen Verhaltens in Situationen, die im realen Leben für die Teilnehmer zu kostspielig oder zu aufwendig wären.

Adaptive VR-Erlebnisse

Adaptive VR-Erlebnisse, ergänzt durch Eye-Tracking-Technologie, steigern das Eintauchen in die virtuelle Realität und die Interaktivität von VR-Umgebungen erheblich. Eye-Tracking in VR ermöglicht intuitivere und natürlichere Interaktionen innerhalb virtueller Räume. Indem sie dem Blick des Nutzers folgen, können VR-Systeme Inhalte dynamisch an den Blickpunkt des Nutzers anpassen. Dies schafft personalisierte Erlebnisse, da die Umgebung in Echtzeit auf den Fokus und die Aufmerksamkeit des Nutzers reagiert. In pädagogischen VR-Anwendungen beispielsweise kann sich die Komplexität der Inhalte an den Grad der Nutzerbeteiligung anpassen, was die Lerneffizienz steigert. Auch im Gaming-Bereich ermöglicht Eye-Tracking realistischere Interaktionen mit Charakteren und intelligentere KI-Reaktionen, wodurch ein tieferes Gefühl von Präsenz und Einbindung entsteht.

Darüber hinaus kann Eye-Tracking den Komfort bei der VR-Nutzung verbessern. Durch die Optimierung der Grafikdarstellung auf der Grundlage des Blickpunkts des Nutzers (eine als „Foveated Rendering“ bezeichnete Technik) wird die Rechenlast verringert, was zu einer flüssigeren Darstellung und einer geringeren Wahrscheinlichkeit von Bewegungsübelkeit führt. Diese Anpassungsfähigkeit verbessert nicht nur das Nutzererlebnis, sondern macht VR auch einem breiteren Publikum zugänglich, was sie zu einer entscheidenden Entwicklung in der VR-Technologie macht.

Blickbasierte Analysen

Blickbasierte Analysen in der virtuellen Realität bieten einen revolutionären Ansatz zum Verständnis des Nutzerverhaltens und der Interaktion. Durch die Erfassung, wohin und wie lange ein Nutzer in einer virtuellen Umgebung blickt, können Entwickler und Forscher wertvolle Erkenntnisse gewinnen. Diese Daten sind entscheidend für die Optimierung von Benutzeroberflächen, die Verbesserung von VR-Erlebnissen und sogar in therapeutischen Kontexten zum Verständnis kognitiver Prozesse. Sie unterstützen zudem die adaptive Bereitstellung von Inhalten, bei der sich das VR-Erlebnis dynamisch an die Fokusbereiche des Nutzers anpassen kann. In Bildungs- und Schulungssimulationen helfen blickbasierte Analysen bei der Bewertung von Lernmustern und dem Grad der Einbindung. Insgesamt handelt es sich um ein leistungsstarkes Werkzeug zur Steigerung der Effektivität und des Immersionsgrades von VR-Anwendungen.

VR-Headsets, die mit dem iMotions-Eye-Tracking-Modul kompatibel sind

Mehrere VR-Headsets mit Eye-Tracking sind nativ in das VR-Eye-Tracking-Modul von iMotions integriert und werden dort vollständig unterstützt. Die VR-Headsets unterscheiden sich hinsichtlich Preis und Anwendungsbereich, wurden jedoch alle von unserem Team aus Produktspezialisten gründlich geprüft.

Forschung zum Eye-Tracking in der virtuellen Realität

Ein Beispiel hierfür liefert eine Studie, in der mithilfe von iMotions verschiedene Unterrichtsmethoden für die Arbeit im Nasslabor verglichen wurden [3]. Die Teilnehmer wurden entweder an einem Desktop-PC oder in einer virtuellen Umgebung geschult. Das Nasslabor ist eine Umgebung, deren Nutzung für Studierende oft zu kostspielig ist; dennoch lässt sich auf kostengünstige Weise testen, wie die Teilnehmer auf die Umgebung reagierten. Die Forscher konnten ableiten, dass bei den Teilnehmern in der VR-Umgebung im Vergleich zur bildschirmbasierten Version zwar eine stärkere Immersion, jedoch ein geringerer Lernerfolg stattfand.

Ein weiteres Beispiel für den Einsatz von iMotions bestand darin, dass die Teilnehmer ein virtuelles Auto steuerten und dabei einem autonom gesteuerten virtuellen Auto folgten [4]. Die Forscher konnten die Teilnehmer ohne jegliches Risiko mit Umgebungen konfrontieren, die in der realen Welt unsicher gewesen wären. Sie stellten fest, dass das gestiegene Vertrauen der Teilnehmer in das autonome Auto auch das Kollisionsrisiko erhöhte – ein entscheidender Faktor für die Aufrechterhaltung der Fahrersicherheit im Umgang mit selbstfahrenden Autos.

Weitere Forschungen mit iMotions im Bereich VR befassten sich unter anderem mit der Diagnose von Krankheiten auf einer virtuellen Insel [5], dem Erlebnis (virtueller) sozialer Interaktion in Verbindung mit haptischem Feedback [6] sowie der Untersuchung der Auswirkungen architektonischer Entwürfe auf das Gefühl der Erholung, ohne dass dafür Baukosten anfallen [7]. Für die Zukunft der VR-Forschung sind die Möglichkeiten praktisch grenzenlos.

Fazit

Zusammenfassend lässt sich sagen, dass die Einbindung von Eye-Tracking-Technologie in VR-Erlebnisse Forschern und Entwicklern gleichermaßen eine Vielzahl neuer Möglichkeiten eröffnet. Die Präzision und Tiefe der durch diese Kombination gewonnenen Erkenntnisse verbessern nicht nur unser Verständnis des Nutzerverhaltens, sondern ebnen auch den Weg für immersivere und effektivere virtuelle Umgebungen. Da VR weiterhin Branchen von Gaming bis zum Gesundheitswesen prägt, wird die Anwendung bewährter Verfahren im Eye-Tracking zweifellos eine entscheidende Rolle dabei spielen, die Grenzen der Innovation zu erweitern. Wenn Sie die in diesem Artikel dargelegten Richtlinien befolgen, sind Sie bestens gerüstet, um sich auf eine Reise zu begeben, die das volle Potenzial von VR-Eye-Tracking ausschöpft und Erlebnisse bietet, die Nutzer auf beispielloser Ebene fesseln, informieren und ansprechen.

Literaturverzeichnis

[1] Clay, V., König, P., König, S. (2019). Eye Tracking in der virtuellen Realität. Journal of Eye Movement Research, 12, (1):3

[2] Eggleston, R., Janson, W. P. & Aldrich, K. A. (1996). Auswirkungen von Virtual-Reality-Systemen auf die Einschätzung von Größe und Entfernung in einer virtuellen Umgebung. Virtual Reality Annual International Symposium, 139–146. https://doi.org/10.1109/VRAIS.1996.490521

[3] Makransky, G., Terkildsen, T. S. und Mayer, R. E. (2017). Die Einbindung immersiver virtueller Realität in eine naturwissenschaftliche Laborsimulation führt zu einer stärkeren Präsenz, aber zu geringeren Lernerfolgen. Learn. Instr. doi: 10.1016/j.learninstruc.2017.12.007

[4] Brown, B., Park, D., Sheehan, B., Shikoff, S., Solomon, J., Yang, J., Kim, I. (2018). Bewertung der Sicherheit menschlicher Fahrer in Dilemma-Zonen mit automatisierten Fahrzeugen mithilfe einer Virtual-Reality-Umgebung. Symposium für System- und Informationstechnik (SIEDS), S. 185–190

[5] Taub, M., Sawyer, R., Lester, J., Azevedo, R. (2019). Der Einfluss kontextbezogener Emotionen auf selbstreguliertes Lernen und wissenschaftliches Denken beim Lernen in einer spielbasierten Lernumgebung. International Journal of Artificial Intelligence in Education. https://doi.org/10.1007/s40593-019-00191-1

[6] Krogmeier, C., Mousas, C., Whittinghill, D. (2019). Mensch, virtueller Mensch, Zusammenstoß! Eine vorläufige Studie zum haptischen Feedback. IEEE-Konferenz zu virtueller Realität und 3D-Benutzeroberflächen (VR). DOI: 10.1109/VR.2019.8798139

[7] Zou, Z., Ergan, S. (2019). Ein Rahmenkonzept zur Quantifizierung der regenerativen Wirkung auf den Menschen in virtuellen gebauten Umgebungen. Environmental Design Research Association (EDRA).