Um die Frage „Was ist die Analyse von Gesichtsausdrücken?“ zu beantworten, müssen wir zunächst einen Blick auf uns selbst werfen. Menschen sind emotionale Wesen. Unser emotionaler Zustand bestimmt unser Verhalten – von den grundlegendsten Prozessen bis hin zu komplexen Handlungen und schwierigen Entscheidungen [1, 2]. Unser Leben wird in vielerlei Hinsicht von unseren Emotionen geleitet; wenn wir also mehr über Emotionen wissen, können wir auch das menschliche Verhalten im Allgemeinen besser verstehen.

Es liegt auf der Hand, dass das Verständnis der emotionalen Verfassung von Menschen für eine Vielzahl von Anwendungsbereichen nützlich sein kann – angefangen bei der Vertiefung des Verständnisses der menschlichen Psychologie über die Untersuchung von Verhaltensweisen zur Verbesserung der Benutzererfahrung bis hin zur Entwicklung wirkungsvoller Werbekampagnen und darüber hinaus.

Auch wenn die Bedeutung des Verständnisses von Emotionen auf der Hand liegt, kann es schwierig sein, objektive Echtzeitdaten über den emotionalen Zustand einer Person zu erhalten.

Es gibt Fragebögen, die darauf ausgelegt sind, den emotionalen Zustand einer Person zu messen, wobei jedoch leicht irreführende Verzerrungen auftreten können (wie bei jedem Fragebogen; [3]). Darüber hinaus liefern sie nur eine Momentaufnahme der Informationen zu einem bestimmten Zeitpunkt, was bedeutet, dass die Daten lediglich ein allgemeines Bild davon vermitteln können, wie sich jemand fühlt.

Die Analyse von Gesichtsausdrücken hingegen kann objektive Echtzeitdaten darüber liefern, wie unsere Gesichter emotionale Inhalte ausdrücken. Auch wenn es eine Debatte darüber gibt, welche emotionalen Inhalte Gesichtsausdrücke genau widerspiegeln [4, 5], bleibt sie doch eines der wenigen Instrumente, das Einblicke in die Gefühlslage einer Person ermöglicht [6] – eine Chance, die man sich nicht entgehen lassen sollte.

Bevor wir jedoch näher auf die Analyse eingehen, beginnen wir mit den Grundlagen:

Table of Contents

Was sind Mimik?

Unser Gesicht ist ein vielschichtiger, hoch differenzierter Teil unseres Körpers – tatsächlich ist es eines der komplexesten Signalsysteme, über die wir verfügen. Es umfasst 43 strukturell und funktionell eigenständige Muskeln, von denen jeder unabhängig von den anderen angesteuert werden kann [7].

Das Gesichtsmuskelsystem ist der einzige Bereich unseres Körpers, in dem Muskeln entweder an einem Knochen und am Gesichtsgewebe ansetzen (andere Muskeln im menschlichen Körper verbinden sich mit zwei Knochen) oder ausschließlich am Gesichtsgewebe, wie beispielsweise die Muskeln, die die Augen oder Lippen umgeben.

Alle Muskeln unseres Körpers werden von Nerven versorgt, die ihre Signale ursprünglich vom Rückenmark und vom Gehirn erhalten. Die Nervenverbindung ist bidirektional, was bedeutet, dass der Nerv auf der Grundlage von Signalen aus dem Gehirn Muskelkontraktionen auslöst, aber auch Informationen an das Gehirn zurücksenden kann.

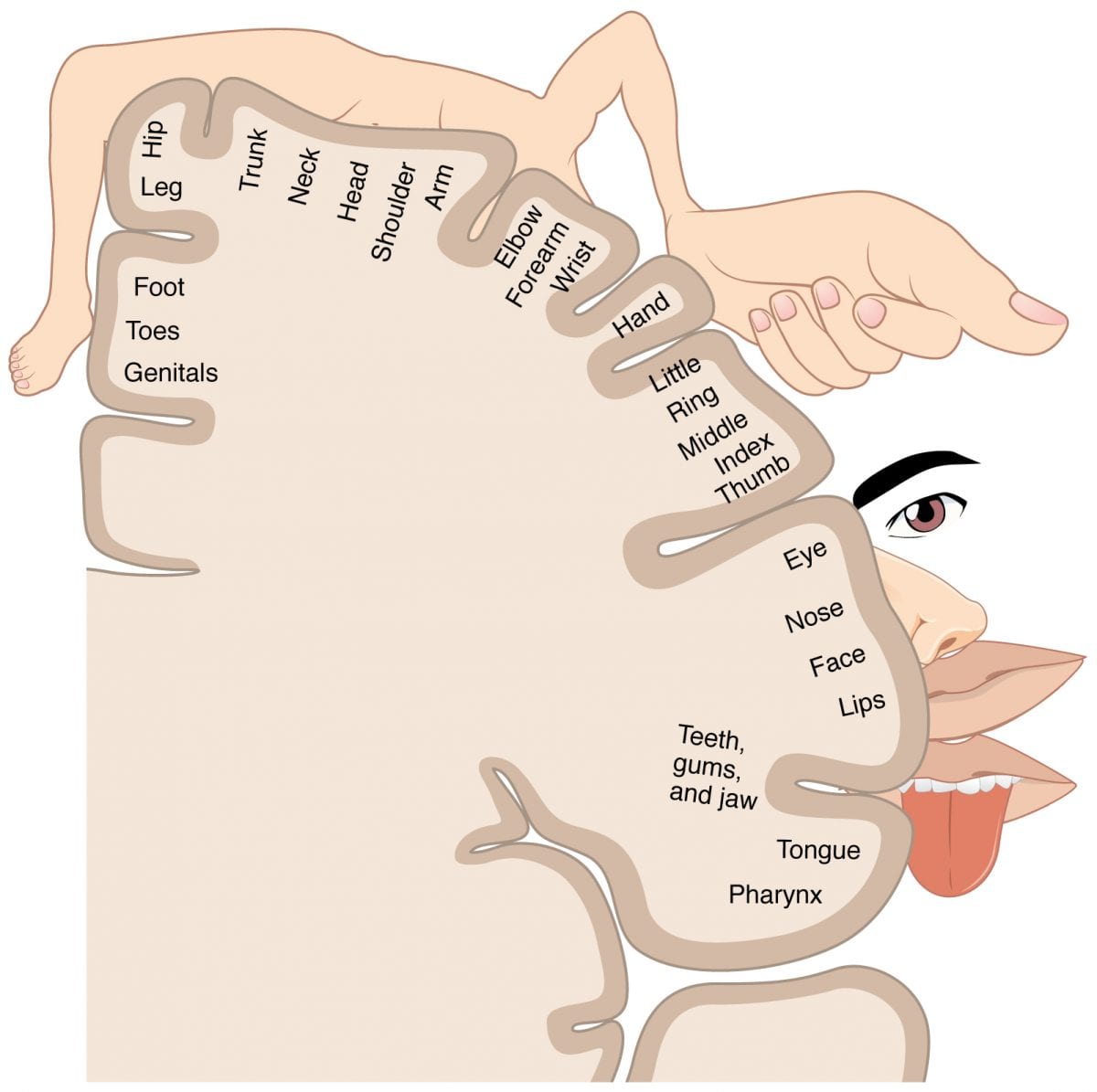

Fast alle Gesichtsmuskeln werden von einem einzigen Nerv, dem Gesichtsnerv, innerviert, der auch als Hirnnerv VII bezeichnet wird. Der Gesichtsnerv entspringt tief im Hirnstamm (der Pons), tritt etwas unterhalb des Ohrs aus dem Schädel (dem Gesichtsnervkanal) aus und verzweigt sich zu allen Gesichtsmuskeln [8]. Der Gesichtsnerv ist zudem mit dem primären motorischen Areal unseres Neokortex verbunden, das alle Muskelbewegungen unseres Körpers steuert (eine repräsentative Darstellung dieser Organisation ist unten abgebildet; [9]).

Unsere Gesichtsausdrücke haben daher oft ihren Ursprung im primären motorischen Kortex, der Signale vom Thalamus erhält, sowie im supplementären motorischen Kortex [10, 11]. Dieser Signalweg lässt sich zwar noch weiter aufschlüsseln, führt aber im Wesentlichen zu einem immer umfangreicheren Netzwerk von Hirnarealen, die Gesichtsausdrücke in verschiedenen Phasen aktivieren können.

Sobald der Gesichtsnerv ein Signal an einen Muskel sendet, zieht sich dieser zusammen (oder entspannt sich), was zu einer Veränderung der Gesichtsmuskulatur führt. Dieses Signal muss nicht unbedingt zu einer äußerlich wahrnehmbaren Veränderung des Gesichtsausdrucks führen, doch darauf wird weiter unten noch näher eingegangen.

Wie funktioniert die Analyse von Gesichtsausdrücken?

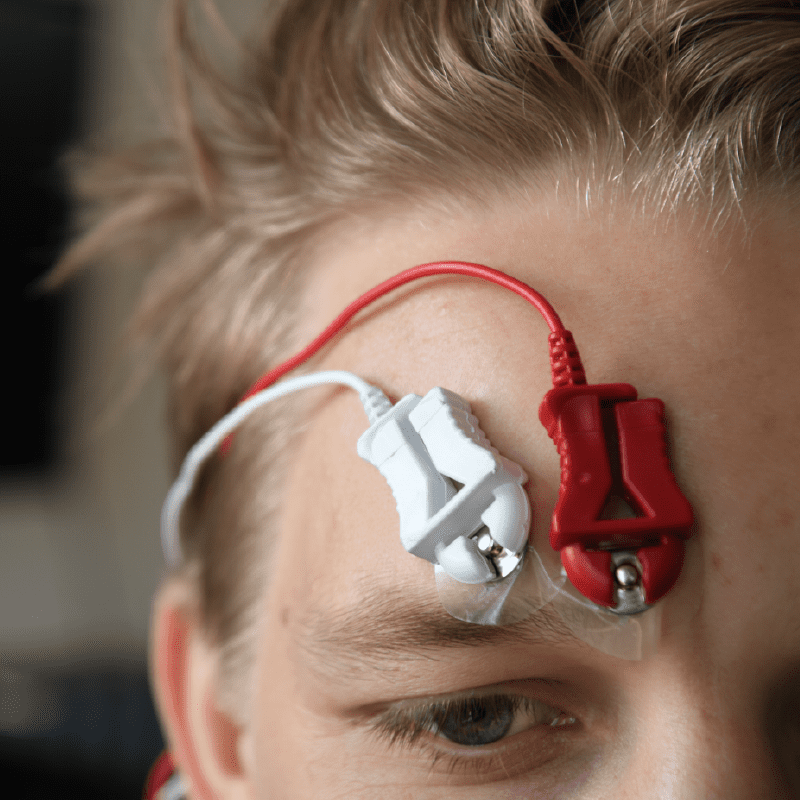

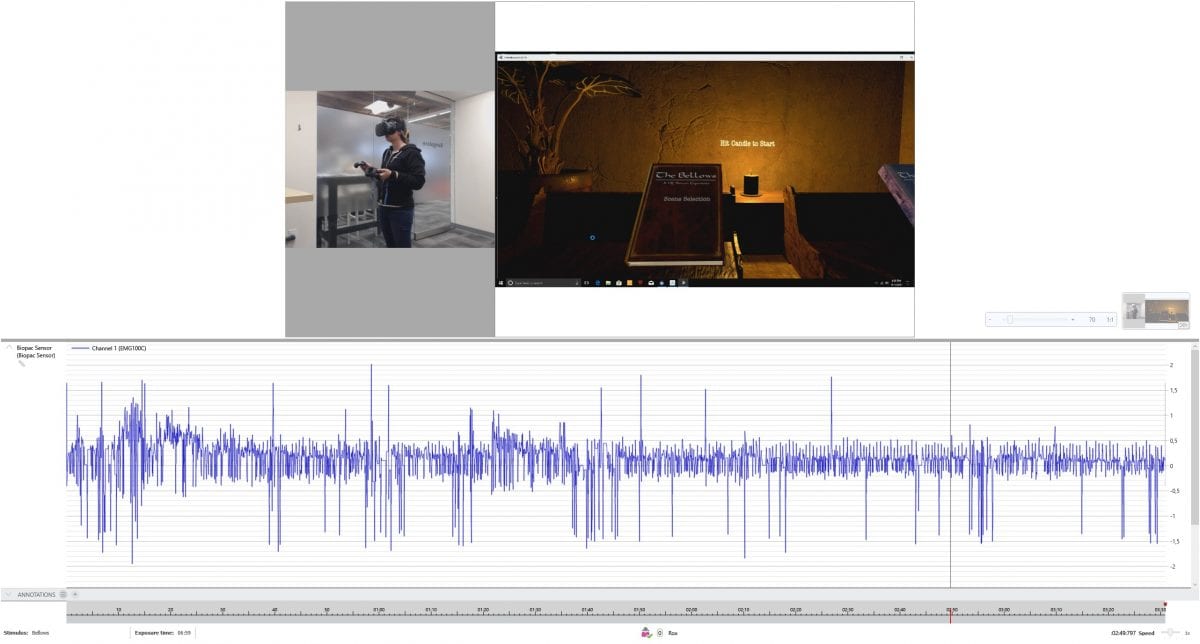

Es gibt drei Hauptmethoden zur Analyse des Gesichtsausdrucks, von denen jede ihre eigenen Vor- und Nachteile hat. Die älteste dieser drei Methoden, die Gesichts-Elektromyographie (fEMG), umfasst die Aufzeichnung der elektrischen Aktivität der Gesichtsmuskeln.

Wenn Sie sich eingehender mit diesem Thema befassen möchten, einschließlich seiner vielfältigen Anwendungsmöglichkeiten und Erkenntnisse, empfehlen wir Ihnen einen Blick in unsere umfassende Informationsquelle zur Mimikanalyse.

fEMG

Aufzeichnungen mittels fEMG haben gezeigt, dass eine Aktivität festgestellt werden kann, selbst wenn keine äußerliche Veränderung des Gesichtsausdrucks zu beobachten ist. Es wird vermutet, dass diese Aktivität mit dem jeweiligen emotionalen Zustand der Person zusammenhängt (so wird beispielsweise angenommen, dass eine erhöhte Aktivität des Musculus zygomaticus major, die mit dem Lächeln einhergeht, mit Gefühlen der Freude in Verbindung steht; [12]).

Zwar liefert die fEMG Daten zu Gesichtsmuskelbewegungen, die visuell nicht wahrnehmbar sind, doch sind die Aufzeichnungen auf eine begrenzte Anzahl von Elektroden beschränkt, die im Gesicht angebracht werden können. Das Anbringen der Elektroden erfordert zudem gewisse Kenntnisse sowohl über die Gesichtsmuskulatur als auch darüber, wie die Elektroden korrekt angebracht werden.

Facial Action Coding System (FACS)

Kurz nachdem fEMG zur Erfassung von Veränderungen der Mimik eingesetzt wurde, führten Paul Ekman und Wallace Friesen das Facial Action Coding System (FACS) ein [13]. Das FACS baute auf den Arbeiten von Carl-Herman Hjortsjö [14] auf, der das Gesicht in einzelne Muskelbewegungen unterteilte.

Das FACS hat sich zur grundlegenden Quelle für die Erforschung von Gesichtsausdrücken entwickelt und das Gebiet der Gesichtsausdrucksanalyse seit seinen Anfängen geprägt. Durch die Erfassung einer Reihe von Gesichtsbewegungen, die mit der Aktivität der Gesichtsmuskulatur zusammenhängen, konnten Forscher die Gesichtsaktivitäten quantifizieren und diese wiederum mit emotionalen Ausdrucksformen in Verbindung bringen.

Auch wenn die Bedeutung von FACS für den Bereich der Mimikanalyse kaum hoch genug eingeschätzt werden kann, ist die praktische Anwendung dieser Methoden nicht ohne Schwierigkeiten. Um Gesichtsausdrücke nach der FACS-Methode korrekt zu quantifizieren, müssen offiziell zertifizierte und geschulte FACS-Kodierer feststellen, welche Muskeln sich bewegen und wie stark diese Bewegung ist. In der Praxis bedeutet dies, dass ein Video einer Interaktion im Wesentlichen Bild für Bild angesehen und ausgewertet werden muss – was natürlich sehr zeitaufwendig sein kann.

Software zur Analyse von Gesichtsausdrücken

In der Folge entstanden Softwareprogramme, die versuchen, die Anforderungen zu erfüllen, die für eine genaue Auswertung von Gesichtsausdrücken gemäß den Prinzipien der FACS-Methode oder auf deren Grundlage erforderlich sind. Eines dieser Programme hieß „Emotient“ und hatte Paul Ekman als Berater. Emotient wurde im Jahr 2016 von Apple übernommen.

Auch andere Unternehmen bieten automatisierte Lösungen für die Analyse von Gesichtsausdrücken an, darunter Affectiva, ein Unternehmen, das seine Algorithmen anhand von über sieben Millionen Gesichtern trainiert hat (der größte Datensatz dieser Art unter allen Anbietern von Software zur Gesichtsausdrucksanalyse) und das in die iMotions-Plattform integriert ist.

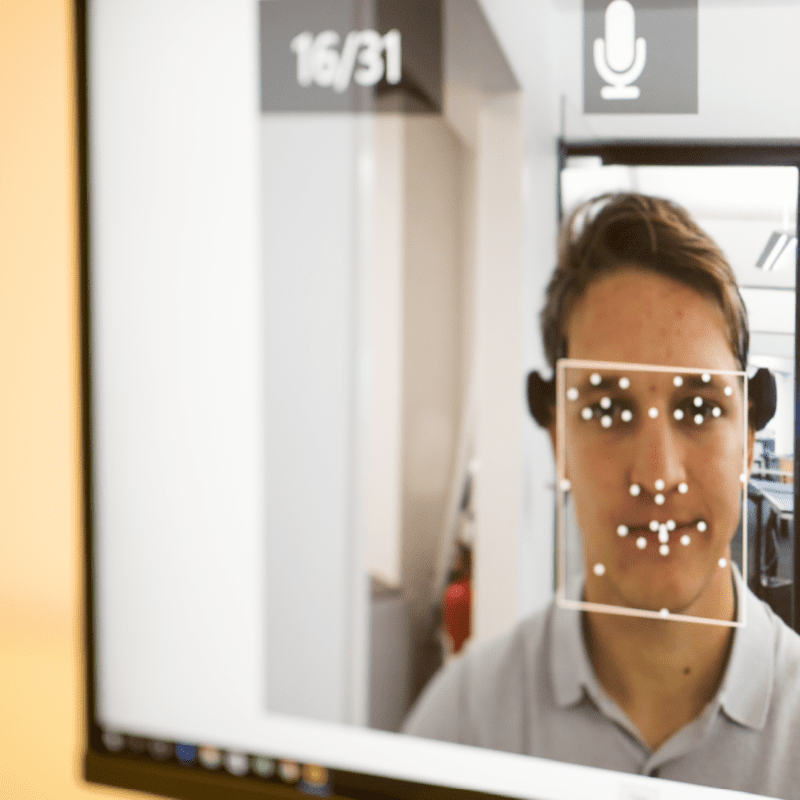

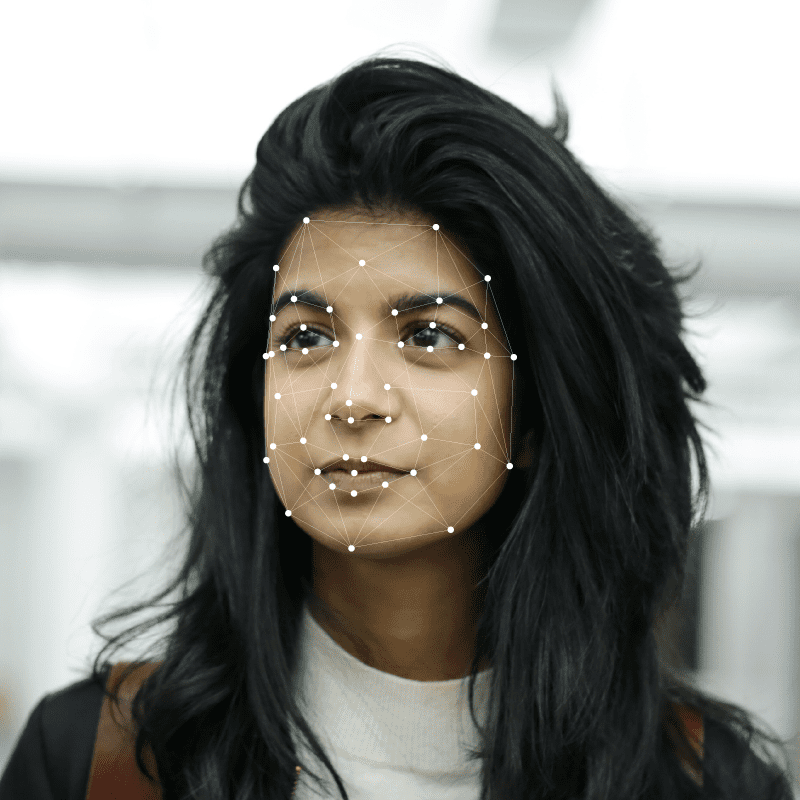

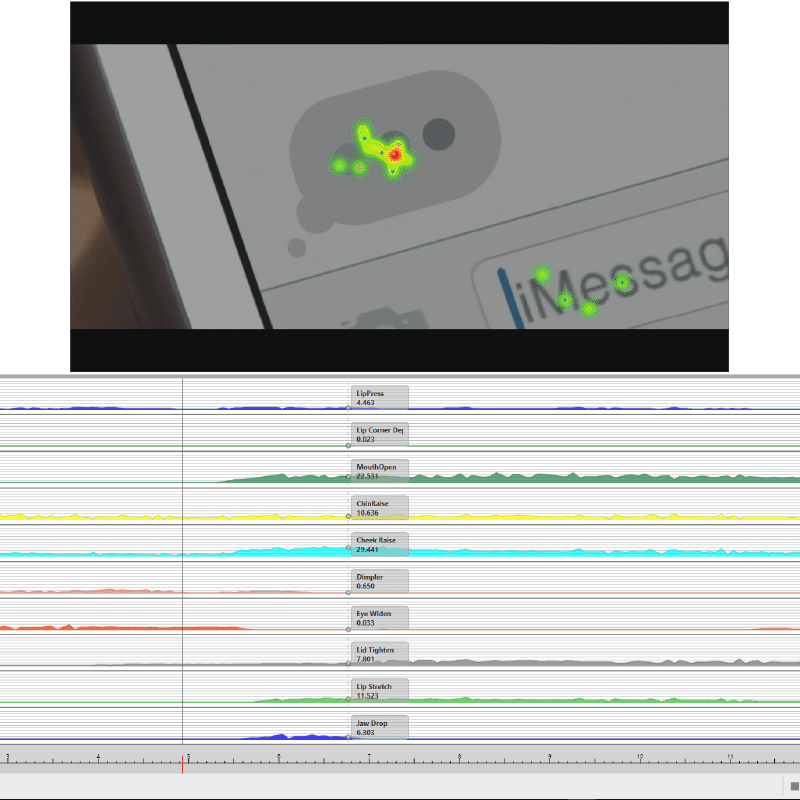

Die Software erkennt zunächst das Gesicht und nutzt Algorithmen der Bildverarbeitung, um wichtige Orientierungspunkte zu identifizieren (ähnlich der FACS-Einteilung des Gesichts). Die Software kann sich dann in der Art und Weise unterscheiden, wie die Bilder verarbeitet werden, doch Affectiva verwendet Algorithmen, die mittels Deep Learning trainiert wurden, um diese Orientierungspunkte zu analysieren und anschließend Gesichtsausdrücke vorherzusagen.

Software zur Analyse von Gesichtsausdrücken hat eindeutig den Vorteil, was den Zeit- und Ressourcenaufwand angeht – eine einfache Webcam ist die einzige Hardware, die benötigt wird. Die Genauigkeit wird jedoch allgemein als besser angesehen, wenn fEMG oder die manuelle FACS-Methode zum Einsatz kommen. Letztendlich müssen diejenigen, die sich mit der Analyse von Gesichtsausdrücken beschäftigen, entscheiden, welche Methode ihren Bedürfnissen und Anforderungen am besten entspricht.

Daten zur Analyse von Gesichtsausdrücken

Die Art der Daten hängt natürlich von der Erfassungsmethode ab (d. h. fEMG, manuelle FACS-Kodierung oder automatische Gesichtsausdrucksanalyse mittels Software). Im Folgenden werden wir die einzelnen Datentypen näher betrachten.

fEMG

Wie beim EMG beziehen sich die Daten auf das Ausmaß der von den Muskeln erzeugten elektrischen Aktivität, nachdem ein Ausgangswert ermittelt wurde. Der Ausgangswert wird anhand von Aufzeichnungen der sogenannten maximalen willkürlichen Kontraktion (MVC) ermittelt – der maximalen Intensität der Muskelkontraktion, zu der die Person fähig ist.

Anschließend wird die Spannungsdifferenz zwischen zwei Elektroden an der Haut gemessen und im Verhältnis zur maximalen Aktivität analysiert.

Facial Action Coding System (FACS)

Das FACS-System besteht aus einer Nummer, die jeder einzelnen Muskelbewegung zugeordnet ist, und kann durch die Angabe der Gesichtshälfte (d. h. links oder rechts) sowie der Stärke der Bewegung weiter spezifiziert werden. Die Stärke wird auf einer Skala von „A“ (geringfügige Aktivität) bis „E“ (maximale Aktivität) bewertet. Auf diese Weise kann ein starkes Öffnen der Augen als R5C + L5C bezeichnet werden (Bewegung des linken und rechten Levator palpebrae superioris mit der Intensität „C“).

Automatische Analyse von Gesichtsausdrücken

Der genaue Datentyp hängt von der Art der Software ab, die für die automatische Analyse von Gesichtsausdrücken verwendet wird. Affectiva liefert beispielsweise Werte, die als „Detektoren“ bezeichnet werden – mit Werten zwischen 0 (kein Ausdruck) und 100 (ein voll ausgeprägter Ausdruck). Diese Werte können dann wie jede andere Datenart analysiert werden.

Lesen Sie auch: Tipps für hochwertige Daten zur Analyse von Gesichtsausdrücken

Fazit

James Russell und José Fernández-Dols schrieben 1997: „Die Verknüpfung von Gesichtern mit Emotionen mag zwar als selbstverständlich gelten, hat sich jedoch als der wichtigste Ansatz in der Emotionspsychologie erwiesen“ [15]. Auch wenn die Einzelheiten dieser Verbindung zu Emotionen nach wie vor umstritten sind, bleibt sie eines der wenigen verfügbaren Instrumente, das objektive Daten zu emotionalen Ausdrucksformen liefern kann.

Es gibt verschiedene Methoden zur Analyse von Gesichtsausdrücken, und welche davon für Ihre Forschung am besten geeignet ist, hängt weitgehend von den Ihnen zur Verfügung stehenden Ressourcen und deren Priorisierung ab. Die beste Entscheidung, die Sie treffen können, ist eine fundierte Entscheidung. Um mehr über Gesichtsausdrücke zu erfahren, laden Sie unseren kostenlosen Leitfaden unten herunter.

Literaturverzeichnis

[1] Sanfey, A.G., Rilling, J.K., Aronson, J.A., Nystrom, L.E. & Cohen, J.D. (2003). Die neuronalen Grundlagen wirtschaftlicher Entscheidungsfindung im Ultimatum-Spiel. Science, 300, 1755–1758.

[2] Angie, A. D., Connelly, S., Waples, E. P. und Kligyte, V. (2011). Der Einfluss einzelner Emotionen auf Urteilsbildung und Entscheidungsfindung: eine metaanalytische Übersicht. Cogn. Emotion, 25 (2011), 1393–1422.

[3] Choi, B. C. K., & Pak, A. W. P. (2005). Ein Verzeichnis von Verzerrungen in Fragebögen. Preventing Chronic Disease, 2, 1–13.

[4] Carroll, J. M. & Russell, J. A. (1996) Sind Gesichtsausdrücke Ausdruck bestimmter Emotionen? Die Beurteilung von Emotionen anhand des Gesichts im Kontext. Journal of Personality and Social Psychology, 70:205–18.

[5] Aviezer H., Trope Y., Todorov A. (2012) Körperliche Signale, nicht Gesichtsausdrücke, unterscheiden zwischen intensiven positiven und negativen Emotionen. Science, 338: 1225–1229.

[6] Sebe, N., Lew, M. S., Cohen, I., Sun, Y., Gevers, T., Huang, T. S. (2004). Analyse authentischer Gesichtsausdrücke. In: Proc. International Conf. Face and Gesture Recognition, S. 517–522.

[7] Moore, Keith L.; Dalley, Arthur F.; Agur, Anne M. R. (2010). Moore’s Clinical Anatomy. Vereinigte Staaten von Amerika: Lippincott Williams & Wilkins.

[8] Gupta, S., Mends, F., Hagiwara, M., Fatterpekar, G., Roehm, P. C. (2013). Bildgebung des Gesichtsnervs: eine aktuelle Übersicht. Radiol Res Pract, 248039:1–14.

[9] OpenStax College, CC BY 3.0. Abgerufen am 24. September 2018 von: https://commons.wikimedia.org/wiki/File:1421_Sensory_Homunculus.jpg

[10] Behrens, T., Johansen-Berg, H., Woolrich, M., Smith, S., Wheeler-Kingshott, C., Boulby, P., Barker, G., Sillery, E., Sheehan, K., Ciccarelli, O., Thompson, A., Brady, J., Matthews, P. (2003). Nichtinvasive Kartierung der Verbindungen zwischen menschlichem Thalamus und Kortex mittels Diffusionsbildgebung. Nat. Neurosci. 6 (7), 750 – 757.

[11] Oliveri, M., Babiloni, C., Filippi, M. M., Caltagirone, C., Babiloni, F., Cicinelli, P., Traversa, R., Palmieri, M. G. & Rossini, P. M. (2003). Einfluss des supplementären motorischen Areals auf die Erregbarkeit des primären motorischen Kortex während Bewegungen, die durch neutrale oder emotional unangenehme visuelle Reize ausgelöst werden. Exp Brain Res, 149, 214–221.

[12] Schmidt, K. L., Ambadar, Z., Cohn, J. F., Reed, L. I. Bewegungsunterschiede zwischen bewussten und spontanen Gesichtsausdrücken: Die Aktivität des Musculus zygomaticus major beim Lächeln. Journal of Nonverbal Behavior. 2006;30:37–52.

[13] Ekman, P., und Friesen, W. V. (1978). Facial Action Coding System: Eine Methode zur Messung von Gesichtsbewegungen. Palo Alto, CA: Consulting Psychologists Press.

[14] Hjortsjo, C. H. (1970). Das menschliche Gesicht und die Mimik. Malmö, Schweden: Nordens Boktryckeri.

[15] Russell, J. A., Fernandez-Dols, J. M. (1997). Die Psychologie des Gesichtsausdrucks. Cambridge, MA: Cambridge UP.[/fusion_builder_column][/fusion_builder_row][/fusion_builder_container]