Erfahren Sie in diesem aufschlussreichen Leitfaden, wie die Genauigkeit von Eye-Tracking-Messungen effektiv gemessen wird. Erfahren Sie mehr über die wichtigsten Kennzahlen, die zur Bewertung der Genauigkeit in Eye-Tracking-Studien herangezogen werden. Das Verständnis dieser Kennzahlen ist entscheidend, um die Zuverlässigkeit und Validität Ihrer Eye-Tracking-Forschung sicherzustellen. Beherrschen Sie noch heute die Kunst der Präzision bei Eye-Tracking-Messungen.

Table of Contents

Der wichtigste Parameter beim Eye-Tracking ist die Genauigkeit. Wenn das System nicht erfasst, wohin Ihre Befragten tatsächlich blicken, stehen auch Ihre übrigen Daten auf wackeligen Beinen – und Sie können sich genauso gut schon früh zum Mittagessen aufmachen.

Da jede Konfiguration anders ist – von Labor-Monitoren bis hin zu mobilen Eye-Tracking-Brillen – gibt es verschiedene Möglichkeiten, die Genauigkeit eines Eye-Tracking-Systems zu überprüfen. In diesem Artikel werden wir einige der gängigsten Methoden zur Messung der Genauigkeit näher betrachten. Jede Methode hat ihre eigenen Stärken und Schwächen, und wenn Sie diese Vor- und Nachteile kennen, können Sie den richtigen Ansatz für Ihre Forschungsumgebung und Ihre Hardware wählen.

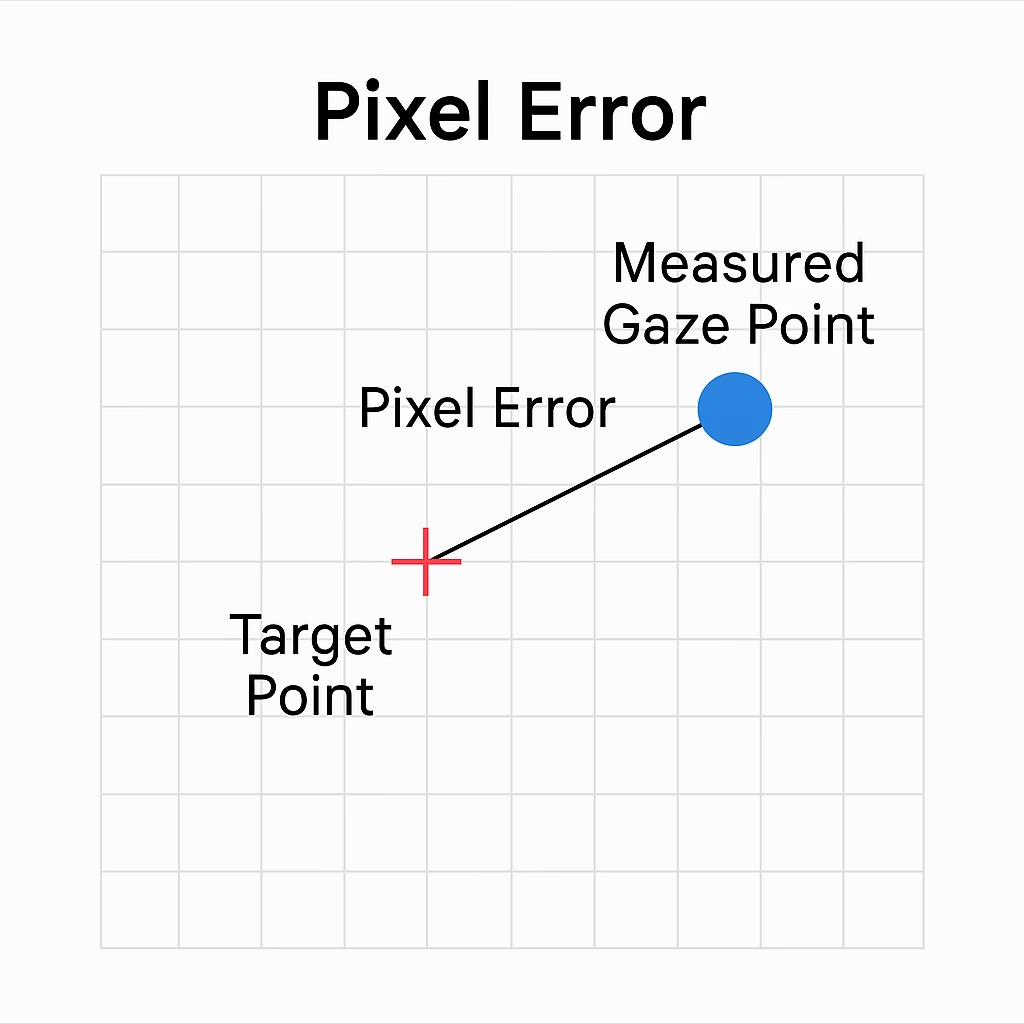

Pixel-Fehler

Der Pixelfehler ist eine der gängigen Methoden zur Messung der Genauigkeit von Eye-Tracking-Systemen. Diese Methode gibt Aufschluss darüber, wie genau die Kalibrierung war, und wird als durchschnittliche (oder maximale) Anzahl an Pixeln quantifiziert, um die der gemessene Blick von den tatsächlichen Kalibrierungspunkten abweicht. Die Differenz zwischen dem tatsächlichen Kalibrierungspunkt (z. B. einem Punkt auf dem Bildschirm) und der Stelle, auf die der Eye-Tracker den Blick der Person vermutet, wird in Pixeln angegeben.

- Ein geringerer Pixelfehler bedeutet eine genauere Kalibrierung.

- Wenn sich der Kalibrierungspunkt beispielsweise bei (500, 400) Pixeln auf dem Bildschirm befindet, der Tracker den Blickpunkt jedoch bei (505, 398) – nur als Beispiel – erfasst, beträgt der Fehler 5–6 Pixel.

Die Darstellung der Kalibrierungsgenauigkeit anhand des Pixelfehlers kann bei kleineren Smartphones manchmal zu weniger als optimalen Ergebnissen führen, obwohl die Daten eigentlich gut sind. Dies liegt an den unterschiedlichen Pixeldichten oder Pixel-pro-Zoll-Werten (PPI) zwischen Desktop-Monitoren und Smartphone- sowie Tablet-Bildschirmen – je kleiner das Gerät, desto höher der PPI-Wert. Zur Veranschaulichung: Die Auflösung eines modernen iPhones beträgt 2556 x 1179, während ein Standard-Desktop-Monitor eine ähnliche Auflösung aufweist.

Das bedeutet, dass Smartphones oder Tablets im Vergleich zu einem Desktop-Bildschirm oft eine höhere Pixelfehlerrate aufweisen, einfach weil die Pixel bei gleicher Auflösung auf einer kleineren Fläche untergebracht sind.

Warum wird die Genauigkeit in Pixeln gemessen?

Bei bildschirmbasierten Eye-Tracking-Systemen ist die Angabe der Genauigkeit in Pixeln oft die praktischste Wahl. Da der Blick des Teilnehmers stets auf einen festgelegten Bildschirm gerichtet ist, spiegelt der Pixelfehler direkt wider, wie weit der gemessene Blickpunkt vom Zielpunkt auf eben diesem Bildschirm entfernt ist.

Dies macht die Interpretation einfach: Beträgt der Fehler 20 Pixel, wissen die Forscher sofort, um wie viel die Blickabschätzung innerhalb des digitalen Inhalts selbst abweicht – sei es eine Webseite, ein Video oder eine Benutzeroberfläche. Da die Größe der AOIs ebenfalls in Pixeln definiert ist, skaliert der Fehler natürlich mit ihnen, sodass die Forscher ein direktes Gespür dafür bekommen, wie sich die Genauigkeit auf AOI-basierte Analysen auswirkt. Der Pixelfehler verknüpft die Genauigkeit mit genau dem Medium, mit dem der Teilnehmer interagiert, und macht ihn so zu einem intuitiven und nützlichen Maß für die Bewertung der Leistung in bildschirmbasierten Experimenten.

Genauigkeit von Weltmodellen mit mehreren Kameras

Wenn Sie mit einem System arbeiten, das mithilfe mehrerer Kameras ein Weltmodell erstellt, wie beispielsweise das Smart Eye Pro-System, sind Sie nicht mehr auf eine flache Bildschirmreferenz beschränkt. In solchen Konfigurationen muss die Blickgenauigkeit relativ zu Objekten und Entfernungen im physischen Raum definiert werden. Anstelle von Pixeln können Abweichungen direkt in realen Einheiten wie Zentimetern oder Metern ausgedrückt werden. Konzeptionell handelt es sich um dasselbe Maß für die Genauigkeit – die Abweichung zwischen dem tatsächlichen und dem geschätzten Blick –, das jedoch an die räumliche Skala der Umgebung statt an einen Bildschirm angepasst ist.

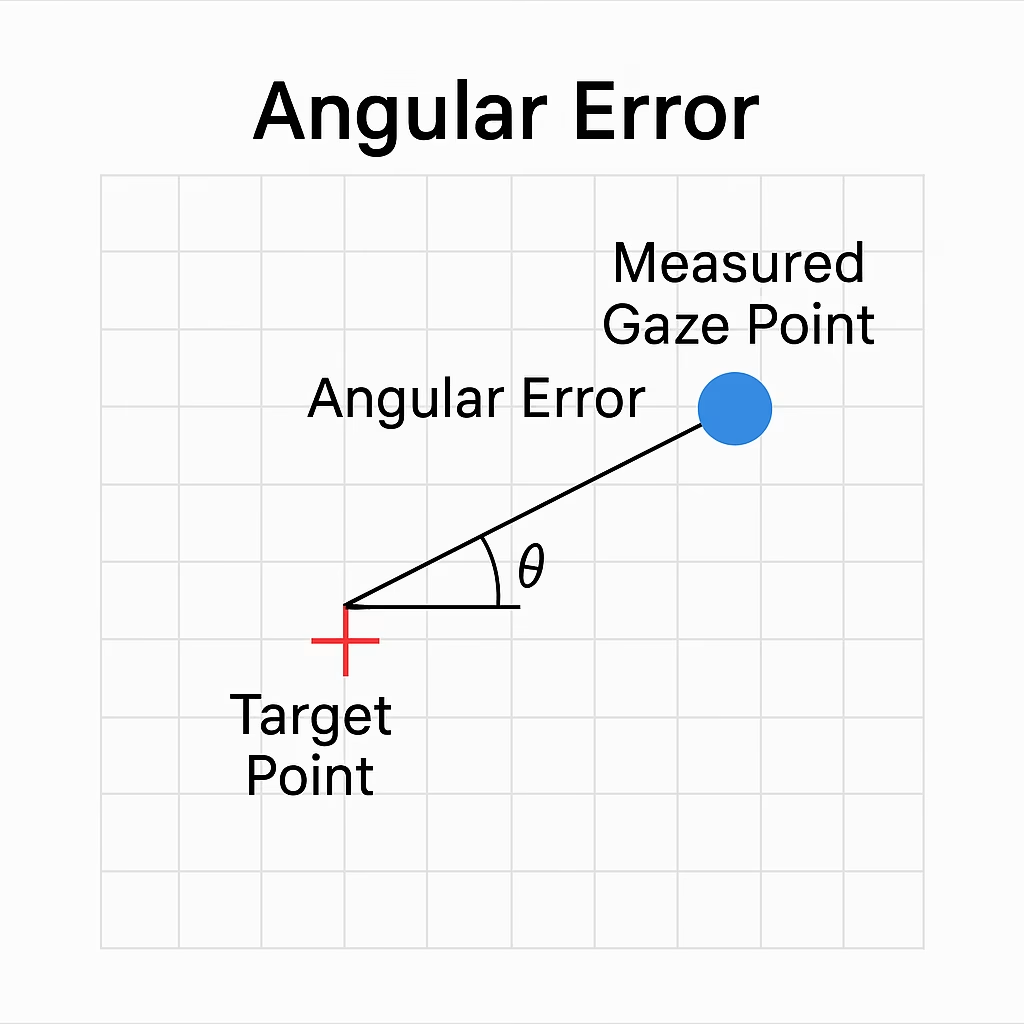

Winkelfehler

Der Winkelabweichungswert ist ein weiterer gängiger Maßstab für die Genauigkeit von Eye-Trackern. Er beschreibt den Winkelabstand in Bogengraden zwischen dem Punkt, auf den eine Person tatsächlich blickte (dem Kalibrierungsziel), und dem Punkt, an dem der Eye-Tracker ihren Blick vermutete.

So funktioniert es:

- Bei der Kalibrierung eines Eye-Trackers blickt der Teilnehmer auf bestimmte Punkte auf einem Bildschirm oder in der Umgebung.

- Das System schätzt daraufhin die Blickposition.

- Der Winkelabstand ist der Winkelabstand zwischen:

- Der eigentliche Stimuluspunkt (auf den der Teilnehmer blicken sollte).

- Der gemessene Blickpunkt (der Punkt, auf den der Eye-Tracker den Blick gerichtet vermutet).

Warum in Winkeln statt in Pixeln messen?

Würde die Genauigkeit nur in Pixeln angegeben, wären die Ergebnisse an eine bestimmte Bildschirmauflösung, Bildschirmgröße und Betrachtungsentfernung gebunden. Das bedeutet, dass derselbe Fehler ganz unterschiedlich aussehen könnte, je nachdem, ob man nah an einem kleinen Laptop-Bildschirm sitzt oder weiter entfernt von einem großen Monitor.

Durch die Angabe der Genauigkeit in Bogengraden wird die Messung unabhängig von der jeweiligen Aufstellung. So entspricht beispielsweise ein Winkelabweichung von 1° immer derselben visuellen Verschiebung für das Auge des Teilnehmers, unabhängig vom Bildschirm. In der Praxis entspricht 1° bei einem Betrachtungsabstand von 57 cm etwa 1 cm oder bei 114 cm etwa 2 cm. Dadurch wird der Winkelabweichung zu einem einheitlichen Standard, der es Forschern ermöglicht, die Genauigkeit über verschiedene Geräte, Labore und Untersuchungsbedingungen hinweg zu vergleichen.

Typische Werte

- Hochwertige Desktop-Eye-Tracker: ~0,3°–0,5° Winkelabweichung.

- Mobile oder brillenbasierte Systeme: oft 0,5°–1,0° oder mehr.

Bezug zur Genauigkeit

- Winkelabweichung = Genauigkeit (systematische Abweichung vom Sollwert).

- Präzision = Konsistenz (wie dicht die wiederholten Blickpunkte beieinander liegen).

Beides ist wichtig: Ein Tracker kann präzise, aber ungenau sein (die Blickpunkte liegen durchweg daneben) oder genau, aber unpräzise (die Blickpunkte sind um das Ziel herum verstreut).

Was die Genauigkeit der Blickverfolgung beeinflussen kann

Bei der Arbeit mit Eye-Tracking ist es wichtig zu verstehen, was „Genauigkeit“ eigentlich bedeutet. Wie bereits erwähnt, kann es auf kleineren Bildschirmen, wie beispielsweise bei Smartphones, den Anschein haben, als sei die Genauigkeit geringer. Dies ist jedoch lediglich darauf zurückzuführen, wie Pixelverschiebungen auf kleinen Displays dargestellt werden – es bedeutet nicht, dass der Eye-Tracker selbst weniger genau ist.

Allerdings können bestimmte Faktoren in der Praxis die Genauigkeit der Blickmessung durch einen Eye-Tracker beeinträchtigen. Zu den häufigsten Problemen zählen:

- Brillen mit starker Sehstärke oder Gleitsichtgläsern – Diese können das Licht verzerren, wodurch es für den Tracker schwieriger wird, den Blick richtig zu interpretieren.

- Brillen mit IR-Schutzbeschichtung – Da die meisten Eye-Tracker Infrarotlicht verwenden, können diese Gläser die Genauigkeit beeinträchtigen oder die Erfassung sogar gänzlich verhindern.

- Verschmutzte oder spiegelnde Gläser – Flecken, Fett oder starke Blendung können die Sensoren beeinträchtigen.

- Augenerkrankungen – Bei Teilnehmern mit Nystagmus oder ähnlichen Erkrankungen ist möglicherweise keine ordnungsgemäße Kalibrierung möglich.

- Gesichts- und Kopfbedeckungen – Das gleichzeitige Tragen von Kopfbedeckungen wie Hüten und Masken kann die Sicht behindern und die Blickverfolgung stören.

Bewährte Verfahren für Forscher

Um möglichst genaue Ergebnisse zu gewährleisten, können Forscher einige praktische Maßnahmen ergreifen:

- Bei Verwendung kleinerer Bildschirme – Überprüfen Sie die Ergebnisse manuell auf der Registerkarte „Überprüfung“. Bitten Sie die Teilnehmer, vor Beginn der Studie ihren Blick auf bestimmte Punkte zu richten, um die Genauigkeit zu bestätigen.

- Teilnehmer mit Brille

- Teilnehmer, die eine IR-Schutzbrille oder eine Gleitsichtbrille tragen, sind von der Teilnahme ausgeschlossen.

- Andere Brillenträger können je nach Kalibrierungsqualität nach Ermessen des Forschers einbezogen oder ausgeschlossen werden.

- Teilnehmer mit bestimmten Erkrankungen – Personen, die sich einer Augenoperation unterzogen haben oder unter Nystagmus oder ähnlichen Beschwerden leiden, können möglicherweise keine gute Kalibrierung vornehmen und sollten daher oft ausgeschlossen werden.

- Raumgestaltung – Verwenden Sie eine kontrollierte Beleuchtung, die Infrarotstrahlung vermeidet. Eine Beleuchtung von oben oder von vorne ist am besten geeignet, vermeiden Sie jedoch Reflexionen auf den Brillen der Teilnehmer.

- Ergonomie – Verwenden Sie einen festen Stuhl, um Kopfbewegungen auf ein Minimum zu reduzieren. Kombinieren Sie diesen mit einem höhenverstellbaren Tisch, damit die Aufstellung für jeden Teilnehmer bequem ist.