Mithilfe von KI-gestützter Emotionserkennungstechnologie können Maschinen menschliche Emotionen anhand von Gesichtsausdrücken, Gesten und Körpersprache interpretieren. Die hochentwickelte KI von Affectiva misst emotionales Engagement und Valenz und ordnet Gesichtsausdrücke mit hoher Genauigkeit bestimmten Emotionen zu. Erfahren Sie, wie diese bahnbrechende Technologie die Interaktion zwischen Mensch und KI verändert.

Table of Contents

Die KI-gestützte Technologie zur Emotionserkennung wird manchmal auch als Emotionserkennungs- oder Emotionsdetektionstechnologie bezeichnet. Menschen nutzen zahlreiche nonverbale Signale wie Mimik, Gestik, Körpersprache und Tonfall, um ihre Emotionen auszudrücken.

Bei Affectiva ist es unsere Vision, eine KI-gestützte Emotionserkennung zu entwickeln, die Emotionen genauso erkennen kann wie Menschen. Unser langfristiges Ziel ist es, intuitivere Werkzeuge zu entwickeln, die ein tieferes Verständnis der menschlichen Wahrnehmung durch KI ermöglichen.

Lassen Sie uns einen genaueren Blick auf die von uns angebotenen Emotionskennzahlen werfen, darauf, wie wir diese berechnen und den Emotionen zuordnen, und wie wir die Genauigkeit dieser Kennzahlen ermitteln.

Affectiva-Emotionsmetriken: Die vollständige Liste

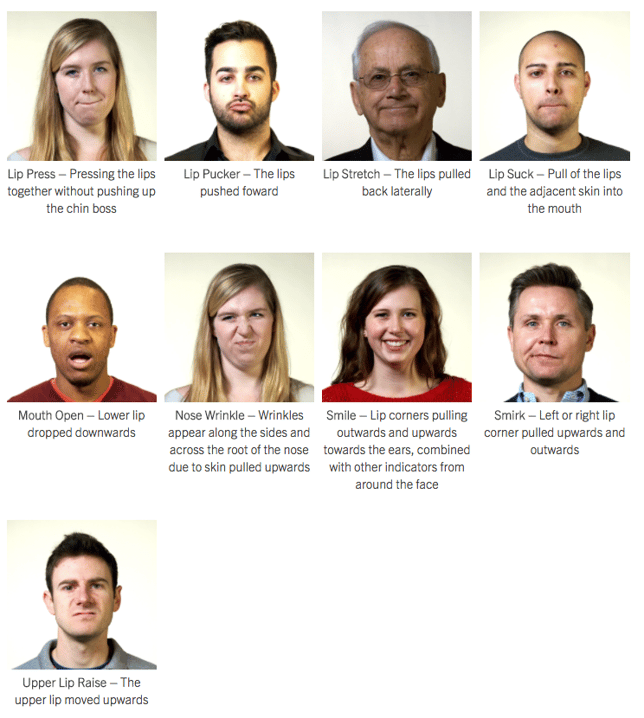

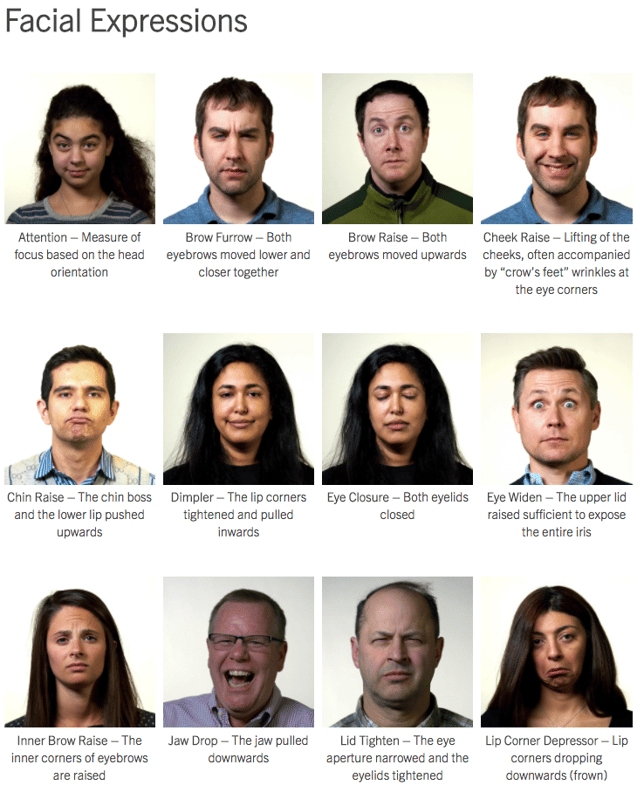

Das Gesicht ist eine reichhaltige Leinwand für Emotionen. Der Mensch ist von Natur aus darauf programmiert, Emotionen durch Mimik auszudrücken und zu vermitteln. Unsere Technologie misst und erfasst Emotionen und Gesichtsausdrücke wissenschaftlich mithilfe ausgefeilter Techniken der Bildverarbeitung und des maschinellen Lernens.

Wenn Sie das Affectiva SDK in Ihren Anwendungen verwenden, erhalten Sie die Ergebnisse zur Gesichtsausdrucksanalyse in Form von neun Emotionsmetriken und 20 Gesichtsausdrucksmetriken.

Gefühle

Darüber hinaus ermöglicht das SDK die Messung von Valenz und Engagement als alternative Kennzahlen zur Erfassung des emotionalen Erlebnisses. Lassen Sie uns näher erläutern, was wir unter Engagement und Valenz verstehen.

Wie berechnet Affectiva das emotionale Engagement?

Engagement, auch als „Expressivität“ bezeichnet, wird als Maß für die Aktivierung der Gesichtsmuskulatur definiert, das die emotionale Beteiligung der Testperson widerspiegelt. Der Wertebereich reicht von 0 bis 100. Das Engagement ist eine gewichtete Summe der folgenden Gesichtsausdrücke:

- Anhebung der inneren und äußeren Augenbrauen.

- Stirnrunzeln.

- Wangenheben.

- Die Nase rümpfen.

- Lippenwinkel-Abspreizer.

- Kinnheben.

- Lippenpresse.

- Mund auf.

- Lippen saugen.

- Lächle.

Wie berechnet Affectiva die emotionale Valenz?

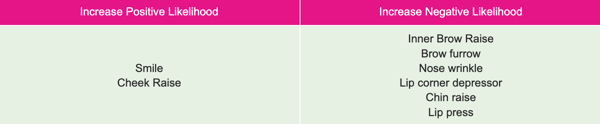

Die Valenz ist ein Maß für den positiven oder negativen Charakter der Erfahrung der aufgezeichneten Person. Der Wertebereich reicht von -100 bis 100. Die Wahrscheinlichkeit der Valenzmetrik wird auf der Grundlage einer Reihe beobachteter Gesichtsausdrücke berechnet:

Wie ordnet Affectiva Gesichtsausdrücke bestimmten Emotionen zu?

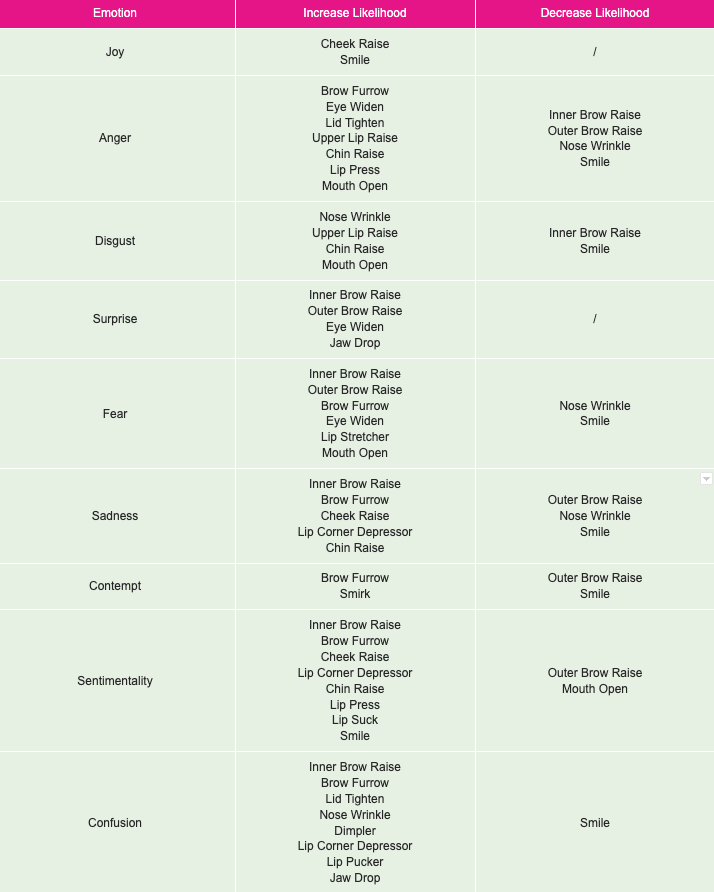

Die Emotionsprädiktoren verwenden die beobachteten Gesichtsausdrücke als Eingabe, um die Wahrscheinlichkeit einer Emotion zu berechnen. Unsere Zuordnung von Gesichtsausdrücken zu Emotionen baut auf den von Friesen & Ekman entwickelten EMFACS-Zuordnungen auf. Darüber hinaus sind unsere Metriken für Sentimentalität und Verwirrung einzigartig bei Affectiva und werden aus einer maßgeschneiderten Analyse abgeleitet, die auf den Videoinhalten basiert, auf die die Menschen reagieren.

Ein Gesichtsausdruck kann sich entweder positiv oder negativ auf die Wahrscheinlichkeit einer Emotion auswirken. Die folgende Tabelle zeigt den Zusammenhang zwischen den Gesichtsausdrücken und den Prädiktoren für Emotionen.

Erfahren Sie hier mehr über unser SDK

Verwendung der Emotionsmetriken von Affectiva

Die Werte der Emotions- und Ausdrucksmetriken zeigen an, wann Nutzer eine bestimmte Emotion oder einen bestimmten Gesichtsausdruck (z. B. ein Lächeln) zeigen, und geben den Grad der Sicherheit an. Man kann sich diese Metriken als Detektoren vorstellen: Wenn die Emotion oder der Gesichtsausdruck auftritt und sich verstärkt, steigt der Wert von 0 (kein Ausdruck) auf 100 (Ausdruck vollständig vorhanden).

Darüber hinaus stellen wir eine zusammengesetzte emotionale Kennzahl namens „Valenz“ bereit, die Aufschluss über das Gesamterlebnis gibt. Valenzwerte von 0 bis 100 stehen für ein neutrales bis positives Erlebnis, während Werte von -100 bis 0 ein negatives bis neutrales Erlebnis anzeigen.

Bestimmung der Genauigkeit

Wir trainieren und testen unsere Ausdrucksmetriken kontinuierlich, um die zuverlässigsten und genauesten Klassifikatoren bereitzustellen.

Unsere Metriken zur Erkennung von Gesichtsausdrücken wurden anhand sehr anspruchsvoller Datensätze trainiert und getestet. Unser Testdatensatz, der aus Hunderttausenden von Gesichtsbildern besteht, wurde aus mehr als 6 Millionen Gesichtsvideos zusammengestellt. Diese Daten stammen aus über 90 Ländern und zeigen reale, spontane Gesichtsausdrücke, die unter schwierigen Bedingungen aufgenommen wurden, wie beispielsweise wechselnde Lichtverhältnisse, unterschiedliche Kopfbewegungen sowie Abweichungen bei den Gesichtszügen aufgrund von ethnischer Zugehörigkeit, Alter, Geschlecht, Bartwuchs und Brillen.

Wie misst Affectiva die Genauigkeit?

Affectiva verwendet die Fläche unter der ROC-Kurve (Receiver Operating Characteristic), um die Genauigkeit des Erkenners anzugeben, da dies die allgemein gültigste Methode zur Messung der Erkennungsgenauigkeit ist. Die ROC-Werte liegen zwischen 0 und 1; je näher der Wert an 1 liegt, desto genauer ist der Klassifikator. Viele Gesichtsausdrücke, wie beispielsweise Lächeln, Stirnrunzeln, offener Mund, geschlossene Augen und hochgezogene Augenbrauen, weisen einen ROC-Wert von über 0,9 auf.

Zu den differenzierteren Gesichtsausdrücken, die selbst für Menschen viel schwieriger zuverlässig zu erkennen sind, gehören das Herabziehen der Mundwinkel, das Weiten der Augen und das Anheben der inneren Augenbrauen. Diese weisen einen ROC-Wert von über 0,8 auf.

Gesichtsverfolgung und Schätzung des Kopfwinkels

Die SDKs enthalten unseren neuesten Gesichts-Tracker, der die folgenden Kennzahlen berechnet:

- Schätzung von Gesichtsmarkern: Die Verfolgung der kartesischen Koordinaten von vier Gesichtsmarkern.

- Schätzung der Kopfausrichtung: Schätzung der Kopfposition im dreidimensionalen Raum in Eulerwinkeln (Neigung, Gierung, Rollwinkel).

- Augenabstand: Der Abstand zwischen den beiden äußeren Augenwinkeln.

Sind Sie bereit, mit der KI-gestützten Emotionserkennung loszulegen?

Wir wissen, dass dieser Beitrag aus der Reihe „101“ eine Menge Stoff zum Verarbeiten ist – und nun sind Sie ein Experte für Emotionserkennung! Das Erkennen von Emotionen mithilfe von Technologie ist eine äußerst komplexe Herausforderung, aber ich bin mir sicher, dass Sie sich die vielen Anwendungsmöglichkeiten vorstellen können, wenn diese Technologie richtig integriert wird. Wir wollten Ihnen auch vermitteln, wie viel Raffinesse erforderlich ist, um Gesichtsausdrücke präzise in Emotionen zu übersetzen.

Im Sinne der Transparenz wollten wir außerdem sicherstellen, dass Sie nicht nur verstehen, welche Funktionen und Möglichkeiten wir anbieten, sondern auch, wie wir zu diesen gekommen sind. Sie können jederzeit unseren Bereich „Wissenschaftliche Ressourcen“ besuchen, um mehr über unsere Technologie zu erfahren, oder sich unsere Patente zur Emotionserkennung ansehen, die uns erteilt wurden.