Die moderne Erforschung von Gesichtsausdrücken begann mit einem Studienabbrecher der Medizin, der den größten Teil seiner frühen 20er Jahre damit verbrachte, die Welt zu bereisen. Nach seiner Rückkehr schrieb er ein Buch. Auch wenn ein Rezensent damals meinte, „einige Passagen seien etwas langatmig“, legte dieses Werk den Grundstein für die Art und Weise, wie wir heute weitgehend über Gesichtsausdrücke denken. Dieser Studienabbrecher der Medizin war Charles Darwin, der die Wissensgebiete der Evolution und der Emotionen prägte.

Als Darwin das Buch verfasste, nutzte er Stiche, Illustrationen, Diagramme und Fotografien, um die Muskelbewegungen des Gesichts beim Zeigen von Emotionen zu untersuchen. Er behauptete, das Gesicht könne sechzig unterschiedliche Gesichtsausdrücke hervorbringen, die sich auf nur sechs Emotionen zurückführen ließen: Wut, Angst, Überraschung, Ekel, Freude und Traurigkeit [1].

Seit Darwins Zeiten hat sich in der Erforschung von Gesichtsausdrücken viel verändert. Auch wenn seine Kernkonzepte nach wie vor unser Verständnis der Beziehung zwischen Gesicht und Emotionen prägen, ist dieses Verständnis mittlerweile differenzierter geworden, und die Methoden sind weiter fortgeschritten. Anstatt Gesichtsausdrücke direkt mit Emotionen in Verbindung zu bringen, wissen wir heute, dass diese Beziehung subtiler und komplexer sein kann [2]. Und statt Illustrationen und Diagrammen verwenden wir Videoaufnahmen, die automatisch analysiert werden können.

Das Modul zur Mimikanalyse von iMotions wurde entwickelt, um die Analyse von Gesichtsausdrücken sowohl aussagekräftig als auch effizient zu gestalten. Gesichtsausdrücke werden automatisch anhand von Videoaufnahmen analysiert – sei es live oder aus dem Archiv. Die Ergebnisse werden anschließend ausgewertet, sodass Sie ein Verständnis für die Gesichtsbewegungen und deren Zusammenhang mit emotionalen Ausdrucksformen erhalten. Im Folgenden geben wir Ihnen einen Überblick über alle Funktionen, die iMotions bietet, um Ihre Forschung erfolgreich zu gestalten.

Table of Contents

Erfassung von FEA-Daten: Live- oder aufgezeichnete Daten

Die Analyse von Gesichtsausdrücken kann praktisch überall durchgeführt werden – alles, was man dazu braucht, ist ein Videostream oder eine Videoaufzeichnung. Dank dieser Flexibilität können die Teilnehmer entweder ins Labor kommen oder Sie können Videos sammeln, die extern aufgezeichnet wurden. Es können Aufnahmen aus Fernsehinterviews, Livestreams oder selbst aufgenommene Videos verwendet werden – überall dort, wo Gesichtsausdrücke zu sehen sind. Diese Flexibilität bedeutet auch, dass mehrere Datenerhebungen gleichzeitig stattfinden können – die Aufnahmen müssen nicht darauf beschränkt sein, dass jeweils nur eine Person am Datenerfassungscomputer anwesend ist. Die Nachbearbeitung kann dann im Hintergrund in die Warteschlange gestellt werden, sodass Sie nie ausgebremst werden – und sich stattdessen auf das Verständnis der Daten konzentrieren können.

Weiterlesen: Wie die Analyse von Gesichtsausdrücken aus der Ferne durchgeführt werden kann

Verhaltensforschung in der Praxis

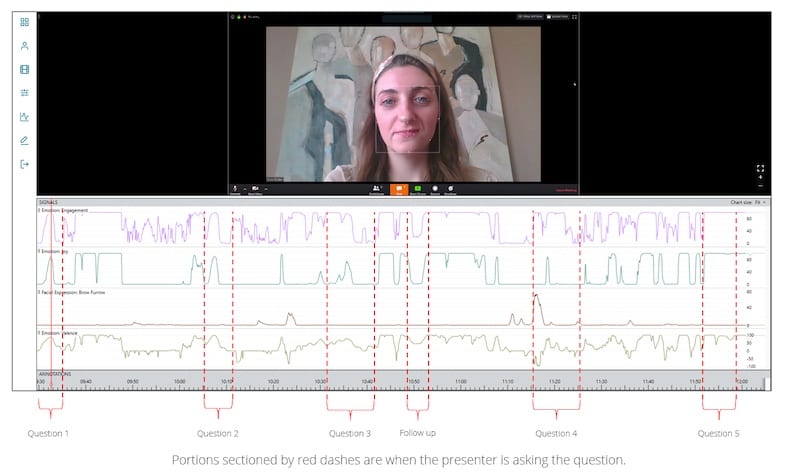

Neben der Nachbearbeitung beliebiger früherer Aufzeichnungen ist es auch möglich, Daten, die von mobilen Geräten wie Smartphones oder Tablets eingehen, in Echtzeit zu analysieren. Dies lässt sich zudem problemlos mit anderen Biosensoren kombinieren, was eine Vielzahl von Möglichkeiten eröffnet, um Interaktionen unmittelbar zu erfassen. Darüber hinaus kann dies mit Zeitachsen-Anmerkungen und LiveMarkern für eine erweiterte Verhaltenskodierung verknüpft werden.

Funktionen zur Datenexportierung und -visualisierung

Mit iMotions lassen sich Daten bei Bedarf problemlos in verschiedene Formate exportieren, um sie weiter zu analysieren. Durch Anmerkungen und Markierungen in den Daten können bestimmte Segmente ausgewählt und nach Belieben exportiert werden.

Mit iMotions können Sie genau auswählen, welche Sensordaten (oder Kombination von Sensordaten) exportiert werden sollen, sodass Sie sich auf das konzentrieren können, was Sie benötigen. Die umfangreiche Datenmenge, die erfasst wird, kann in iMotions verbleiben, falls sie später benötigt wird oder erneut exportiert werden soll.

iMotions: Eine umfassende experimentelle Plattform

Nahezu jeder Schritt des Versuchsablaufs lässt sich in iMotions durchführen – vom Versuchsdesign (Reihenfolge der Stimuli, Teilnehmerdaten, Gruppeneinteilung) über die Präsentation der Stimuli bis hin zur Datenerfassung, -verarbeitung (oder auch nur zur Nachbearbeitung) und zum Datenexport.

Es ist daher nicht erforderlich, verschiedene Softwareprogramme für die Stimuluspräsentation, die Gesichtsverfolgung, die Gesichtsauswertungen oder zur Erfassung der Gruppenzugehörigkeit der Teilnehmer zu verwenden. Dies sorgt für einen optimierten und einfach durchführbaren Ablauf bei der Durchführung von Experimenten.

Über 20 Messgrößen für Gesichtsausdrücke

Das Modul zur Gesichtsausdrucksanalyse liefert über 20 Messgrößen für Gesichtsausdrücke (auch als „Action Units“ bezeichnet), Daten zu sieben Grundemotionen (Freude, Wut, Angst, Ekel, Verachtung, Traurigkeit und Überraschung), Gesichtsmarker sowie Verhaltensindikatoren wie Kopfausrichtung, Kopfdrehung und sogar den Grad der Aufmerksamkeit der Teilnehmer.

Die Empfindlichkeit der Messungen lässt sich zudem je nach Versuchssituation anpassen, sodass Sie die volle Kontrolle über den Datenerfassungsprozess haben. Ein Einblick in Emotionen kann ein anspruchsvolles Unterfangen sein, doch die Gesichtsausdrucksanalyse mit iMotions bringt Sie diesem Ziel so nahe wie möglich.

Siehe auch: Facial Action Coding System (FACS) – Ein visueller Leitfaden

Integrationen verschiedener Modalitäten

iMotions zeichnet sich durch seine Integrationsmöglichkeiten aus – es ermöglicht die Anbindung zahlreicher verschiedener Biosensoren, um eine tiefgreifendere Analyse des menschlichen Verhaltens zu ermöglichen. Biosensoren wie Eye-Tracker (bildschirmbasiert, als Brille und in VR), EEG, EDA, EKG und EMG (unter anderem) lassen sich nahtlos in das Experiment einbinden.

Diese Sensoren können die Daten ergänzen, indem sie ein tieferes Verständnis ermöglichen, das sonst fehlen würde. Die Daten können Aufschluss über Aufmerksamkeitsprozesse, kognitive Veränderungen und physiologische Erregungszustände geben – Informationen, die bei einer alleinigen Betrachtung von Gesichtsausdrucksdaten nicht verfügbar sind.

Über das Lab Streaming Layer (LSL)-Protokoll lassen sich auch zahlreiche andere Sensoren anschließen, die nicht standardmäßig integriert sind. Auf diese Weise können Daten von anderen Sensoren an iMotions gesendet und mit anderen Datenquellen synchronisiert werden (hier finden Sie eine Liste der von LSL unterstützten Geräte und Tools).

Haftungsausschluss: Überprüfen Sie unbedingt die Datenqualität, wenn Sie eine Verbindung über LSL-Anwendungen von Drittanbietern herstellen, bevor Sie Ihre endgültige Studie durchführen – einige LSL-Apps wurden möglicherweise seit längerer Zeit nicht mehr getestet und können Fehler enthalten, die durch ein Update behoben werden müssen.

Darüber hinaus ist es möglich, über unsere offene API praktisch jeden beliebigen Datenstrom anzubinden. Dies kann beispielsweise zur Realisierung von Gehirn-Computer-Schnittstellen oder für Biofeedback genutzt werden. Praktisch jedes Gerät, das Daten erzeugt, lässt sich mit iMotions verbinden, was neue Forschungsmöglichkeiten eröffnet.

Weiterlesen: Was ist eine API und wie funktioniert sie?

Die Analyse von Gesichtsausdrücken blickt auf eine überraschend lange Geschichte zurück, hat jedoch erst vor kurzem den Sprung in die Moderne geschafft. Das Modul zur Gesichtsausdrucksanalyse von iMotions hilft Ihnen dabei, Forschung an der Spitze dieser Entwicklungen zu betreiben – um Emotionen wie nie zuvor zu erfassen.

Literaturverzeichnis

[1] Darwin, C. (1872). Der Ausdruck der Emotionen bei Menschen und Tieren. London: J. Murray.

[2] Russell, J.A., Barrett, L.F. (1999). Kernaffekte, prototypische emotionale Episoden und andere Dinge, die als Emotionen bezeichnet werden: Eine Analyse des Elefanten. Journal of Personality and Social Psychology, Band 76, Nr. 5, S. 805–819.